最小二乘法求回归直线方程的推导过程 |

您所在的位置:网站首页 › 最小二乘法求回归方程公式 › 最小二乘法求回归直线方程的推导过程 |

最小二乘法求回归直线方程的推导过程

|

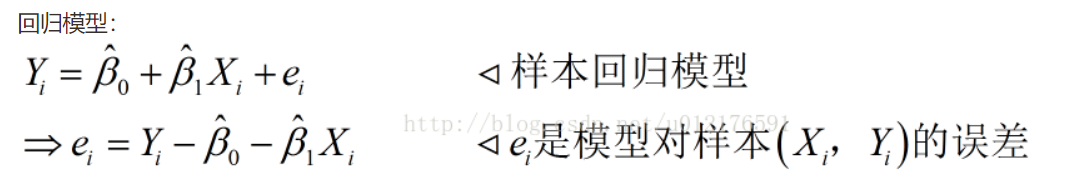

在数据的统计分析中,数据之间即变量x与Y之间的相关性研究非常重要,通过在直角坐标系中做散点图的方式我们会发现很多统计数据近似一条直线,它们之间或者正相关或者负相关。虽然这些数据是离散的,不是连续的,我们无法得到一个确定的描述这种相关性的函数方程,但既然在直角坐标系中数据分布接近一条直线,那么我们就可以通过画直线的方式得到一个近似的描述这种关系的直线方程。当然,从前面的描述中不难看出,所有数据都分布在一条直线附近,因此这样的直线可以画出很多条,而我们希望找出其中的一条,能够最好地反映变量之间的关系。换言之,我们要找出一条直线,使这条直线“最贴近”已知的数据点,设此直线方程为: ① y ^ = a + b x ①\hat{y}=a+bx ①y^=a+bx 这里的 y ^ \hat{y} y^ 是为了区分Y的实际值 y(这里的实际值就是统计数据的真实值,我们称之为观察值),当 x i x_{i} xi 取值(i=1,2,3……n)时,Y的观察值为 y ^ \hat{y} y^ ,近似值为 y ^ \hat{y} y^ (或者说对应 x i x_{i} xi 的纵坐标是 y ^ = a + b x i \hat{y}=a+bx_{i} y^=a+bxi)。 其中①式叫做Y对x的回归直线方程,b叫做回归系数。要想确定回归直线方程①,我们只需确定a与回归系数b即可。 设x,Y的一组观察值为: ( x i x_{i} xi , y i y_{i} yi ) i = 1 , 2 , 3 … … n i = 1,2,3……n i=1,2,3……n 其回归直线方程为: y ^ = a + b x \hat{y}=a+bx y^=a+bx 当x取值(i=1,2,3……n)时,Y的观察值为

y

i

y_{i}

yi,差

y

i

y_{i}

yi -

y

^

\hat{y}

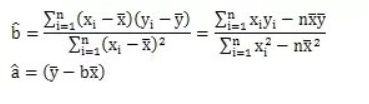

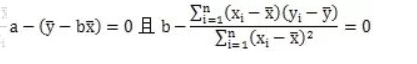

y^刻画了实际观察值与回归直线上相应点纵坐标之间的偏离程度,见下图: 一个很自然的想法是把各个离差加起来作为总离差。可是,由于离差有正有负,直接相加会互相抵消,如此就无法反映这些数据的贴近程度,即这个总离差不能用n个离差之和来表示,见下图: 用最小二乘法求回归直线方程中的a、b的公式如下:

基本变形公式准备完毕,我们可以开始最小二乘法求回归直线方程公式的推导了:

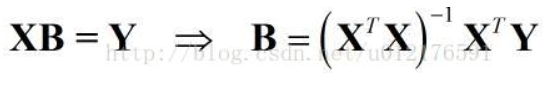

首先给出最小二乘解的矩阵形式的公式:

一般线性模型,即普通最小二乘法( Ordinary Least Square,OLS):所选择的回归模型应该使所有观察值的残差平方和达到最小。 以简单线性模型 y = b1t +b0 作为例子。

https://blog.csdn.net/lql0716/article/details/70165695 https://blog.csdn.net/Sunshine_in_Moon/article/details/45797343 https://blog.csdn.net/bitcarmanlee/article/details/51589143 |

【本文地址】

今日新闻 |

推荐新闻 |

实际上我们希望这n个离差构成的总离差越小越好,只有如此才能使直线最贴近已知点。换句话说,我们求回归直线方程的过程其实就是求离差最小值的过程。

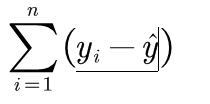

实际上我们希望这n个离差构成的总离差越小越好,只有如此才能使直线最贴近已知点。换句话说,我们求回归直线方程的过程其实就是求离差最小值的过程。 一般做法是我们用离差的平方和,即:

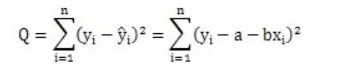

一般做法是我们用离差的平方和,即:  作为总离差 ,并使之达到最小。这样回归直线就是所有直线中Q取最小值的那一条。由于平方又叫二乘方,所以这种使“离差平方和为最小”的方法,叫做最小二乘法。

作为总离差 ,并使之达到最小。这样回归直线就是所有直线中Q取最小值的那一条。由于平方又叫二乘方,所以这种使“离差平方和为最小”的方法,叫做最小二乘法。

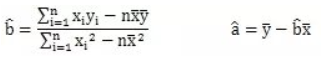

当然,我们肯定不能满足于直接得到公式,我们只有理解这个公式怎么来的才能记住它,用好它,因此给出上面两个公式的推导过程更加重要。在给出上述公式的推导过程之前,我们先给出推导过程中用到的两个关键变形公式的推导过程。首先是第一个公式:

当然,我们肯定不能满足于直接得到公式,我们只有理解这个公式怎么来的才能记住它,用好它,因此给出上面两个公式的推导过程更加重要。在给出上述公式的推导过程之前,我们先给出推导过程中用到的两个关键变形公式的推导过程。首先是第一个公式: 接着是第二个公式:

接着是第二个公式:

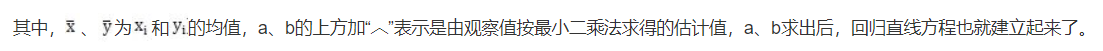

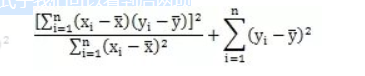

至此,公式变形部分结束,从最终式子我们可以看到后两项

至此,公式变形部分结束,从最终式子我们可以看到后两项  与a、b无关,属于常数项,我们只需

与a、b无关,属于常数项,我们只需 即可得到最小的Q值,因此:

即可得到最小的Q值,因此: