HDFS客户端操作(开发重点) |

您所在的位置:网站首页 › 大学钱被偷了能报警吗 › HDFS客户端操作(开发重点) |

HDFS客户端操作(开发重点)

|

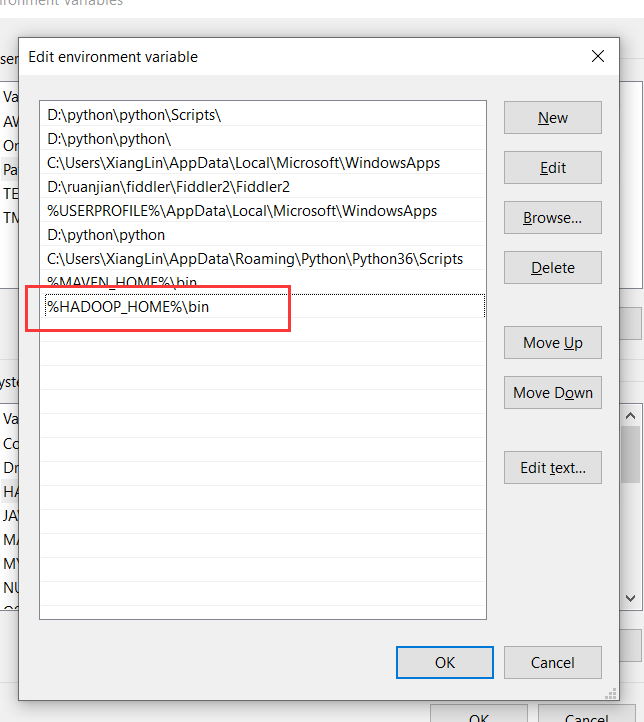

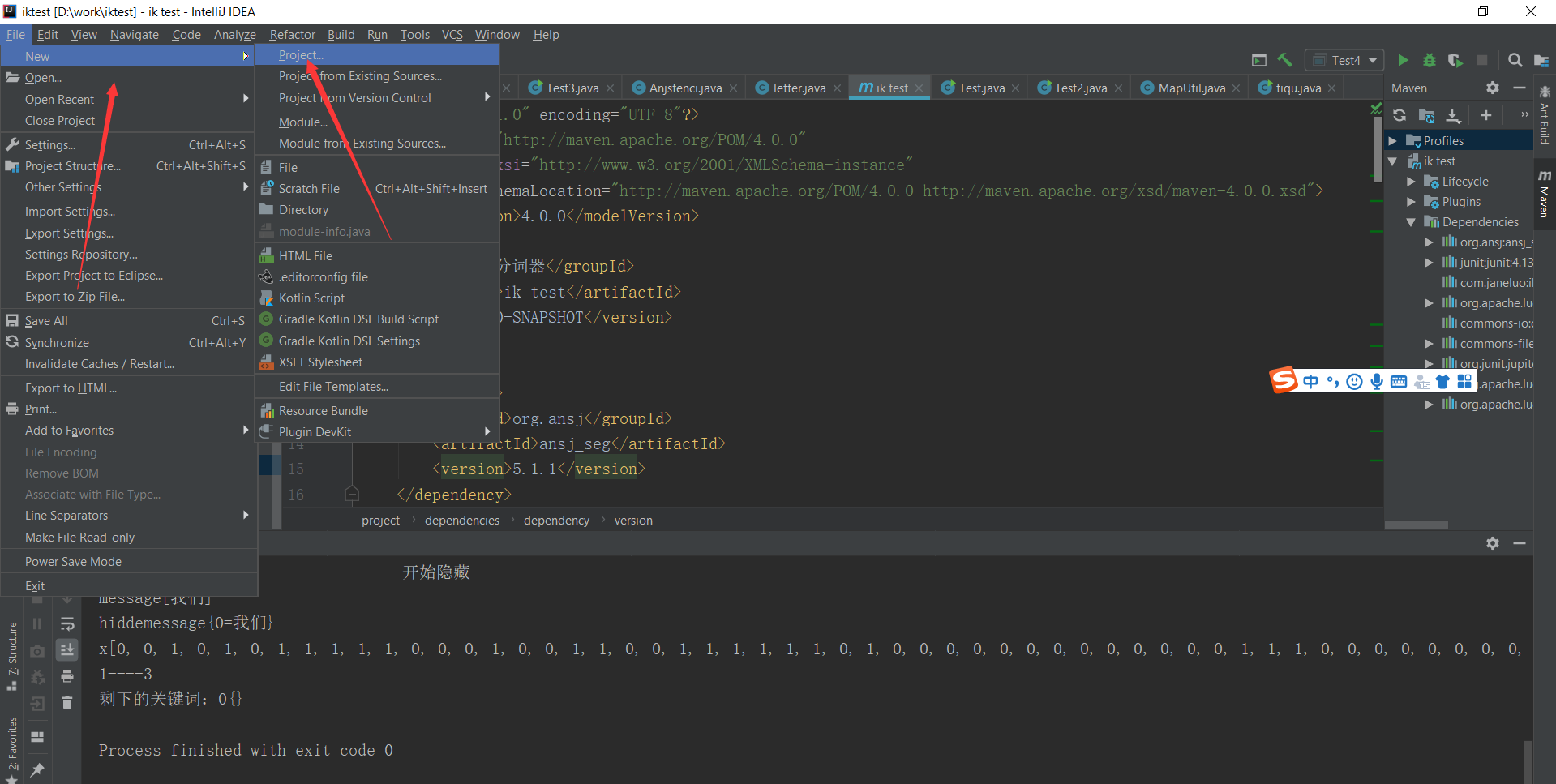

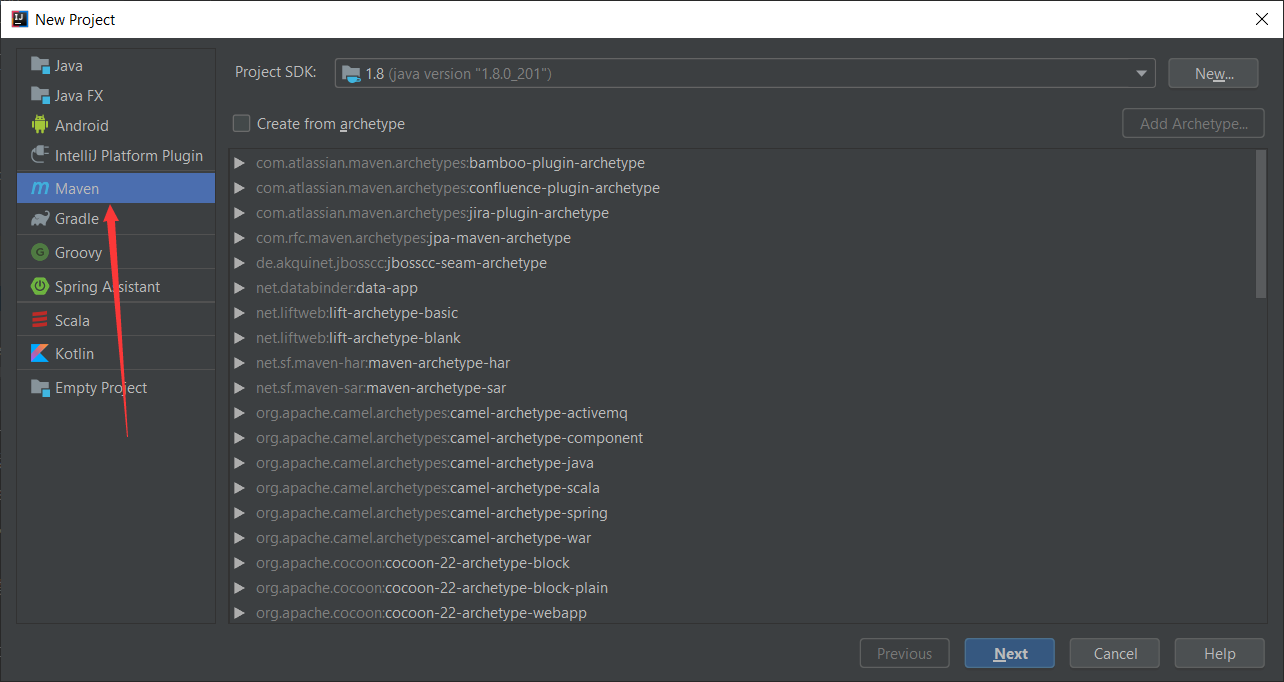

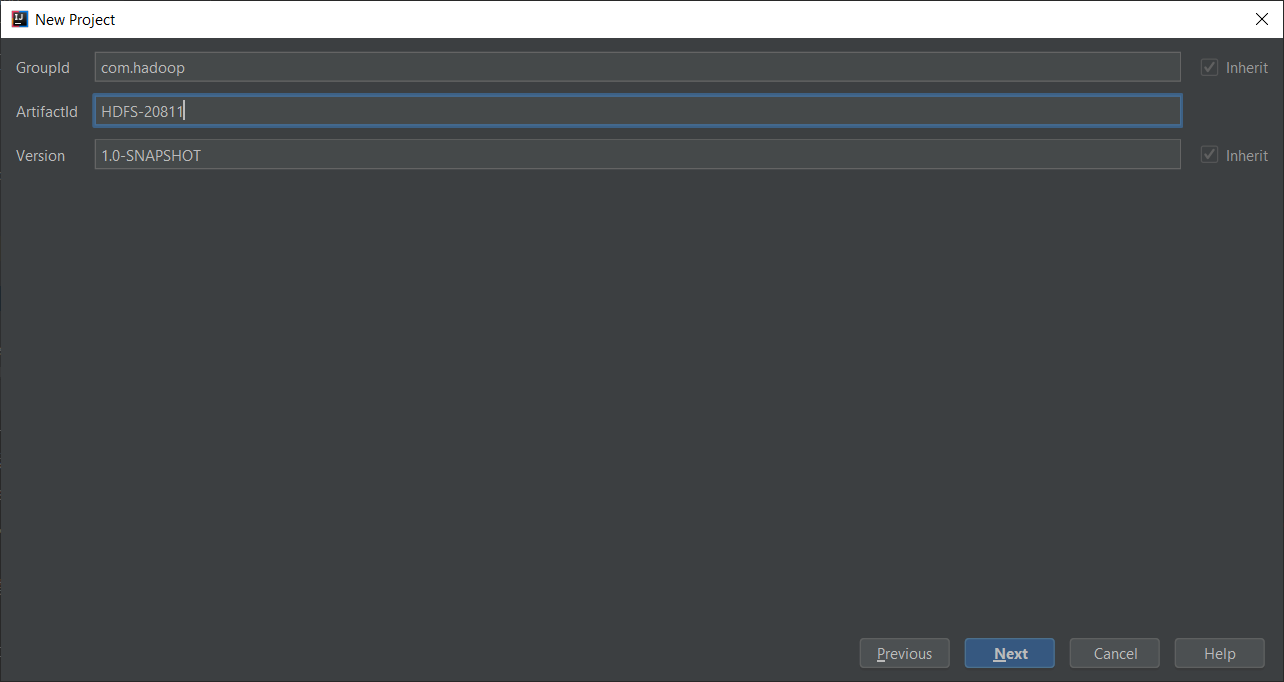

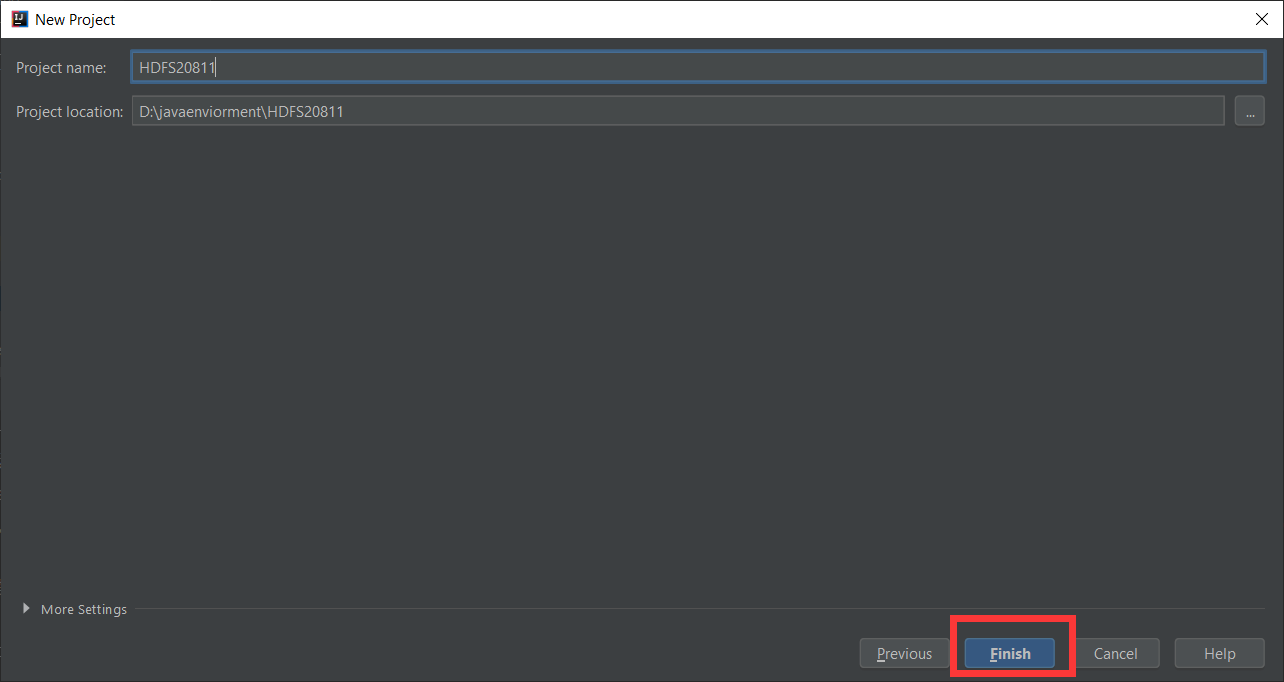

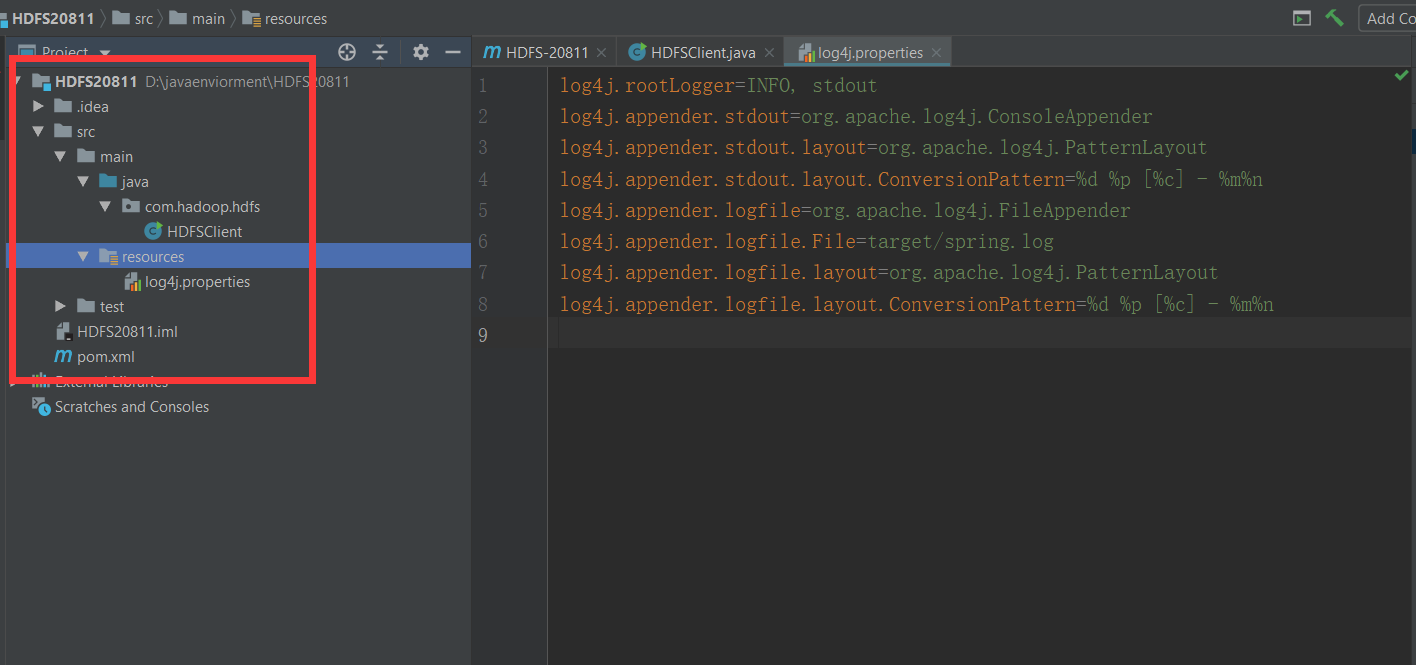

参考尚硅谷hadoop公开课 HDFS客户端环境准备1.根据自己电脑的操作系统拷贝对应的编译后的hadoop jar包到非中文路径(例如:D:\hadoop\hadoop-2.7.2),如图所示。 2.配置HADOOP_HOME环境变量,如图所示。 4.创建一个Maven工程HdfsClientDemo 1. 4.创建一个Maven工程Hdfs20811 5.导入相应的依赖坐标+日志添加 junit junit RELEASE org.apache.logging.log4j log4j-core 2.8.2 org.apache.hadoop hadoop-common 2.7.2 org.apache.hadoop hadoop-client 2.7.2 org.apache.hadoop hadoop-hdfs 2.7.2 jdk.tools jdk.tools 1.8 system ${JAVA_HOME}/lib/tools.jar 注意:如果Eclipse/Idea打印不出日志,在控制台上只显示 1.log4j:WARN No appenders could be found for logger (org.apache.hadoop.util.Shell). 2.log4j:WARN Please initialize the log4j system properly. 3.log4j:WARN See http://logging.apache.org/log4j/1.2/faq.html#noconfig for more info.需要在项目的src/main/resources目录下,新建一个文件,命名为“log4j.properties”,在文件中填入 log4j.rootLogger=INFO, stdout log4j.appender.stdout=org.apache.log4j.ConsoleAppender log4j.appender.stdout.layout=org.apache.log4j.PatternLayout log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n log4j.appender.logfile=org.apache.log4j.FileAppender log4j.appender.logfile.File=target/spring.log log4j.appender.logfile.layout=org.apache.log4j.PatternLayout log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n6.创建包名:com.hadoop.hdfs 8.执行程序 运行时需要配置用户名称,如图所示

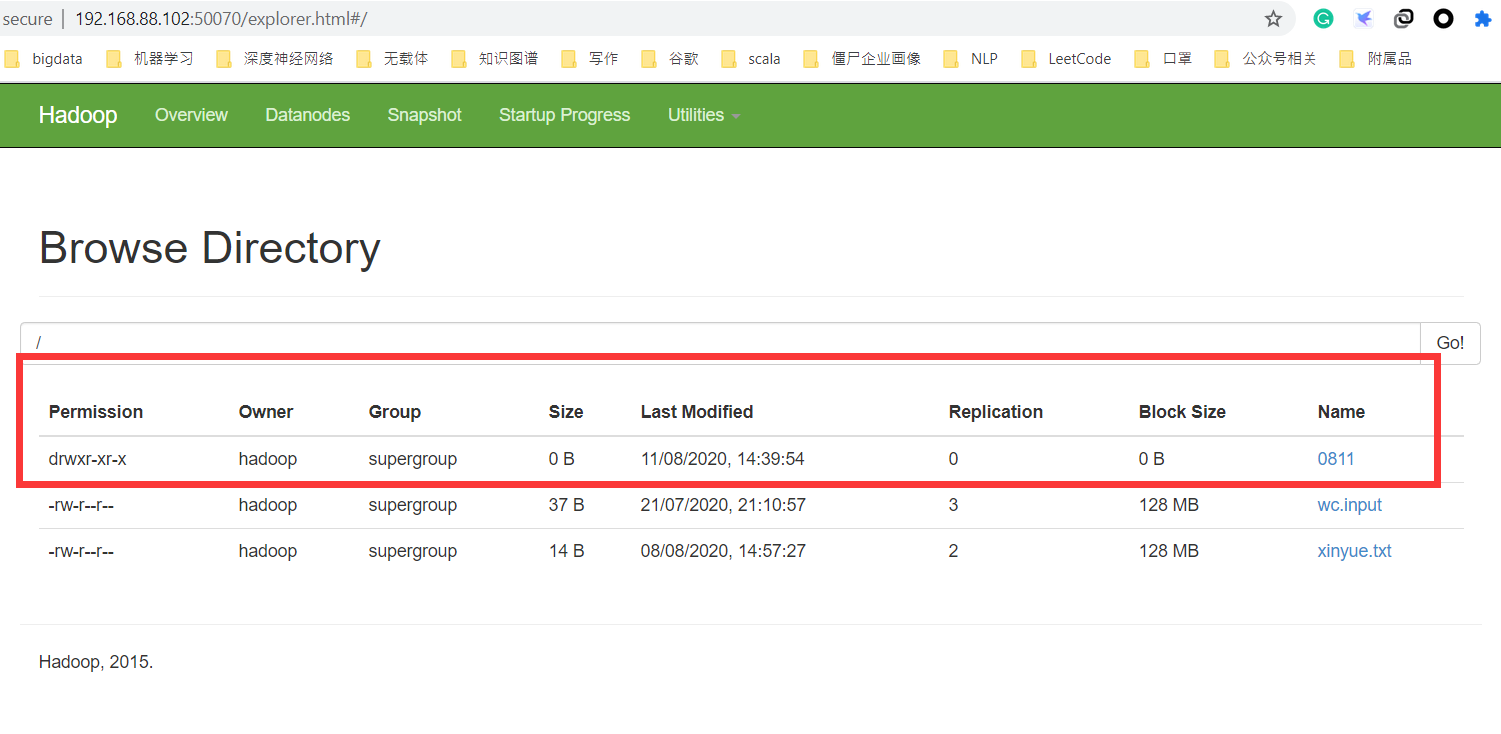

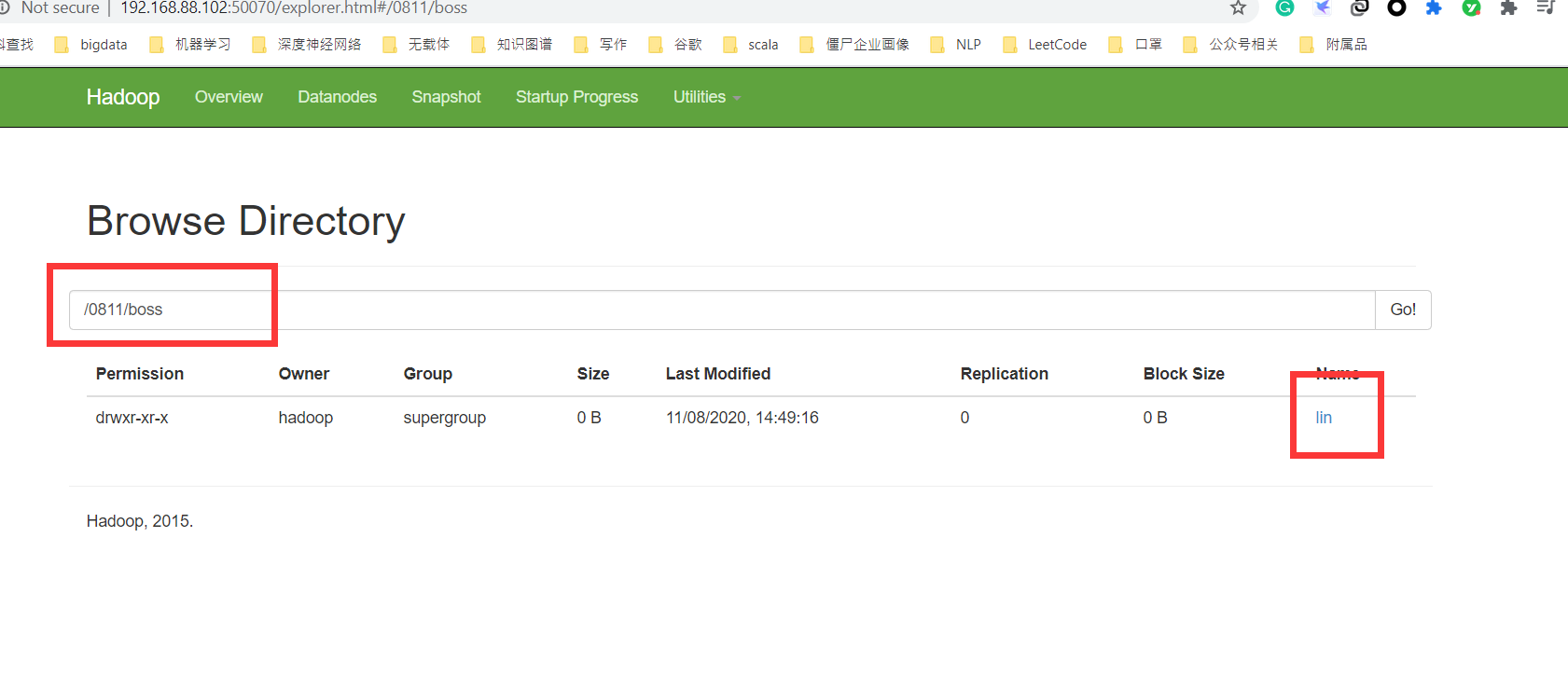

下面这种不需要配置也是OK的; public class HDFSClient { public static void main(String[] args) throws IOException, URISyntaxException, InterruptedException { Configuration conf = new Configuration(); // conf.set("fs.defaultFS","hdfs://192.168.88.102:9000"); // //.获取hdfs客户端对象 // FileSystem fs = FileSystem.get(conf); FileSystem fs = FileSystem.get(new URI("hdfs://192.168.88.102:9000"),conf,"hadoop"); //2.在hdfs上创建路径 fs.mkdirs(new Path("/0811/boss/lin")); //3.关闭资源 fs.close(); System.out.println("over"); } }

几百本常用电子书免费领取:https://github.com/XiangLinPro/IT_book

|

【本文地址】

今日新闻 |

推荐新闻 |

3. 配置Path环境变量,如图3-6所示。

3. 配置Path环境变量,如图3-6所示。

2.

2.  3.

3.  4.

4.

7.创建HdfsClient类

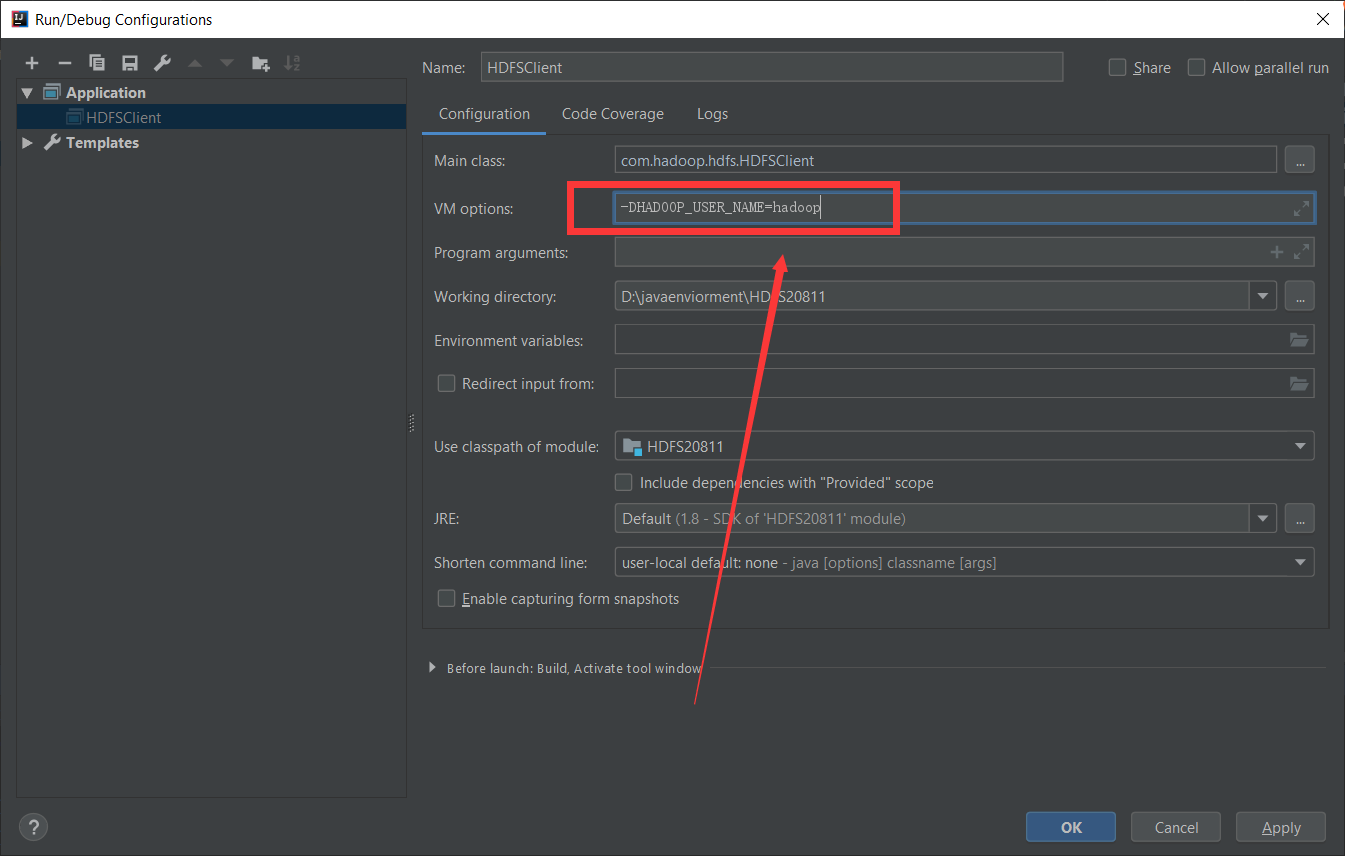

7.创建HdfsClient类 客户端去操作HDFS时,是有一个用户身份的。默认情况下,HDFS客户端API会从JVM中获取一个参数来作为自己的用户身份:-DHADOOP_USER_NAME=hadoop hadoop为用户名称。

客户端去操作HDFS时,是有一个用户身份的。默认情况下,HDFS客户端API会从JVM中获取一个参数来作为自己的用户身份:-DHADOOP_USER_NAME=hadoop hadoop为用户名称。