[医学图像分割综述] Medical Image Segmentation Using Deep Learning: A Survey |

您所在的位置:网站首页 › 三维图像英语怎么说 › [医学图像分割综述] Medical Image Segmentation Using Deep Learning: A Survey |

[医学图像分割综述] Medical Image Segmentation Using Deep Learning: A Survey

|

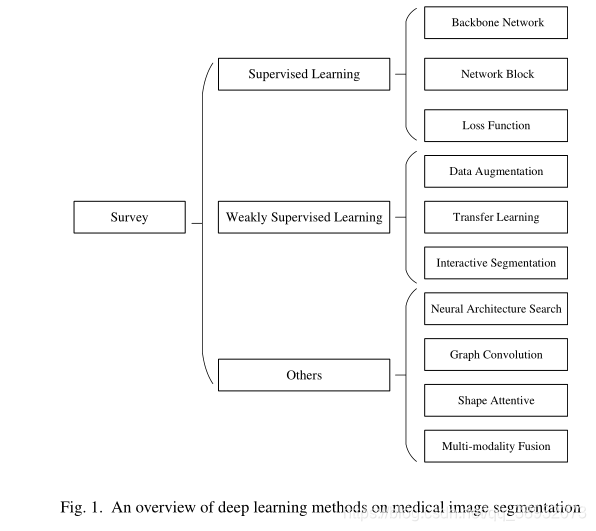

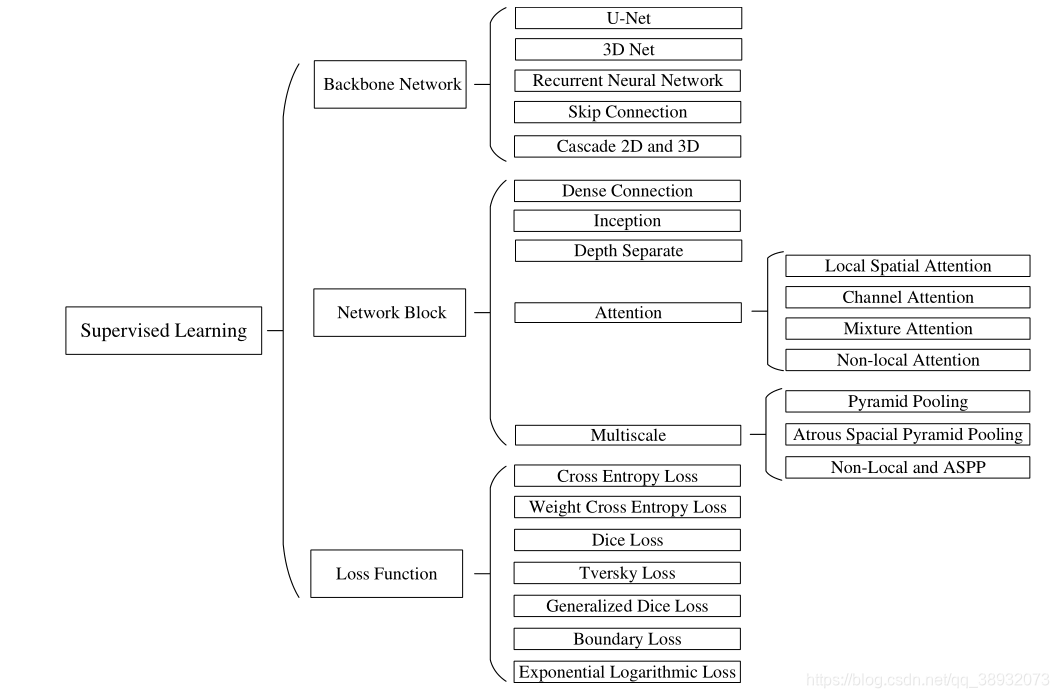

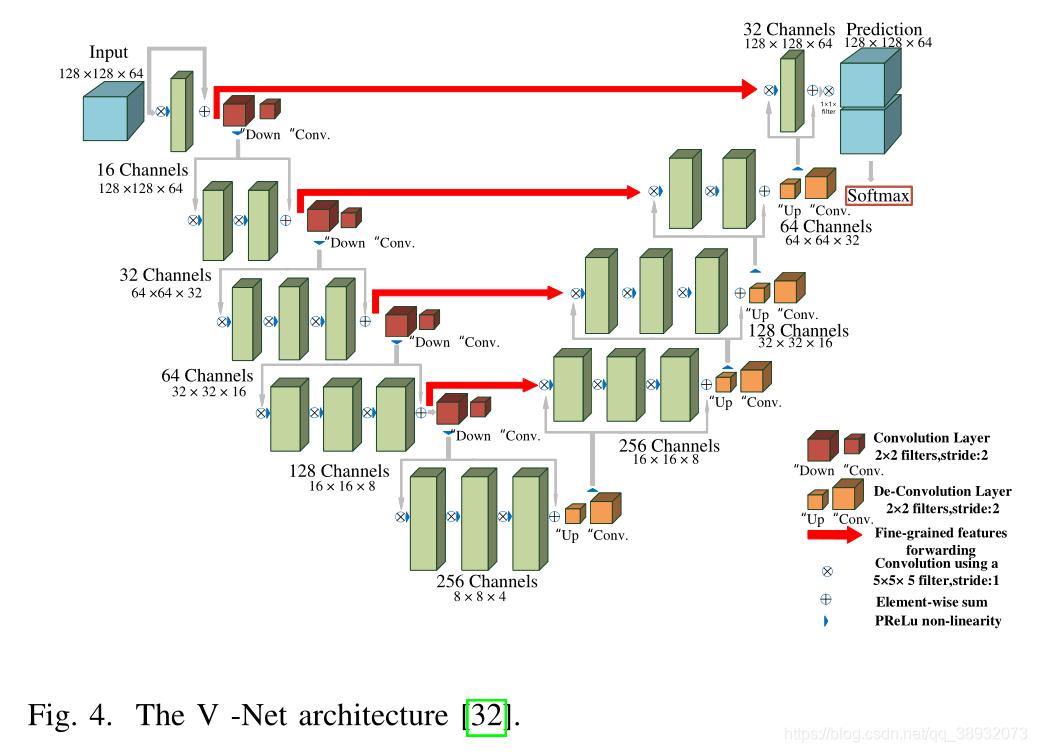

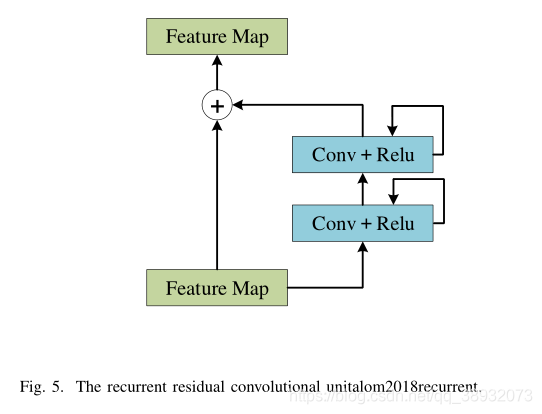

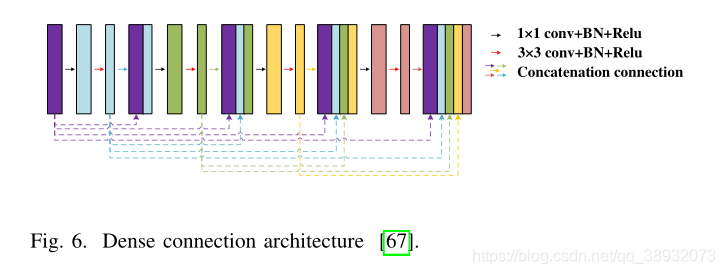

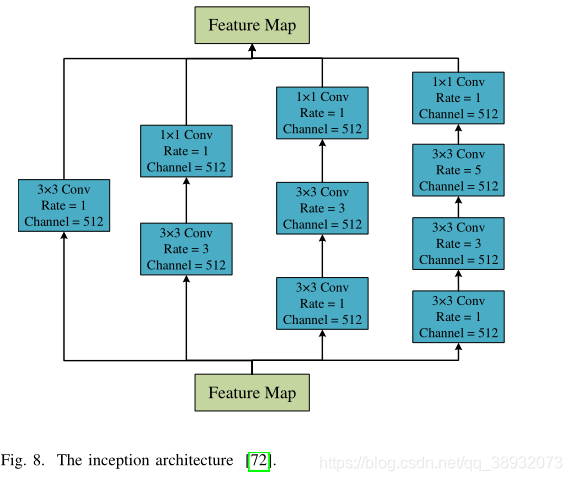

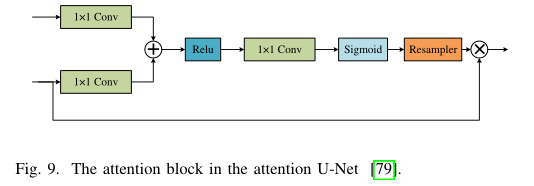

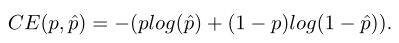

使用深度学习的医学图像分割:一项调查 论文地址 本综述有两个独创之处,首先,与传统的调查方法直接将医学图像分割的文献划分为多个组,并对每个组详细介绍文献的方法相比,我们将目前流行的文献按照从粗到细的多层次结构进行分类。其次,本文重点研究了监督学习和弱监督学习方法,但未包括无监督方法,这种方法目前在医学图像领域并不流行。对于监督学习方法,我们从骨干网络的选择、网络块的设计和损失函数的改进三个方面对文献进行了分析。对于弱监督学习方法,我们分别根据数据增强,迁移学习和交互式分割研究文献。与已有的调查相比,本次调查的文献分类与以往有很大的不同,更便于读者了解相关的理论基础,并引导读者思考基于深度学习方法的医学图像分割的适当改进。 文章目录 1. Introduction2. Supervised Learning2.1 Backbone Network2.1.1 U-Net2.1.2 3D-Net2.1.3 Recurrent Neural Network(RNN)2.1.4 Skip Connection2.1.5 Cascade of 2D and 3D2.1.6 Others 2.2 Network Function Block2.2.1 Dense Connection2.2.2 Inception2.2.3 Depth Separability2.2.4 Attention Mechanism2.2.5 Multi-scale Information Fusion 2.3 Loss Function2.3.1 Cross Entropy Loss2.3.2 Weighted Cross Entropy Loss2.3.3 Dice Loss2.3.4 Tversky Loss2.3.5 Generalized Dice Loss2.3.6 Boundary Loss2.3.7 Exponential Logarithmic Loss2.3.8 Loss Improvements2.3.9 Deep Supervision 3. Weakly Supervision Learning3.1 Data Augmentation3.1.1 Traditional Methods3.1.2 Conditional Generative Adversarial Nets (cGAN) 3.2 Transfer Learning3.2.1 Pre-trained Model3.2.2 Domain Adaptation3.2.3 Interactive Segmentation3.2.4 Others Works 4. Future Research Direction4.1 Network Architecture Search4.2 Graph Convolutional Neural Network4.3 Interpretable Shape Attentive Neural Network4.5 Multi-modality Data Fusion 5. Discussion And Outlook5.1 Medical Image Segmentation Datasets5.2 Challenges and Future Scope5.2.1 Design of Network Architecture5.2.2 Design of Loss Function5.2.3 Other Research Directions 1. Introduction医学图像分割的目的是使图像中解剖或病理结构的变化更加清晰;它在计算机辅助诊断和智能医疗中发挥着至关重要的作用,极大地提高了诊断的效率和准确性。目前流行的医学图像分割任务包括肝脏和肝脏肿瘤分割,脑和脑肿瘤分割,视盘分割,细胞分割,肺分割和肺结节等。 为了帮助临床医生做出准确的诊断,有必要对医学图像中的一些关键目标进行分割,并从分割区域中提取特征。医学图像分割的早期方法通常依赖于边缘检测、模板匹配技术、统计形状模型、活动轮廓和传统机器学习技术。这些方法在一定程度上取得了不错的效果,但由于特征表示的困难,图像分割仍然是计算机视觉领域中最具挑战性的课题之一。特别是医学图像的特征提取比普通RGB图像更难,因为前者往往存在模糊、噪声、对比度低等问题。由于深度学习技术的快速发展,医学图像分割将不再需要手工制作的特征,卷积神经网络(CNN)成功实现了图像的层次特征表示,从而成为图像处理和计算机视觉领域最热门的研究课题。由于用于特征学习的CNN对图像噪声、模糊、对比度等不敏感,对医学图像提供了很好的分割结果。 需要一提的是,一般的图像分割任务主要分为了语义分割和实例分割。但在医学图像分割中,由于每个器官或组织都有很大的不同,所以医学图像的实例分割并无太大意义,医学图像分割通常都指语义分割。 以往的医学图像分割综述文献大多按时间顺序总结了医学图像分割的发展,从而忽略了医学图像分割的深度学习技术分支。另一个问题是,这些调查只介绍了相关的技术发展,而没有关注医学图像分割的任务特征,如少镜头学习、不平衡学习等,这限制了基于任务驱动的医学图像分割的改进。 本综述的主要内容遵循下图所示部分: 这篇综述的一些关键贡献可以总结如下: 总结了深度学习用于医学图像从粗到细分割的技术分支,如图1所示,分割方法主要包括监督学习和弱监督学习两个方面。讨论了神经结构搜索(NAS)、图卷积网络(GCN)和多模态数据融合在医学图像分析中的最新应用。在监督学习方法方面,我们从骨干网的选择、网络块的设计和损失函数的改进三个方面对文献进行了分析。该分类方法可以帮助后续研究人员更深入地理解医学图像分割网络的动机和改进策略。对于弱监督学习,我们还从数据增强、迁移学习和交互式分割三个方面综述了处理少镜头数据或类不平衡数据的文献。除了全面回顾深度学习在医学图像分割中的发展和应用,我们还收集了目前常见的公共医学图像分割数据集。最后,讨论了该领域未来的研究方向和发展趋势。 2. Supervised Learning对于医学图像分割任务,监督学习是最流行的方法,因为这些任务通常要求较高的精度。在本节中,我们将重点回顾神经网络体系结构的改进。这些改进主要包括网络骨干、网络块和损失功能的设计。图2展示了基于监督学习的网络架构改进的概况。 图像语义分割的目的是对图像进行像素分类。通常采用编码器-解码器结构的全卷积网络方法。编码器通常用于提取图像特征,而解码器通常用于将提取的特征恢复到原始图像大小并输出最终分割结果,典型的有FCN,U-Net,Deeplab等。 2.1.1 U-Net与普通的图像分割不同,医学图像通常含有噪声且边界模糊。因此,仅仅依靠图像的底层特征很难对医学图像中的目标进行检测和识别。同时,由于缺乏图像细节信息,仅靠图像语义特征无法获得准确的边界。而U-Net通过跳跃连接,将低分辨率和高分辨率的特征图结合起来,有效地融合了低分辨率和高分辨率的图像特征,是医学图像分割任务的完美解决方案。目前,U-Net已经成为大多数医学图像分割任务的基准,并激发了许多有意义的改进。 在实践中,由于CT、MRI图像等大部分医学数据都是以三维数据的形式存在的,使用三维卷积核可以更好地挖掘数据的高维空间相关性。由于计算资源的限制,3D U-Net仅包含3次下采样,不能有效提取深层图像特征,导致医学图像分割精度有限。与3D-UNet相比,V-Net利用残差连接设计更深层次的网络(4次下采样),从而获得更高的性能。 在医学图像分割中,RNN被用对图像序列的时间依赖性进行建模。Alom等人提出了一种结合ResUNet和RNN的医学图像分割方法。该方法实现了递归残差卷积层的特征积累,改善了图像分割任务中的特征表示。图5显示了回归残差卷积单元。 虽然跳跃连接可以融合低分辨率和高分辨率信息,从而改善特征表示,但存在低分辨率和高分辨率特征之间语义鸿沟较大的问题,导致特征映射模糊。例如,为了改进跳跃连接,Ibtehaz等人提出了包含残差路径(ResPath)的MultiResUNet,它使编码器特征在与解码器中相应特征融合之前执行一些额外的卷积操作。 2.1.5 Cascade of 2D and 3D对于图像分割任务,级联模型通常训练两个或多个模型来提高分割精度。该方法在医学图像分割中尤其流行。级联模型大致可以分为三种类型:粗-细分割、检测分割和混合分割。 第一类是粗细分割框架,使用两个2D网络的级联进行分割,其中第一个网络进行粗分割,然后使用另一个网络模型在之前的粗分割结果的基础上实现细分割。Christ等人提出了一种用于肝脏和肝肿瘤分割的级联网络。该网络首先使用一个FCN对肝脏进行分割,然后将之前的肝脏分割结果作为第二个FCN的输入进行肝脏肿瘤分割。Yuan等人首先训练了一个简单的卷积-反卷积神经网络(CDNN)模型(19层FCN),对一个CT体积的整个图像提供快速但粗糙的肝脏分割,然后将另一个CDNN(29层FCN)应用于肝脏区域,用于细粒度肝脏分割。这种级联网络利用第一个网络产生的后验概率比普通级联网络能有效地提取更丰富的多尺度上下文信息。 然而,医学图像大多是三维体数据,而二维卷积神经网络无法学习三维的时间信息,三维卷积神经网络往往计算成本高,GPU内存消耗严重。因此,提出了一些伪三维分割方法。Vu等将相邻切片的叠加作为输入用于中心切片预测,然后将得到的2D特征图输入到标准2D网络中进行模型训练。这些伪三维方法虽然能够从三维数据中分割出目标,但由于只利用了局部时间信息而导致精度提升有限。相比于伪3D网络,2D和3D级联网络要更好 。Li等人提出了一种混合密集连接U-Net(H-DenseUNet)用于肝脏和肝脏肿瘤的分割。该方法首先利用简单的ResNet获得粗略的肝脏分割结果,利用二维DenseUNet有效提取二维图像特征,然后利用三维DenseUNet提取三维图像特征,最后设计一种混合特征融合层,对二维和三维特征进行联合优化。虽然H-DenseUNet相对于整个3D网络来说降低了模型的复杂性,但是模型仍是复杂的,而且在3D卷积中仍然存在大量的参数。Zhang等人提出一种和H-DenseUNet结构相似的轻量级混合卷积网络(LW-HCN),但它使用了3D深度可分离卷积,因此所需的参数和计算成本要更少 。 传统UNet在检测带有模糊噪声边界的较小解剖结构时通常表现不佳。为了解决这一问题 。Valanarasu等人提出了一种完整的级联网络KiU-Net来进行脑夹层分割。作者设计了一种全新的过完备结构Ki-Net,其中中间层的空间大小大于输入数据的空间大小,这是通过在编码器的每一转换层之后加上上采样层来实现的。因此,提出的Ki-Net比U-Net具有更强的边缘捕获能力,并与香草U-Net级联,提高整体分割精度。利用Ki-Net的低层精细边缘特征图和U-Net的高层形状特征图,不仅提高了分割精度,而且对小解剖标志和模糊的噪声边界实现了快速收敛。 2.1.6 Others生成对抗网络(GAN)在诸多领域有着非常不错的应用,研究者们自然而然地将这一技术应用在图像分割中。由于医学图像通常对比度较低,不同组织和病变之间的界限模糊,且带标签的数据稀缺。基于U-Net的图像分割方法利用像素损失来学习像素之间的局部和全局关系是不够的,使用生成对抗网络来改进图像分割是一种流行的方法。生成网络学习识别肿瘤区域并生成分割结果,对抗网络学习从生成网络中区分ground-truth和分割结果,从而强制生成网络获得尽可能真实的标签。在训练样本数量有限的情况下,cGAN能够很好地工作。Conze等利用级联的预先训练的卷积编码器-解码器作为cGAN的生成器用于腹部多器官分割,并将对抗网络作为判别器强制模型创建真实的器官描绘。 此外,由于成像技术的限制,医学图像不可避免地会在一定程度上被破坏从而依赖于手工修复,因此关于器官形状和位置的先验知识的结合对于改善医学图像分割效果可能是至关重要的。Oktay等提出了一种新的通用方法,将形状和标签结构的先验知识结合到解剖约束神经网络(ACNN)中,用于医学图像分析任务。通过这种方式,神经网络的训练过程可以被约束和引导,以做出更解剖和有意义的预测,特别是在输入的图像数据信息不够充分或不够一致的情况下(例如,缺少对象边界)。研究表明,由于在神经网络的训练过程中采用了先验知识约束,改进后的模型可以提供更高的分割精度,并且具有更强的鲁棒性。 2.2 Network Function Block 2.2.1 Dense Connection密集连接常被用于构造一种特殊的卷积神经网络。对于密集连接网络,每一层的输入来自前面所有层的输出。Guan等提出了一种改进的U-Net,用密集连接的形式来代替U-Net的每个子块,如图6所示。虽然密集连接有助于获得更丰富的图像特征,但往往在一定程度上降低了特征表示的鲁棒性,增加了参数的数量。 对于CNN来说,深度网络往往比浅层网络具有更好的性能,但它们也遇到了一些新的问题,如梯度消失、网络收敛困难、内存占用大等。Inception克服了这些问题。它在不增加网络深度的情况下并行地合并卷积核,从而获得更好的性能。该结构能够利用多尺度卷积核提取更丰富的图像特征,并进行特征融合,获得更好的特征表示。Gu等通过将Inception引入医学图像分割,提出了CE-Net。然而,Inception通常比较复杂,导致模型修改困难。 为了提高网络模型的泛化能力,减少对内存的使用需求,许多研究者对复杂医疗三维体积数据的轻量级网络模型进行了研究。Lei等提出了一种比V-Net更加轻量的LV-Net用于肝脏分割。通常,深度可分将标准卷积分解为逐通道卷积和逐点卷积。普通卷积的参数一般为 D K × D K × M × N D_K\times D_K \times M \times N DK×DK×M×N, M M M是输入特征的维数, N N N是输出特征的维数, D K D_K DK是卷积核大小。对于深度可分离卷积而言,其中的逐通道卷积参数为 D K × D K × 1 × M D_K\times D_K \times 1 \times M DK×DK×1×M,逐点卷积参数为 1 × 1 × M × N 1\times 1 \times M \times N 1×1×M×N,与传统卷积相比,深度可分离卷积的计算代价为 ( 1 / N + 1 / D K 2 ) \left( 1/N+1/D_{K}^{2} \right) (1/N+1/DK2),关于深度可分离卷积可参考此处博文 2.2.4 Attention Mechanism对于神经网络来说,一个注意块可以选择性地改变输入,或者根据不同的重要性给输入变量赋予不同的权重。近年来,将深度学习与视觉注意机制相结合的研究大多集中在利用掩码形成注意机制上。掩码的原理是设计一个新的层,通过训练和学习,可以从图像中识别关键特征,然后让网络只关注图像的感兴趣区域。 局部空间注意力(Local Spatial Attention): 空间注意力块的目的是计算每个像素在空间域中的特征重要性,提取图像的关键信息。正常的池化相当于信息合并,容易造成关键信息的丢失。Jaderberg等人针对这一问题,设计了空间变换块,通过空间变换来提取图像的关键信息。受此启发,Oktay等提出了attention U-Net。改进的U-Net在融合编码器和相应解码器的特征之前,利用注意力块改变编码器的输出。注意力块输出一组用于控制像素在空间位置上重要性的门信号(gating signal)。 通道注意力(Channel Attention): 通道注意块利用学习到的全局信息,选择性地强调有用的特征,抑制无用的特征,实现特征的再校准。Hu等提出了一种基于通道注意力的SE-Net,该方法采用三个步骤对通道进行注意力加权,图10显示了这个架构。 混合注意力(Mixture Attention): 空间注意力忽略了不同通道信息的差异,对每个通道都一视同仁。相反,通道注意力直接集中全局信息,而忽略每个通道的局部信息,是一种相对粗糙的操作。因此,研究人员结合两种注意机制的优点,设计了多种基于混合注意力块的模型。Wang等比较了通道注意、空间注意以及两种注意的不同组合在医学图像分割中的表现。他们的结论是,以通道为中心的注意力是提高图像分割性能最有效的方法。 非局部注意力(Non-local Attention): 大多数医学图像分割模型使用局部卷积操作,该操作集中在相邻卷积核的区域,而忽略了全局信息。最近,Wang等提出了一种非局部的U-Net来克服局部卷积在医学图像分割中的缺点。非局部U-Net在上采样和下采样过程中采用自注意机制和全局聚合块提取完整的图像信息,提高了最终分割的精度。(非局部注意力等价于自注意力(Self-Attention)) 医学图像分割的难点之一是目标尺度的大范围变化。例如,中晚期的肿瘤可能比早期的大得多。感知场的大小大致决定了我们可以使用多少上下文信息。 金字塔池化(Pyramid Pooling) 多尺度池化的并行操作可以有效地改善网络的上下文信息,从而提取更丰富的语义信息。He等提出的SPP将图像分为粗糙空间和精细空间,然后对图像进行局部特征采集,提取多尺度特征。受SPP的启发,一个多尺度信息提取块被设计并并命名为残差多核池化(RMP),它使用四个不同大小的池化核来编码全局上下文信息。然而,RMP中的上采样操作不能恢复细节信息的丢失,因为池化通常扩大了感受野,但降低了图像分辨率。 空洞空间金字塔池化(Atrous Spatial Pyramid Pooling) 为了减少池化操作造成的细节信息丢失,研究人员提出了用空洞卷积代替池化操作。与传统卷积相比,空洞卷积在不增加参数数量的情况下能有效扩大感受野。Chen等结合空洞卷积和SPP提出了空洞空间金字塔池化ASPP,该算法对不同尺度的同一物体有较强的识别能力。 然而ASPP在图像分割方面存在两个严重问题。第一个是局部信息的丢失,第二个则是这些信息在远距离传播后可能是不相关的。如何同时处理不同尺度的对象之间的关系,是设计一个好的空洞卷积网络的关键。针对以上问题,Wang等设计了一种混合扩展卷积(HDC)网络。该结构使用锯齿波启发式方法来分配膨胀率,从而可以访问更大像素范围的信息,从而抑制网格化效果。 除了网络骨干和功能模块的设计外,损失函数的选择也是提高网络性能的一个重要因素。 2.3.1 Cross Entropy Loss在图像分割任务中,交叉熵是最常用的损失函数之一。该函数将预测的分类向量与实际的分割结果向量进行像素级的比较。对于二进制分割,也就是分割掩码,假定

P

(

Y

=

1

)

=

p

P(Y=1)=p

P(Y=1)=p和

P

(

Y

=

0

)

=

1

−

p

P(Y=0)=1-p

P(Y=0)=1−p,预测结果根据Sigmoid函数给出,即

P

(

Y

^

=

1

)

=

1

/

(

1

+

e

−

x

)

=

p

^

P(\hat{Y}=1)=1/(1+e^{-x})=\hat{p}

P(Y^=1)=1/(1+e−x)=p^和

P

(

Y

^

=

0

)

=

1

−

1

/

(

1

+

e

−

x

)

=

1

−

p

^

P(\hat{Y}=0)=1-1/(1+e^{-x})=1-\hat{p}

P(Y^=0)=1−1/(1+e−x)=1−p^,

x

x

x是网络输出,最终交叉熵损失即可定义为: 交叉熵损失对图像的每个像素都进行同等处理,从而输出一个平均值,忽略了类的不平衡,例如包含大量像素的类对损失函数的影响较大而只包含少量像素的类对损失函数的影响很小。因此,交叉熵损失在小目标分割中往往表现出较低的性能。 为了解决类不平衡的问题,Long等人提出了加权交叉熵损失(WCE)来抵消类不平衡。在二值分割的情况下,将加权交叉熵损失定义为: |

【本文地址】

Gao等人结合LSTM和CNN对不同脑MRI切片之间的时间关系进行建模,以提高分割精度。Bai等结合FCN和RNN挖掘主动脉序列分割的时空信息。显然,RNN可以通过考虑上下文信息关系来捕获图像的局部和全局空间特征。

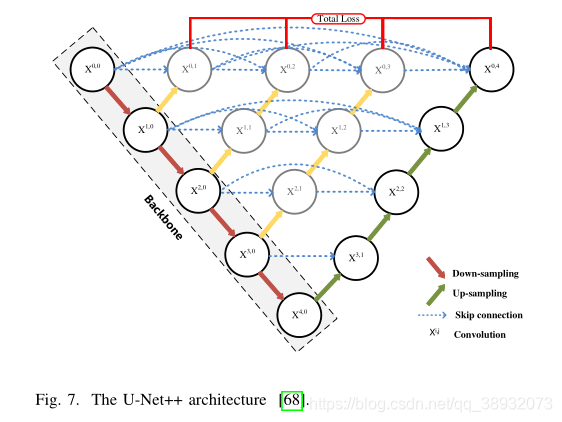

Gao等人结合LSTM和CNN对不同脑MRI切片之间的时间关系进行建模,以提高分割精度。Bai等结合FCN和RNN挖掘主动脉序列分割的时空信息。显然,RNN可以通过考虑上下文信息关系来捕获图像的局部和全局空间特征。 Zhou等将所有的U-Net层(从一层到四层)连接在一起,如图7所示。这种结构的优点是,它允许网络自动学习不同层次特征的重要性。此外,对跳跃连接进行了重新设计,使得具有不同语义尺度的特征可以在译码器中聚合,从而形成了一种高度灵活的特征融合方案。缺点仍然是由于采用了密集连接,增加了参数的数量。因此,将一种剪枝方法集成到模型优化中,以减少参数的数量。

Zhou等将所有的U-Net层(从一层到四层)连接在一起,如图7所示。这种结构的优点是,它允许网络自动学习不同层次特征的重要性。此外,对跳跃连接进行了重新设计,使得具有不同语义尺度的特征可以在译码器中聚合,从而形成了一种高度灵活的特征融合方案。缺点仍然是由于采用了密集连接,增加了参数的数量。因此,将一种剪枝方法集成到模型优化中,以减少参数的数量。

该块通过1 × 1卷积结合Relu和Sigmoid函数,生成一个权值映射,并通过与编码器的输出特征相乘进行校正。

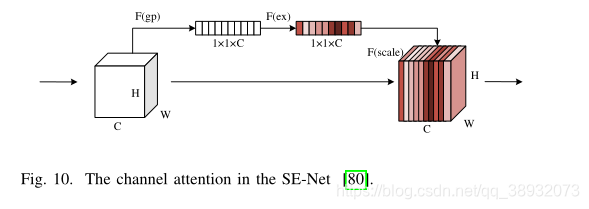

该块通过1 × 1卷积结合Relu和Sigmoid函数,生成一个权值映射,并通过与编码器的输出特征相乘进行校正。 首先是压缩操作,对输入特征进行全局平均池化,得到1 × 1 × channel的特征映射。然后是激励操作,通过通道特征的相互作用来减少通道数量,然后将减少的通道特征重构回信道数量。最后使用sigmoid函数生成[0,1]的特征权重映射,将比例乘回到原始输入特征。图中颜色的深度即代表了该通道特征在整个特征映射上的重要程度。

首先是压缩操作,对输入特征进行全局平均池化,得到1 × 1 × channel的特征映射。然后是激励操作,通过通道特征的相互作用来减少通道数量,然后将减少的通道特征重构回信道数量。最后使用sigmoid函数生成[0,1]的特征权重映射,将比例乘回到原始输入特征。图中颜色的深度即代表了该通道特征在整个特征映射上的重要程度。 可见,注意机制对于提高图像分割精度是有效的。事实上,空间注意力着重于寻找感兴趣的目标区域,而通道注意力着重于寻找感兴趣的特征。混合注意力机制既能利用空间又能利用通道。然而,与非局部注意相比,传统的注意力机制缺乏挖掘不同目标和特征之间关联的能力,因此基于非局部注意的CNN在图像分割任务中往往表现出比普通CNN更好的性能。

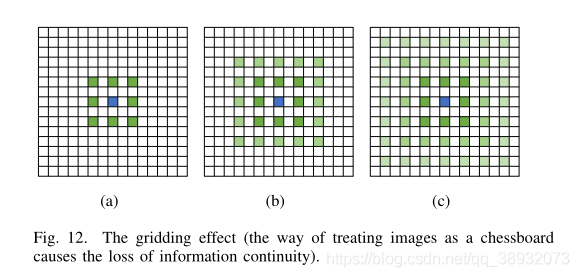

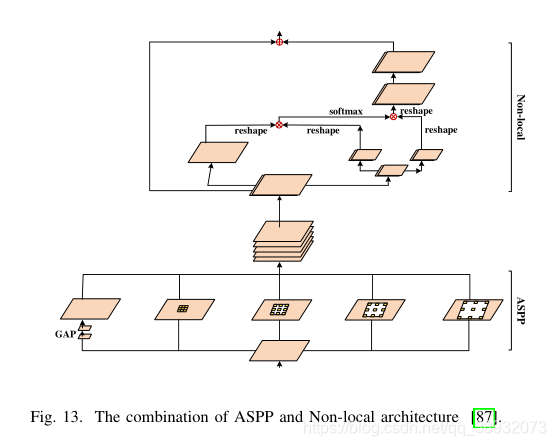

可见,注意机制对于提高图像分割精度是有效的。事实上,空间注意力着重于寻找感兴趣的目标区域,而通道注意力着重于寻找感兴趣的特征。混合注意力机制既能利用空间又能利用通道。然而,与非局部注意相比,传统的注意力机制缺乏挖掘不同目标和特征之间关联的能力,因此基于非局部注意的CNN在图像分割任务中往往表现出比普通CNN更好的性能。 非局部和ASPP(Non-local and ASPP) 空洞卷积能有效地扩大接受野以收集更丰富的语义信息,但由于网格效应导致细节信息丢失。因此,为了提高空洞卷积的性能,有必要增加约束或建立像素关联。最近,Yang等提出了一种ASPP与非局部结合块用于人体部位分割,如图13所示。ASPP使用不同尺度的多个并行空洞卷积来捕获更丰富的信息,而非局部操作捕获广泛的依赖关系。该组合具有ASPP和非局部的优点,在医学图像分割中具有良好的应用前景。

非局部和ASPP(Non-local and ASPP) 空洞卷积能有效地扩大接受野以收集更丰富的语义信息,但由于网格效应导致细节信息丢失。因此,为了提高空洞卷积的性能,有必要增加约束或建立像素关联。最近,Yang等提出了一种ASPP与非局部结合块用于人体部位分割,如图13所示。ASPP使用不同尺度的多个并行空洞卷积来捕获更丰富的信息,而非局部操作捕获广泛的依赖关系。该组合具有ASPP和非局部的优点,在医学图像分割中具有良好的应用前景。

其中

β

\beta

β用于调整正样本和负样本的比例,它是一个经验值,如果

β

>

1

\beta>1

β>1,假阴性数量减少,反之如果

β

<

1

\beta

其中

β

\beta

β用于调整正样本和负样本的比例,它是一个经验值,如果

β

>

1

\beta>1

β>1,假阴性数量减少,反之如果

β

<

1

\beta