喂饭级stable |

您所在的位置:网站首页 › sd卡多少g比较合适 › 喂饭级stable |

喂饭级stable

|

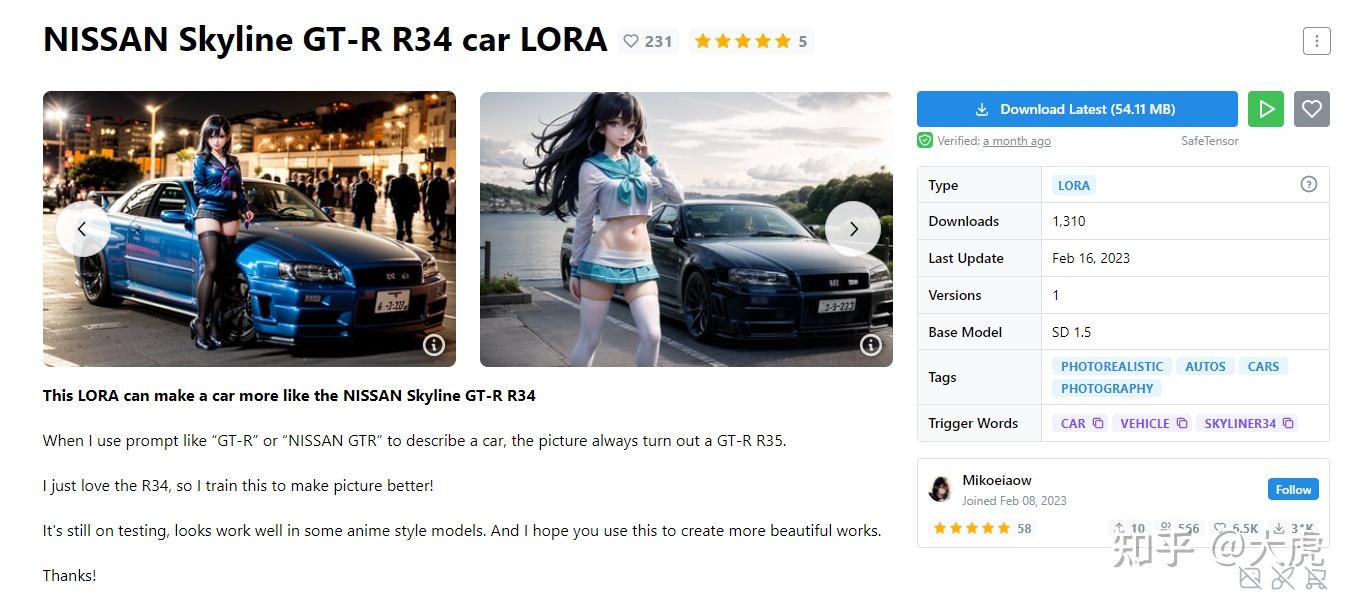

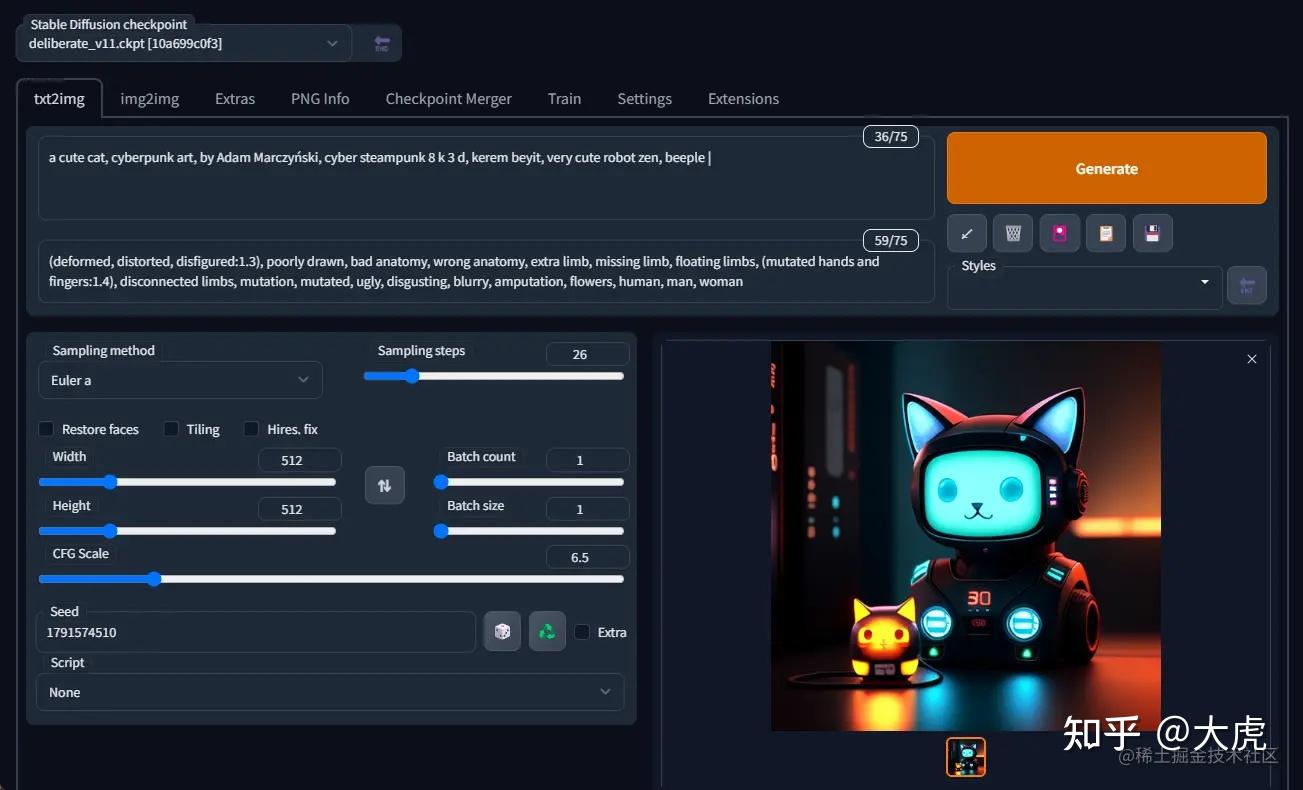

背景 Stable Diffusion是2022年发布的深度学习文本到图像生成模型。它主要用于根据文本的描述产生详细图像,官方项目其实并不适合新手直接使用,好在有一些基于 stable-diffusion 封装的 webui 开源项目,可以通过界面交互的方式来使用 stable-diffusion,极大的降低了使用门槛,以下是几个比较火的 webui 项目: github.com/AUTOMATIC11…github.com/Sygil-Dev/s…其中,AUTOMATIC1111 的 stable-diffusion-webui 是目前功能最多最好用的,强烈推荐,下面就来介绍如何使用它。还是先看看他们的能力如何  除了手部有些问题其他还都能接受 除了手部有些问题其他还都能接受 不露手部还是很赞的配置要求 不露手部还是很赞的配置要求要顺利运行stable-diffusion-webui和模型, 需要足够大的显存,最低配置4GB显存,基本配置6GB显存,推荐配置12GB显存。 当然内存也不能太小,最好大于16GB,总之内存越大越好,如下图显卡为NVIDIA GeForce GTX 1060 Ti ( 5GB / NVIDIA ),这个上古显卡跑AI绘画着实比较吃力,但也能将就用。  最低配置,比这个配置高都能跑,跑的慢也没关系,练练手嘛 1、下载项目 最低配置,比这个配置高都能跑,跑的慢也没关系,练练手嘛 1、下载项目 通过 git 的方式将整个工程源码拉下来运行: git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git注:这个开源项目目前的更新频率很快,会不定期的修复一些 bug 或加入一些新功能,所以建议可以时常 git pull 拉取最新代码。老司机请跳过1、2、3步~ 1、下载安装git2、Python 环境 stable-diffusion-webui 主要是使用 Python 开发的,所以运行这个工程,需要安装一下 Python 环境并配置好环境变量, 注意:官方推荐安装 Python 3.10.6 版本 3.10.6下载地址 使用 python --version查看当前版本。 另外,建议使用 Anaconda 管理多个 Python 环境,详见 官方的 conda 环境安装说明:github.com/AUTOMATIC11…anaconda 常用命令:blog.csdn.net/ligous/arti… 3、CUDA 环境默认 stable-diffusion-webui 运行使用的是 GPU 算力,也就是说需要用到 Nvidia 显卡(配置越高,绘图越快)A卡不行,A卡不行,A卡不行(CPU 算力跟 GPU 算力相比简直天差地别,虽然可以通过改参来实现,但有条件直接上N卡吧)。这里我们需要安装 CUDA 驱动,先确定一下电脑能安装的 CUDA 版本,桌面右下角->右键 NVIDIA 设置图标->NVIDIA 控制面板:  可以看到我的电脑的显示的是 NVIDIA CUDA 11.6.134 driver,所以我的电脑要安装的 CUDA 版本不能超过 11.6。 注意:高版本显卡是可以安装低版本的 CUDA 驱动的,比如我也可以安装经典的 10.2 版本,但是安装 11.6 版本可以获得更高的 GPU 运行效率,所以一般来说推荐安装显卡支持的最高 CUDA 版本。 在下面的网址中找到对应的 CUDA 版本进行安装: CUDA 官方归档:developer.nvidia.com/cuda-toolki… 直接选择 "精简" 安装就可以了,安装完成之后,可以使用如下命令查看 CUDA 版本,来验证 CUDA 是否安装成功: nvcc --version注:如果你没有 Nvidia 显卡,也可以通过给 stable-diffusion-webui 指定运行参数 --use-cpu sd,让其使用 CPU 算力运行,但是非常不建议你这么做,CPU 算力跟 GPU 算力相比简直天差地别,可能 GPU 只需要 10 秒就能绘制完成,而 CPU 却要 10 分钟,这不是开玩笑的。另外,如果你的显卡内存不多,建议 4G 的显卡加上 --medvram 启动参数,2G 的显卡加上 --lowvram 启动参数。怎么配置启动参数我们后面说。 2、下载权重文件sd-v1-4.ckpt这是stable diffusion运行必须的权重文件,4G左右,可以去hugging face下载后放到models/Stable-diffusion目录下 https://huggingface.co/CompVis/stable-diffusion-v-1-4-original/resolve/main/sd-v1-4.ckpt 3、下载本文需要的模型文件主要用于真人风格图像绘制(都可以下来试试,推荐lora) chilloutmix_NiPrunedFp32Fix.safetensors 可以去C站下载,3.97G,下载完成后放到models/Stable-diffusion目录下 https://civitai.com/models/6424  4、启动项目 4、启动项目在安装配置好运行环境之后,直接运行工程下的 webui-user.bat 文件即可(如果是类 Unix 系统,则运行 webui-user.sh)。 首次启动会自动下载一些 Python 依赖库(具体哪些库请看工程下的 requirements.txt) ,以及项目需要用到的配置和模型文件(比如:v1-5-pruned-emaonly.safetensors,将近 4 个 G~),初始化一次之后,下次启动就快了。 Launching Web UI with arguments: ... Running on local URL: http://127.0.0.1:7860 To create a public link, set `share=True` in `launch()`.看到这个提示就说明成功运行起来了,打开网址就可以看到程序的运行界面了:  温馨提示:该项目是英文页面,可以使用浏览器的翻译功能转成中文来使用~ 5、使用stable-diffusion-webui 的功能很多,主要有如下 2 个: 文生图(text2img):根据提示词(Prompt)的描述生成相应的图片。图生图(img2img):将一张图片根据提示词(Prompt)描述的特点生成另一张新的图片。 1、文生图(text2img)在开始使用文生图之前,有必要了解以下几个参数的含义: 参数说明Prompt提示词(正向)Negative prompt消极的提示词(反向)Width & Height要生成的图片尺寸。尺寸越大,越耗性能,耗时越久。CFG scaleAI 对描述参数(Prompt)的倾向程度。值越小生成的图片越偏离你的描述,但越符合逻辑;值越大则生成的图片越符合你的描述,但可能不符合逻辑。Sampling method采样方法。有很多种,但只是采样算法上有差别,没有好坏之分,选用适合的即可。Sampling steps采样步长。太小的话采样的随机性会很高,太大的话采样的效率会很低,拒绝概率高(可以理解为没有采样到,采样的结果被舍弃了)。Seed随机数种子。生成每张图片时的随机种子,这个种子是用来作为确定扩散初始状态的基础。不懂的话,用随机的即可。以上对参数的解析源自以下文章: zhuanlan.zhihu.com/p/574063064baijiahao.baidu.com/s?id=175886…接下来我们来生成一张赛博朋克风格的猫咪图片,配置以下参数后, 点击 "Generate" 即可: Prompt:a cute cat, cyberpunk art, by Adam Marczyński, cyber steampunk 8 k 3 d, kerem beyit, very cute robot zen, beeple | Negative prompt:(deformed, distorted, disfigured:1.3), poorly drawn, bad anatomy, wrong anatomy, extra limb, missing limb, floating limbs, (mutated hands and fingers:1.4), disconnected limbs, mutation, mutated, ugly, disgusting, blurry, amputation, flowers, human, man, woman CFG scale:6.5 Sampling method:Euler a Sampling steps:26 Seed:1791574510 注:提示词(Prompt)越多,AI 绘图结果会更加精准,另外,目前中文提示词的效果不好,还得使用英文提示词。

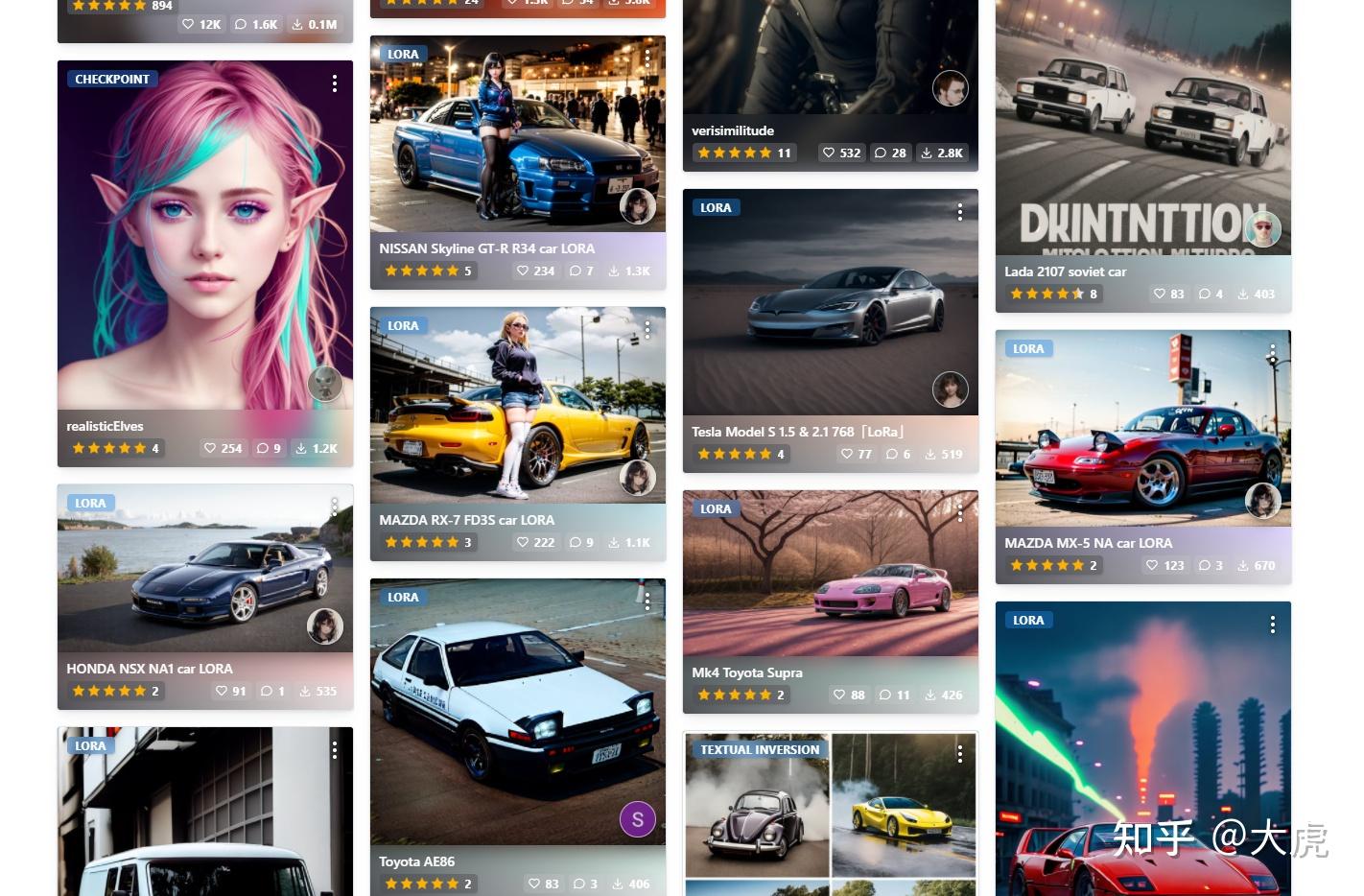

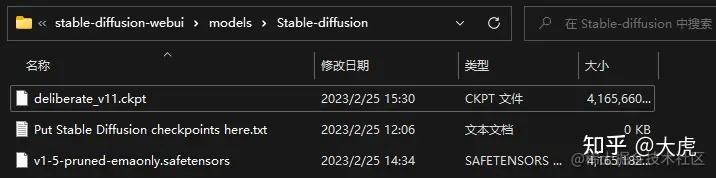

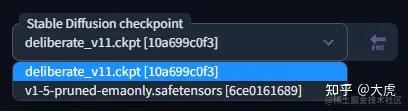

2、模型文件 上面截图里左上角 Stable Diffusion checkpoint 的值怎么跟之前截图里的不一样?这是因为我换了一个模型文件,还记得前面提到那个将近 4 个 G 大小的模型文件(v1-5-pruned-emaonly.safetensors)吗?那是 stable-diffusion-webui 的默认模型文件,用这个模型文件生成出来的图片比较丑,因此我换了另一个模型文件。模型文件下载的网站几个,比较出名的就是 civitai,这上面共享的都是别人训练好的模型。 模型文件下载地址: civitai:civitai.com/默认的 v1-5-pruned-emaonly:huggingface.co/runwayml/st… 模型库 模型库根据你要生成的图片风格(比如:动漫、风景),挑选合适的模型查看,前面那个文生图的例子,使用的就是这个 Deliberate 模型,直接点击 "Download Latest" 即可下载该模型文件。  注:模型文件有 2 种格式,分别是 .ckpt(Model PickleTensor) 和 .safetensors(Model SafeTensor),据说 .safetensors 更安全,这两种格式 stable-diffusion-webui 都支持,随意下载一种即可。 将下载好的模型文件放到 stable-diffusion-webui\models\Stable-diffusion 目录下:  放置好模型文件之后,需要重启一下 stable-diffusion-webui(执行 webui-user.bat)才能识别到。  这些模型文件一般会附带一组效果图,点击任意一张,就可以看到生成该效果图的一些参数配置:  把这些参数配置到 stable-diffusion-webui 中,点击 "Generate" 就可以生成类似效果的图片了。 注:因为 AI 绘图带有随机性质,所以生成出来的图片跟效果图不一定完全一样。 文生图功能有很多东西可以发掘,你可以用它来生成世界上独一无二的图片,而要用好文生图功能,提示词(Prompt)是必须掌握的重中之重,它是有语法规则的,在此推荐两篇对 Prompt 详细说明的文章: 全网 Stable Diffusion Prompt 运用技巧:www.bilibili.com/read/cv1990…Prompt 工具網站:www.accucrazy.com/prompt-tool…更深入的图生图攻略我们下期再讲 happy hacking~~~ |

【本文地址】