【精选】所有人都在谈的Embedding到底是什么? |

您所在的位置:网站首页 › moved的中文意思是什么 › 【精选】所有人都在谈的Embedding到底是什么? |

【精选】所有人都在谈的Embedding到底是什么?

|

文章目录

什么是 Embedding?Embedding 技术对深度学习推荐系统的重要性

说起 Embedding,我想你肯定不会陌生,至少经常听说。事实上,Embedding 技术不仅名气大,而且用 Embedding 方法进行相似物品推荐,几乎成了业界最流行的做法,无论是国外的 Facebook、Airbnb,还是在国 内的阿里、美团,我们都可以看到 Embedding 的成功应用。因此,自从深度学习流行起来之后,Embedding 就 成为了深度学习推荐系统方向最火热的话题之一。

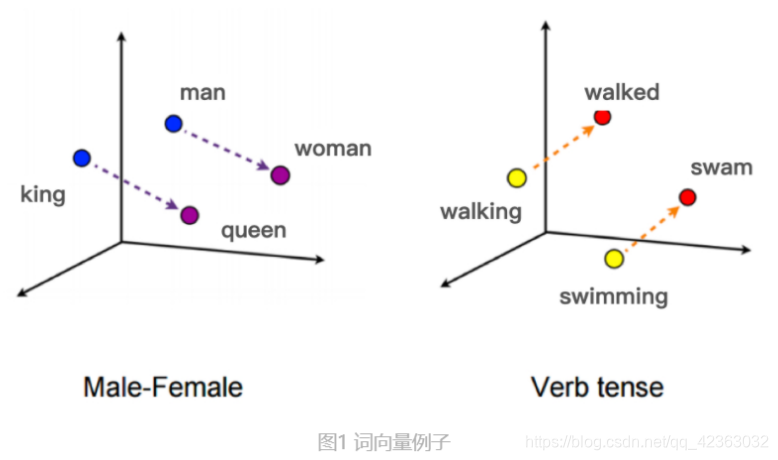

但是 Embedding 这个词又不是很好理解,你甚至很难给它找出一个准确的中文翻译,如果硬是翻译成“嵌入”“向量 映射”,感觉也不知所谓。所以索性我们就还是用 Embedding 这个叫法吧。 那这项技术到底是什么,为什么它在推荐系统领域这么重要?最经典的 Embedding 方法 Word2vec 的原理细节到 底啥样?这节课,我们就一起来聊聊这几个问题。 什么是 Embedding?简单来说,Embedding 就是用一个数值向量“表示”一个对象(Object)的方法,我这里说的对象可以是一个词、 一个物品,也可以是一部电影等等。但是“表示”这个词是什么意思呢?用一个向量表示一个物品,这句话感觉还是 有点让人费解。 这里,我先尝试着解释一下:一个物品能被向量表示,是因为这个向量跟其他物品向量之间的距离反映了这些物品 的相似性。更进一步来说,两个向量间的距离向量甚至能够反映它们之间的关系。这个解释听上去可能还是有点抽 象,那我们再用两个具体的例子解释一下。 图 1 是 Google 著名的论文 Word2vec 中的例子,它利用 Word2vec 这个模型把单词映射到了高维空间中,每个单 词在这个高维空间中的位置都非常有意思,你看图 1 左边的例子,从 king 到 queen 的向量和从 man 到 woman 的向量,无论从方向还是尺度来说它们都异常接近。这说明什么?这说明词 Embedding 向量间的运算居然能够揭 示词之间的性别关系!比如 woman 这个词的词向量可以用下面的运算得出: Embedding(woman)=Embedding(man)+[Embedding(queen)-Embedding(king)] 同样,图 1 右的例子也很典型,从 walking 到 walked 和从 swimming 到 swam 的向量基本一致,这说明词向量 揭示了词之间的时态关系!这就是 Embedding 技术的神奇之处。

事实上,我一直把 Embedding 技术称作深度学习的“基础核心操作”。在推荐系统领域进入深度学习时代之后, Embedding 技术更是“如鱼得水”。那为什么 Embedding 技术对于推荐系统如此重要,Embedding 技术又在特征 工程中发挥了怎样的作用呢?针对这两个问题,我主要有两点想和你深入聊聊 首先,Embedding 是处理稀疏特征的利器。 上节课我们学习了 One-hot 编码,因为推荐场景中的类别、ID 型特 征非常多,大量使用 One-hot 编码会导致样本特征向量极度稀疏,而深度学习的结构特点又不利于稀疏特征向量 的处理,因此几乎所有深度学习推荐模型都会由 Embedding 层负责将稀疏高维特征向量转换成稠密低维特征向 量。所以说各类 Embedding 技术是构建深度学习推荐模型的基础性操作 其次,Embedding 可以融合大量有价值信息,本身就是极其重要的特征向量 。 相比由原始信息直接处理得来的特 征向量,Embedding 的表达能力更强,特别是 Graph Embedding 技术被提出后,Embedding 几乎可以引入任何 信息进行编码,使其本身就包含大量有价值的信息,所以通过预训练得到的 Embedding 向量本身就是极其重要的 特征向量。 因此我们才说,Embedding 技术在深度学习推荐系统中占有极其重要的位置,熟悉并掌握各类流行的 Embedding 方法是构建一个成功的深度学习推荐系统的有力武器。这两个特点也是我们为什么把 Embedding 的相关内容放到 特征工程篇的原因,因为它不仅是一种处理稀疏特征的方法,也是融合大量基本特征,生成高阶特征向量的有效手 段。 |

【本文地址】

今日新闻 |

推荐新闻 |

你可能会觉得词向量技术离推荐系统领域还是有一点远,那 Netflix 应用的电影 Embedding 向量方法,就是一个 非常直接的推荐系统应用。从 Netflix 利用矩阵分解方法生成的电影和用户的 Embedding 向量示意图中,我们可 以看出不同的电影和用户分布在一个二维的空间内,由于 Embedding 向量保存了它们之间的相似性关系,因此有 了这个 Embedding 空间之后,我们再进行电影推荐就非常容易了。具体来说就是,我们直接找出某个用户向量周 围的电影向量,然后把这些电影推荐给这个用户就可以了。这就是 Embedding 技术在推荐系统中最直接的应用。

你可能会觉得词向量技术离推荐系统领域还是有一点远,那 Netflix 应用的电影 Embedding 向量方法,就是一个 非常直接的推荐系统应用。从 Netflix 利用矩阵分解方法生成的电影和用户的 Embedding 向量示意图中,我们可 以看出不同的电影和用户分布在一个二维的空间内,由于 Embedding 向量保存了它们之间的相似性关系,因此有 了这个 Embedding 空间之后,我们再进行电影推荐就非常容易了。具体来说就是,我们直接找出某个用户向量周 围的电影向量,然后把这些电影推荐给这个用户就可以了。这就是 Embedding 技术在推荐系统中最直接的应用。