IDEA下使用maven配置Spark开发环境 |

您所在的位置:网站首页 › idea的maven项目如何添加依赖 › IDEA下使用maven配置Spark开发环境 |

IDEA下使用maven配置Spark开发环境

|

IDEA下使用maven配置Spark开发环境

1、安装Java2、配置环境变量3、配置Hadoop环境4、安装Scala插件5、配置maven4、Spark编程Spark测试

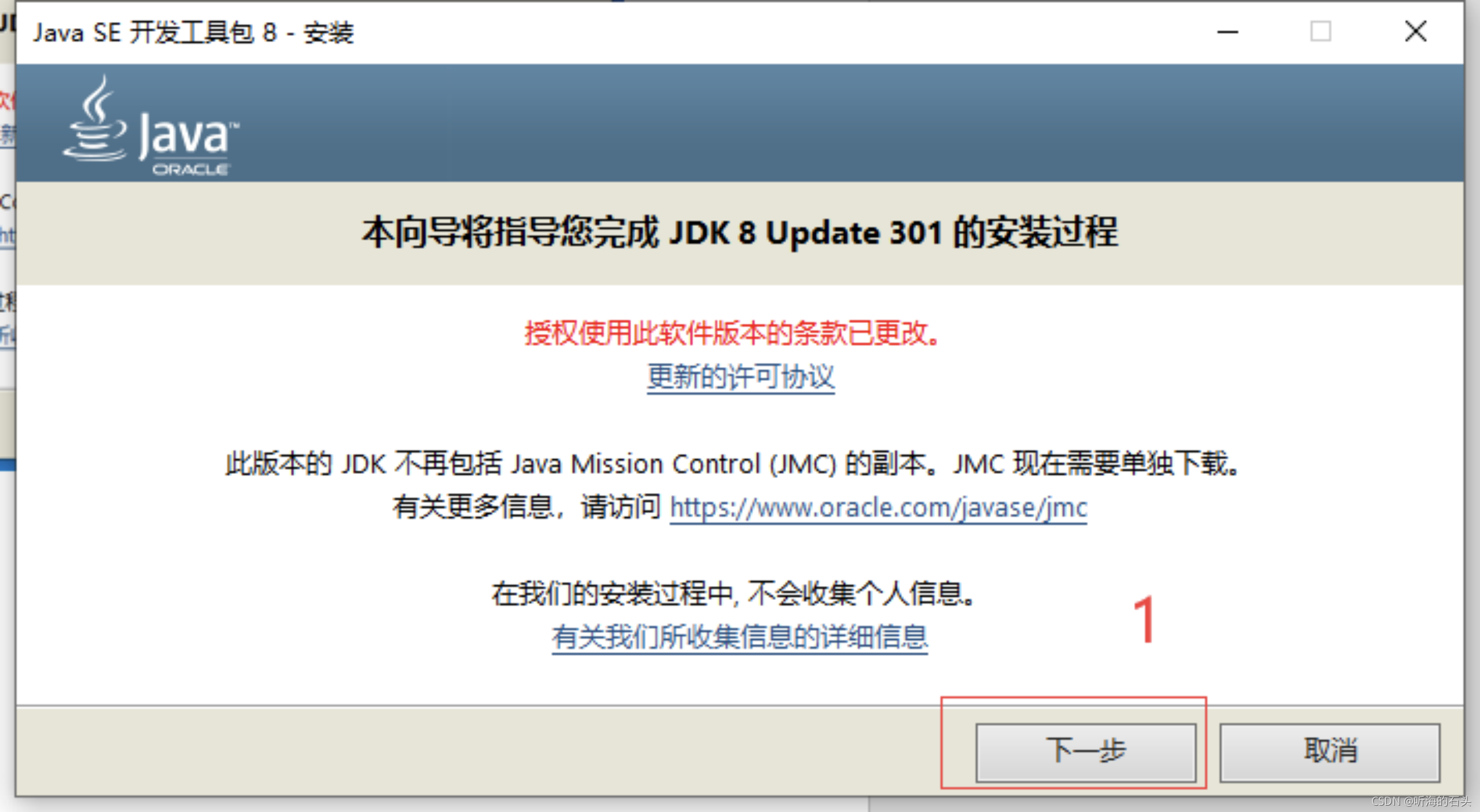

使用到的软件安装包: https://pan.baidu.com/s/1fOKsPYBmOUhHupT50_6yqQ 提取码: d473 1、安装Java

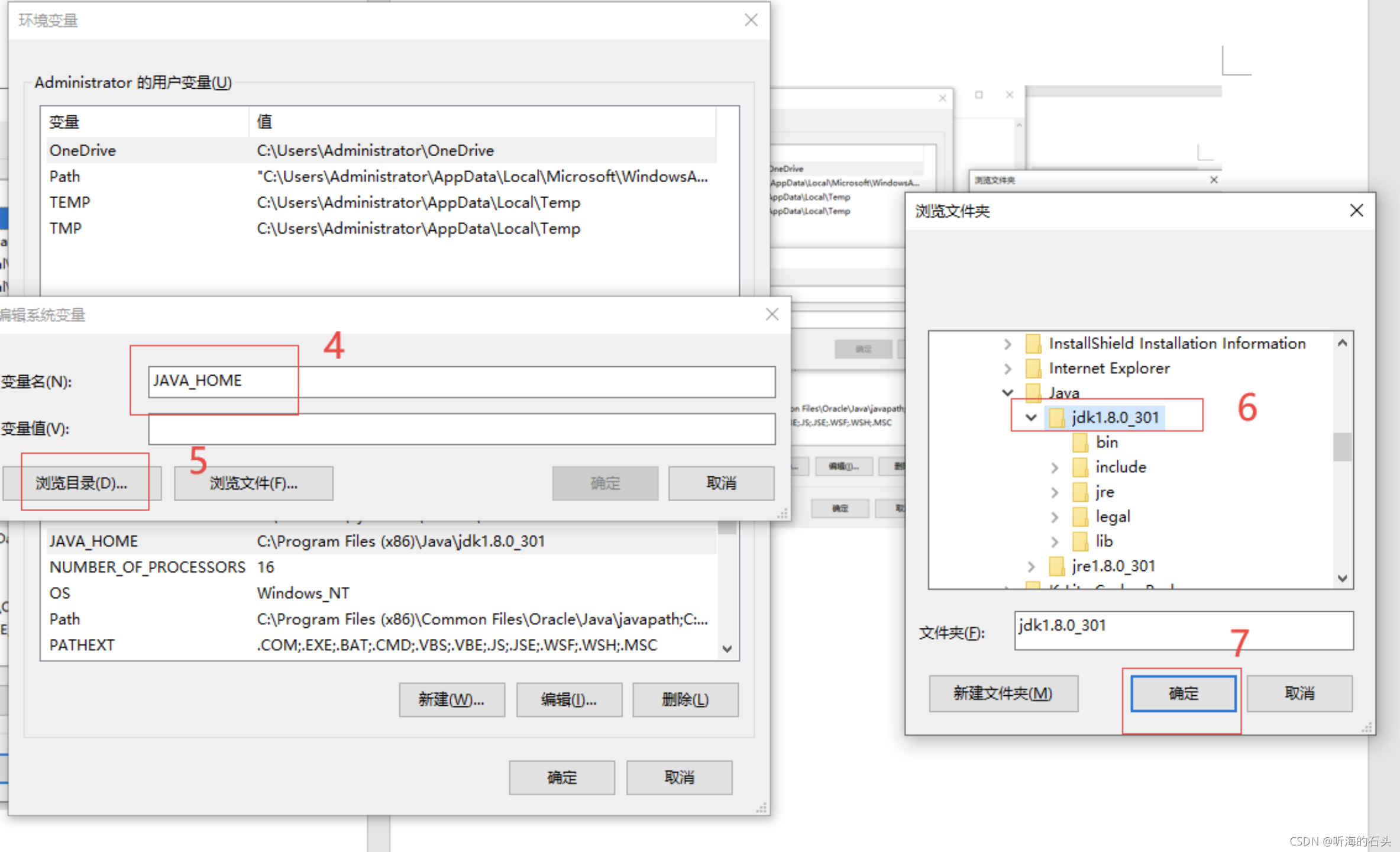

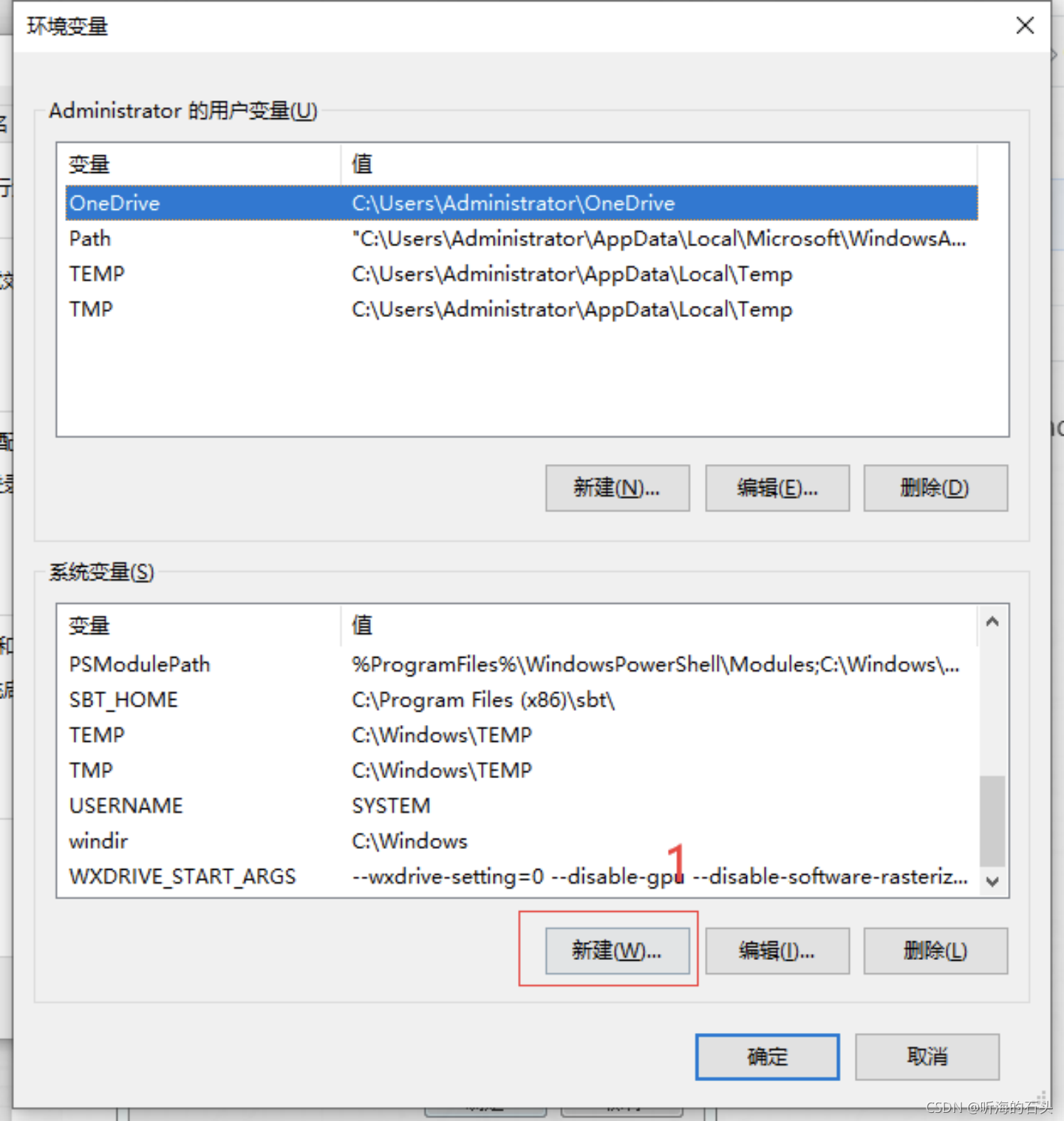

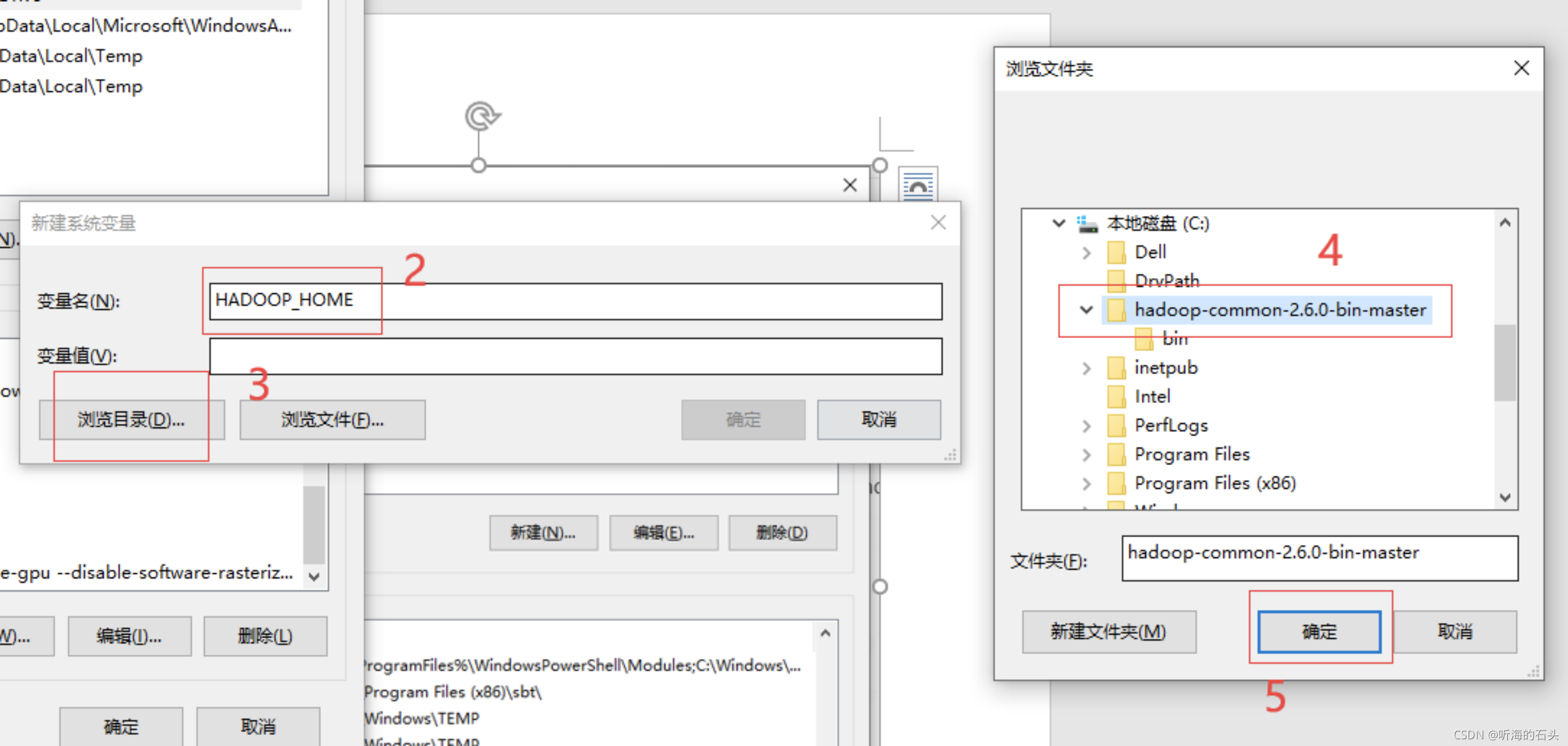

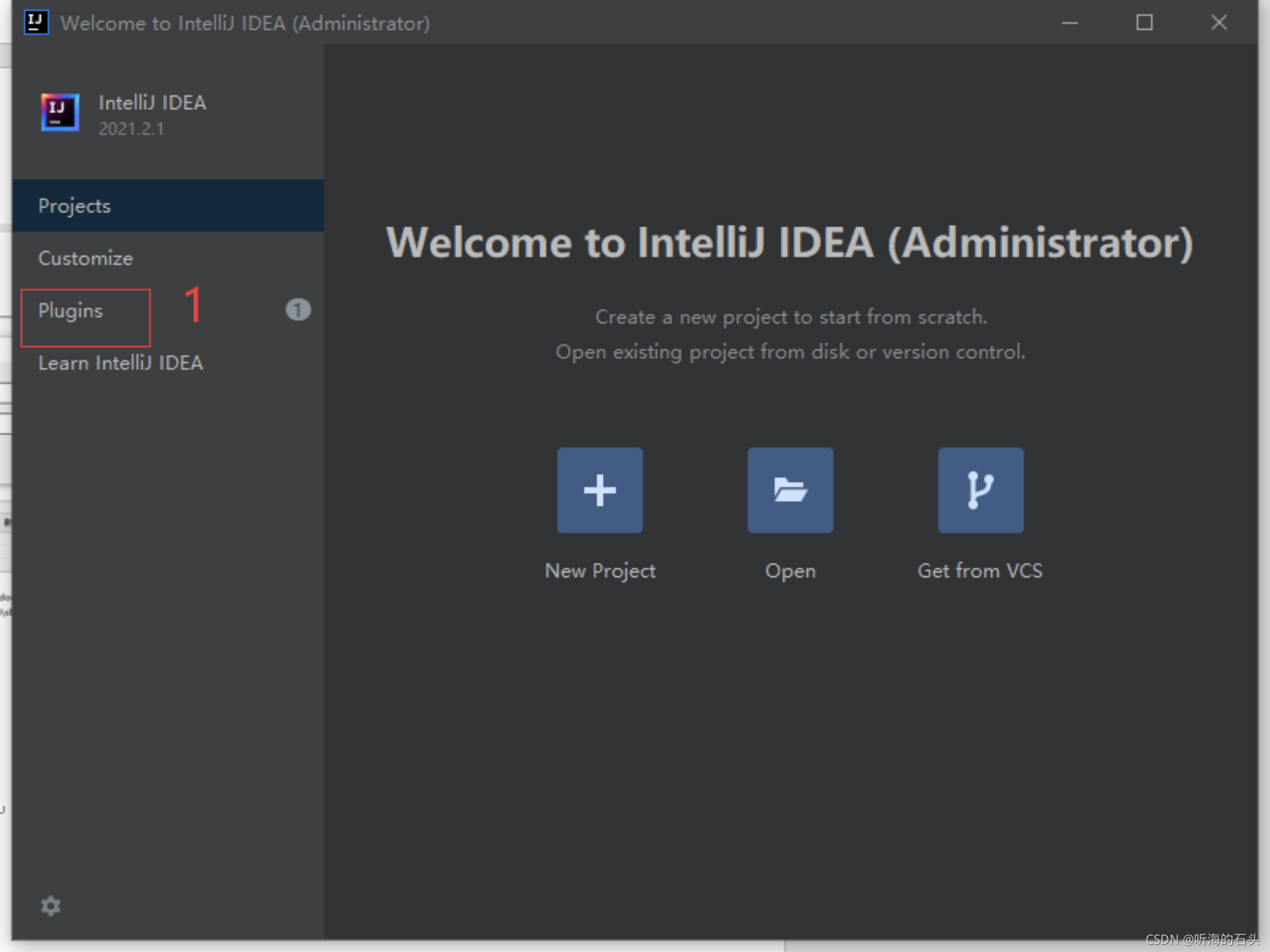

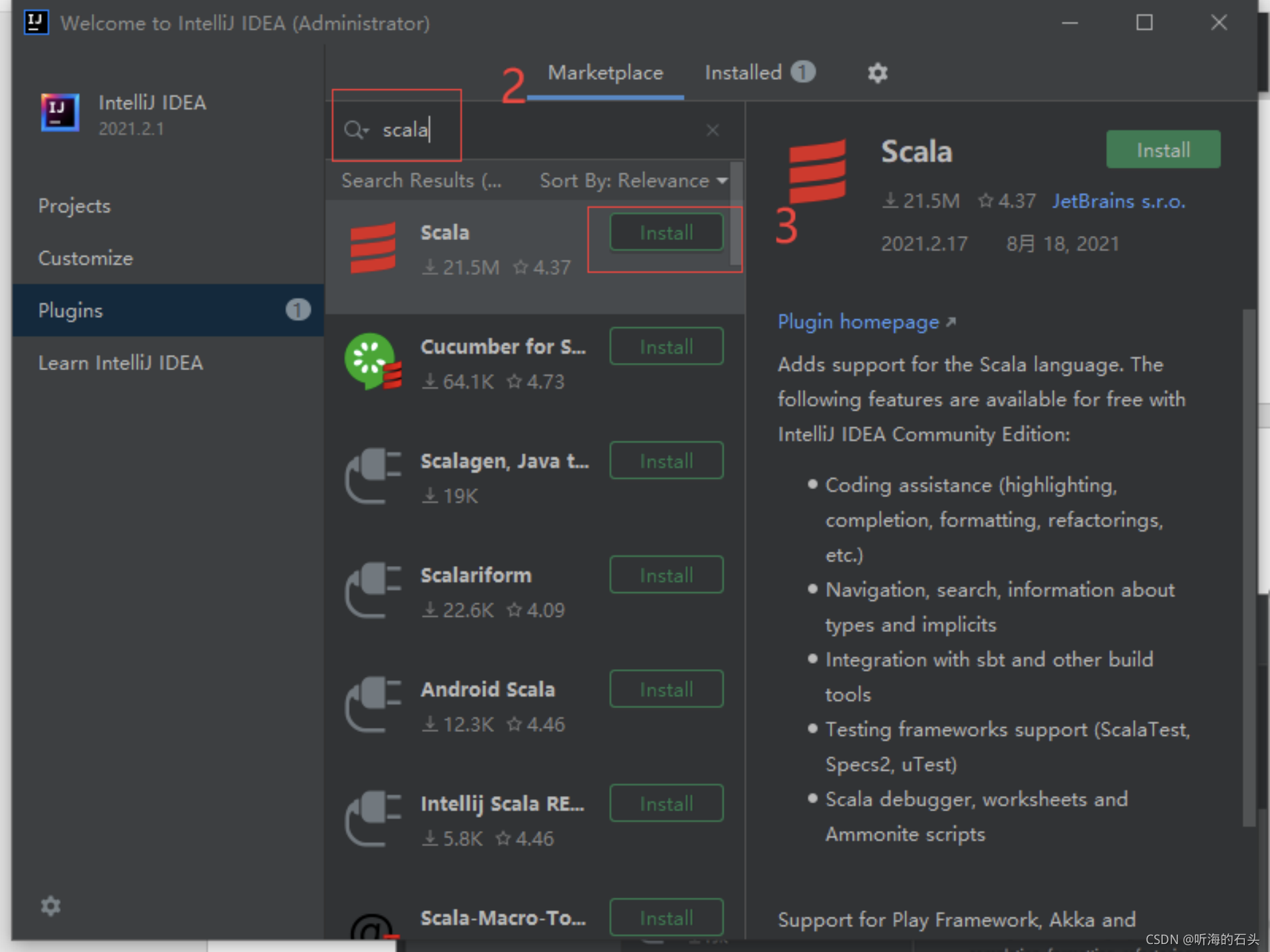

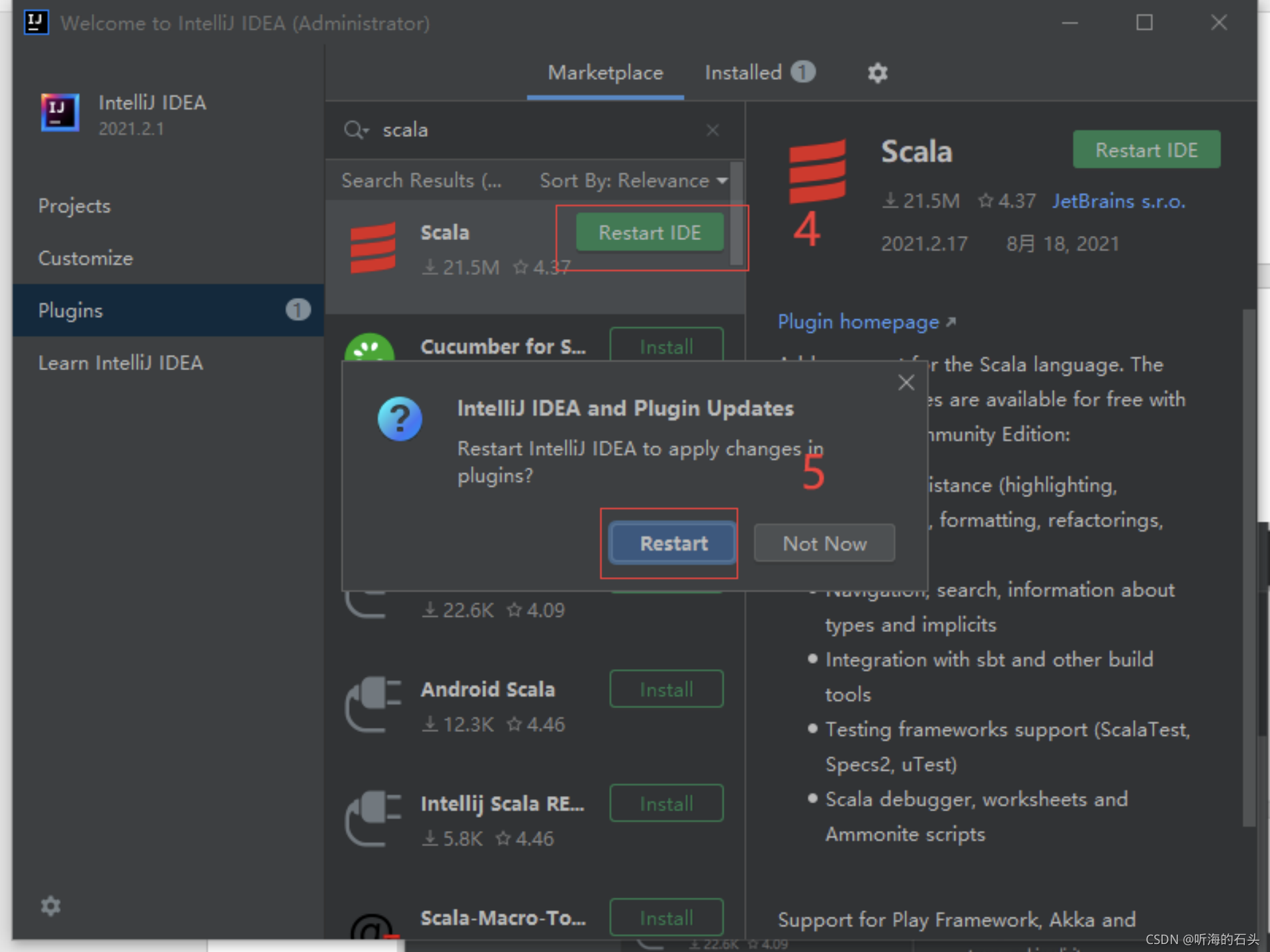

环境变量设置:右键->我的电脑,选择属性 点击高级系统设置 点击新建: 1、将hadoop-common-2.6.0-bin-master 拷贝到C盘目录下 2、将C:\ hadoop-common-2.6.0-bin-master\bin下的hadoop.dll文件和winutils.exe文件拷贝到C:\Windows\System32下,若有重复,不需要复制替换。 3、配置环境变量: 选择Plugis 输入scala,点击install

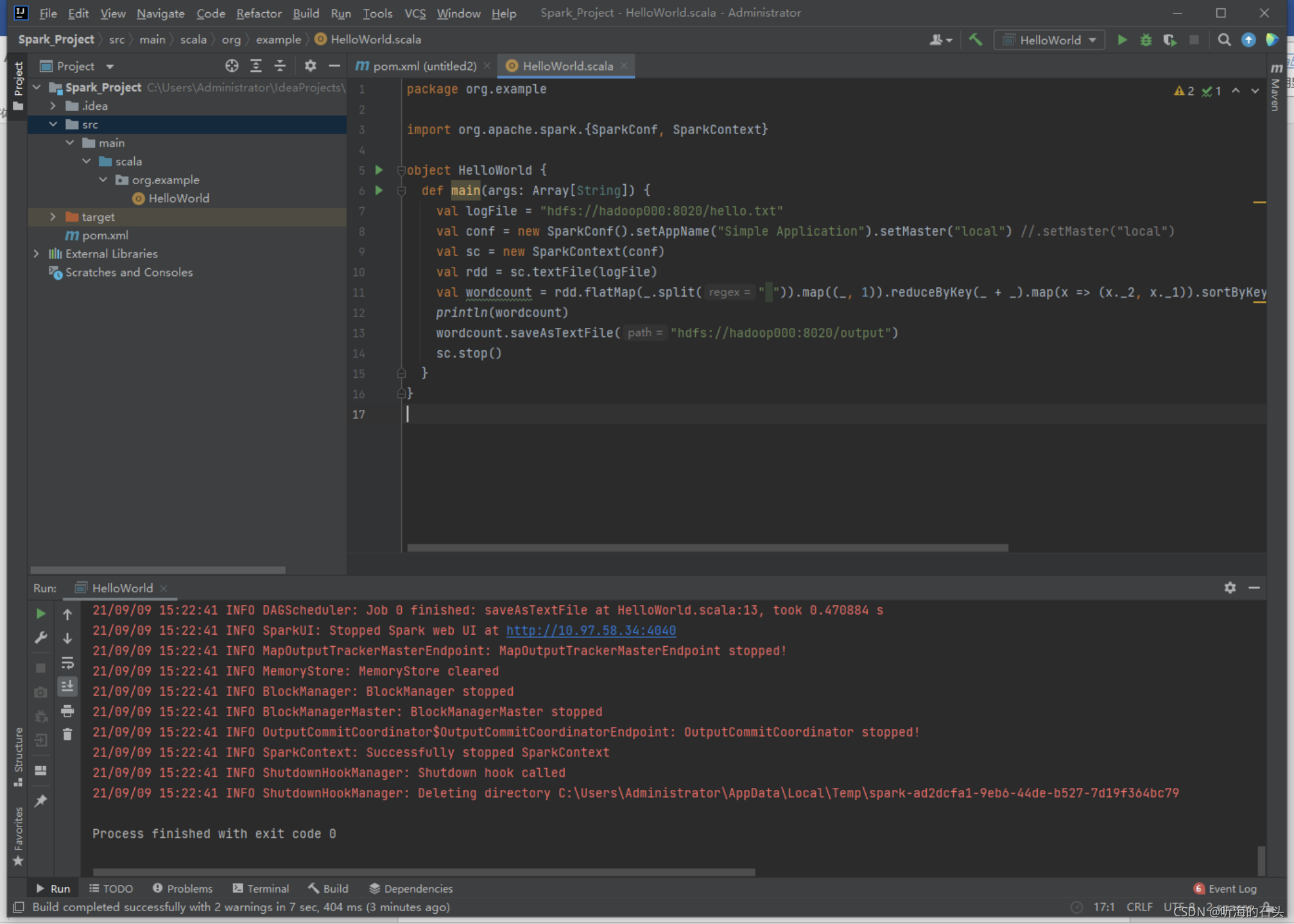

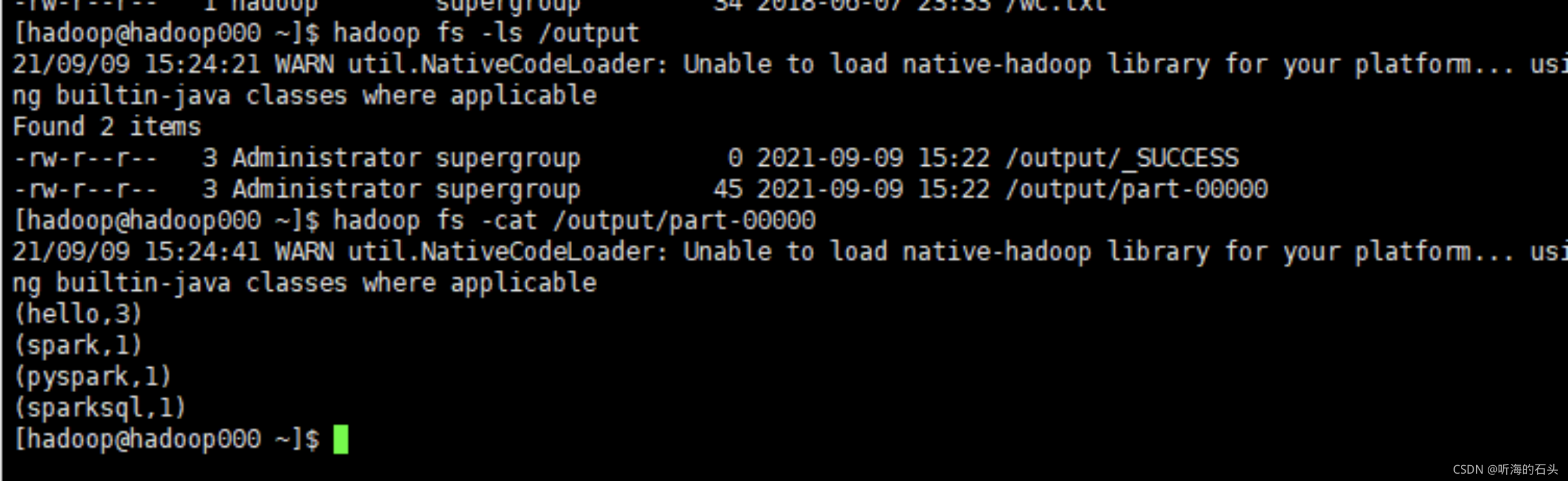

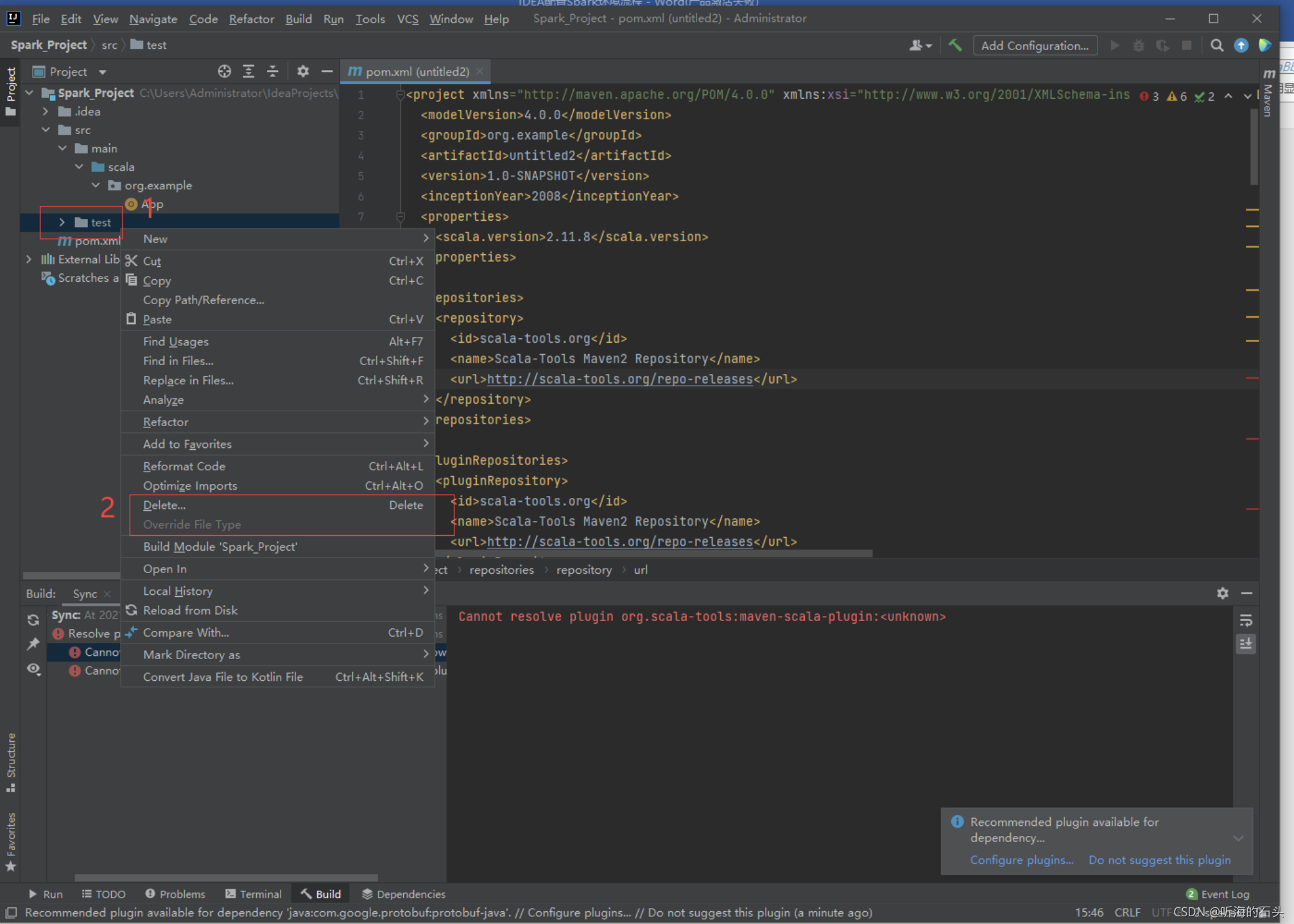

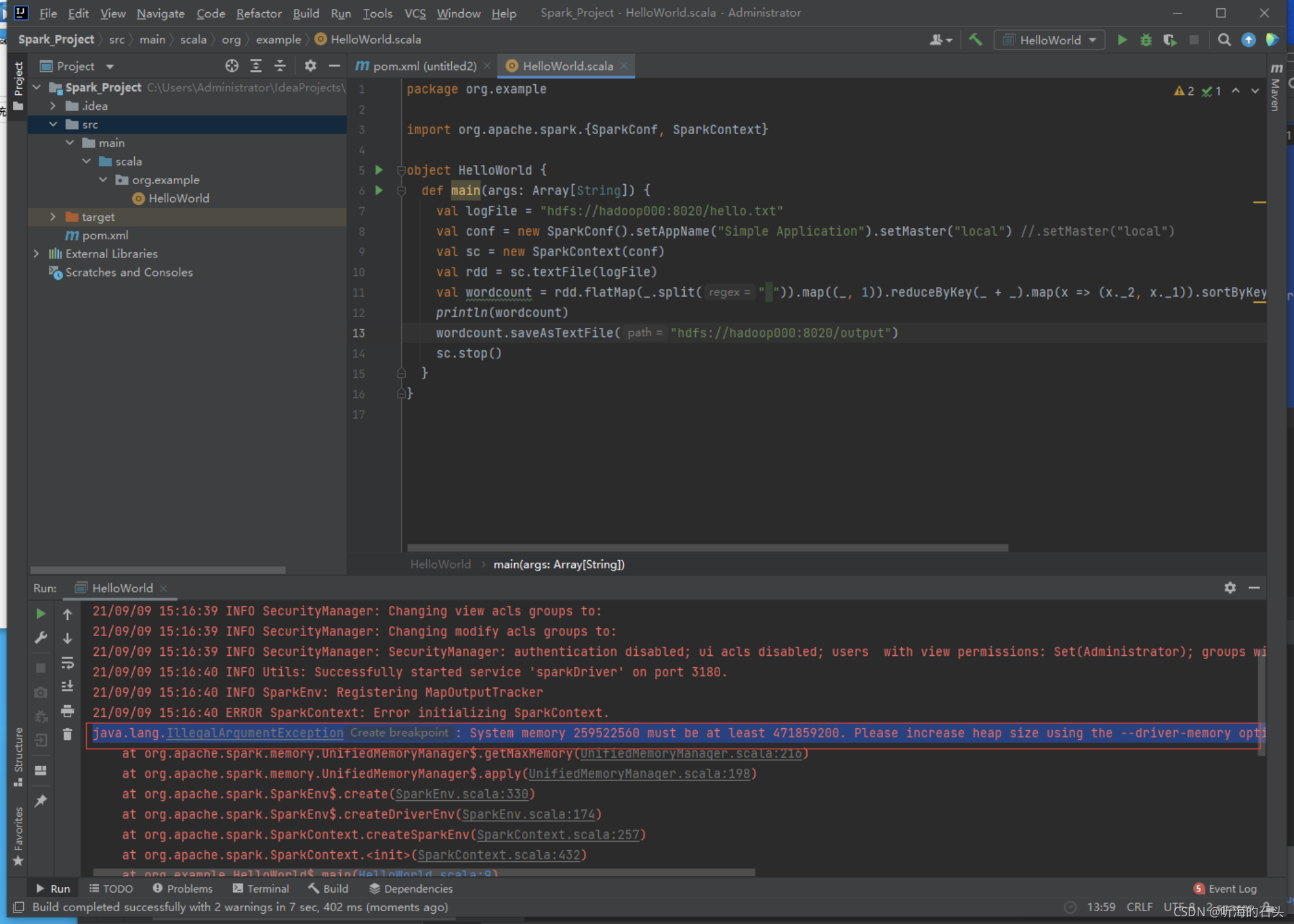

1、删除test文件夹 Spark测试代码: ackage org.example import org.apache.spark.{SparkConf, SparkContext} object HelloWorld { def main(args: Array[String]) { val logFile = "hdfs://hadoop000:8020/hello.txt" val conf = new SparkConf().setAppName("Simple Application").setMaster("local") //.setMaster("local") val sc = new SparkContext(conf) val rdd = sc.textFile(logFile) val wordcount = rdd.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _).map(x => (x._2, x._1)).sortByKey(false).map(x => (x._2, x._1)) println(wordcount) wordcount.saveAsTextFile("hdfs://hadoop000:8020/output") sc.stop() } }

|

【本文地址】

今日新闻 |

推荐新闻 |

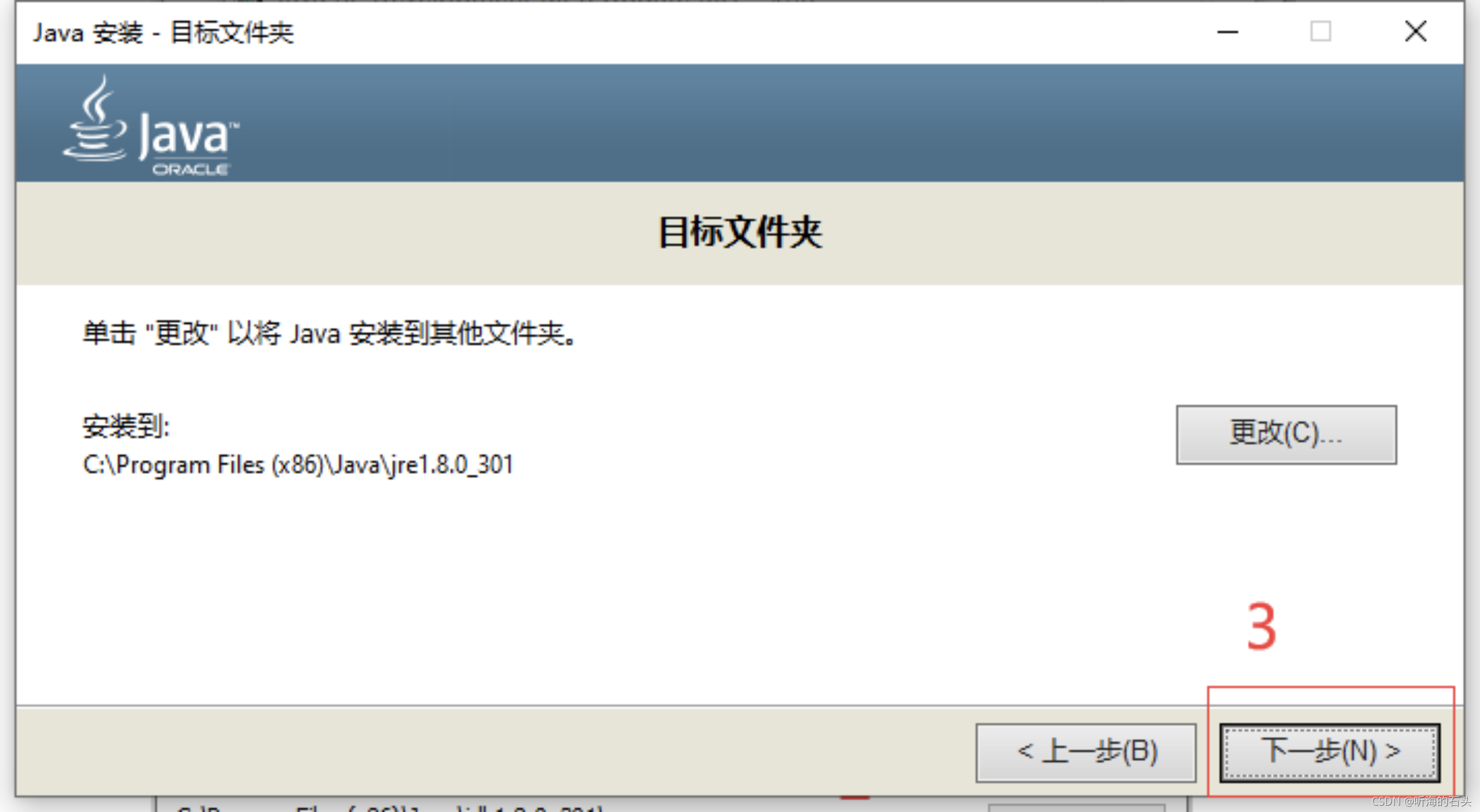

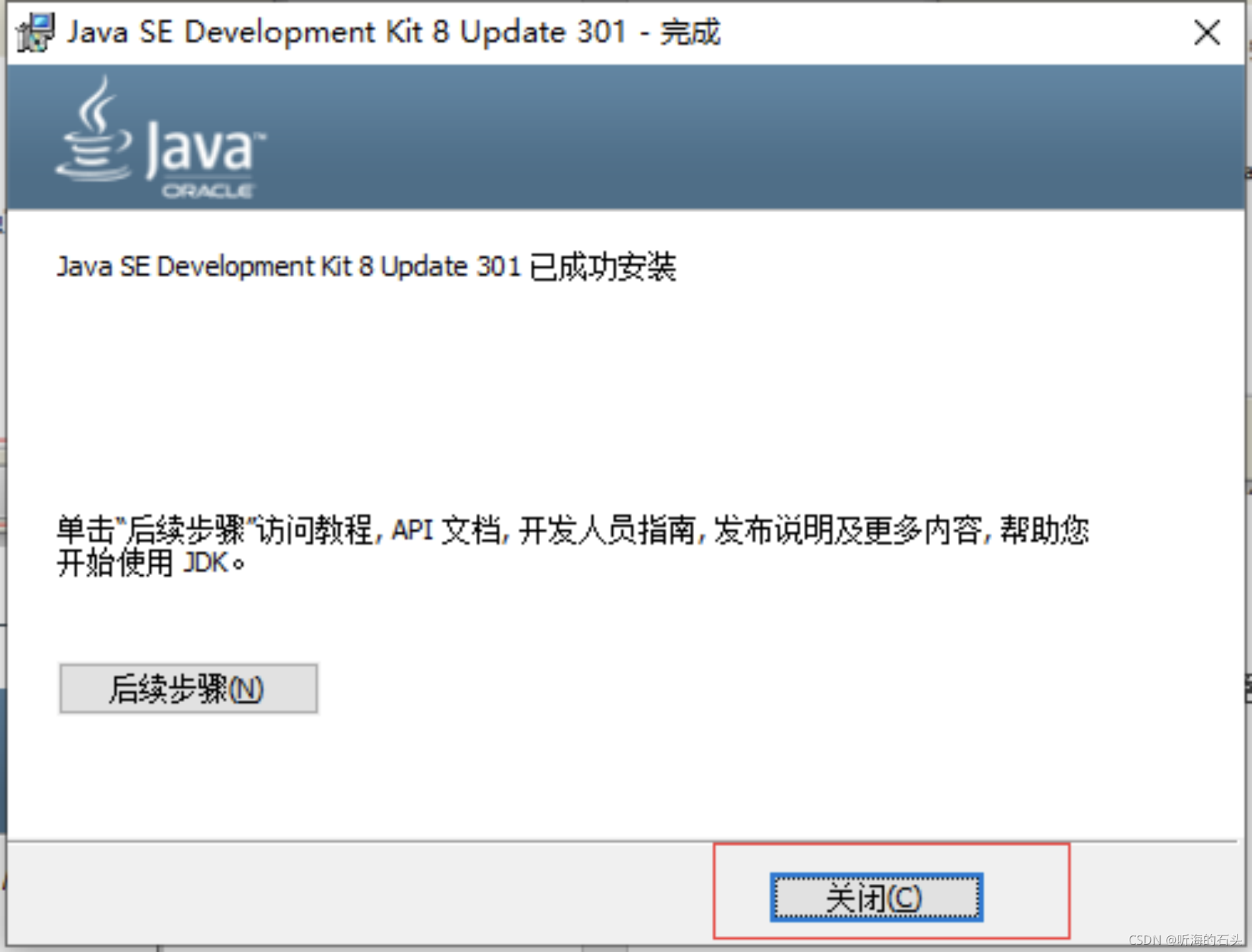

点击下一步,

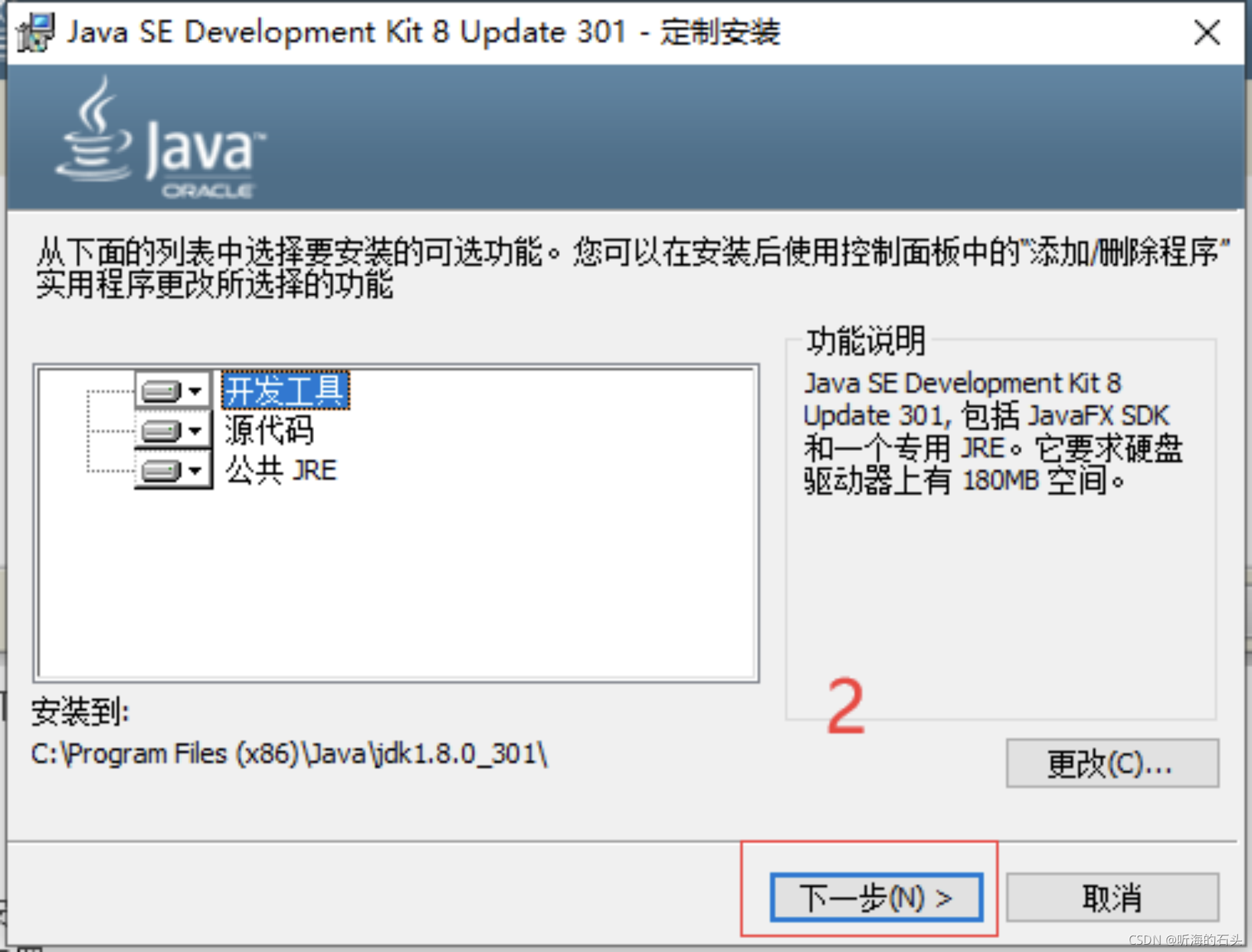

点击下一步,  点击下一步:

点击下一步:

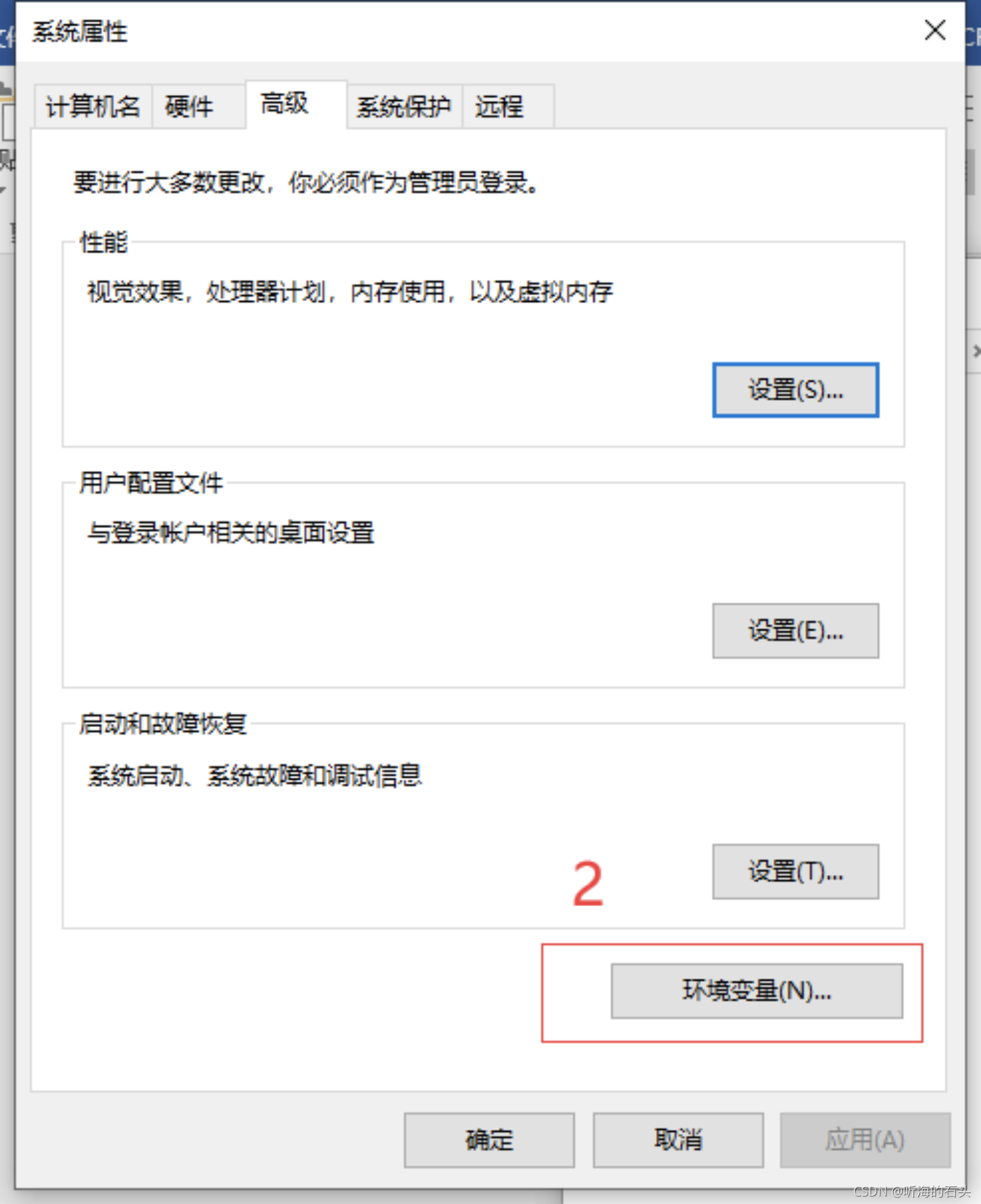

点击环境变量:

点击环境变量:

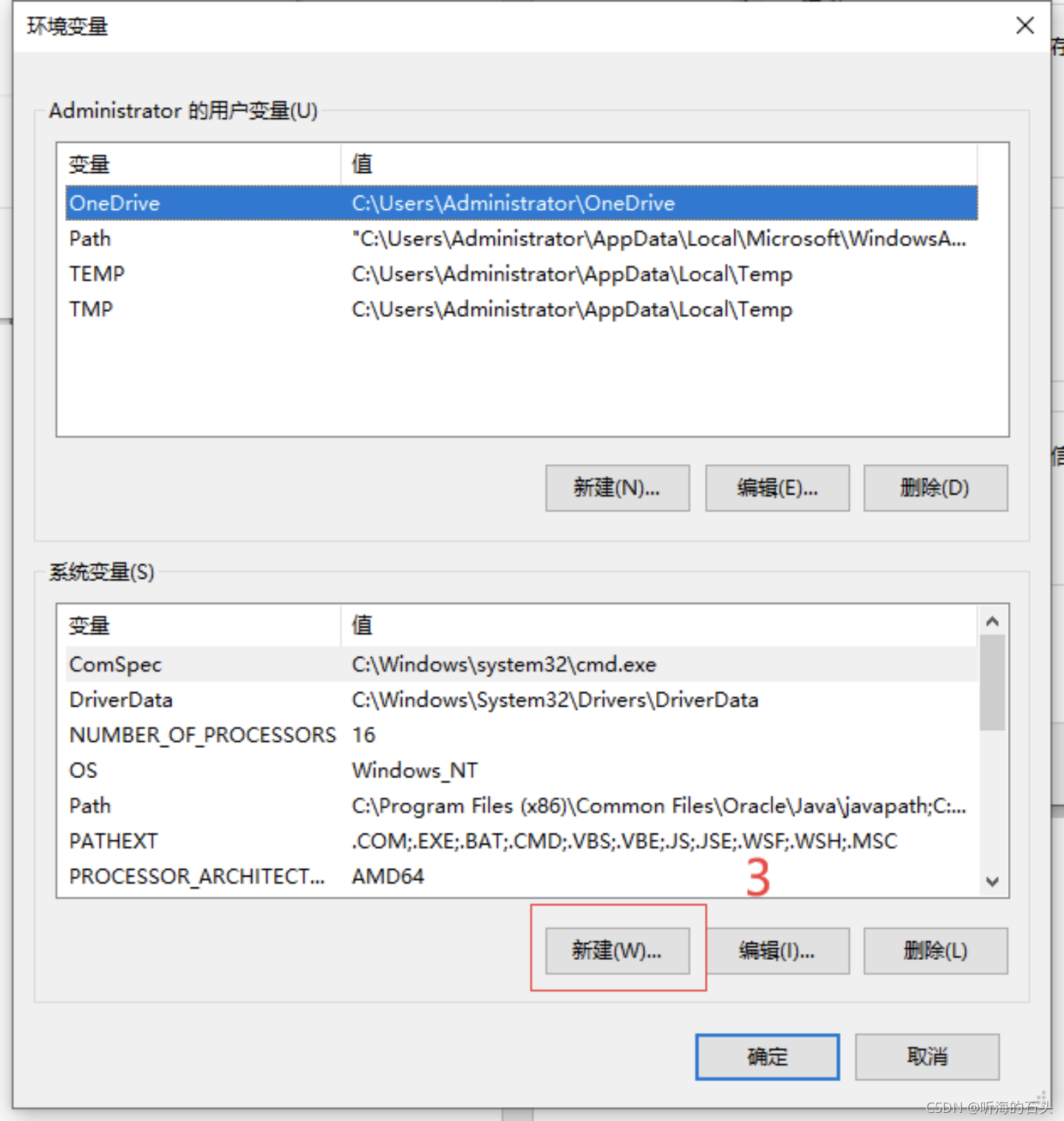

变量名输入:JAVA_HOME 然后点击浏览目录,选择C盘下的C:\Program Files (x86)\Java\jdk1.8.0_301文件夹,点击打开即可

变量名输入:JAVA_HOME 然后点击浏览目录,选择C盘下的C:\Program Files (x86)\Java\jdk1.8.0_301文件夹,点击打开即可

和配置Java的环境变量流程一样,配置Hadoop环境

和配置Java的环境变量流程一样,配置Hadoop环境  重启电脑

重启电脑

重启IDEA

重启IDEA

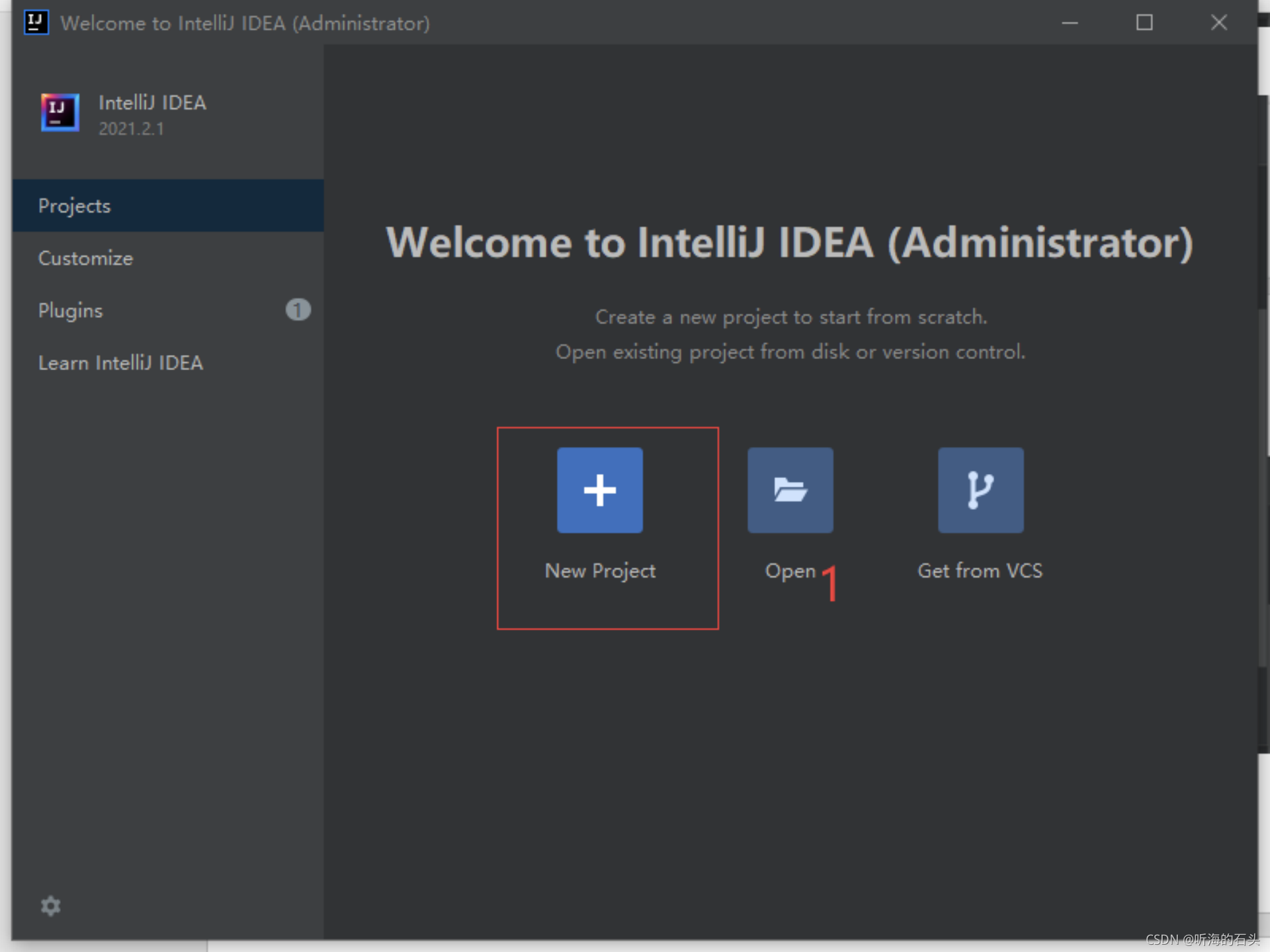

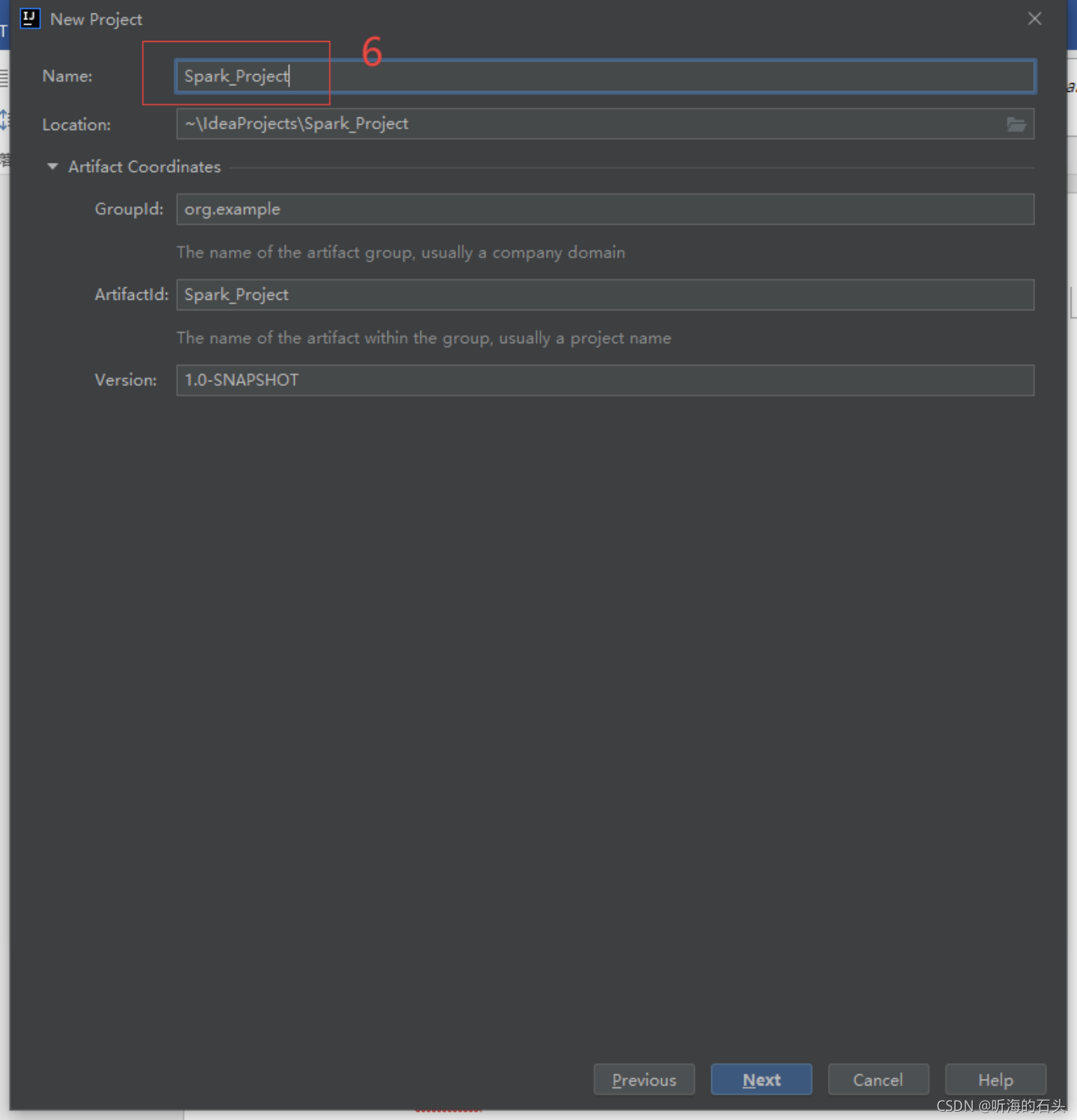

输入Spark_Project

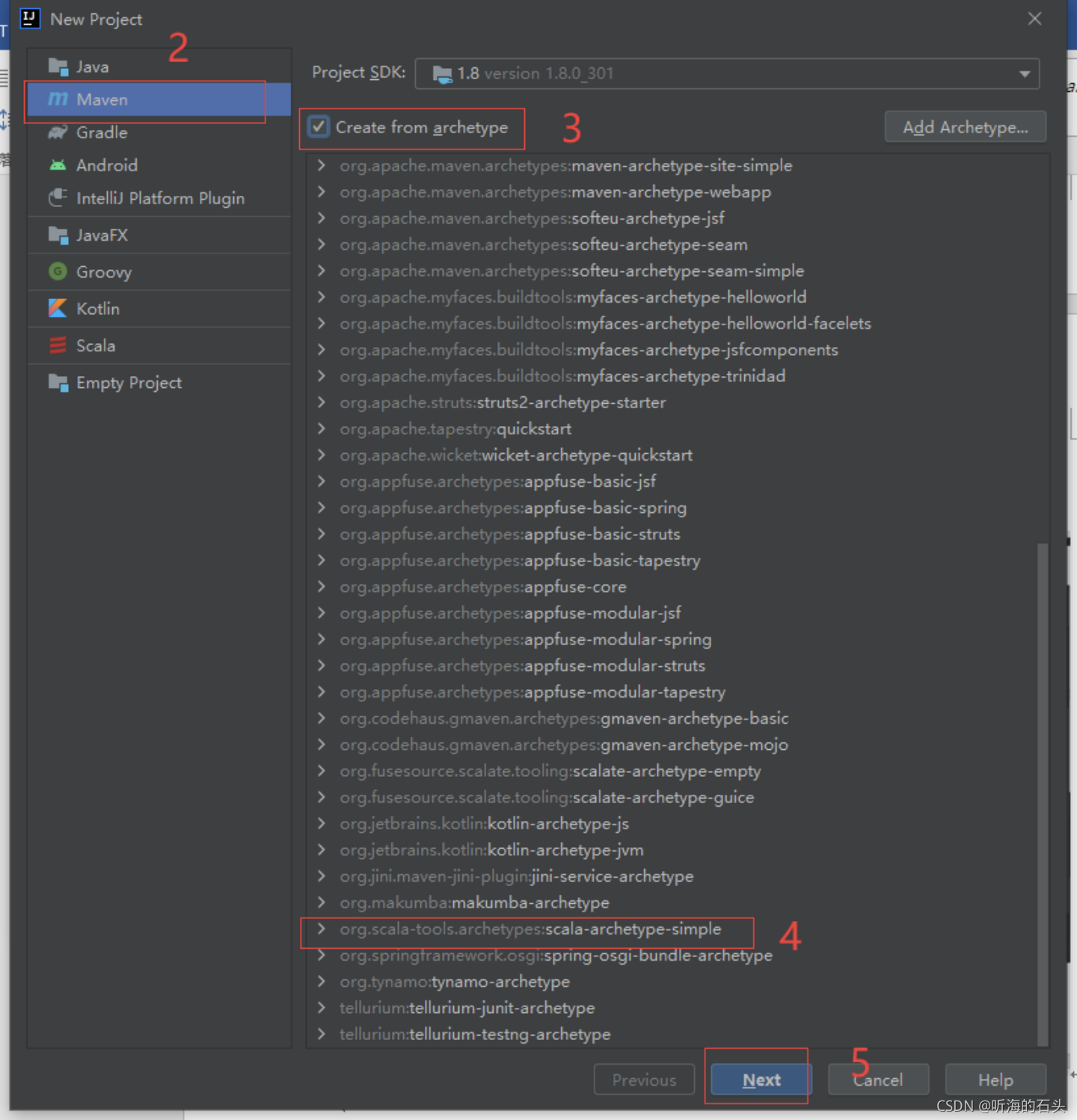

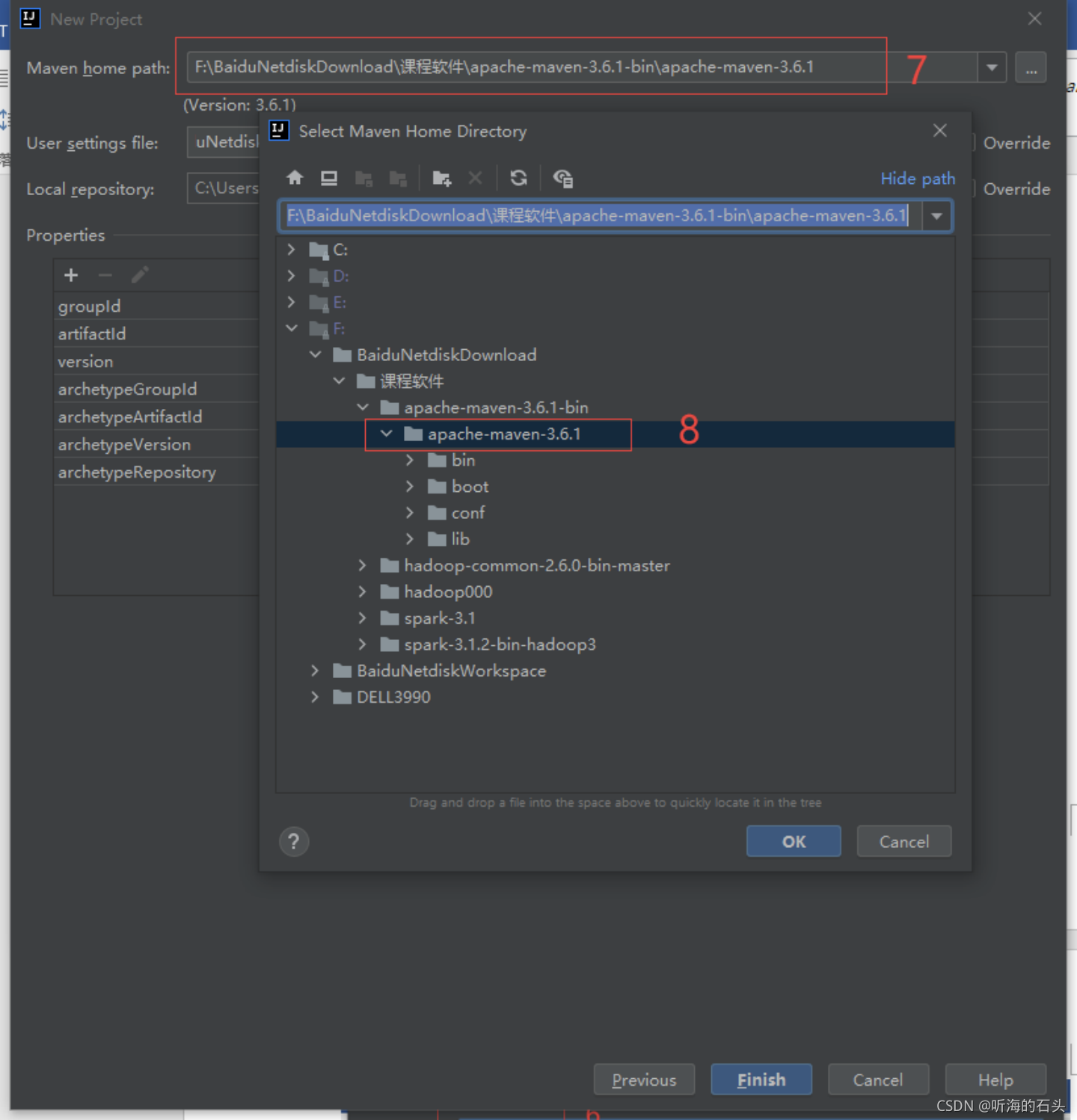

输入Spark_Project  选择提供的maven安装包

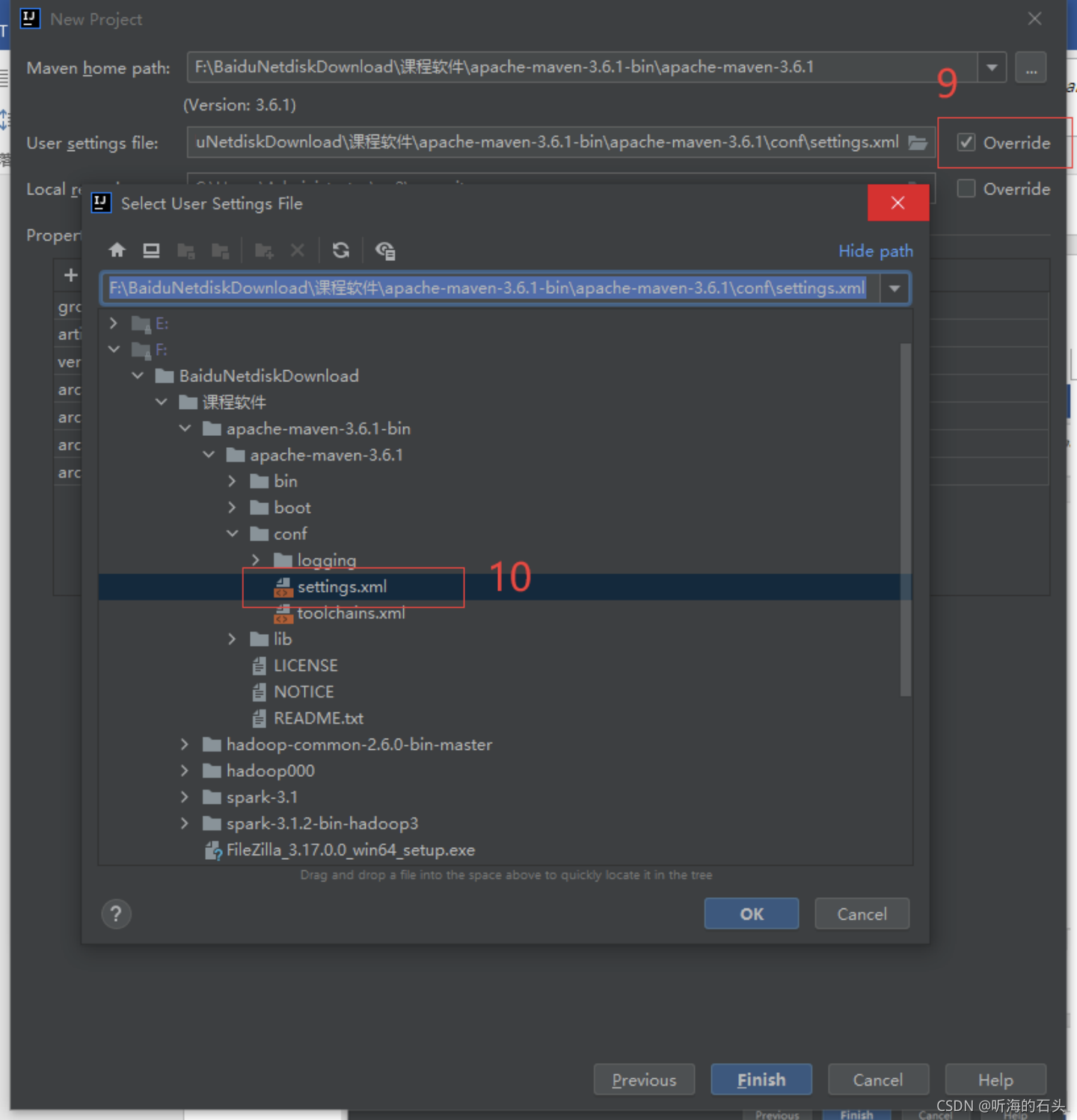

选择提供的maven安装包  选择apache-maven-3.6.1-bin\apache-maven-3.6.1\conf下的setting文件,并将Override打钩

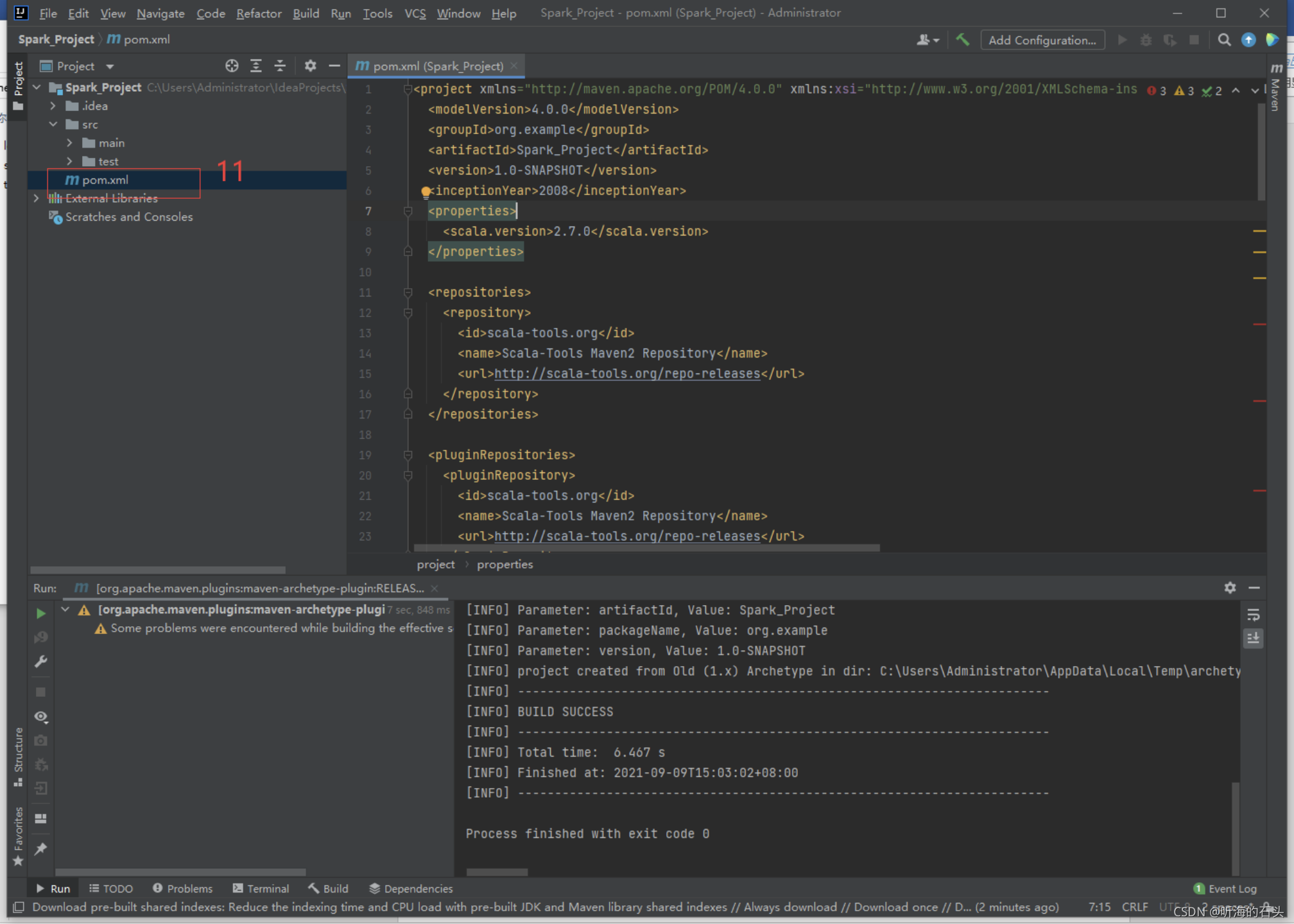

选择apache-maven-3.6.1-bin\apache-maven-3.6.1\conf下的setting文件,并将Override打钩  点击pom文件,将提供的pom内容全部复制修改

点击pom文件,将提供的pom内容全部复制修改 至此,环境配置完成,开始Spark编程。

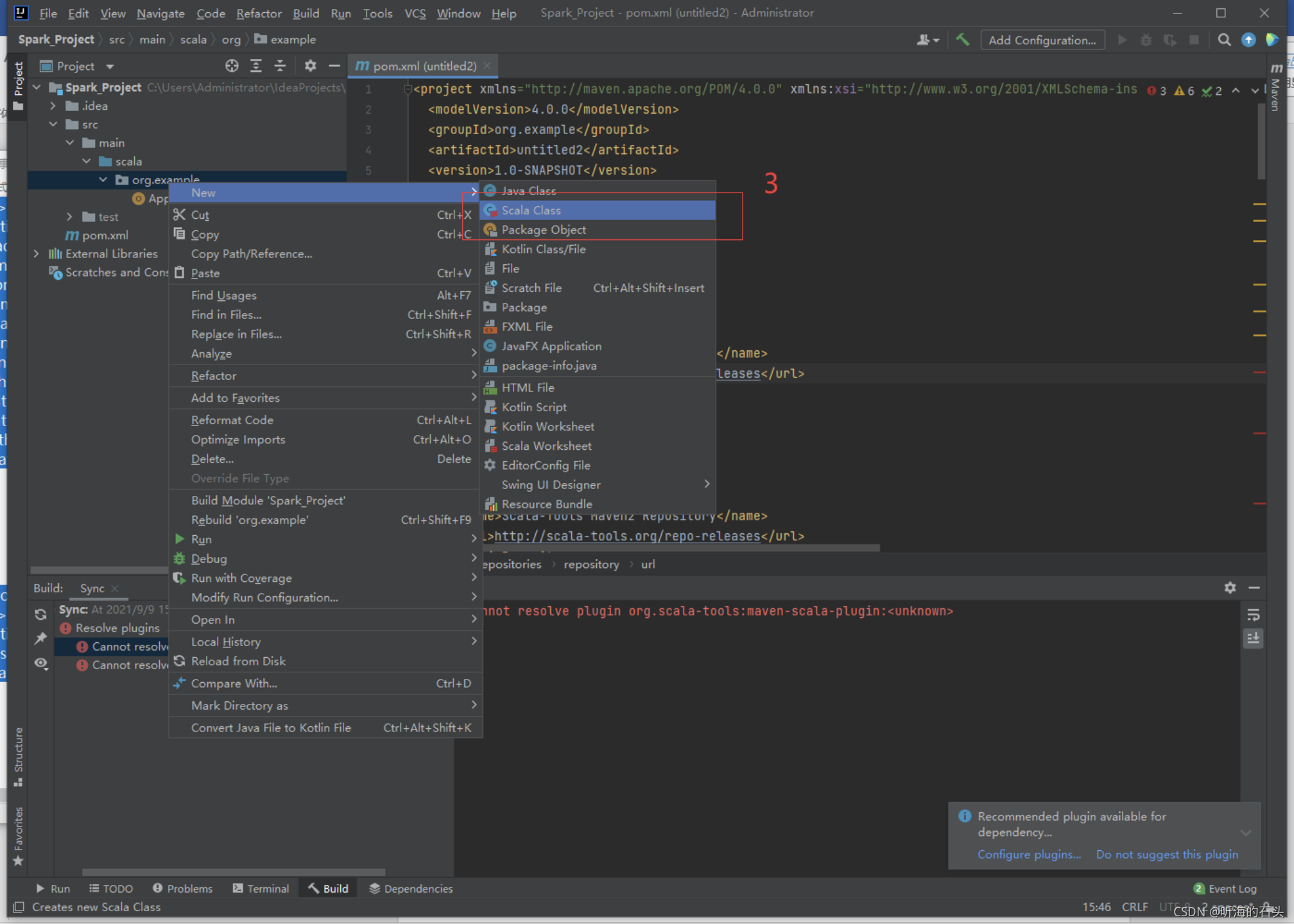

至此,环境配置完成,开始Spark编程。 创建Scala文件

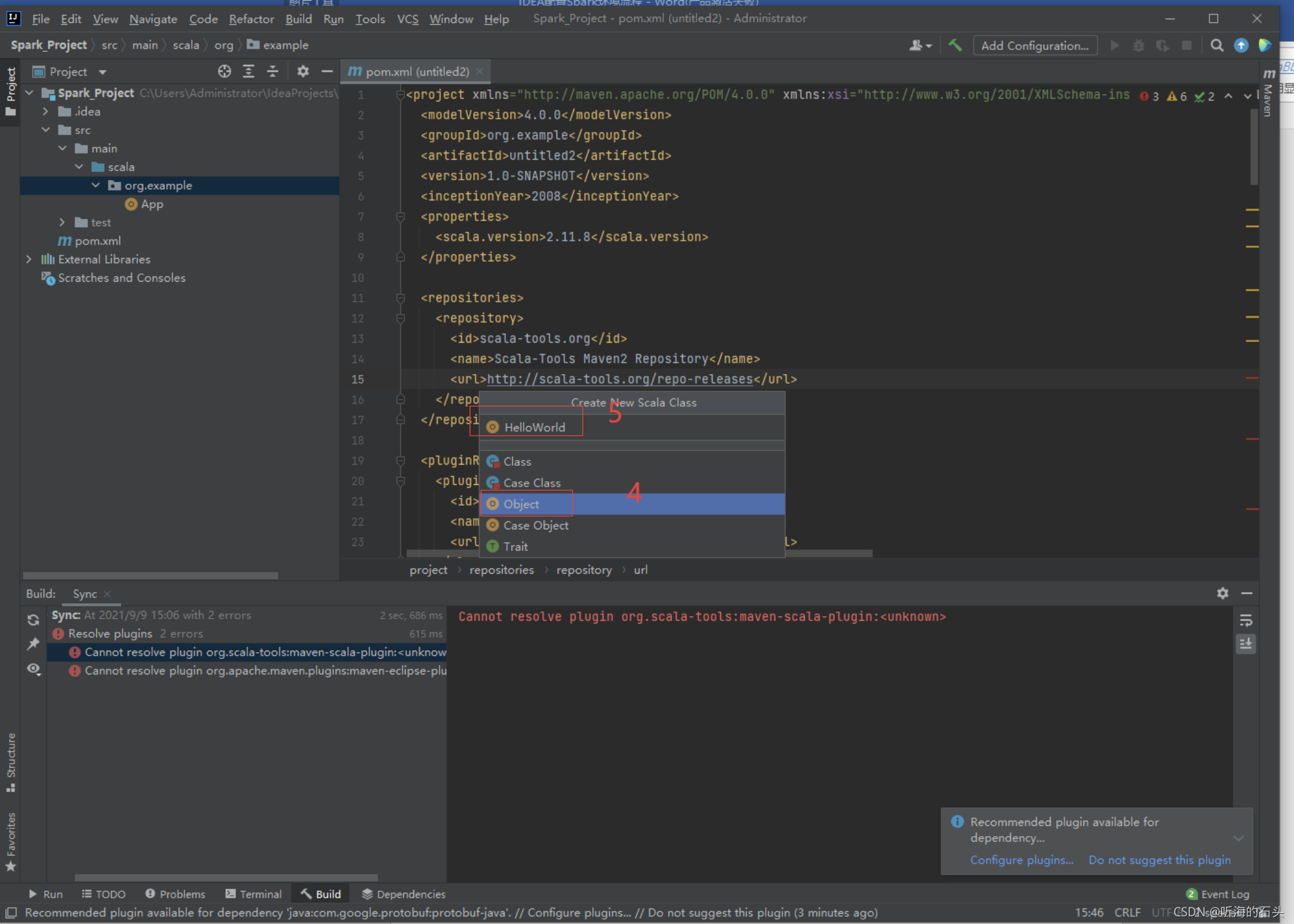

创建Scala文件  选择Object选项,输入HelloWorld类

选择Object选项,输入HelloWorld类

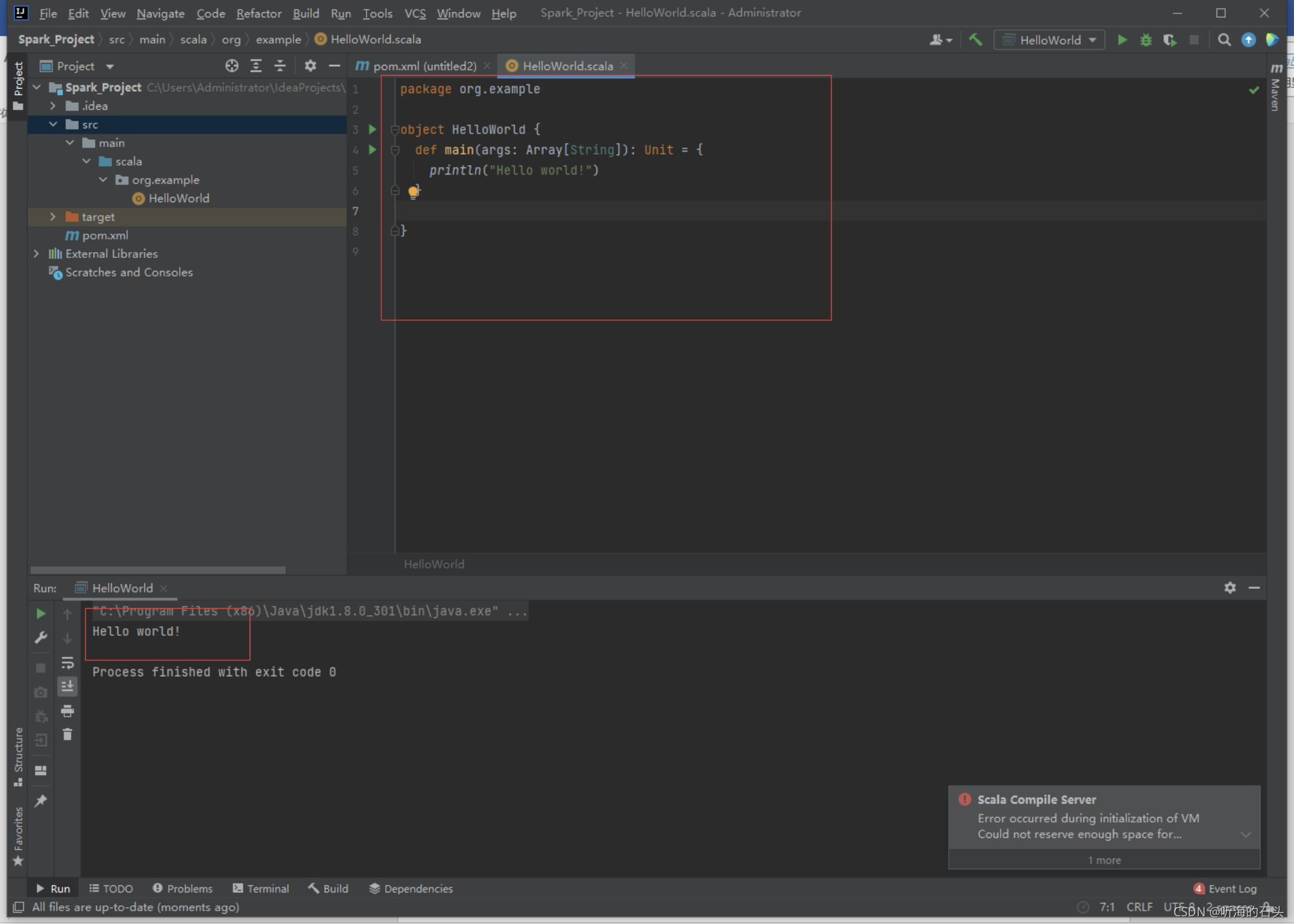

Scala测试完成!

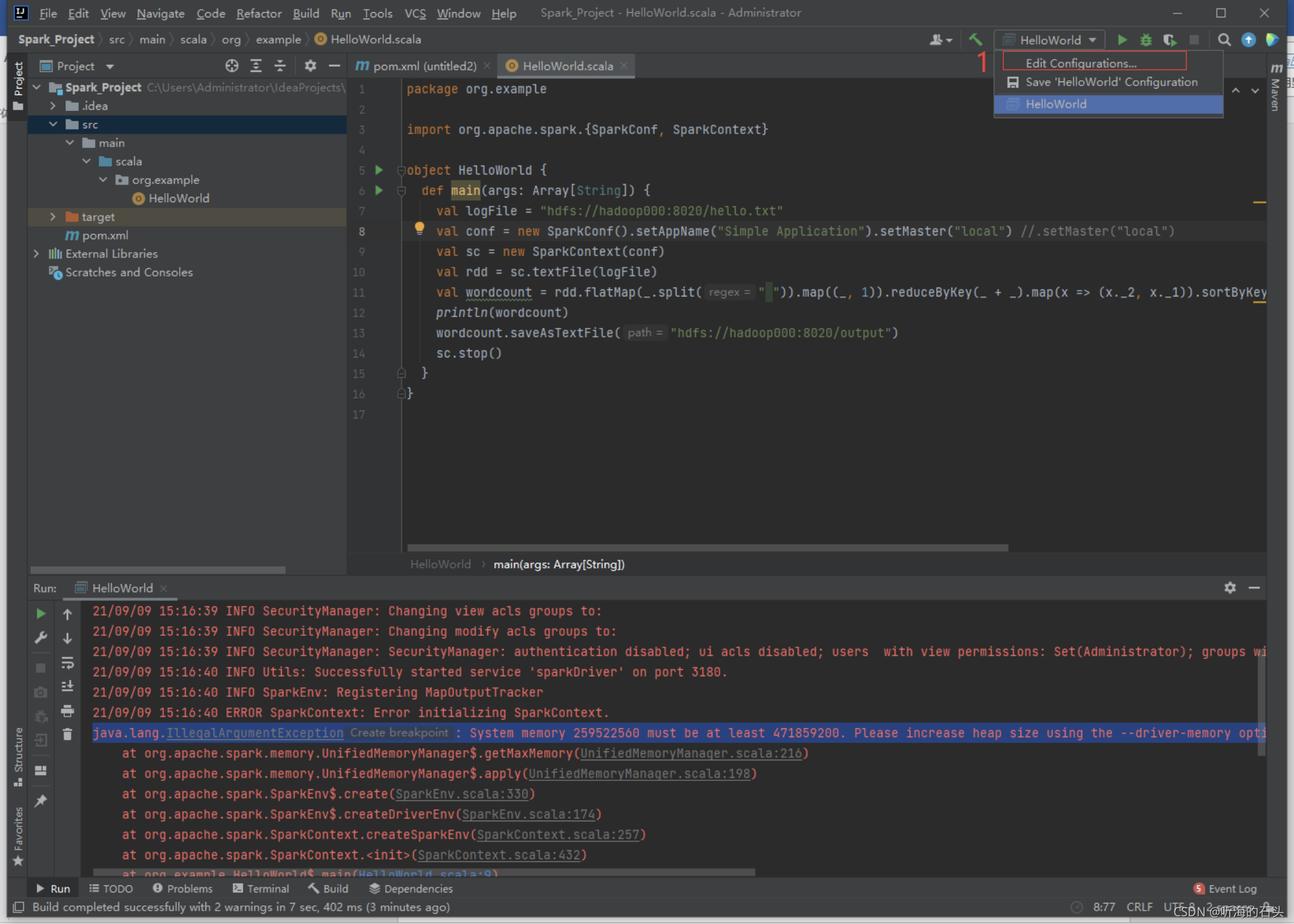

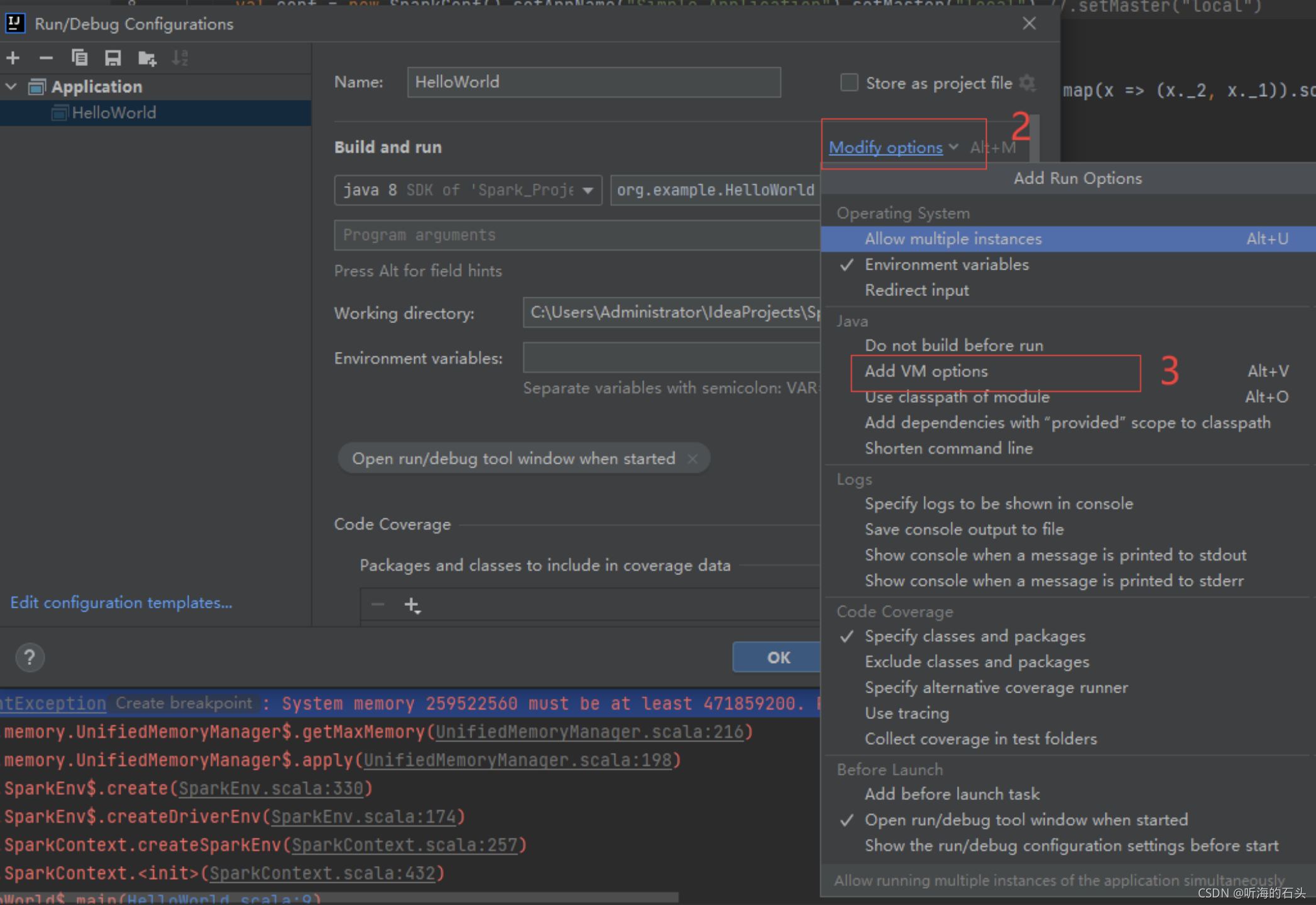

Scala测试完成! 发现报错,原因是虚拟内存未配置,

发现报错,原因是虚拟内存未配置,

输入:-Xms1024m 运行成功!

输入:-Xms1024m 运行成功!