警惕!AI诈骗正在全国爆发,科技公司老板被骗430万 |

您所在的位置:网站首页 › ai换脸是人工智能吗 › 警惕!AI诈骗正在全国爆发,科技公司老板被骗430万 |

警惕!AI诈骗正在全国爆发,科技公司老板被骗430万

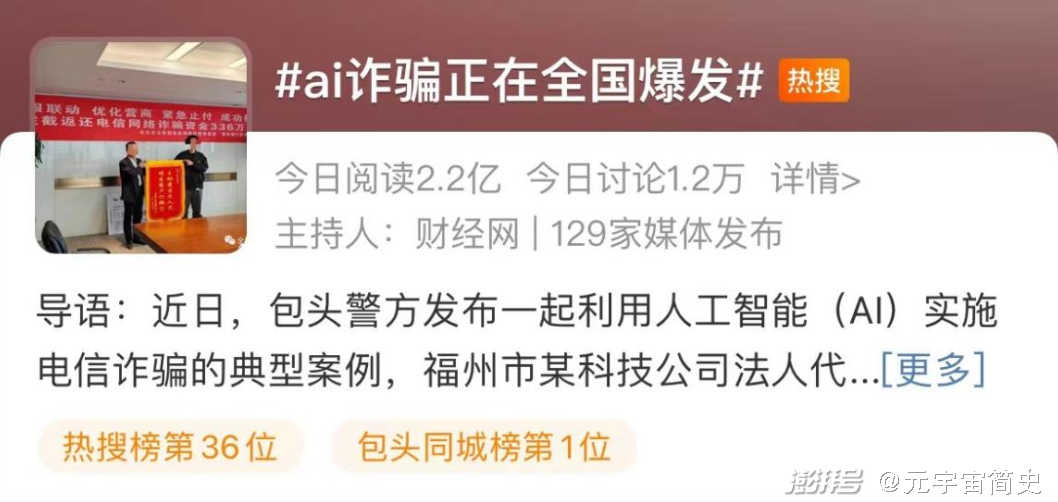

来源丨元宇宙简史 作者丨元宇宙简史主理人 Fun 【元宇宙导读】随着AI技术的发展和应用,网络诈骗也出现了新的手法和变化。近日,福州市某科技公司法人代表郭先生在与“好友”视频聊天时,被对方以借用账户转账为由,10分钟内被骗走430万元。这是一起典型的AI诈骗案件,也是目前全国范围内正在爆发的一种新型诈骗方式。本文将分析AI诈骗的原理、特点、危害和防范措施,以期提高公众的安全意识和防范能力。 近日,一条令人震惊的消息登上了微博热搜榜:AI诈骗正在全国爆发。  据报道,福州市某科技公司法人代表郭先生,在与好友视频聊天时,被对方以借用账户转账为由,10分钟内骗走了430万元。事后才发现,视频中的好友其实是骗子利用AI换脸和拟声技术伪造的。 这是近期全国范围内出现的一种新型电信诈骗,该诈骗利用AI人工智能,通过“换脸”和“拟声”技术模仿受害人的朋友或亲戚的声音和外貌,以此骗取受害者的信任,进行网络诈骗。 据包头警方介绍,这种诈骗的成功率高达100%,已经造成了多起重大经济损失。 01、430万AI诈骗案件始末 郭先生是福州市一家科技公司的法人代表,他在4月20日11时40分左右收到了一个微信视频电话,是他的好友打来的。 好友跟他聊了几句,然后说自己有个朋友在外地参加投标,需要借用郭先生公司的公对公账户转430万元保证金。好友还给郭先生发了银行转账单的截图,说已经把钱打到了郭先生的账户上。 郭先生看了视频,觉得好友的面貌和声音都没有问题,就没有去核实账户是否收到钱,于11时49分分两次把430万元转给了好友指定的账户。 转完钱后,郭先生给好友发了微信消息,告诉他已经办好了。没想到,好友回复了一个问号。 郭先生赶紧打电话给好友,才知道好友根本不知道这件事。原来,对方利用智能AI换脸技术,冒充好友对他进行了诈骗。 “他一直没有跟我说要借钱,只说会先把钱打给我,再让我转给他朋友。而且视频里面我也认出了他的长相和声音,所以我就没有多想”,郭先生说。 4月20日12时21分,福州市公安局刑侦支队向包头市公安局电信网络犯罪侦查局发出外协请求,称福建省一位知名民营企业负责人被骗走430万元,而涉案的银行卡是包头市蒙商银行的对公账户,请求包头警方尽快进行止付处理。 包头市公安局电信网络犯罪侦查局立刻启动“包头市警银联动绿色查询机制”,当班民警迅速完成核查、报审程序,并第一时间将涉案卡的信息通报给蒙商银行相关部门。 在银行的大力配合下,仅用10分钟,就成功拦截了该诈骗账户内的336.84万元被骗资金。同时,向福州市公安局警方提供了剩余款项93.16万元资金流出信息,为进一步追查该案剩余资金提供了重要线索。 目前,福建警方与包头警方正在全力追缴剩余资金中。  02、AI诈骗原理解析 AI换脸和拟声技术是人工智能技术在图像和语音领域的重要应用之一,它们可以通过深度学习算法,从大量数据中提取特征,并生成逼真的图像和语音。  AI换脸技术可以将一个人脸图像中的面部特征替换成另一个人脸图像中的面部特征,并保持原图像中其他部分不变。例如,可以将一个人脸图像中的眼睛、鼻子、嘴巴等替换成另一个人脸图像中对应部位的眼睛、鼻子、嘴巴,而发型可以保持不变。  AI拟声技术可以根据一个人语音样本中的音色、语调、节奏等特征生成与其相似或相同的语音,并可以根据输入文本合成任意内容的语音。例如,可以根据一个人的说话录音,生成与其相同或相似的声音,然后你可以用这个声音去和任何人交谈。  正常情况下,AI换脸和拟声技术可以为我们带来极大的便利,特别是可以提高影视行业的效率降低其成本,但如果被不法分子利用,则可能造成严重后果。 03、部分典型的AI诈骗案例 2022年2月,浙江温州市公安局瓯海分局接到报案称,一名陈先生被“好友”诈骗了近5万元。骗子利用陈先生好友在社交平台发布的视频,截取其面部视频画面后再利用“AI换脸”技术合成,制造陈先生与“好友”视频聊天的假象骗取其信任。 2021年4月,上海某公司高管因对方使用AI换脸与人工生成的语音技术制作公司领导的面孔,并要该高管转账,致使该高管被诈骗150万元。 2021年,常德网警巡查发布消息,AI技术改变诈骗,新骗局来袭后,诈骗成功率竟接近100%。骗子利用AI换脸技术,将自己置换成视频、电视剧中的男(女)主角,并通过社交软件与受害者聊天,以情感为诱饵进行诈骗。 2020年12月,广东深圳市某大学生小李在网上认识了一名女网友,并与其视频聊天。不料,对方利用AI换脸技术,将小李视频中的面部合成到不雅视频中,并以此威胁小李支付5万元封口费。小李拒绝后,对方将不雅视频发送给了小李的亲友,造成了严重的社会影响。  04、AI诈骗是如何实施的? AI诈骗的实施过程大致分为以下几个步骤: 1、骗子通过各种渠道收集受害人及其熟人的信息,如姓名、电话、社交账号、照片、视频等; 2、骗子利用AI换脸技术,将自己或他人的面部替换成受害人熟人的面部,并利用AI拟声技术,将自己或他人的声音转变成受害人熟人的声音; 3、骗子通过社交软件或电话联系受害人,并以视频方式进行信息确认,让受害人放松警惕; 4、骗子以各种理由诱导受害人转账汇款,如借钱、投资、紧急救助等,并催促受害人尽快操作; 5、骗子在收到钱款后立即消失,切断与受害人的联系。  05、AI诈骗有何特点? AI诈骗相比传统的电信诈骗,有以下几个特点: - 更加隐蔽和逼真。通过AI换脸和拟声技术,骗子可以轻易地伪装成任何人,并与受害人进行视频通话,让受害人无法辨别真伪; - 更加高效和精准。通过AI技术分析公众发布在网上的各类信息,骗子可以快速地筛选出目标人群,并根据不同情况制定定制化的诈骗脚本,从而提高诈骗成功率; - 更加难以防范和追查。由于AI换脸和拟声技术生成的内容很难被检测和辨认,受害人往往在事后才发现被骗,并且难以找到证据和线索。同时,由于骗子使用虚假或盗用的身份信息和账户信息进行转账汇款,也增加了警方追缴资金和抓捕嫌疑人的难度。

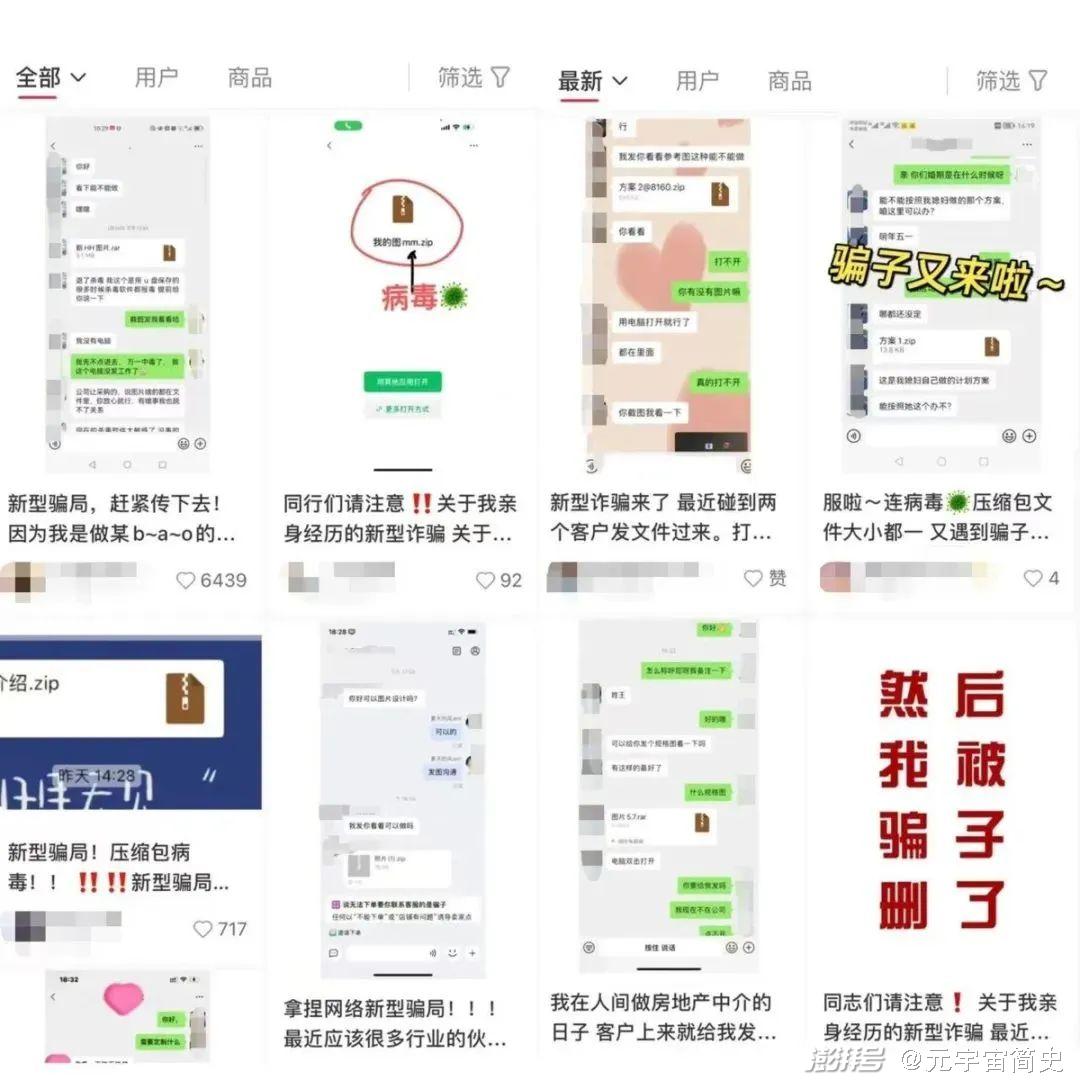

06、如何防范AI诈骗? 面对日益猖獗的AI诈骗,我们应该如何提高安全防范意识,避免上当受骗呢?以下是一些防范建议: - 不轻信陌生电话或视频。如果有陌生人或熟人通过电话或视频联系你,并要求你提供个人信息或转账汇款,要保持警惕,并通过其他方式核实对方身份; - 不随意透露个人信息或资产情况。不要在网上公开或分享过多的个人信息或资产情况,如姓名、电话、地址、出生日期、银行卡号、验证码等,以免被不法分子利用; - 不贪图小利或同情心。不要轻信陌生人或熟人给你介绍的投资理财项目、中奖信息、紧急救助等,并要求你转账汇款。如果有疑问或感觉异常,要及时报警求助; - 不下载未知软件或点击可疑链接。不要随意下载未知来源或非正规渠道的软件或应用程序,并要定期检查手机、电脑是否中毒。不要轻易点击来自陌生人或熟人发送的可疑链接,并要注意保护自己的社交账号密码; - 不参与非法活动或违规操作。不要为了赚取佣金或回报而参与非法活动或违规操作,如代开发票、代收货款、代购物品等,并要注意保护自己的银行卡和支付账户。 总之,在AI技术飞速发展日益普及的今天,我们应该充分利用其带来的便利和效率,同时也要警惕其可能带来的风险和危害。只有提高自身安全意识和防范能力,才能有效地避免成为AI诈骗的受害者。 严正声明:本文为元宇宙简史原创,未经授权禁止转载!内容仅供参考交流,不构成任何投资建议。任何读者若据此进行投资决策,风险自担。 |

【本文地址】