机器学习笔记(七):概率图模型 |

您所在的位置:网站首页 › 联合概率表示 › 机器学习笔记(七):概率图模型 |

机器学习笔记(七):概率图模型

|

机器学习最重要的任务,是根据一些已观察到的证据(例如训练样本)来对感兴趣的未知变量(例如类别标记)进行估计和推测。概率模型提供了一种描述框架,将学习任务归结为计算变量的概率分布。概率图模型(probabilistic graphical model,简称PGM)是一类用图来表达变量相关关系的概率模型,它以图为表示工具,最常见的是用一个结点表示一个或一组随机变量,结点之间的边表示变量间的概率相关关系,即“变量关系图”。 根据边的性质不同,概率图模型可大致分为两类:第一类是使用有向无环图表示变量间的依赖关系,称为有向图模型或贝叶斯网;第二类是使用无向图表示变量间的相关关系,称为无向图模型或马尔科夫网(Markov network). 关于贝叶斯网在上一篇文章中已有介绍,本文主要介绍马尔科夫网。 目录 一、隐马尔科夫模型 二、马尔科夫随机场 三、条件随机场 一、隐马尔科夫模型(Hidden Markov Model,简称HMM)隐马尔科夫模型是结构最简单的动态贝叶斯网,其基本思想来源于马尔可夫过程,可看作是一个含有隐含未知参数的马尔可夫过程。(对马尔可夫过程不了解的同学可参考百度百科中的介绍 https://baike.baidu.com/item/%E9%A9%AC%E5%B0%94%E5%8F%AF%E5%A4%AB%E8%BF%87%E7%A8%8B/2952385) 一个对马尔科夫模型直观的描述如下图所示

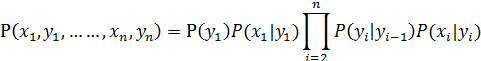

上图中的变量可分为两组,一组是状态变量{y1,y2,…,yn},yi∈У表示系统在第i时刻的状态,通常假定状态变量是隐藏的、不可被观测的,因此状态变量亦称隐变量。第二组是观测变量即可以被观测到的变量{x1,x2,…,xn},其中xi∈Х表示第i时刻的观测值。观测变量的取值仅依赖于状态变量,即xt由yt确定;而yt仅依赖于上一个时刻的状态y(t-1),即系统下一时刻的状态仅由当前状态决定,不依赖于以往的任何状态。基于这种依赖关系,所有变量的联合概率分布为

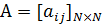

从上图与上式可以看出,想要确定一个隐马尔科夫模型主要需要知道模型的结构和三组与模型相关的参数。这三组参数分别为 1、状态转移概率:模型在各个状态间转换的概率,通常记为矩阵

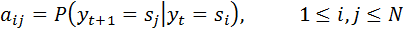

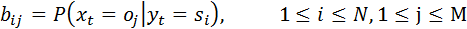

2、输出观测概率:模型根据当前状态获得各个观测值的概率,通常记为矩阵

其中

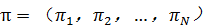

表示在任意时刻t,若状态为si,则观测值oj被获取的概率。 3、初始状态概率:模型在初始时刻各状态出现的概率,通常记为

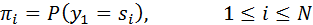

其中

表示模型的初始状态为si的概率。 通过制定状态空间y、观测空间x和上述三组参数,就能确定一个隐马尔科夫模型,通常用其参数λ=[A,B,π]来指代。给定隐马尔科夫模型λ,它按如下过程产生观测序列: 1、 设置t=1,并根据初始状态概率π选择初始状态y1; 2、 根据状态yt和输出观测概率B选择观测变量取值xt; 3、 根据状态yt和状态转移矩阵A转移模型状态,即确定y(t+1); 4、 若t |

【本文地址】

今日新闻 |

推荐新闻 |