机器学习(11)线性回归(1)理论:损失函数(含最小二乘法)、正规方程、梯度下降、回归性能评估(均方差) |

您所在的位置:网站首页 › 线性回归方程公式计算公式 › 机器学习(11)线性回归(1)理论:损失函数(含最小二乘法)、正规方程、梯度下降、回归性能评估(均方差) |

机器学习(11)线性回归(1)理论:损失函数(含最小二乘法)、正规方程、梯度下降、回归性能评估(均方差)

|

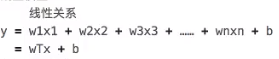

目录 一、线性回归基础理论 1、定义与公式 2、线性关系(单特征与双特征) 2-1、单特征线性关系 2-2、双特征平面关系 2-3、其他线性模型 二、线性回归的损失和优化原理 1、损失函数 1、定义 2、公式 3、损失函数举例 2、损失函数 -- 最小二乘法 2、优化方法: 2-1、正规方程 1、公式 2、原理 2-2、梯度下降 1、单特征 2、双特征 3、梯度下降过程(单特征) 4、梯度下降过程(双特征) 3、正规方程与梯度下降优缺点对比 三、回归性能评估(均方差) 公式 API 一、线性回归基础理论 1、定义与公式定义: 线性回归:利用回归方程,对一个或多个自变量(特征值)和因变量(目标值)之间关系进行建模的一种分析方式。 线性关系公式 :

权重系数:w 偏置:b 2、线性关系(单特征与双特征) 2-1、单特征线性关系

(该图是线性模型,但不是线性关系) 尽可能让假定的参数贴近真实的参数,越贴近,结果越准确。

损失函数(loss function):是用来估量模型的预测值f(x)与真实值Y的不一致程度,它是一个非负实值函数,通常使用L(Y, f(x))来表示,损失函数越小,模型的鲁棒性就越好。 2、公式

其中,前面的均值函数表示的是经验风险函数,L代表的是损失函数,后面的ΦΦ是正则化项(regularizer)或者叫惩罚项(penalty term),它可以是L1,也可以是L2,或者其他的正则函数。整个式子的目的:找到使目标函数最小时的θ值(损失最小的情况)。 3、损失函数举例1、log对数损失函数(逻辑回归) 2、平方损失函数(最小二乘法) 3、指数损失函数(Adaboost) 4、Hinge损失函数(SVM) 5、0-1损失函数 6、绝对值损失函数 4、损失函数 -- 最小二乘法 优化目的:让损失函数取得最小值。 优化方法: 1、正规方程; 2、梯度下降。 2-1、正规方程 1、公式

优点:不需要试错,可以直接取得最小值,比较快捷。 缺点:当特征过于复杂时,求解速度太慢且得不到结果。 适用于:小数据场景。(梯度下降相对用的更多一些) 2-2、梯度下降机器学习的过程类似于梯度下降:根据上一步的“错误”,不断学习改进,才有了学习能力。 1、单特征

从上面比较高的位置,一点一点移动到最低点: 求出最小的损失值后,它的权重和偏置就是需要求的模型参数。

小规模数据:正规方程、岭回归。 大规模数据:梯度下降。 三、回归性能评估(均方差)回归性能评估方式:求均方差,均方差较小的那个模型效果较好。 公式

(y^i为预测值,y为真实值) API sklearn.metrics.mean_squared_error

|

【本文地址】

今日新闻 |

推荐新闻 |