深度长文 |

您所在的位置:网站首页 › 立体3d视觉效果怎么做视频 › 深度长文 |

深度长文

|

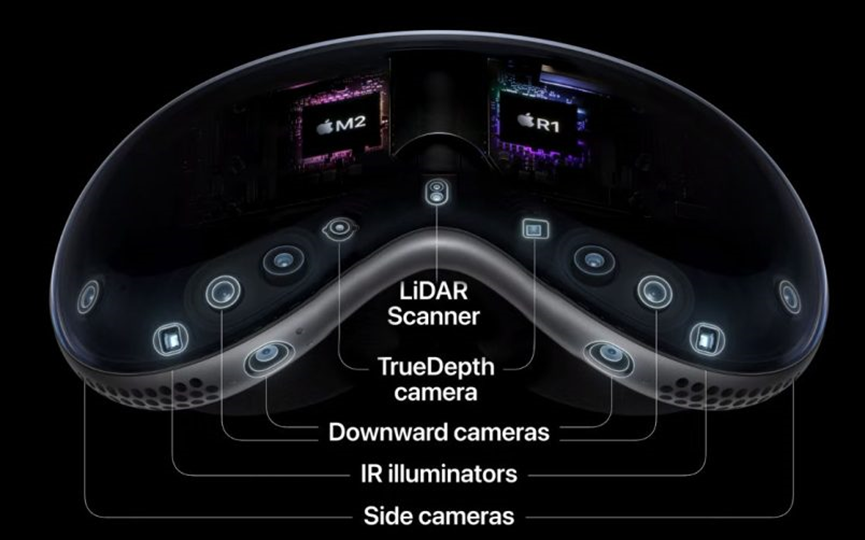

Apple Vision Pro的传感器分布 Apple Vision Pro目前公开出的产品形态包含众多传感器,以强化设备的深度信息感知能力,实现最佳的三维空间虚实结合效果。其中视觉传感器包括以下几类:RGB摄像头,红外摄像头,dToF激光雷达,结构光相机,以及鱼眼红外摄像头。

Apple Vision Pro正面传感器分布图 (图片来自苹果公司官方公开信息) Apple Vision Pro 的外部包括以下几种视觉传感器 8 个摄像头 2个前向的RGB摄像头,支持前向拍摄和VST 4个向侧前方的鱼眼红外摄像头,支持6DOF追踪 2个向下的红外摄像头,支持躯干追踪和下方的手势追踪 2个红外激光器,发出红外光对操控区域的躯干、腿部、膝盖、手以及环境进行照明,以辅助红外摄像头和鱼眼红外摄像头对相应区域内活动单元的捕捉 1 个dToF LiDAR激光雷达,沿用iPhone pro后摄的dToF LiDAR形式,支持3D拍摄、空间重建、空间的深度感知与定位 1个结构光相机,与iPhone的前置结构光Face ID类似,苹果公司称之为TrueDepth摄像头,支持FaceTime应用的面部扫描功能和前向区域的精细手势追踪

Apple Vision Pro内侧传感器分布图 (图片来自苹果公司官方公开信息) Apple Vision Pro 的内部有 4 个红外摄像头和一圈 LED,推测应该是采用结构光方案的光场信息进行眼动追踪和眼部表情分析。 苹果公司在Apple Vision Pro上使用了丰富的传感器硬件,其中与其他VR厂商的尝试所明显不同的是,苹果公司使用了激光雷达LiDAR和结构光传感器,并取消了手柄而转用手势追踪来进行交互。这两者的结合,配合苹果公司优异的UI界面效果,实现了在同类硬件设备中非常突出的表现,让第一批Apple Vision Pro的实机体验者们对其大部分功能给出了极高的评价。 Apple dToF LiDAR的技术路线 苹果公司在其品牌下的系列产品上均使用了由索尼独家开发的dToF LiDAR激光雷达,并陆续搭载在iPad Pro,iPhone 12 Pro,iPhone 13 Pro,iPhone 14 Pro,以及即将发行的Apple Vision Pro产品上。在2013年苹果收购以色列3D传感公司PrimeSense以及之后的一系列收购动作中,透露出苹果公司在进行消费电子产品上对3D功能的规划和长期布局。自2013年之后苹果公司进行了长时间的技术积累,聚焦在3D传感领域和dToF激光雷达方案上的成果最终于2017年和2020年陆续发布,包括2017年在iPhone X上推出了前置结构光的Face ID功能,和2020年在iPad和iPhone 12 pro上推出了与后置摄像头组合使用的dToF LiDAR激光雷达。

iPhone 12 Pro的LiDAR处于后摄模组的右下角 (图片来自苹果公司官方公开信息)

苹果和索尼合作的dToF LiDAR模组形态 (上图来自数码博主拆机视频,下图来自苹果公司官方公开信息) 从上图中可以看到,Apple Vision Pro这款产品,其正中间的激光雷达的形态,与苹果公司前期发布的一系列产品所搭载的dToF LiDAR激光雷达模组几乎完全一致。据推测这款LiDAR使用的收光端SPAD面阵芯片方案为IMX 590,是苹果公司与索尼的定制款芯片。但因为索尼近期的一系列商业动作,该型号未来可能会因为改版而发生一些变化,即整个dToF LiDAR的收发光核心芯片均有索尼独家提供。之前这款LiDAR所使用的发光端VCSEL芯片,一直是由Lumentum和WIN Semi公司提供,而业内专家判断索尼希望将发光端VCSEL芯片替换为索尼的自研芯片,索尼可能希望将VCSEL和Driver做成VCSEL on driver的形式,以实现更优的性能和功耗。

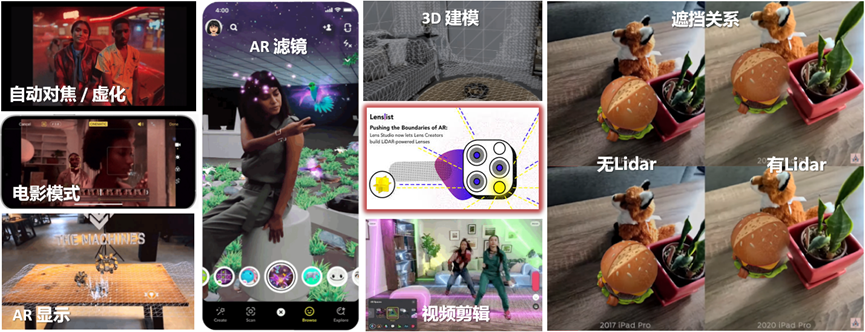

各种基于iPhone所开发的3D应用 (根据自网络及苹果公司公开信息整理) 目前苹果公司在其高端机型上广泛使用的dToF激光雷达是由索尼独家设计并供应,其搭载的核心接收端芯片可能方案为IMX590,是一款可以输出数百到上千个散点的SPAD面阵产品。苹果公司通过将这个传感芯片生成的散点阵列深度图像与主摄RGB图像进行融合,从而以算法实现较高分辨率及精度的Mesh网格和RGBD融合深度图。第三方公司利用三维信息开发了各类3D应用及特效功能,包括知名的JigSpace,Roomplan,Measure,Polycam,3D Scanner,Canvas,Playground AR,以及知名公司Snapchat,IKEA Place的3D应用。

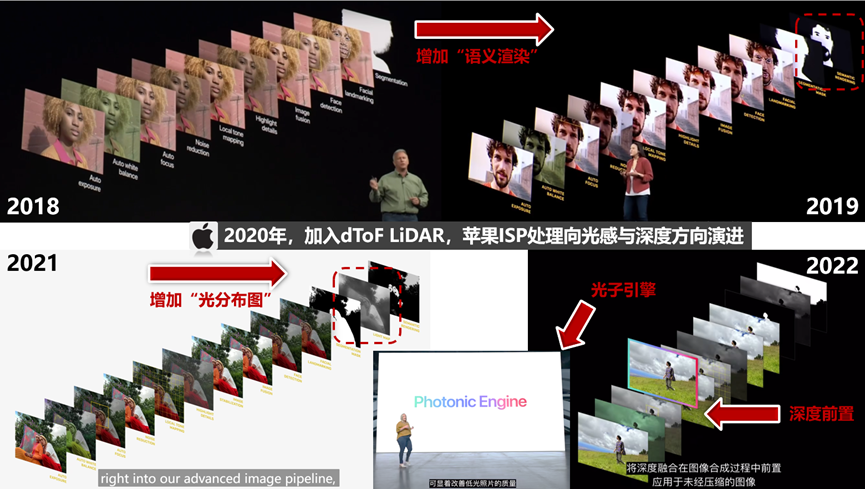

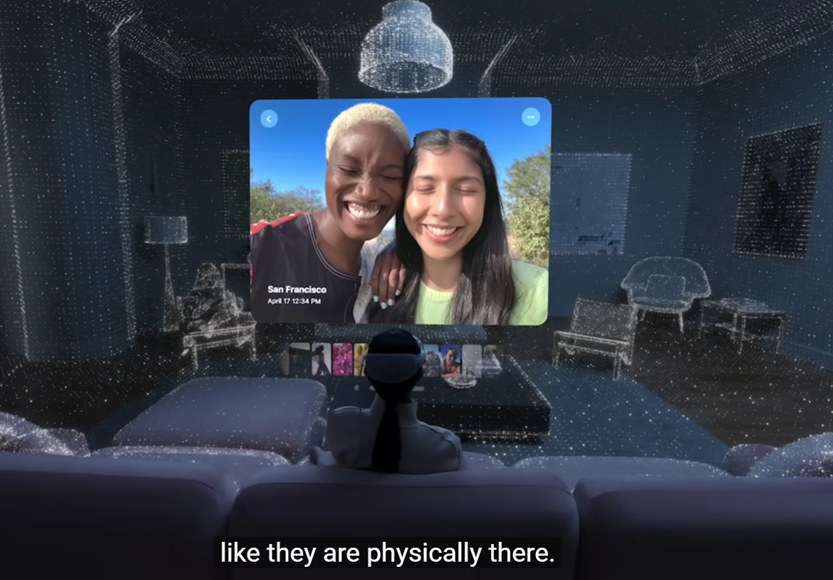

苹果公司iPhone影像系统的ISP架构 (根据苹果公司官方公开信息整理) 基于LiDAR的相关应用开发不仅只来自于第三方,苹果公司也在iPhone的影像系统中不断基于LiDAR开发其ISP图像处理框架。在2020年的iPhone 12 Pro加入dToF LiDAR之后,苹果公司在其ISP图层处理中增加了“光分布图”,dToF LiDAR本身在测量深度的同时就可以获取红外光分布图,而且在2022年之后苹果将整套依靠光感与深度驱动的影像系统称为Photonic Engine(光子引擎),并将深度融合在图像处理过程中前置,置于3A层(自动曝光,自动白平衡,自动对焦)后的第一层,成为后续图层渲染等处理的重要依据。另外,3A层的自动对焦功能也是基于LiDAR的高帧率深度信息来实现的,LiDAR自动对焦可以极好地弥补摄像头PDAF在弱光、明暗交替等场景下较弱的自动对焦能力。 Apple Vision Pro中展示的dToF LiDAR相关功能 苹果MR设备上所搭载的dToF LiDAR沿用了通过iPhone所积累的三维重建能力,通过Apple Vision Pro设备中间位置的LiDAR能够感知所处空间和房屋的3D空间结构,并将该空间结构运用到后面将介绍到的各类功能的方方面面之中。这个3D空间结构可以通过LiDAR预扫描建立而成,也可以通过高帧率的扫描来实时更新周边环境信息。

Apple Vision Pro发布会3D空间重建 (图片来自苹果公司官方公开信息) >>> VST功能 3D Camera功能 Mindfulness功能 Occlusion功能 3D视觉的来源 晶状体的工作机制 MR设备如何重塑3D自然视觉 |

【本文地址】

今日新闻 |

推荐新闻 |