SpringBoot 热搜与不雅文字过滤实战教程,你学会了吗? |

您所在的位置:网站首页 › 文字过滤效果代码 › SpringBoot 热搜与不雅文字过滤实战教程,你学会了吗? |

SpringBoot 热搜与不雅文字过滤实战教程,你学会了吗?

|

👉 欢迎加入小哈的星球 ,你将获得: 专属的项目实战 / Java 学习路线 / 一对一提问 / 学习打卡/ 赠书福利 全栈前后端分离博客项目 1.0 版本完结啦,2.0 正在更新中..., 演示链接:http://116.62.199.48/ ,全程手摸手,后端 + 前端全栈开发,从 0 到 1 讲解每个功能点开发步骤,1v1 答疑,直到项目上线。目前已更新了183小节,累计29w+字,讲解图:1244张,还在持续爆肝中.. 后续还会上新更多项目,目标是将Java领域典型的项目都整一波,如秒杀系统, 在线商城, IM即时通讯,Spring Cloud Alibaba 等等,戳我加入学习,已有730+小伙伴加入(早鸟价超低)

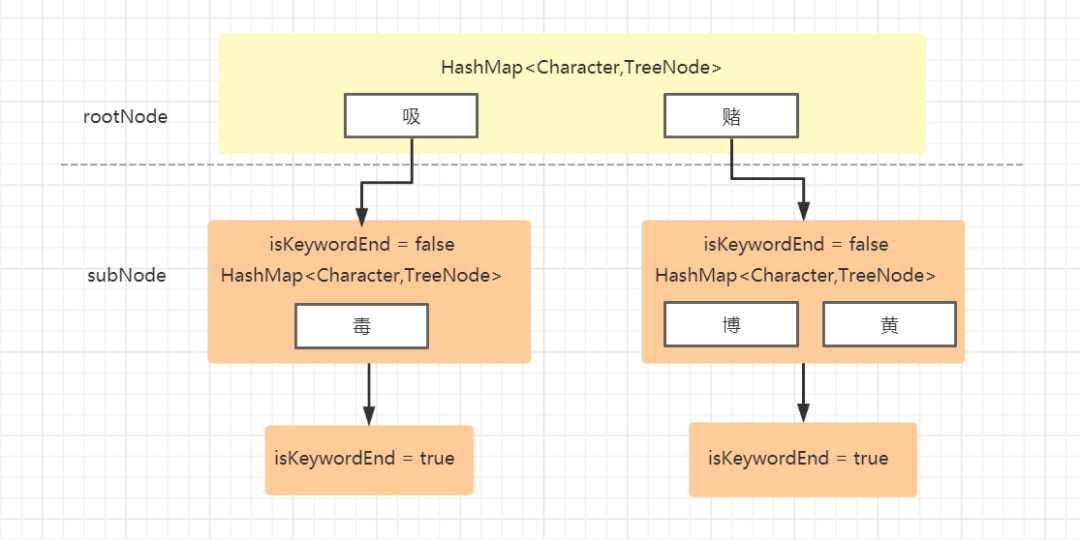

一、前言 二、不雅文字过滤 三、Redis搜索栏热搜 一、前言这里主要讲springboot整合redis的个人搜索记录与热搜、敏感词过滤与替换两个功能,下面进行环境准备,引入相关maven依赖 org.springframework.boot spring-boot-starter-web org.springframework.boot spring-boot-starter-test test org.springframework.boot spring-boot-starter-data-redis 2.7.0 org.apache.commons commons-lang3 3.12.0application.yml配置为 spring: redis: #数据库索引 database: 0 host: 192.168.31.28 port: 6379 password: 123456 lettuce: pool: #最大连接数 max-active: 8 #最大阻塞等待时间(负数表示没限制) max-wait: -1 #最大空闲 max-idle: 8 #最小空闲 min-idle: 0 #连接超时时间 timeout: 10000最后敏感词文本文件放在resources/static目录下,取名为word.txt,敏感词文本网上很多,这里就随便贴一个: https://github.com/lining0806/TextFilter/blob/master/敏感词库大全.txt 二、不雅文字过滤 1、实现原理简单原理如下图所示,使用了DFA算法,创建结点类,里面包含是否是敏感词结束符,以及一个HashMap,哈希里key值存储的是敏感词的一个词,value指向下一个结点(即指向下一个词),一个哈希表中可以存放多个值,比如赌博、赌黄这两个都是敏感词。

敏感词库的初始化,这里主要工作是读取敏感词文件,在内存中构建好敏感词的Map节点 /** * @author shawn * @version 1.0 * @ClassName SensitiveWordInit * Description:屏蔽一些无关紧要的警告。使开发者能看到一些他们真正关心的警告。从而提高开发者的效率 * 屏蔽敏感词初始化 * @date 2022/6/22 18:20 */ @Configuration @SuppressWarnings({ "rawtypes", "unchecked" }) public class SensitiveWordInit { // 字符编码 private String ENCODING = "UTF-8"; // 初始化敏感字库 public Map initKeyWord() throws IOException { // 读取敏感词库 ,存入Set中 Set wordSet = readSensitiveWordFile(); // 将敏感词库加入到HashMap中//确定有穷自动机DFA return addSensitiveWordToHashMap(wordSet); } // 读取敏感词库 ,存入HashMap中 private Set readSensitiveWordFile() throws IOException { Set wordSet = null; ClassPathResource classPathResource = new ClassPathResource("static/word.txt"); InputStream inputStream = classPathResource.getInputStream(); //敏感词库 try { // 读取文件输入流 InputStreamReader read = new InputStreamReader(inputStream, ENCODING); // 文件是否是文件 和 是否存在 wordSet = new HashSet(); // StringBuffer sb = new StringBuffer(); // BufferedReader是包装类,先把字符读到缓存里,到缓存满了,再读入内存,提高了读的效率。 BufferedReader br = new BufferedReader(read); String txt = null; // 读取文件,将文件内容放入到set中 while ((txt = br.readLine()) != null) { wordSet.add(txt); } br.close(); // 关闭文件流 read.close(); } catch (Exception e) { e.printStackTrace(); } return wordSet; } // 将HashSet中的敏感词,存入HashMap中 private Map addSensitiveWordToHashMap(Set wordSet) { // 初始化敏感词容器,减少扩容操作 Map wordMap = new HashMap(wordSet.size()); for (String word : wordSet) { Map nowMap = wordMap; for (int i = 0; i HOT_SEARCH_NUMBER) { break; } Long time = Long.valueOf(Objects.requireNonNull(valueOperations.get(val))); //返回最近一个月的数据 if ((now - time) HOT_SEARCH_NUMBER) { break; } Long time = Long.valueOf(Objects.requireNonNull(valueOperations.get(val))); //返回最近一个月的数据 if ((now - time) |

【本文地址】

来源:blog.csdn.net/lemon_TT/article/details/125728934

来源:blog.csdn.net/lemon_TT/article/details/125728934