网络图片爬虫(几个简单步骤实现网页图片的爬取,详细步骤,超详细,简单易懂) |

您所在的位置:网站首页 › 抓取网页图片的方法 › 网络图片爬虫(几个简单步骤实现网页图片的爬取,详细步骤,超详细,简单易懂) |

网络图片爬虫(几个简单步骤实现网页图片的爬取,详细步骤,超详细,简单易懂)

|

文章目录

网络图片爬取前提准备主要分为以下几个部分:1. 分析网页,查看索要爬取网页的源代码(按F12或者CTRL+SHIFT+C),选中你想要爬取的图片中的任意一个,下面以2. 读取网页的内容3. 获取图片的数据4.下载图片

网络图片爬取

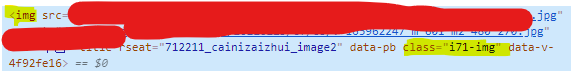

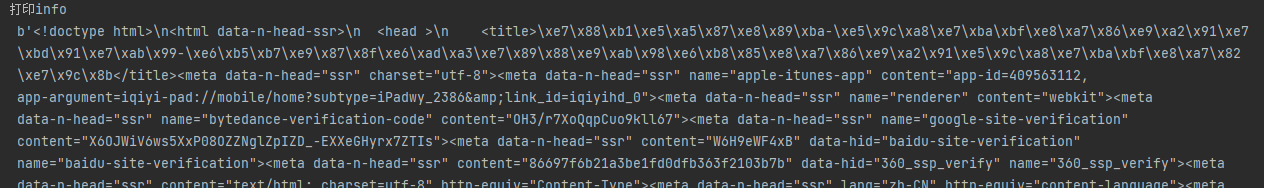

前提准备

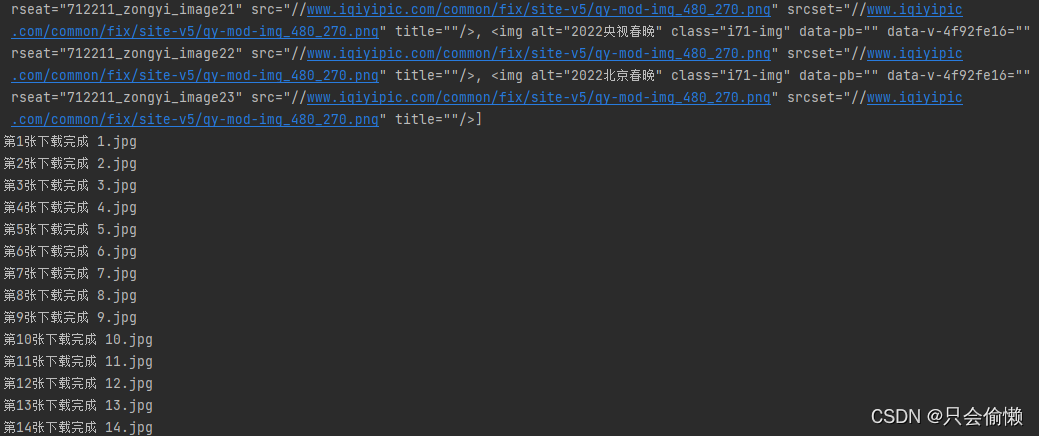

安装好开发库:Beautifulsoup4和requests,这两个库主要用于python爬虫,简单安装过程点这里开发库安装 主要分为以下几个部分: 1. 分析网页,查看索要爬取网页的源代码(按F12或者CTRL+SHIFT+C),选中你想要爬取的图片中的任意一个,下面以爱奇艺的首页为例,注意下图: 代码如下: #导入两个开发库 import urllib.request from bs4 import BeautifulSoup #定义图像的url地址(就是你想要爬取的网址) domain = 'https://www.iqiyi.com/' #在大多数网站都会有反爬取机制,所以我们这里以修改UserAgent的方式来模拟浏览器的形式来骗过该机制 req = urllib.request.Request(domain) req.add_header('Host','www.iqiyi.com') req.add_header('Referer','https://www.iqiyi.com/') req.add_header('User-Agent','fake-client') #接下来通过urllib.request的urlopen()函数来打开网页并发出请求,获得数据,再通过read()函数读取获得的数据,代码如下: html = urllib.request.urlopen(req) info = html.read() print('打印info','\n',info)#将结果打印出来,验证是否成功在此运行一下,效果如图: 能够获取到数据,基本上上边几步就算成功了 3. 获取图片的数据在第二步我们获取到了网页内的数据,那么我们就可以从获取的网页数据中筛选出我们想要的图片数据 soup = BeautifulSoup(info,'html.parser') #这里使用开发库BeautifulSoup4的一个类BeautifulSoup,来实例化我们的对象info, #让其相当于一个页面,使其HTML页面结构成为BeautifulSoup的属性, #函数的第二个参数是指定使用HTML解释器 all_img = soup.find_all('img',class_ = 'i71-img')#通过find_all()函数进行筛选,筛选条件是img标签并且表示属性class为i71-img print("打印all_img",all_img)#打印输出筛选出的图片信息 4.下载图片这里我们获取到了图片的信息,其中src属性里是图片的url地址,我们通过这个地址就可以下载图片了,下载代码如下: #使用for循环遍历all_img来定义下载后图片的名称,再使用urllib.request.urlretrieve()函数来下载图片 i=0 for img in all_img: i=i+1 image_name = '%s.jpg' % i #设置图片的保存位置,记得提前创建好文件夹,有能力的可以通过python来自动创建 urllib.request.urlretrieve('https:'+img['src'],'D:\\12345\\'+image_name) print('第%s张下载完成' %i,image_name) print('下载完成')运行结果如下 |

【本文地址】

可以看到图片标签,标识属性class,图片的url属性src(这三个接下来会用到)

可以看到图片标签,标识属性class,图片的url属性src(这三个接下来会用到)

最后查看一下你保存图片的文件夹,就可以看到爬取到的所有图片了

最后查看一下你保存图片的文件夹,就可以看到爬取到的所有图片了