大数据学习 |

您所在的位置:网站首页 › 大数据环境部署会议 › 大数据学习 |

大数据学习

|

大数据学习--平台环境部署

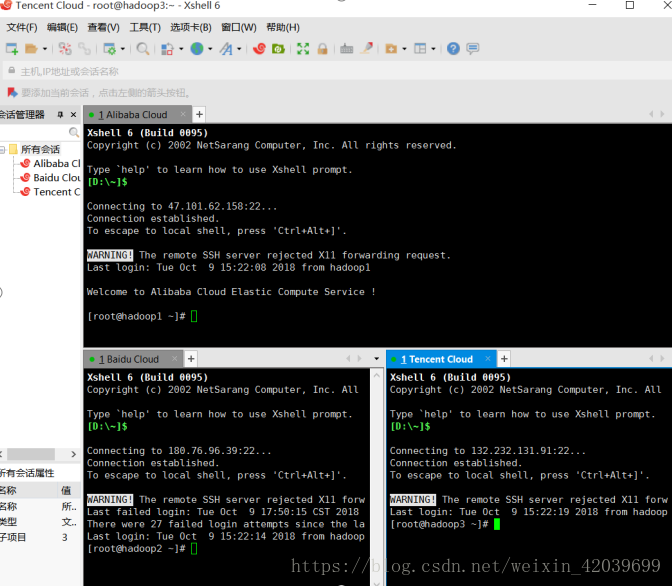

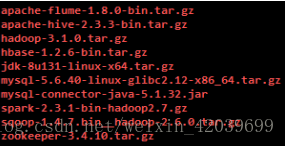

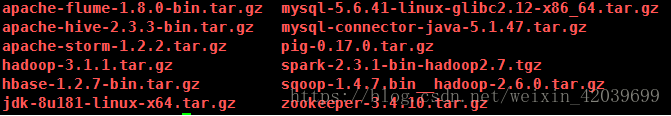

本文利用云服务器对大数据平台进行环境部署,包含:服务器使用、环境准备、Hadoop集群完全分布式安装、Zookeeper集群完全分布式安装、HBase完全分布式安装、Hive、Scala、Spark、Sqoop、Flume的安装。如有错误还望指出。 目录一、服务器使用 二、环境准备 三、Hadoop3.1.1 集群环境安装 四、Zookeeper 集群安装部署 五、Hbase 完全分布式安装 六、Hive安装 七、Scala安装 八、Spark安装 九、Sqoop安装 十、flume安装 一、服务器使用阿里云服务器,百度云服务器,腾讯云服务器。学生购买会有优惠,但只限一台机器。我用的学生优惠分别在三个平台各买了一台云主机来搭建大数据环境。 1、阿里云(centos7.3) 47.101.62.158公 172.19.46.110私 2、百度云(centos7.3) 180.76.96.39 公 192.168.0.4私 3、腾讯云(centos7.3) 132.232.131.91 公 172.27.0.13 私 4、安全组ssh端口开放 使用服务器这里是关键。服务器如果在各网页界面去操作会效率很低,用Xshell或者putty可以远程连接服务器进行操作。这样就需要设置各服务器安全组打开ssh的22端口,然后进行远程连接。 二、环境准备OS:CentOS 7.0+ 远程连接:Xshell 序号 主机 IP 主机名 用户名 密码 1 Baidu Cloud 180.76.96.39 公 192.168.0.4 私 Hadoop2 root *** 2 Alibaba Cloud 47.101.62.158 公 172.19.46.110 私 Hadoop1 root *** 3 Tencent Cloud 132.232.131.91 公 172.27.0.13 私 Hadoop3 root *** Package: Welcome to The Apache Software Foundation!(Apache官网) Index of /apache Hadoop集群安装(伪|全) https://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-3.1.1/hadoop-3.1.1.tar.gz JDK安装 Unauthorized Request 如果用wget命令下载会出问题:博客:https://blog.csdn.net/weixin_42039699/article/details/82936624 MySQL安装 https://dev.mysql.com/get/Downloads/MySQL-5.6/mysql-5.6.41-linux-glibc2.12-x86_64.tar.gz https://dev.mysql.com/get/Downloads/Connector-J/mysql-connector-java-5.1.47.tar.gz Pig安装 https://mirrors.tuna.tsinghua.edu.cn/apache/pig/pig-0.17.0/pig-0.17.0.tar.gz Hive安装 https://mirrors.tuna.tsinghua.edu.cn/apache/hive/stable-2/apache-hive-2.3.3-bin.tar.gz HBase安装 https://mirrors.tuna.tsinghua.edu.cn/apache/hbase/1.2.7/hbase-1.2.7-bin.tar.gz Zookeeper集群安装 https://mirrors.tuna.tsinghua.edu.cn/apache/zookeeper/zookeeper-3.4.10/zookeeper-3.4.10.tar.gz Sqoop安装 Apache Sqoop - Apache Attic Spark安装 https://mirrors.tuna.tsinghua.edu.cn/apache/spark/spark-2.3.1/spark-2.3.1-bin-hadoop2.7.tgz Flume安装 https://mirrors.tuna.tsinghua.edu.cn/apache/flume/stable/apache-flume-1.8.0-bin.tar.gz Storm安装 https://mirrors.tuna.tsinghua.edu.cn/apache/storm/apache-storm-1.2.2/apache-storm-1.2.2.tar.gz 三、Hadoop3.1.1 集群环境安装设备: 实验设备包括 3 台服务器(CentOS7.0+) 实验所需安装包 步骤: 1.基础环境准备 1.1 集群规划 序号 主机 IP 主机名 用户名 密码 1 Baidu Cloud 180.76.96.39 公 192.168.0.4 私 Hadoop2 root *** 2 Alibaba Cloud 47.101.62.158 公 172.19.46.110 私 Hadoop1 root *** 3 Tencent Cloud 132.232.131.91 公 172.27.0.13 私 Hadoop3 root *** 1.2 系统准备 3台服务器(CentOS7.0+) 软件安装包存放于tgz目录下: 1.3 网络配置(虚拟机配置,云服务器跳过) 为每个 Hadoop 主机配置相应的 IP 地址,每台的操作方法相同。IP 地址根据 实验环境进行配置,如果实验环境使用的是动态 IP 地址则可以跳过网络配置部分,进入下一步操作。 1.3.1 修改网络配置文件 1、首先,确保在 root 用户下进行操作。通过 vi 命令修改网络配置文件 [root@localhost ~]# vi /etc/sysconfig/network-scripts/ifcfg-eth0 2、然后按 i 键进入编辑模式,我们需要将其中的 BOOTPROTO=dhcp 改为BOOTPROTO=static 意思是设置为静态 IP,将 ONBOOT=no 改为 ONBOOT=yes 意思是将网卡设置 为开机启用,同时在文字下方添加如下内容: IPADDR= #静态 IP GATEWAY= #默认网关 NETMASK= #子网掩码 DNS1= #DNS 配置 3、修改完成以后按 Esc 键退出编辑模式,按 Shift + : 输入 wq 进行保存并退出!修改好的配置截图。 1.3.2 重启网络服务 通过 service network restart 重启网络服务,使修改的配置生效 [root@localhost ~]# service network restart 1.3.3 查看配置是否修改成功 通过 ifconfig 命令来查看当前的 IP 地址信息 通过上面的操作以后分别将三台 hadoop 主机的配置改为 : hadoop1 IP,hadoop2 IP,hadoop3 IP 1.4 关闭防火墙 三台 hadoop 主机都需要操作关闭防火墙 1、首先,输入 service iptables stop 命令停止防火墙的运行,再通过输入 chkconfig iptables off 命令关闭防火墙开机运行 2、执行命令如下: [root@localhost ~]# service iptables stop [root@localhost ~]# chkconfig iptables off 查看防火墙状态: [root@localhost ~]# service iptables status iptables: Firewall is not running. 注意: CentOS 7.0+默认使用的是firewall作为防火墙 关闭并禁止firewall开机启动: 停止 systemctl stop firewalld.service 禁止开机启动 systemctl disable firewalld.service |

【本文地址】