WWW 2023 |

您所在的位置:网站首页 › 多源数据融合和传感器管理答案 › WWW 2023 |

WWW 2023

|

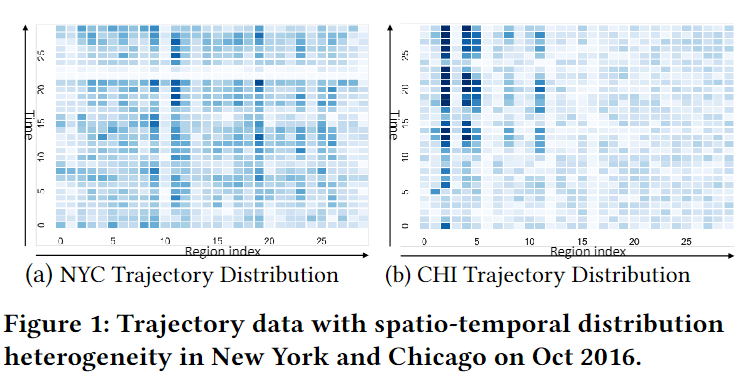

沿着这条研究线,图形神经网络(GNNs),已被用于聚合复杂关系的强大建模方案信息以及图形连接,例如 MV-PN 和 MVURE。具体来说,这些方法的灵感来自图自动编码器(GAE)和图注意力网络,通过遵循图形结构的消息传递来执行邻域特征聚合。尽管有效的现有的区域表示方法,我们确定了两个以前工作中没有很好解决的关键挑战。 数据噪声和不完整性。由于多种因素(例如,设备部署成本高,或传感器故障),数据噪声和不完整性在收集的时空数据中普遍存在。也就是说,对于基于图的表示方法,预生成的空间图通常包含噪声信息,连接区域之间的依赖性较弱。例如,由于城市中不同的区域功能,一个区域可能与其所有邻近区域都没有很强的相关性。因此,直接聚合生成的空间图上的空间和时间信息以及不太相关的区域连接将涉及下游时空挖掘应用程序(例如,犯罪预测、交通分析)的任务无关噪声信号。 时空分布异质性。当前用于区域图构建的方法中使用的时空数据(例如,人类流动性流)可能表现出跨空间和时间维度的分布异质性。这种数据分布的异质性阻碍了当前神经网络模型的表示能力,从而导致次优的区域表示性能。 为了更好地理解城市空间中不同区域的倾斜数据分布,我们在图 1 中展示了纽约市和芝加哥的人的交通轨迹分布。在这些图中,可以观察到人类轨迹数据在不同地理区域的不同分布,这给生成准确的区域图连接以反映基于移动轨迹的复杂空间相关性带来了挑战。

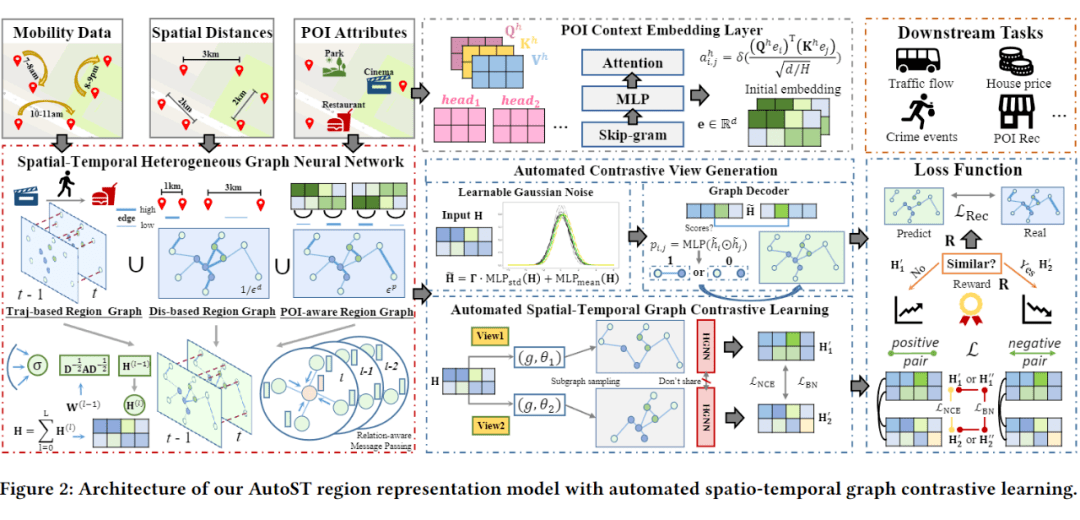

最近,一系列基于对比的自监督学习(SSL)方法在解决数据噪声和标签短缺问题方面取得了出色的性能,适用于计算机视觉中的各种任务、自然语言处理和网络嵌入。对比学习的核心思想是通过 i)缩短矢量表示空间中正例和基准例之间的距离来生成增强的 SSL 信号;ii)扩大负样本和基准样本之间的距离。 此外,时空数据分布还受到城市数据场景中异构外部因素的影响,例如区域功能、环境属性和随时间变化的交通流量。这些不同的数据集本质上以多视图展示。每个数据维度对应于视图特定的特征和语义。因此,如何将这些异构数据源有效地纳入区域表示框架并融合来自不同观点的知识,仍然是一个重大挑战。 鉴于上述动机和挑战,我们提出了一种 Automated Spatio- T时间图对比学习(AutoST)范式,以提供具有多视图的有效且稳健的区域表示城市感知场景中的时空数据。具体来说,首先引入时空异构图神经编码器,通过从视图内和视图间数据相关性中捕获区域相关性来对时空模式进行建模。在我们的自我监督学习范例中,编码的多视图区域嵌入将作为我们的增强模式的指导,以自动提取城市空间中所有区域的异构依赖关系。 图对比学习组件不仅增强了隐式跨区域关系的学习过程,而且在以自适应方式有效结合辅助自监督信号方面也发挥着重要作用。从概念上讲 AutoST 优于现有的图形对比学习方法,可以自动发现有用的时空 SSL 信号以实现更有效的数据扩充。当前的一些方法直接利用随机掩码操作,这可能会丢失一些有用的图连接并且仍然容易受到噪声扰动。 总的来说,本文主要做出了以下贡献: 我们强调共同应对的重要性, 解决数据噪声和分布异质性挑战时空图学习任务。 我们设计时空异构图神经网络同时捕获内部视图并通过各种建模来查看区域依赖性时空因素。为了解决数据噪声和分布化多样性问题,我们进行时空对比学习自动化数据的区域依赖图增强。 我们在不同的环境中验证我们的 AutoST时空挖掘任务,通过与不同区域竞争表示和图形神经网络基线。我们强调共同应对的重要性, 解决数据噪声和分布异质性挑战时空图学习任务。 我们设计时空异构图神经网络同时捕获内部视图并通过各种建模来查看区域依赖性时空因素。为了解决数据噪声和分布化多样性问题,我们进行时空对比学习自动化数据的区域依赖图增强。 模型介绍 本章介绍所提出的 AutoST 模型,主要包括时空异构图神经网络,自动化图增强模块和自动时空图对比学习模块,模型整体框架如下图所示。

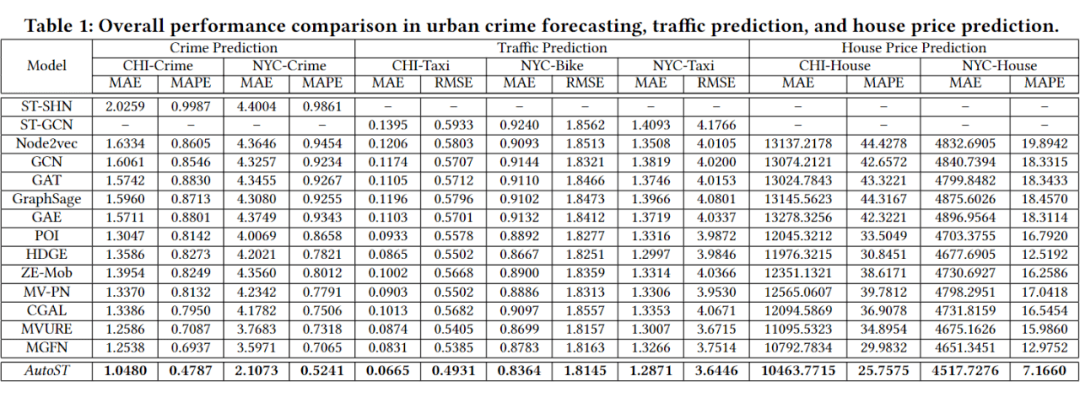

2.1 时空异构图神经网络 为了从不同的视角抓取区域之间的动态信息,比如交通流,还有空间关系,我们提出了异构时空图神经网络。除了抓取区域之间的关系, 我们还抓取了每一个区域针对不同视角的内部关系。 我们异构时空图有 3 个子图构成,POI 视角的区域关系子图,交通流量的区域关系子图和距离区域关系的子图。我们的异构图的关系分为 5 种, 一种是通过区域包含的 POI 的相似度的关系,一种是通过区域之间的交通流构成的关系,一种是通过区域之间的距离来约束的一种关系,一种 POI 视图和交通流视图之间的关系,还有一种是交通流视图和距离视图之间的关系。我们使用异构图神经网络来抓取异构图的信息通过不同种类关系的消息传递。 2.2 自动化图增强 为了基于异构时空图进行有效的自监督信号,我们提出对异构时空图进行去除噪音边的自监督任务。使这一过程可学习且自适应的关键,在于找出图中的噪音边,然后去掉噪音边的图用于训练。 我们的 AutoST 采用变分图自动编码器(VGAE)带有随机游走算法进行自动化图增强,因为 VGAE 在考虑重建数据分布方面的优势。VGAE 是图形流形中定义明确的随机函数,可以很好地捕获图形分布。首先,VGAE 模块学习编码映射 以捕获低维节点嵌入中的层次图结构。然后,AutoST 通过向低维图形表示(即编码节点嵌入)添加高斯噪声,在原始图形空间中生成对比视图。 2.3 自动时空图对比学习 使用生成的图结构表示,AutoST 然后通过元素乘积和 MLP 计算采样分数关于每个节点对的生成视图。形式上,对于索引为 i 和 j 的节点,采样分数, 所有节点对的概率得分组成一个采样矩阵。接下来,AutoST 对该矩阵进行稀疏化处理,以获得描述生成的图视图的图结构的二进制邻接矩阵。 为了有效地进行图对比学习,我们在解码图上应用随机游走算法以生成具有较少节点和边的子图作为对比视图。具体来说,对于双视图生成,AutoST 使用两个具有相同架构但非共享参数的 VGAE 模块,针对两个不同的对比视图。解码器生成两个图,随机游走器基于这两个图使用同一组种子节点生成子图。 形式上,增强的多视图用于两个自适应对比表示视图。与最近使用随机增强运算符(例如,边扰动、边掩蔽和节点删除的图对比学习模型不同,我们使用可学习的区域依赖性来增强时空图学习。因此,AutoST 通过自适应地提供辅助 SSL 信号来增强区域表示的稳健性。 2.4 模型优化 本文同时优化 2 个目标,其中 1 种自监督任务优化目标包括:最大化节点与子图表征互信息。此外,AutoST 还进行了最大两个生成子图的互信息,以及参数衰减的正则化。 实验结果 我们在 crime prediction task , traffic predition task 和 house price prediction 三个任务上进行了对比实验,总体实验效果如下所示,本文的 AutoST 在三个数据集上均取得了显著优于基线方法的效果。且相对于其他方法,AutoST 取得了显著的进一步效果提升,这验证了自动化数据增强方式带来的收益。同时,在不同稀疏度的子数据集上,AutoST 的推荐效果保持了相对基线方法的优势。

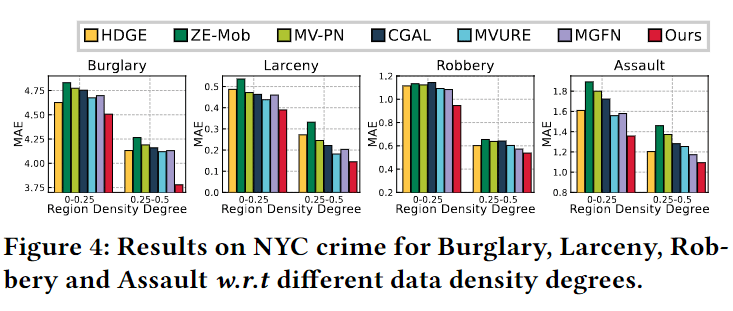

本文还进行实验来研究 AutoST 对数据稀疏性的稳健性。为了实现这一目标,本文分别评估不同密度程度区域的预测精度。这里,每个区域的密集程度是通过区域特定的犯罪发生序列中非零元素(犯罪发生)的比例来估计的。具体来说,我们将犯罪密度度小于 0.5 的稀疏区域分为两组,即(0.0, 0.25] 和(0.25, 0.5]。 评估结果如图 Figure4。我们观察到 AutoST 始终优于其他方法。因此,该实验再次证明时空区域表示学习极大地受益于自监督信号,以提供准确和稳健的犯罪预测具有不同犯罪密度程度的案例。

此外,我们随机选取一些区域进行样例学习,来展示 AutoST 在学习关于地理语义的全局区域依赖性方面的能力。具体来说,我们采样两个区域对,即 1)附近区域:(region-15, region-31);2)遥远的区域:(region-1,region-158)。 从呈现的图 Figure3 来看,虽然 region-15 和 region-31 在空间上彼此相邻,但它们表现出不同的城市功能。然而,它们通过基线 MGFN 学习的表示向量显示出很高的相似性。相反,表示向量的多样性可以在 AutoST 方法学习的区域表示向量中观察到。总的来说,这些观察表明 AutoST 在捕获整个城市空间中的全局区域依赖性方面的优势。 总结 本文提出了一种新的区域表示学习方法,该方法具有自动时空图对比学习范式。本文探索了时空图的自适应自监督学习,并确定了当前区域表示模型面临的关键问题。本文的工作表明,基于自动对比学习的数据增强可以为多视图时空数据的区域图表示学习提供巨大的潜力。我们使用几个真实数据集对三个时空挖掘任务进行了广泛的实验,以验证 AutoST 在各种设置中的优势。 更多阅读 # 投 稿 通 道# 让你的文字被更多人看到 如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢? 答案就是:你不认识的人。 总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。 PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是 最新论文解读,也可以是 学术热点剖析、 科研心得或 竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。 📝 稿件基本要求: • 文章确系个人 原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注 • 稿件建议以 markdown格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题 • PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供 业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算 📬 投稿通道: • 投稿邮箱:[email protected] • 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者 • 您也可以直接添加小编微信( pwbot02)快速投稿,备注:姓名-投稿 🔍 现在,在 「知乎」也能找到我们了 进入知乎首页搜索 「PaperWeekly」 · · 返回搜狐,查看更多 |

【本文地址】

今日新闻 |

推荐新闻 |