模型评估指标总结(预测指标、分类指标、回归指标) |

您所在的位置:网站首页 › 公共关系评估指标 › 模型评估指标总结(预测指标、分类指标、回归指标) |

模型评估指标总结(预测指标、分类指标、回归指标)

|

文章目录

一、预测问题评价指标均方误差(MSE)均方根误差(RMSE)平均绝对误差(MAE)平均绝对百分比误差(MAPE)对称平均绝对百分比误差(SMAPE)均方对数误差(MSLE)中位绝对误差(MedAE)以上7种预测评价指标如何选用?

二、分类问题评价指标2.1单项分类问题指标准确率(Accuracy)精确率/查准率(Precision)召回率/查全率(Recall)

2.2综合分类问题指标F1分数(F1 score)PR曲线ROC曲线AUC曲线

为什么常用ROC曲线作为分类评价指标

三、回归问题评价指标MAEMSERMSE三者的比较

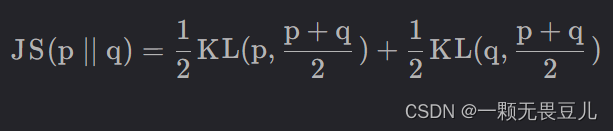

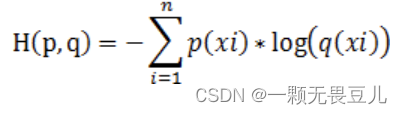

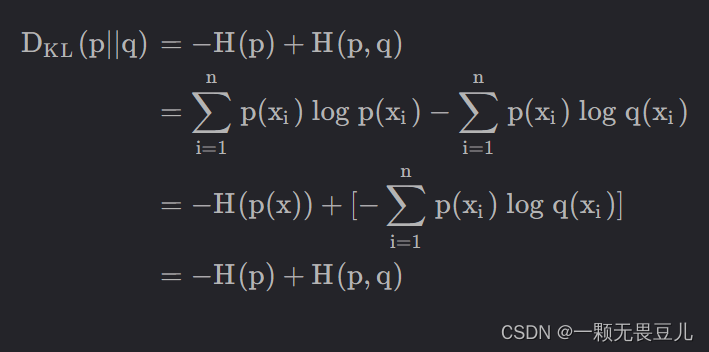

四、常用损失4.1交叉熵损失(Cross Entropy)4.1.1信息熵4.1.2KL散度4.1.3JS散度4.1.4交叉熵4.1.5KL散度、信息熵、交叉熵三者的关系

4.2均方误差损失(MSE)

五、鲁棒性与泛化性

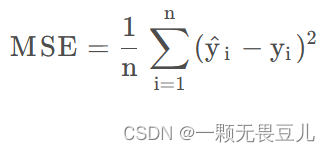

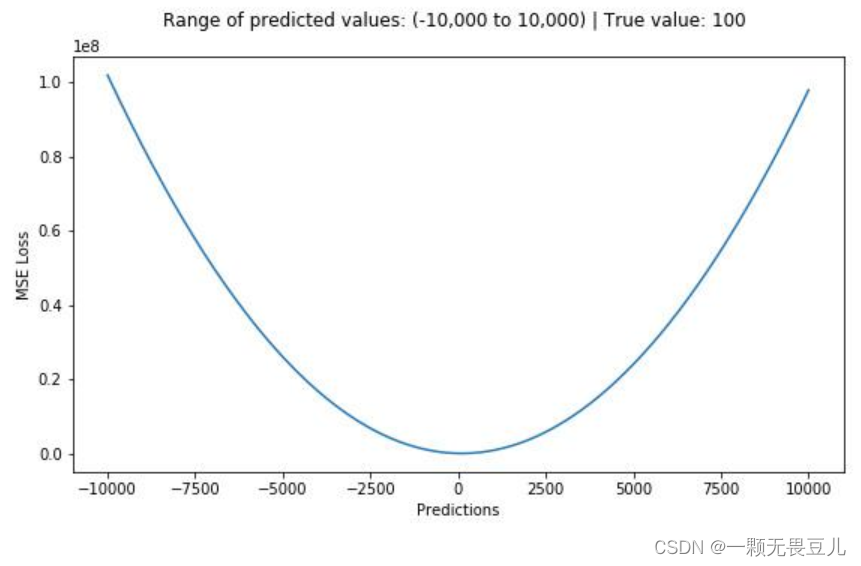

均方误差(Mean Square Error)简称MSE,公式如下:

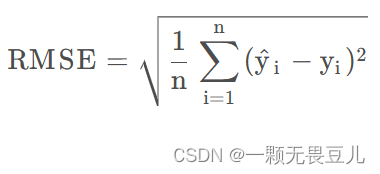

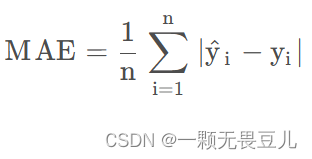

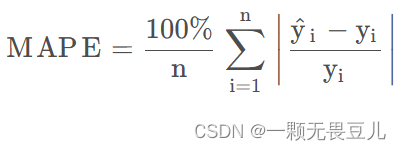

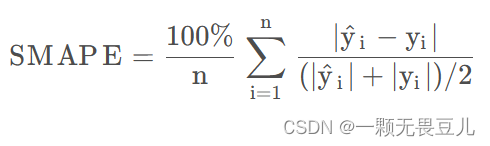

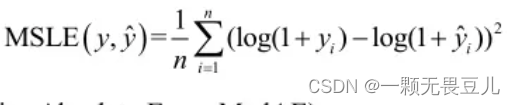

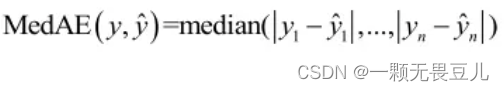

均方根误差(Root Mean Square Error)简称RMSE,公式如下: 平均绝对误差(Mean Absolute Error),简称MAE,公式如下: 平均绝对百分比误差(Mean Absolute Percentage Error),简称MAPE,公式如下: 对称平均绝对百分比误差(Symmetric Mean Absolute Percentage Error)简称SMAPE,公式如下: 均方对数误差(Mean Squared Log Error),简称MSLE,公式如下: 中位绝对误差(Median Absolute Error)简称MedAE,公式如下: 1.单个指标选用: 当看重真实值和预测值间的差的平方时,选用MSE或RMSE当看重真实值和预测值间的绝对值误差时,选用MAE或MedAE,两者分别是误差的均值和中位数,MAE对极端值比较敏感当看重真实值的数据中存在量级差,或不同样本的真实值存在量级差,而且更加关注真实值和预测值的百分比差异时,选用MAPE或SMAPE当y具有随着x进行指数变动的趋势时,选用MSLE2.多个指标搭配使用 RMSE与MAE联合使用,可以看出样本误差的离散程度,若RMSE远大于MAE,则可以知道不同样本的误差差别很大MAE与MAPE,再结合“y八”(即y一横,y平均),可以估算不同数量级样例的拟合程度,若MAE远大于MAPE*(y平均),则可能是模型对真实值小的样本预测更准,此时就可以考虑为不同数量级的样本建立不同的模型。 二、分类问题评价指标 2.1单项分类问题指标

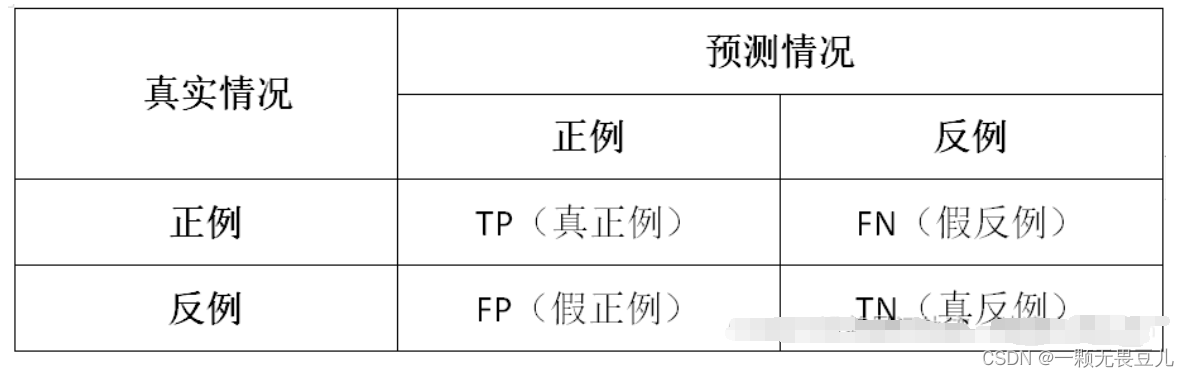

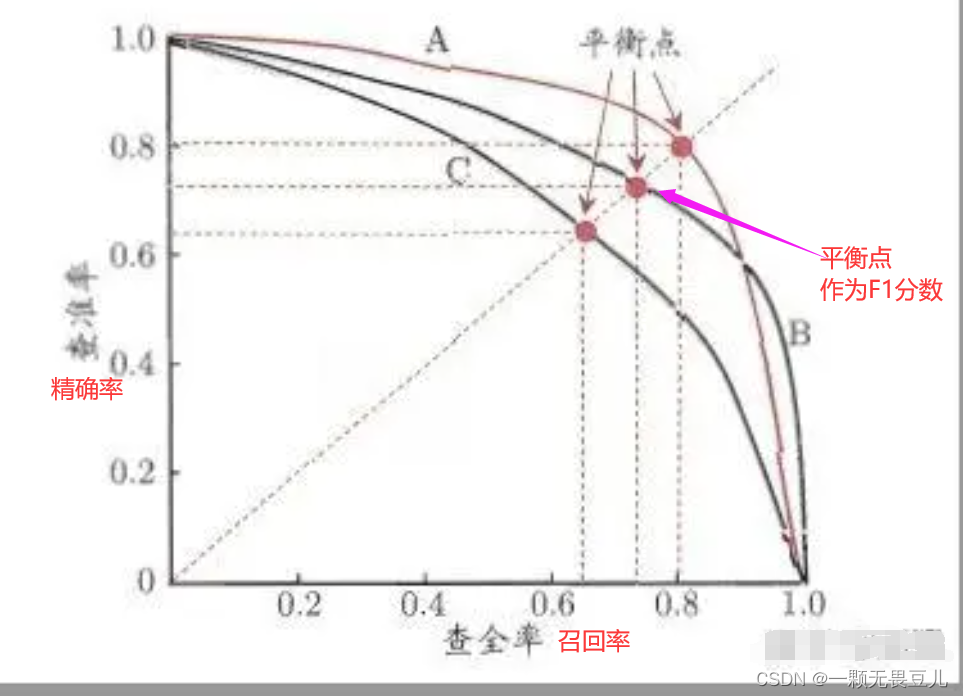

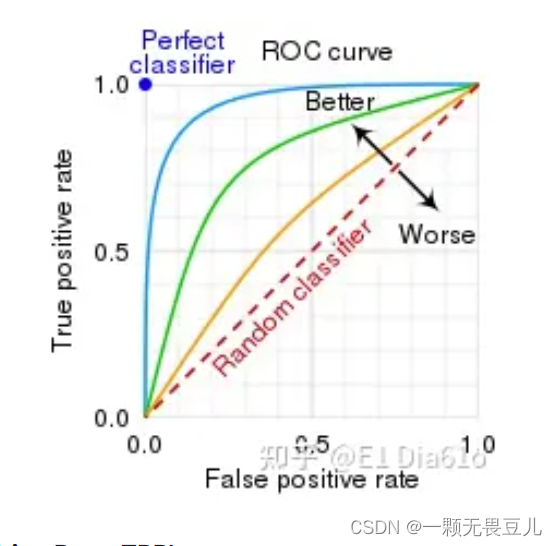

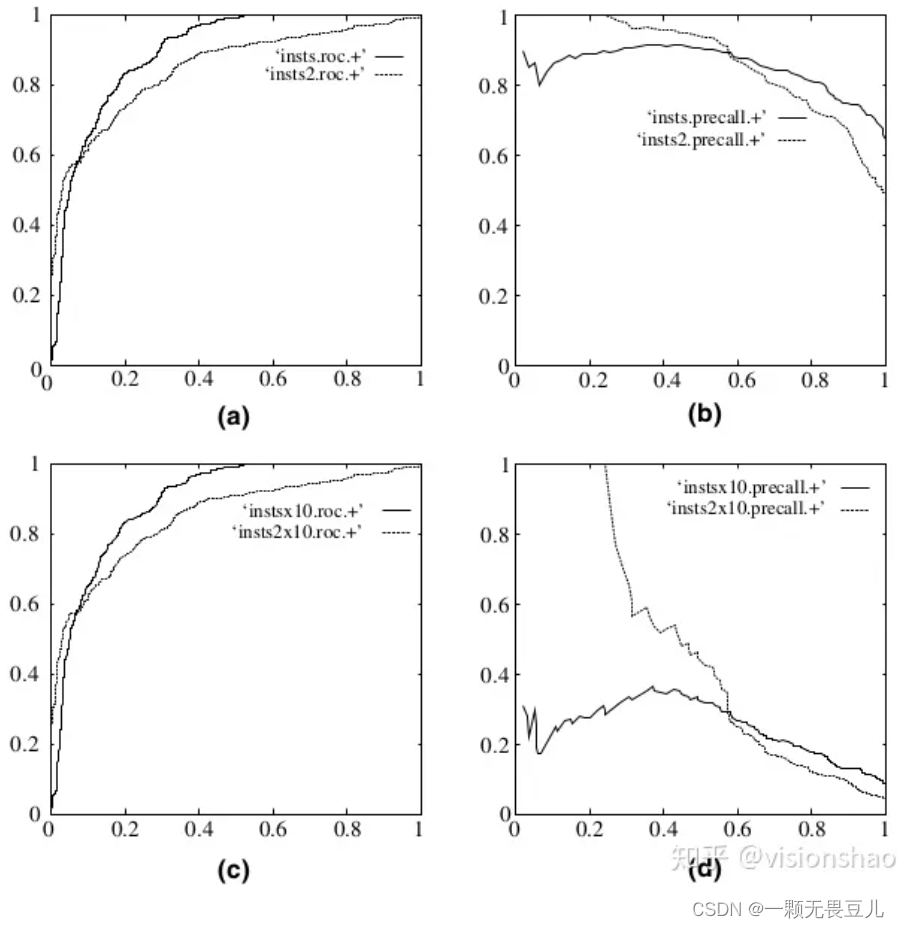

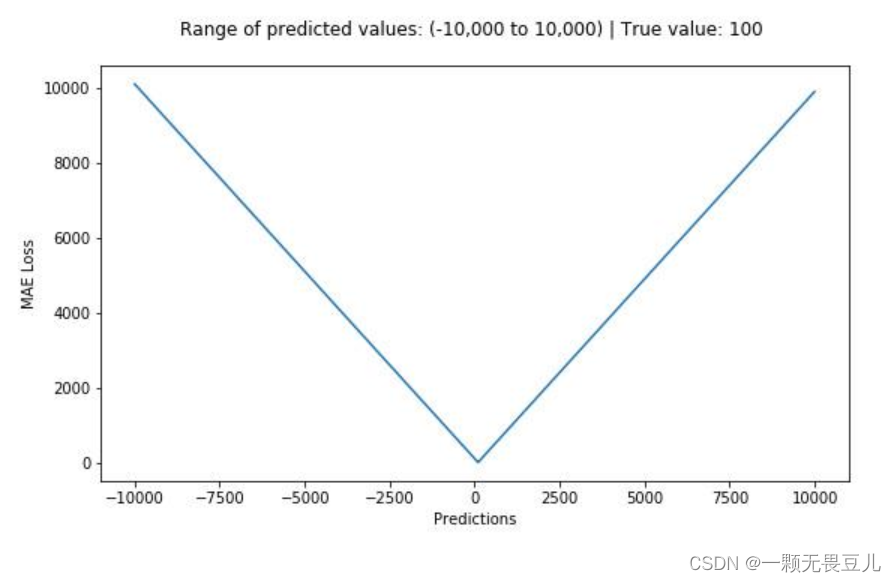

准确率是指预测正确的结果占总样本的百分比,公式如下: Acc=(TP+TN)/(TP+TN+FP+FN) 注意:当样本不平衡时,准确率不适合作为衡量指标,即样本不平衡时,准确率就会失效。如:一个总样本中,正样本占90%,负样本占10%,样本是严重不平衡的,此时我们只需要将全部样本预测为正样本就可得到90%的高准确率,但实际我们并没有很用心的分类,只是随便无脑一分而已。 精确率/查准率(Precision)精确率/查准率是指所有被预测为正的样本中实际为正的样本的概率(不准错,宁愿漏检,也不能让现有的预测有错),公式如下: Pre=TP/(TP+FP) 召回率/查全率(Recall)召回率/查全率是指实际为正的样本中被预测为正样本的概率(不准漏,宁可错杀一千,也不放过一个),公式如下: Recall=TP/(TP+FN) 2.2综合分类问题指标 F1分数(F1 score)F1分数是精确率和召回率的博弈,公式如下。精确率和召回率是相互制约的关系,即当精确率过高,召回率就会偏小当召回率过高,精确率就会偏小,其关系如下图2.2,当然,我们希望我们的模型精确率越高越好,召回率越高越好,但两者是矛盾的,所以我们选取一个点,一个两者间的平衡作为F1分数。 F1 score=(2×Precision×Recall)/(Precision+Recall) PR曲线是指以召回率为横坐标,精确率为纵坐标,如图2.2.1,AP是PR曲线与X轴、Y轴围成的面积,AP=1时的模型性能最好,AP越接近1越好,最小也得大于0.5。 ROC曲线是指以假阳性率FPR为横坐标,真阳性率TPR为纵坐标,如图2.2.2。 假阳性率FPR:是指所有实际为负例的样本中,模型错误的预测为正例的样本比例,可以理解为所有阴性群体中被检测出来阳性的比率(误诊率),FPR越接近0越好,公式如下: FPR=FP/(FP+TN)妥善设定阈值的话,能有预测价值。AUC = 0.5,跟随机猜测一样(例:丢铜板),模型没有预测价值。AUC < 0.5,比随机猜测还差;但只要总是反预测而行,就优于随机猜测。 为什么常用ROC曲线作为分类评价指标因为ROC曲线有个很好的特性:当测试集中的正负样本的分布变化的时候,ROC曲线能够保持不变。在实际的数据集中经常会出现类不平衡(class imbalance)现象,即负样本比正样本多很多(或者相反),而且测试数据中的正负样本的分布也可能随着时间变化,用ROC作为衡量分类情况,更加稳定。下图是ROC曲线和Precision-Recall曲线的对比: 平均绝对误差(Mean Absolute Error),简称MAE,公式如下: 均方误差(Mean Square Error)简称MSE,公式如下:

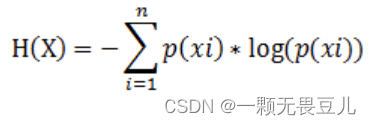

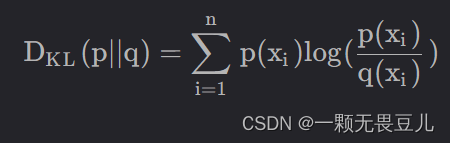

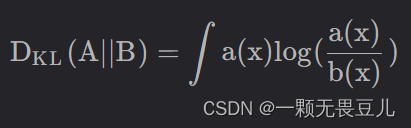

均方根误差(Root Mean Square Error)简称RMSE,公式如下: 所以,如何选择MAE、MSE、RMSE: 若异常点代表在商业中很重要的异常情况,并且需要被检测出来,则选用MSE;若只把异常值当作受损数据,则选用MAE 处理异常点时,MAE损失函数更稳定,但它的导数不连续,因此求解效率较低。MSE损失函数对异常点更敏感,但通过令其导数为0,可以得到更稳定的封闭解。 四、常用损失交叉熵损失与均值平方差损失是机器学习中常用的求损失函数的方式,其中交叉熵损失(Cross Entropy)一般针对的是分类问题,而均值平方差损失(MSE)主要针对的是回归问题。 4.1交叉熵损失(Cross Entropy)交叉熵损失是KL散度的简化,在了解交叉熵之前,需要对信息论中熵的含义有基本的了解。 4.1.1信息熵熵:是关于不确定性的描述,指的是整个系统内部样本之间的距离,或称之为系统内样本分布的集中程度、分散程度和混乱程度。 系统内样本越分散,信息熵就越大;分布越有序,信息熵就越小。 信息的大小和随机事件的概率有关,概率越小的事件发生,信息量就越大;概率越大的事件发生,信息量就越小,所以信息的度量应依赖于概率分布p(x)。 假设一离散型数据X=(x0,x1,x2),对应的概率为p(xi)。其中每个事件的信息量为: I(xi)=−log(p(xi)),根据熵的定义可得: KL散度用于衡量两个概率分布之间的差异,值越小,表示两个分布就越接近。 公式如下: 离散形式: JS散度用于衡量两个概率分布的差异度,是KL散度的变体。 公式如下: 交叉熵常作为多分类问题的损失函数,用来作为预测值和真实值的距离度量。 给定两个概率分布p,q,p(x)表示正确分布,即真实值的分布,q(x)表示预测分布,即预测值的分布。

均方误差(Mean Square Error)简称MSE,公式如下: 鲁棒性:指的是模型对于输入数据的健壮性,即模型在遇到各种不同的数据输入时,仍然能够保持高效的表现。一个鲁棒性强的模型能够在噪声、缺失数据或者其他异常情况下也能够准确地预测结果。 泛化性:则是指模型对于新数据的适应能力,即模型能否对于未在训练集中出现的数据进行准确的预测。一个具有很强泛化性的模型能够在不同的数据集上都表现出色,而不仅仅是在训练集上表现好。 通俗点说,鲁棒性关注的是模型对于已知情况的适应能力,而泛化性则关注的是模型对于未知情况的适应能力。深度学习中的目标是构建既有鲁棒性又有泛化性的模型,即能够在多种情况下都能够高效准确预测结果的模型。 https://blog.csdn.net/weixin_44912902/article/details/130168215 (常总结,常复盘,如有问题,欢迎指出、欢迎讨论!!!) |

【本文地址】

今日新闻 |

推荐新闻 |

其中y_i表示真实值,比如模型的真实,比如模型的label;“y_i尖”是预测值,如常用的y_pred。 MSE的范围:[0,+∞),预测值和真实值完全吻合时,MSE=0,即完美模型(实际模型训练中,基本不会出现的啦!!!);误差越大,MSE该值越大。 (目前没有时间学习latex公式啊,等我学会了,再更新下,重新敲啊,大家饶过我吧,哈哈)

其中y_i表示真实值,比如模型的真实,比如模型的label;“y_i尖”是预测值,如常用的y_pred。 MSE的范围:[0,+∞),预测值和真实值完全吻合时,MSE=0,即完美模型(实际模型训练中,基本不会出现的啦!!!);误差越大,MSE该值越大。 (目前没有时间学习latex公式啊,等我学会了,再更新下,重新敲啊,大家饶过我吧,哈哈) 其实就是MSE开根号得到的,已经有MSE了,为啥还定义一个开根号版本(RMSE)呢?据解释说这样数量级上比较直观。 RMSE的范围:[0,+∞),预测值和真实值完全吻合时,RMSE=0,即完美模型;误差越大,RMSE值越大。

其实就是MSE开根号得到的,已经有MSE了,为啥还定义一个开根号版本(RMSE)呢?据解释说这样数量级上比较直观。 RMSE的范围:[0,+∞),预测值和真实值完全吻合时,RMSE=0,即完美模型;误差越大,RMSE值越大。 MAE的范围:[0,+∞),预测值和真实值完全吻合时,MAE=0,即完美模型;误差越大,MAE值越大。 MAE对极端值比较敏感,当没有MSE敏感。

MAE的范围:[0,+∞),预测值和真实值完全吻合时,MAE=0,即完美模型;误差越大,MAE值越大。 MAE对极端值比较敏感,当没有MSE敏感。 和MAE很像,就是MAE除了一个分母。 MAPE的范围:[0,+∞),预测值和真实值完全吻合时,MAPE=0,即完美模型;误差越大,MAPE值越大。 注意:当真实值y_i中存在数据等于0时,该公式不可用,因分母不能为0

和MAE很像,就是MAE除了一个分母。 MAPE的范围:[0,+∞),预测值和真实值完全吻合时,MAPE=0,即完美模型;误差越大,MAPE值越大。 注意:当真实值y_i中存在数据等于0时,该公式不可用,因分母不能为0 和MAE和MAPE都很像,首先,是在MAE的基础上除以了一个分母,其次,MAPE除以的分母不同罢了 注意:当真实值y_i中有数据为0,且预测值“y_i尖”中也有数据为0时,该公式不可用,存在分母为0问题。

和MAE和MAPE都很像,首先,是在MAE的基础上除以了一个分母,其次,MAPE除以的分母不同罢了 注意:当真实值y_i中有数据为0,且预测值“y_i尖”中也有数据为0时,该公式不可用,存在分母为0问题。

在上图中,(a)和©为ROC曲线,(b)和(d)为PR曲线。(a)和(b)展示的是分类其在原始测试集(正负样本分布平衡)的结果,©和(d)是将测试集中负样本的数量增加到原来的10倍后,分类器的结果。可以明显的看出,ROC曲线基本保持原貌,而PR曲线则变化较大。

在上图中,(a)和©为ROC曲线,(b)和(d)为PR曲线。(a)和(b)展示的是分类其在原始测试集(正负样本分布平衡)的结果,©和(d)是将测试集中负样本的数量增加到原来的10倍后,分类器的结果。可以明显的看出,ROC曲线基本保持原貌,而PR曲线则变化较大。

分析上式:

分析上式: 连续形式:

连续形式:  特点:

特点:

KL散度=信息熵+交叉熵 交叉熵损失常用于分类问题,而且离散的变量,具体是为啥呢? 因为目标是训练模型使得模型拟合的分布与数据的真实分布差异尽可能小,便想到KL散度 数据集的真实值是确定的,即信息熵H§是确定的常数,因此最小化交叉熵即可。

KL散度=信息熵+交叉熵 交叉熵损失常用于分类问题,而且离散的变量,具体是为啥呢? 因为目标是训练模型使得模型拟合的分布与数据的真实分布差异尽可能小,便想到KL散度 数据集的真实值是确定的,即信息熵H§是确定的常数,因此最小化交叉熵即可。