让天下没有难Tuning的大模型:PEFT技术简介 |

您所在的位置:网站首页 › 全站仪主要技术参数 › 让天下没有难Tuning的大模型:PEFT技术简介 |

让天下没有难Tuning的大模型:PEFT技术简介

|

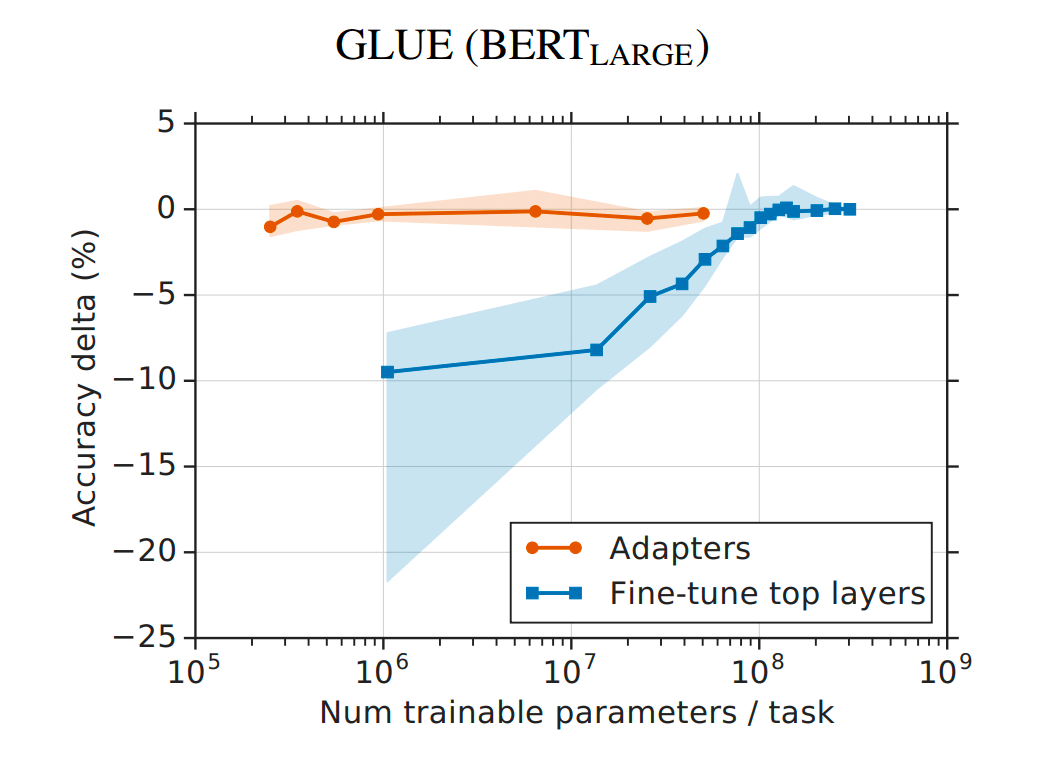

从实验结果来看,该方法能够在只额外对增加的 3.6% 参数规模(相比原来预训练模型的参数量)的情况下取得和 Full-finetuning 接近的效果(GLUE 指标在 0.4% 以内)。

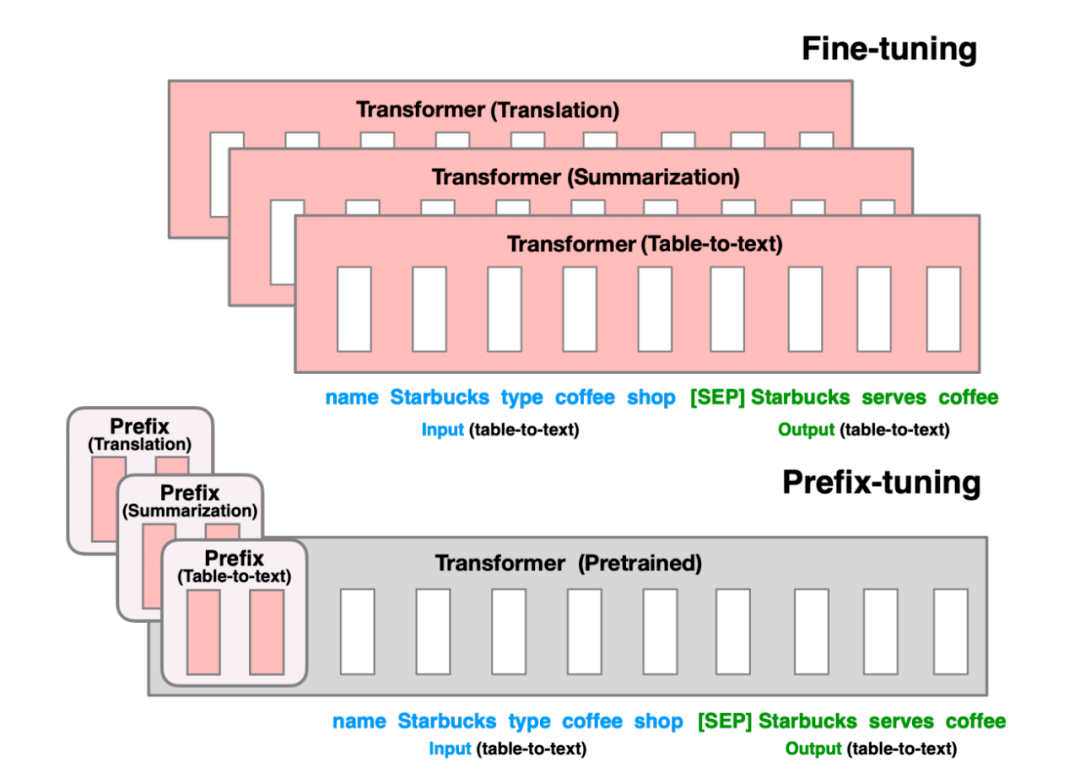

Prefix Tuning

Prefix Tuning 方法由斯坦福的研究人员提出,与 Full-finetuning 更新所有参数的方式不同,该方法是在输入 token 之前构造一段任务相关的 virtual tokens 作为 Prefix,然后训练的时候只更新 Prefix 部分的参数,而 Transformer 中的其他部分参数固定。该方法其实和构造 Prompt 类似,只是 Prompt 是人为构造的“显式”的提示,并且无法更新参数,而 Prefix 则是可以学习的“隐式”的提示。 同时,为了防止直接更新 Prefix 的参数导致训练不稳定的情况,他们在 Prefix 层前面加了 MLP 结构(相当于将 Prefix 分解为更小维度的 Input 与 MLP 的组合后输出的结果),训练完成后,只保留 Prefix 的参数。 实验结果也说明了 Prefix Tuning 的方式可以取得不错的效果。

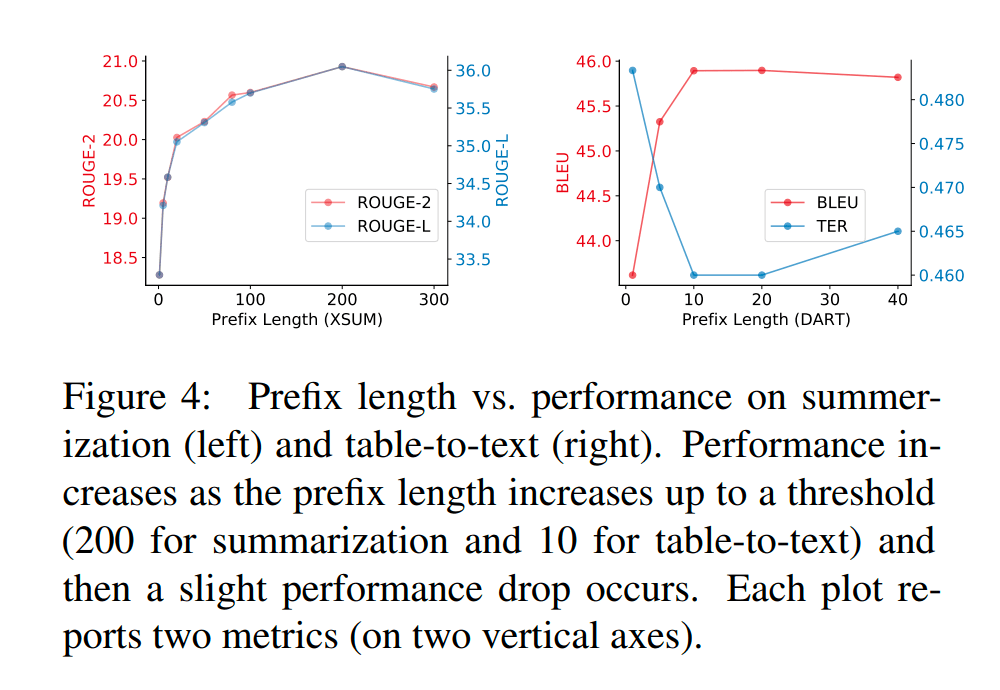

除此之外,作者还做了一系列的消融实验说明该方法的有效性: 1. Prefix 长度的影响:不同的任务所需要的 Prefix 的长度有差异。

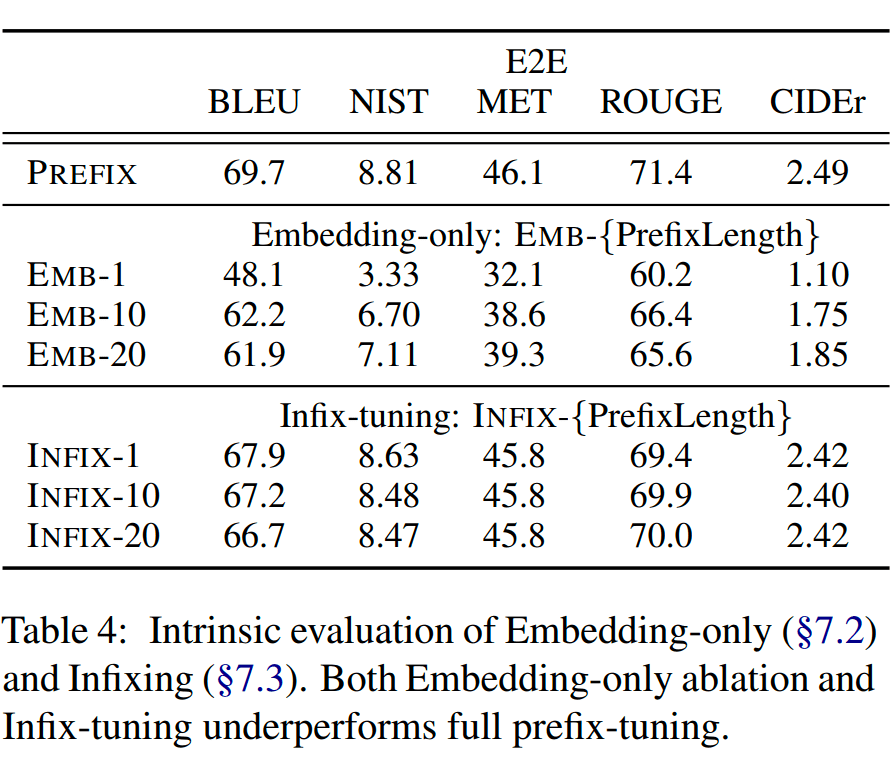

2. Full vs Embedding-only:作者对比了 Embedding-only(只有最上层输入处的 Embedding 作为参数更新,后续的参数固定)和 Full(每一层的 Prefix 相关的参数都训练)的方式的效果。 3. Prefixing vs Infixing:对比了 [PREFIX; x; y] 方式与 [x; INFIX; y] 方式的差异,还是 Prefix 方式最好。

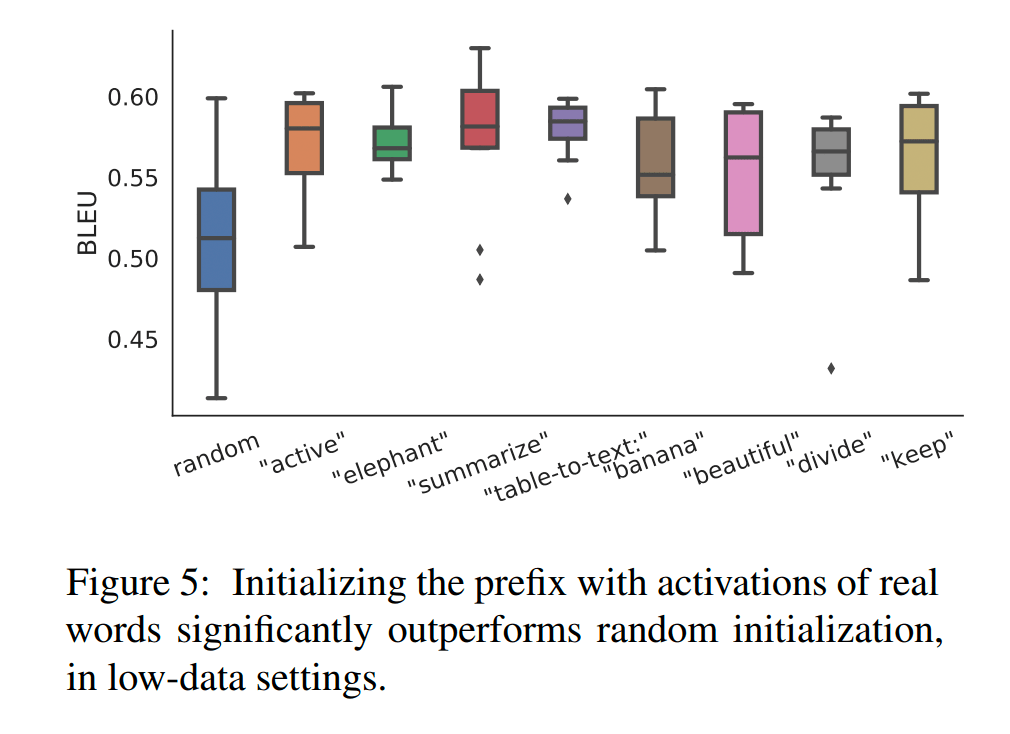

4. Initialization: 用任务相关的 Prompt 去初始化 Prefix 能取得更好的效果。

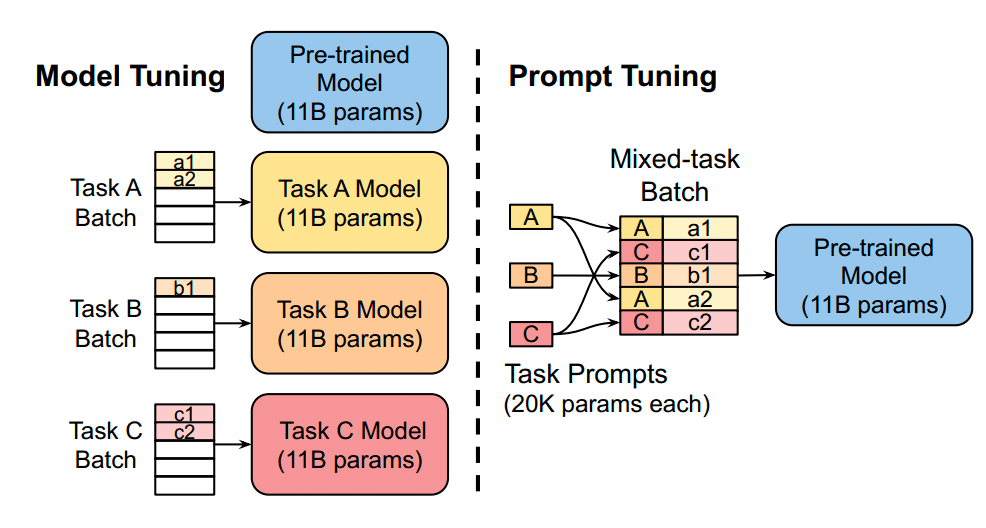

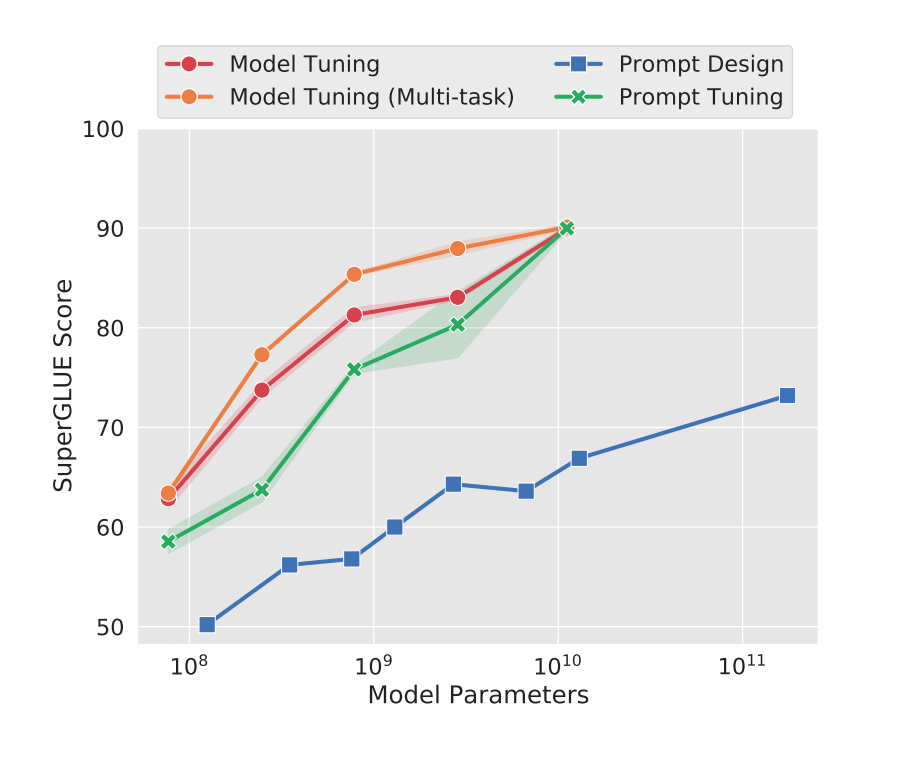

Prompt Tuning 论文《The Power of Scale for Parameter-Efficient Prompt Tuning》 我给这篇文章取了个新名字:Scale is All You Need,总的来说就是,只要模型规模够大,简单加入 Prompt tokens 进行微调,就能取得很好的效果。 该方法可以看作是 Prefix Tuning 的简化版本,只在输入层加入 prompt tokens,并不需要加入 MLP 进行调整来解决难训练的问题,主要在 T5 预训练模型上做实验。似乎只要预训练模型足够强大,其他的一切都不是问题。作者也做实验说明随着预训练模型参数量的增加,Prompt Tuning 的方法会逼近 Fine-tune 的结果。

3.1 实验

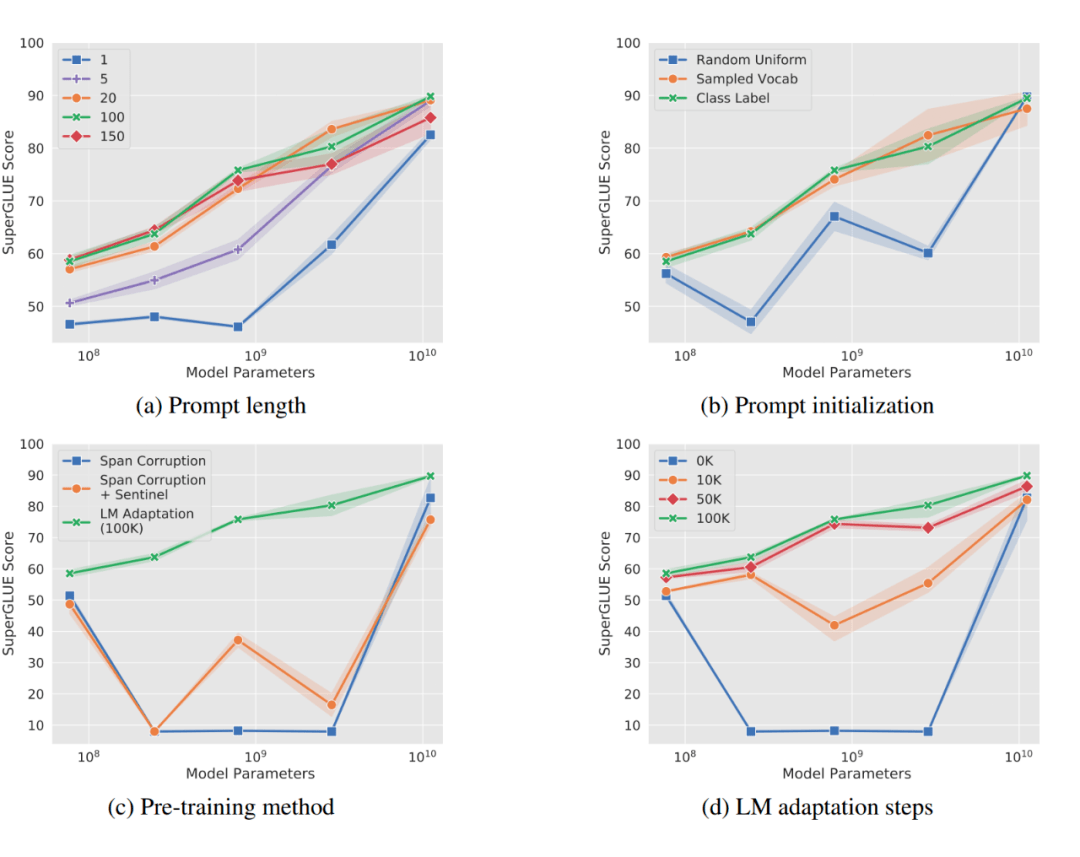

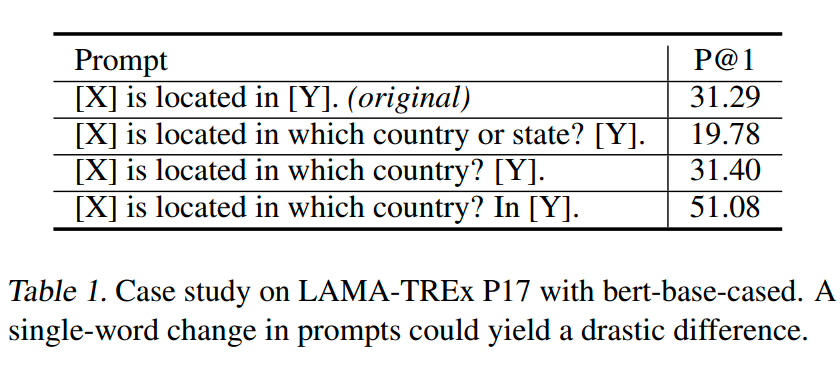

作者做了一系列对比实验,都在说明:随着预训练模型参数的增加,一切的问题都不是问题,最简单的设置也能达到极好的效果。 a)Prompt 长度影响:模型参数达到一定量级时,Prompt 长度为 1 也能达到不错的效果,Prompt 长度为 20 就能达到极好效果。 b)Prompt 初始化方式影响:Random Uniform 方式明显弱于其他两种,但是当模型参数达到一定量级,这种差异也不复存在。 c)预训练的方式:LM Adaptation 的方式效果好,但是当模型达到一定规模,差异又几乎没有了。 d)微调步数影响:模型参数较小时,步数越多,效果越好。同样随着模型参数达到一定规模,zero shot 也能取得不错效果。a)Prompt 长度影响:模型参数达到一定量级时,Prompt 长度为 1 也能达到不错的效果,Prompt 长度为 20 就能达到极好效果。 b)Prompt 初始化方式影响:Random Uniform 方式明显弱于其他两种,但是当模型参数达到一定量级,这种差异也不复存在。 c)预训练的方式:LM Adaptation 的方式效果好,但是当模型达到一定规模,差异又几乎没有了。 P-Tuning 4.1 V1 P-Tuning 方法的提出主要是为了解决这样一个问题:大模型的 Prompt 构造方式严重影响下游任务的效果。

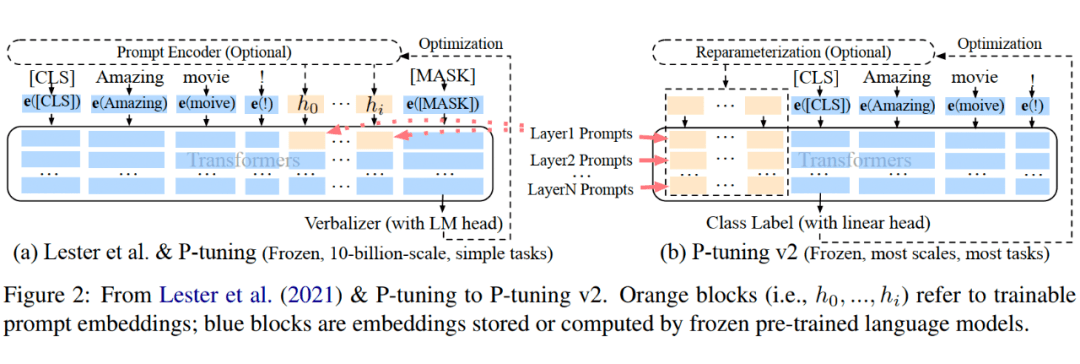

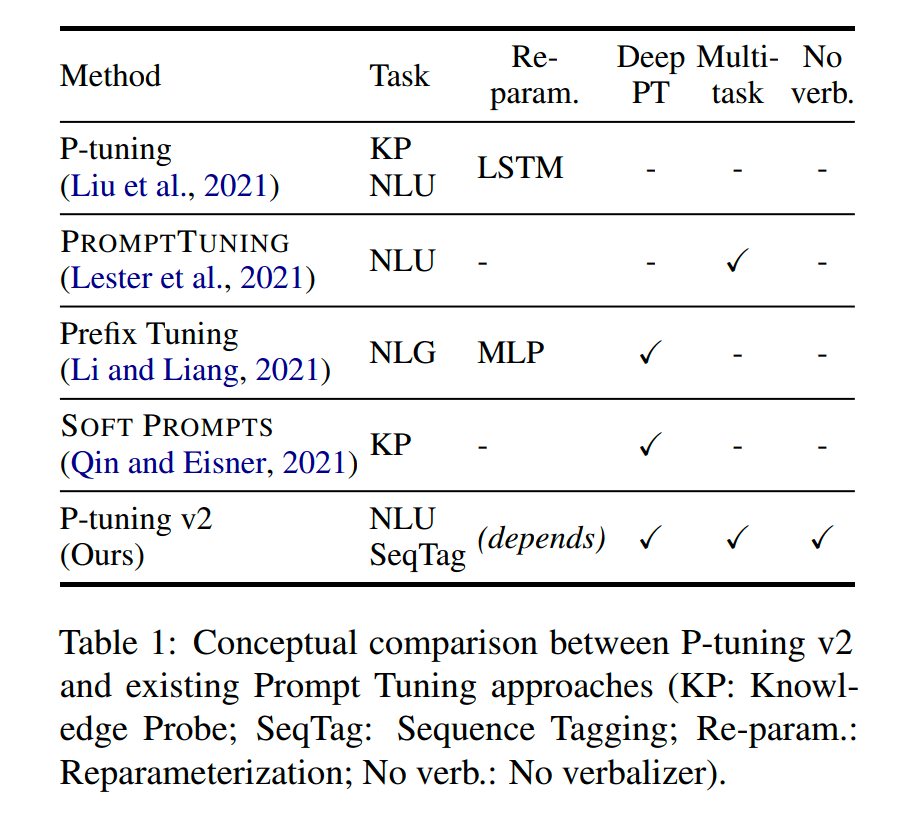

P-Tuning 提出将 Prompt 转换为可以学习的 Embedding 层,只是考虑到直接对 Embedding 参数进行优化会存在这样两个挑战: Discretenes:对输入正常语料的 Embedding 层已经经过预训练,而如果直接对输入的 prompt embedding 进行随机初始化训练,容易陷入局部最优。Association:没法捕捉到 prompt embedding 之间的相关关系。 Association:没法捕捉到 prompt embedding 之间的相关关系。 作者在这里提出用 MLP+LSTM 的方式来对 prompt embedding 进行一层处理 4.1.1 与 Prefix-Tuning 的区别 这篇文章(2021-03)和 Prefix-Tuning(2021-01)差不多同时提出,做法其实也有一些相似之处,主要区别在 Prefix Tuning 是将额外的 embedding 加在开头,看起来更像是模仿 Instruction 指令;而 P-Tuning 的位置则不固定。 Prefix Tuning 通过在每个 Attention 层都加入 Prefix Embedding 来增加额外的参数,通过 MLP 来初始化;而 P-Tuning 只是在输入的时候加入 Embedding,并通过 LSTM+MLP 来初始化。 Prefix Tuning 是将额外的 embedding 加在开头,看起来更像是模仿 Instruction 指令;而 P-Tuning 的位置则不固定。 Prefix Tuning 通过在每个 Attention 层都加入 Prefix Embedding 来增加额外的参数,通过 MLP 来初始化;而 P-Tuning 只是在输入的时候加入 Embedding,并通过 LSTM+MLP 来初始化。 4.2 V2 论文《P-Tuning v2: Prompt Tuning Can Be Comparable to Fine-tuning Universally Across Scales and Tasks》 从标题就可以看出这篇文章的野心,P-Tuning v2 的目标就是要让 Prompt Tuning 能够在不同参数规模的预训练模型、针对不同下游任务的结果上都达到匹敌 Fine-tuning 的结果。 那也就是说当前 Prompt Tuning 方法未能在这两个方面都存在局限性。 不同模型规模:Prompt Tuning 和 P-tuning 这两种方法都是在预训练模型参数规模够足够大时,才能达到和 Fine-tuning 类似的效果,而参数规模较小时效果则很差。 不同任务类型:Prompt Tuning 和 P-tuning 这两种方法在 sequence tagging 任务上表现都很差。4.2.1 主要结构 相比 Prompt Tuning 和 P-tuning 的方法,P-tuning v2 方法在多层加入了 Prompts tokens 作为输入,带来两个方面的好处: 1. 带来更多可学习的参数(从 P-tuning 和 Prompt Tuning 的 0.1% 增加到0.1%-3%),同时也足够 parameter-efficient。 2. 加入到更深层结构中的 Prompt 能给模型预测带来更直接的影响。

4.2.2 几个关键设计因素

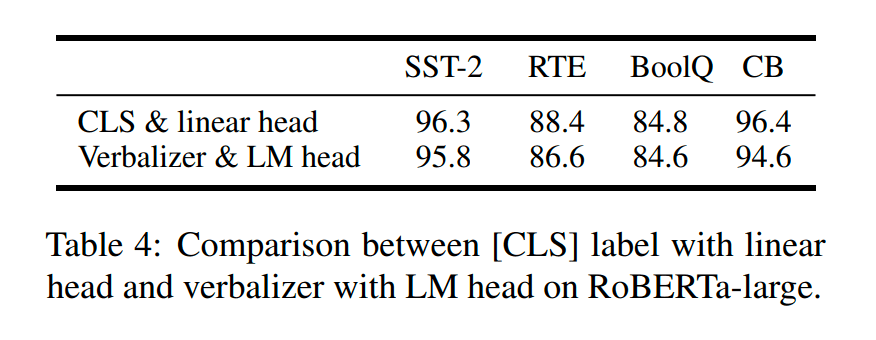

Reparameterization:Prefix Tuning 和 P-tuning 中都有 MLP 来构造可训练的 embedding。本文发现在自然语言理解领域,面对不同的任务以及不同的数据集,这种方法可能带来完全相反的结论。 Prompt Length:不同的任务对应的最合适的 Prompt Length 不一样,比如简单分类任务下 length=20 最好,而复杂的任务需要更长的 Prompt Length。 Multi-task Learning多任务对于 P-Tuning v2 是可选的,但可以利用它提供更好的初始化来进一步提高性能。 Classification Head 使用 LM head 来预测动词是 Prompt Tuning 的核心,但我们发现在完整的数据设置中没有必要这样做,并且这样做与序列标记不兼容。P-tuning v2 采用和 BERT 一样的方式,在第一个 token 处应用随机初始化的分类头。Reparameterization:Prefix Tuning 和 P-tuning 中都有 MLP 来构造可训练的 embedding。本文发现在自然语言理解领域,面对不同的任务以及不同的数据集,这种方法可能带来完全相反的结论。 Prompt Length:不同的任务对应的最合适的 Prompt Length 不一样,比如简单分类任务下 length=20 最好,而复杂的任务需要更长的 Prompt Length。 Multi-task Learning多任务对于 P-Tuning v2 是可选的,但可以利用它提供更好的初始化来进一步提高性能。 4.2.3 实验结果 不同预训练模型大小下的表现,在小模型下取得与Full-finetuning相近的结果,并远远优于P-Tuning。 不同任务下的 P-Tuning v2 效果都很好,而 P-Tuning 和 Prompt Learning 效果不好;同时,采用多任务学习的方式能在多数任务上取得最好的结果。Verbalizer with LM head v.s. [CLS] label with linear head,两种方式没有太明显的区别

Verbalizer with LM head v.s. [CLS] label with linear head,两种方式没有太明显的区别

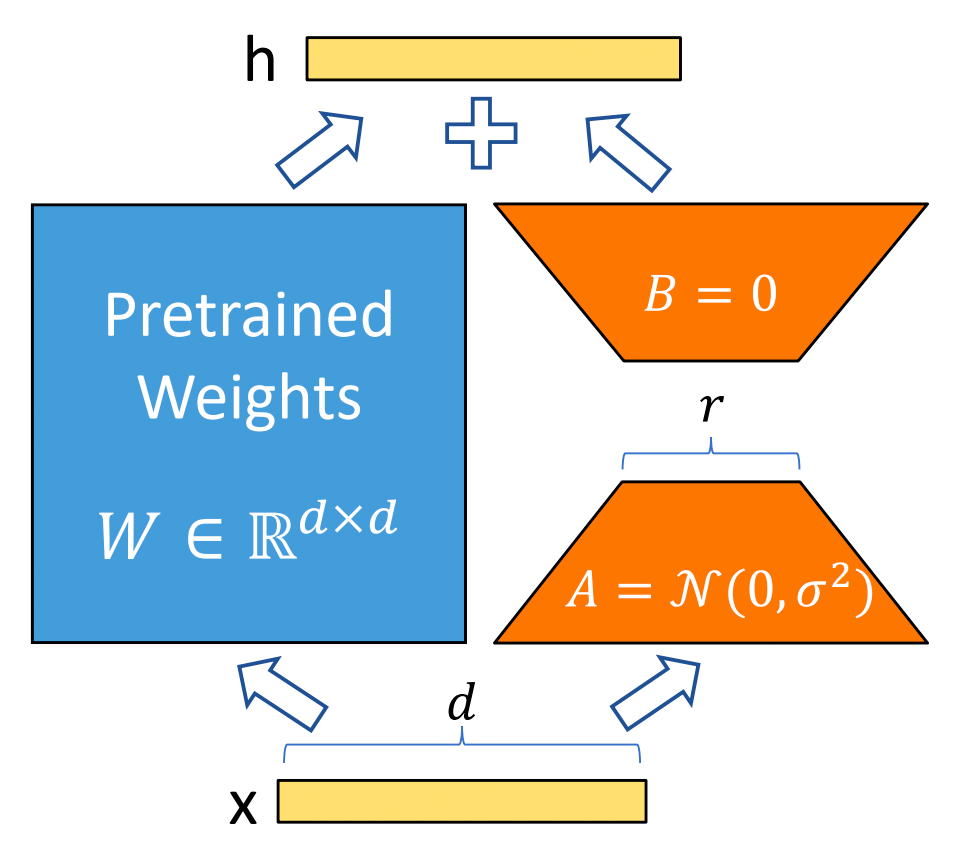

LoRA 微软和 CMU 的研究者指出,现有的一些 PEFT 的方法还存在这样一些问题: 由于增加了模型的深度从而额外增加了模型推理的延时,如 Adapter 方法 Prompt 较难训练,同时减少了模型的可用序列长度,如 Prompt Tuning、Prefix Tuning、P-Tuning 方法往往效率和质量不可兼得,效果差于 full-finetuning 往往效率和质量不可兼得,效果差于 full-finetuning 有研究者对语言模型的参数进行研究发现:语言模型虽然参数众多,但是起到关键作用的还是其中低秩的本质维度(low instrisic dimension)。本文受到该观点的启发,提出了 Low-Rank Adaption(LoRA),设计了如下所示的结构,在涉及到矩阵相乘的模块,引入 A、B 这样两个低秩矩阵模块去模拟 Full-finetune 的过程,相当于只对语言模型中起关键作用的低秩本质维度进行更新。

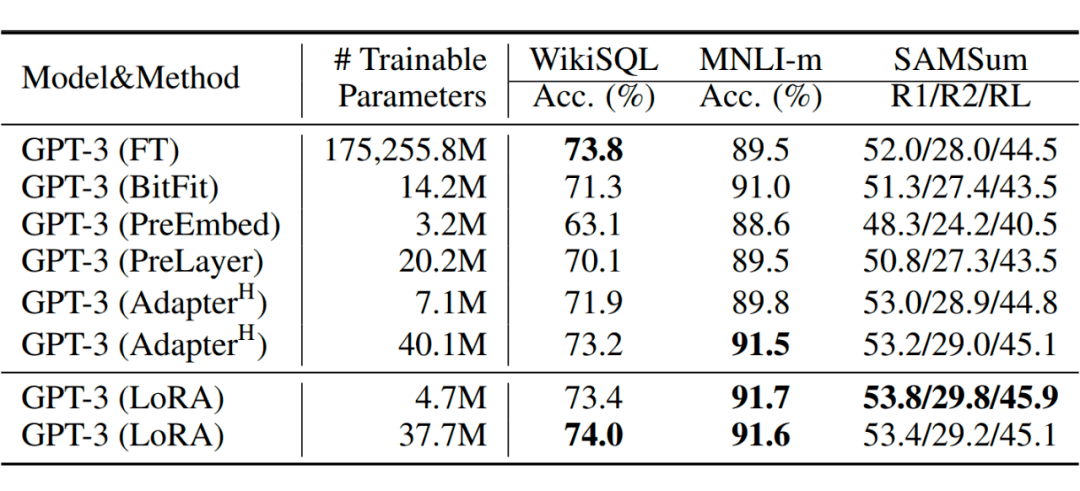

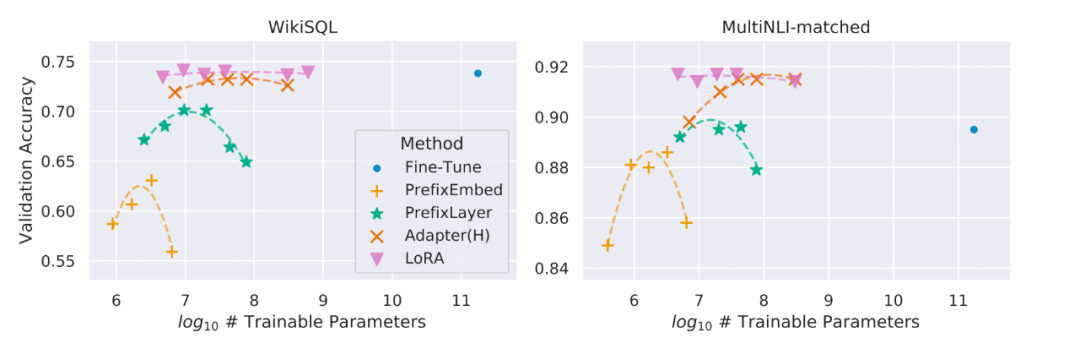

这么做就能完美解决以上存在的 3 个问题: 相比于原始的 Adapter 方法“额外”增加网络深度,必然会带来推理过程额外的延迟,该方法可以在推理阶段直接用训练好的 A、B 矩阵参数与原预训练模型的参数相加去替换原有预训练模型的参数,这样的话推理过程就相当于和 Full-finetune 一样,没有额外的计算量,从而不会带来性能的损失。 由于没有使用 Prompt 方式,自然不会存在 Prompt 方法带来的一系列问题。该方法由于实际上相当于是用 LoRA 去模拟 Full-finetune 的过程,几乎不会带来任何训练效果的损失,后续的实验结果也证明了这一点。 该方法由于实际上相当于是用 LoRA 去模拟 Full-finetune 的过程,几乎不会带来任何训练效果的损失,后续的实验结果也证明了这一点。 在实验中,研究人员将这一 LoRA 模块与 Transformer 的 attention 模块相结合,在 RoBERTa 、DeBERTa、GPT-2 和 GPT-3 175B 这几个大模型上都做了实验,实验结果也充分证明了该方法的有效性。

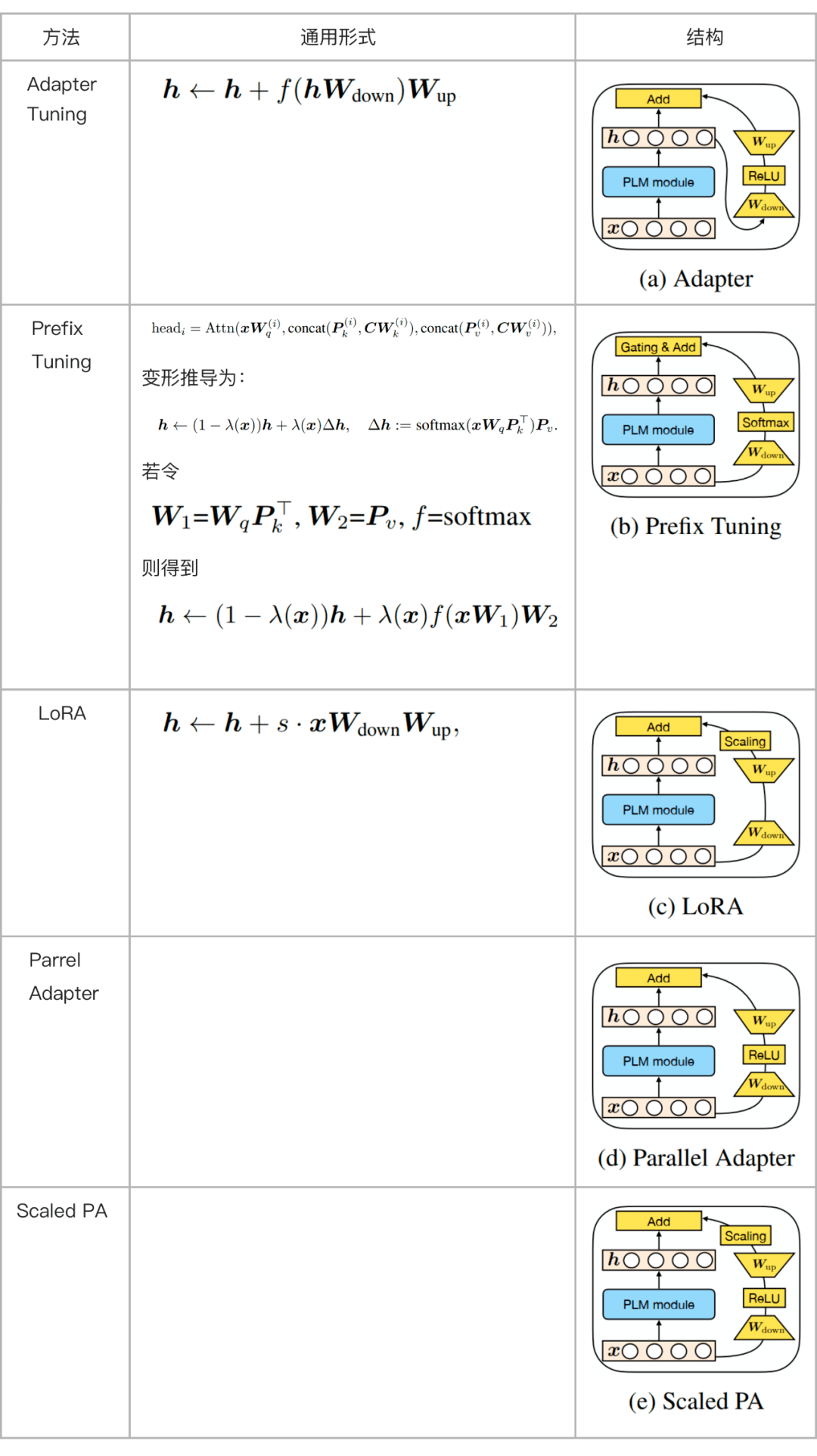

5.1 Towards a Unified View of PETL 这篇 ICLR2022 的文章研究了典型的 PEFT 方法,试图将 PEFT 统一到一个框架下,找出它们起作用的具体原因,并进行改进。主要研究了三个问题: 典型的PEFT方法有什么联系? 典型的PEFT方法中是哪些关键模块在起作用? 能否对这些关键模块进行排列组合,找出更有用的 PEFT 方法?典型的PEFT方法有什么联系? 典型的PEFT方法中是哪些关键模块在起作用? 5.1.1 通用形式

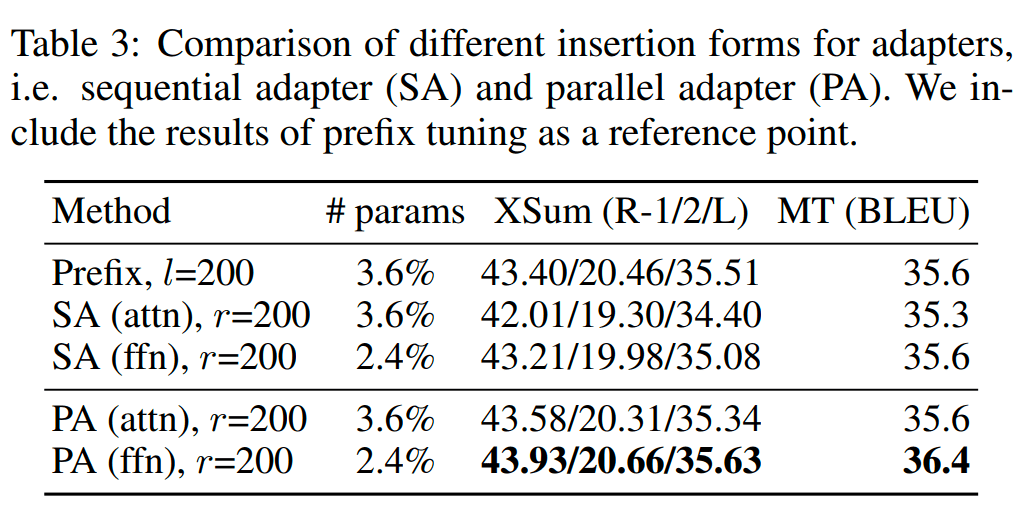

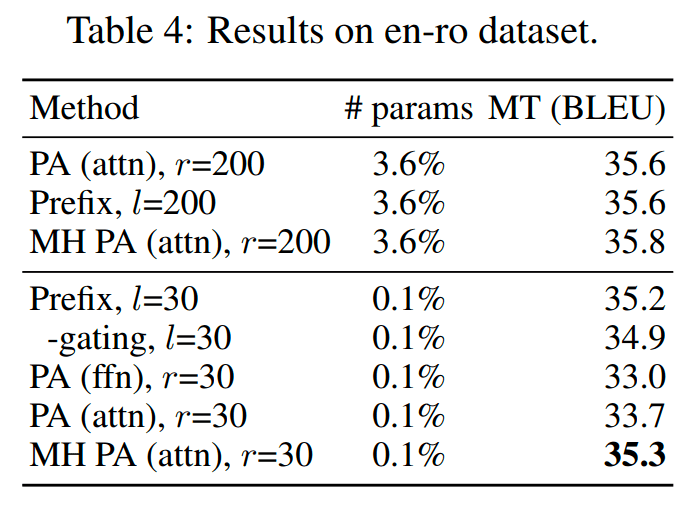

通过对 Prefix Tuning 的推导,得出了和 Adapter Tuning 以及 LoRA 形式一致的形式。 更近一步地,可以将这些 Tuning 的方法统一在同一套框架下, 包括这几大要素: 的形式 嵌入 Transformer 结构的方式(分为 Parrell 和 Sequential 两种。Parallel 指的是在输入层嵌入,这样与原有结构可以并行计算;Sequential 指的是在输出层嵌入,相当于增加了网路的深度,与原有结构存在依赖关系) 修改的表示层(主要指对 attention层的修改还是对 ffn 层的修改)组合方式。怎么与原有的参数组合,包括简单相加(Adapter)、门控式(Prefix Tuning)、缩放式(LoRA)三种) 的形式 组合方式。怎么与原有的参数组合,包括简单相加(Adapter)、门控式(Prefix Tuning)、缩放式(LoRA)三种) 根据这个统一的框架,还另外设计了三种变体Parallel Adapter、Multi-head Parallel Adapter、Scaled Parallel Adapter。 5.1.2 一些实验 哪种嵌入形式更好:Parallel or Sequencial? 答案是:Parallel 更好

对哪块结构做修改更好?Attention or FFN? 当微调的参数量较多时,从结果来看,对 FFN 层进行修改更好 。 一种可能的解释是 FFN 层学到的是任务相关的文本模式,而 Attention 层学到的是成对的位置交叉关系,针对新任务并不需要进行大规模调整。当微调参数量较少(0.1%)时,对 Attention 进行调整效果更好。

当微调参数量较少(0.1%)时,对 Attention 进行调整效果更好。

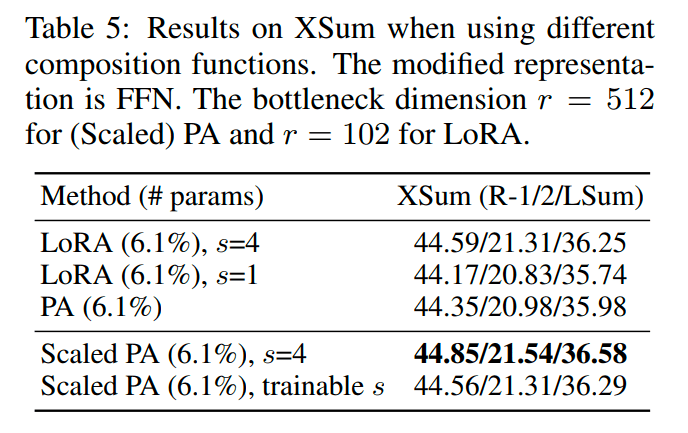

哪种组合方式效果更好? 从结果来看,缩放式的组合效果更好。

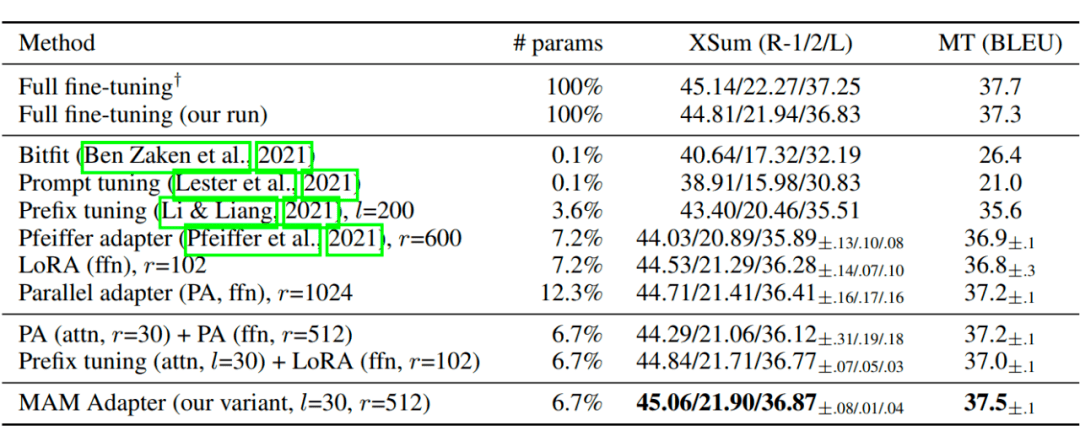

5.1.3 结论 基于以上的经验, Scaled parallel adapter is the best variant to modify FFN FFN can better utilize modification at larger capacitiesmodifying head attentions like prefix tuning can achieve strong performance with only 0.1% parameters modifying head attentions like prefix tuning can achieve strong performance with only 0.1% parameters 研究者设计出最新的结构 MAM Adapter,取得了最好的效果:

案例 6.1 典型应用 [1] https://github.com/mymusise/ChatGLM-Tuning 一种平价的 Chatgpt 实现方案,基于清华的ChatGLM-6B+ LoRA 进行finetune [2] https://github.com/tloen/alpaca-lora 6.2 PEFT实现 [1] https://github.com/huggingface/peft huggingface PEFT [2] https://github.com/jxhe/unify-parameter-efficient-tuning 参考文献 [1] Parameter-Efficient Transfer Learning for NLP: https://arxiv.org/pdf/1902.00751.pdf [2] Prefix-Tuning: Optimizing Continuous Prompts for Generation: https://arxiv.org/pdf/2101.00190.pdf [3] The Power of Scale for Parameter-Efficient Prompt Tuning: https://arxiv.org/pdf/2104.08691.pdf [4] BitFit: Simple Parameter-efficient Fine-tuning for Transformer-based Masked Language-models: https://arxiv.org/pdf/2106.10199.pdf [5] GPT Understands, Too: https://arxiv.org/pdf/2103.10385.pdf [6] TOWARDS A UNIFIED VIEW OF PARAMETER-EFFICIENT TRANSFER LEARNING: https://arxiv.org/pdf/2110.04366.pdf [7] UNIPELT: A Unified Framework for Parameter-Efficient Language Model Tuning: https://arxiv.org/pdf/2110.07577.pdf [8] Ladder Side-Tuning:预训练模型的“过墙梯”: https://kexue.fm/archives/9138 [9] INTRINSIC DIMENSIONALITY EXPLAINS THE EFFECTIVENESS OF LANGUAGE MODEL FINE-TUNING: https://arxiv.org/pdf/2012.13255.pdf [10] Prompt-Tuning——深度解读一种新的微调范式: [11] P-tuning:自动构建模版,释放语言模型潜能: https://kexue.fm/archives/8295 [12] P-Tuning v2: Prompt Tuning Can Be Comparable to Fine-tuning Universally Across Scales and Tasks: https://arxiv.org/pdf/2110.07602.pdf 更多阅读 # 投 稿 通 道# 让你的文字被更多人看到 如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢? 答案就是:你不认识的人。 总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。 PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是 最新论文解读,也可以是 学术热点剖析、 科研心得或 竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。 📝 稿件基本要求: • 文章确系个人 原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注 • 稿件建议以 markdown格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题 • PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供 业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算 📬 投稿通道: • 投稿邮箱:[email protected] • 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者 • 您也可以直接添加小编微信( pwbot02)快速投稿,备注:姓名-投稿 🔍 现在,在 「知乎」也能找到我们了 进入知乎首页搜索 「PaperWeekly」 · · 返回搜狐,查看更多 |

【本文地址】

今日新闻 |

推荐新闻 |