机器学习 |

您所在的位置:网站首页 › wine数据集分析训练模型 › 机器学习 |

机器学习

|

大家有没有听说过“三行代码行天下”这句话 真的有这么强吗? 没错,你没有听错 python在数据处理建模这方面确实段位很高 那么,python中的最重要的装备之一就是“sklearn” 下面我们就来看看sklearn是如何来实现决策树中的分类树的 本文目录: 1 概述 1.1 sklearn 中的决策树 2 DecisionTreeClassififier 与红酒数据集 2.1 重要参数 2.1.1 criterion 2.1.2 random_state & splitter 2.1.3 剪枝参数 2.1.4 目标权重参数 2.2 重要属性和接口 1 概述 决策树( Decision Tree )是一种非参数的有监督学习方法,它能够从一系列有特征和标签的数据中总结出决策规 则 并用树状图的结构来呈现这些规则,以解决分类和回归问题。决策树算法容易理解,适用各种数据,在解决各 种问题时都有良好表现 尤其是以树模型为核心的各种集成算法,在各个行业和领域都有广泛的应用。 如果对决策树原理还不了解的,请看作者博客文章《机器学习-万字长文介绍决策树之原理(一) 》 1.1 sklearn中的决策树 在sklearn模块中决策树是 sklearn.tree sklearn 中决策树的类都在 ”tree“ 这个模块之下。这个模块总共包含五个类:

在开始敲代码之前,我们先看看sklearn建模的基本流程:

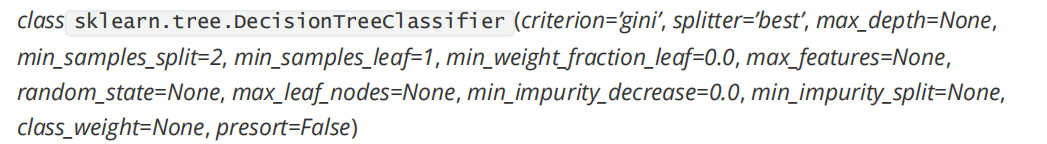

如果按照上图的流程,分类树的建模流程就是: from sklearn import tree #导入需要的模块 clf = tree.DecisionTreeClassifier() #实例化 clf = clf.fit(X_train,y_train) #用训练集数据训练模型 result = clf.score(X_test,y_test) #导入测试集,从接口中调用需要的信息是不是只用了三行呢?! 下面我们用一个具体的例子来讲解分类树 2 DecisionTreeClassififier与红酒数据集我们先看看分类树的参数:

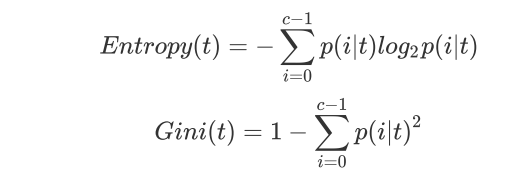

是不是傻眼了?这么多,看到都脑阔疼。 没关系,接下来我们挑选其中重要的参数配合实际的例子来讲清楚。 2.1 重要参数 2.1.1 criterion 为了要将表格转化为一棵树,决策树需要找出最佳节点和最佳的分枝方法,对分类树来说,衡量这个 “ 最佳 ” 的指标 叫做“ 不纯度 ” 。 通常来说,不纯度越低,决策树对训练集的拟合越好。现在使用的决策树算法在分枝方法上的核心 大多是围绕在对某个不纯度相关指标的最优化上。 不纯度基于节点来计算,树中的每个节点都会有一个不纯度,并且子节点的不纯度一定是低于父节点的,也就是 说,在同一棵决策树上,叶子节点的不纯度一定是最低的。 Criterion 这个参数正是用来决定不纯度的计算方法的。 sklearn 提供了两种选择: 1 )输入 ”entropy“ ,使用 信息熵 ( Entropy ) 2 )输入 ”gini“ ,使用 基尼系数 ( Gini Impurity )

其中 t 代表给定的节点, i 代表标签的任意分类, 代表标签分类i 在节点 t 上所占的比例。 注意,当使用信息熵 时,sklearn 实际计算的是基于信息熵的信息增益 (Information Gain) ,即父节点的信息熵和子节点的信息熵之差。 比起基尼系数,信息熵对不纯度更加敏感,对不纯度的惩罚最强。 但是 在实际使用中,信息熵和基尼系数的效果基 本相同。 信息熵的计算比基尼系数缓慢一些,因为基尼系数的计算不涉及对数。 另外,因为信息熵对不纯度更加敏感,所以信息熵作为指标时,决策树的生长会更加“ 精细 ” 因此对于高维数据或者噪音很多的数据,信息熵很容易 过拟合,基尼系数在这种情况下效果往往比较好。 当模型拟合程度不足的时候,即当模型在训练集和测试集上都表 现不太好的时候,使用信息熵。当然,这些不是绝对的。

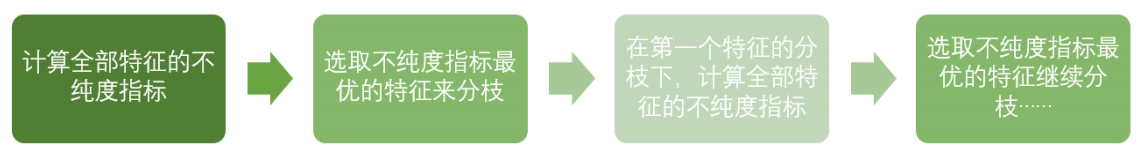

到这里,决策树的基本流程其实可以简单概括如下:

下面我们真的要开始上代码了,一般大多数讲决策树的教程都会用鸢尾花(iris)数据集 但是用这个数据集不太好,原因是有一个参数不能够用这个数据集很清楚的介绍,下面我们会讲到 所以本文用的是红酒数据集 首先,要确保你的计算机上有机器学习的环境,如果没有,请看作者文章《机器学习-环境配置(windows版)》 然后我们打开cmd,输入指令: jupyter lab新建一个".ipynb"文件准备敲代码 第一步:导入所需要的包 from sklearn import tree from sklearn.datasets import load_wine from sklearn.model_selection import train_test_split第二步:查看数据 我们先来看看这个红酒数据集到底是什么样子的 wine = load_wine() wine.data.shape

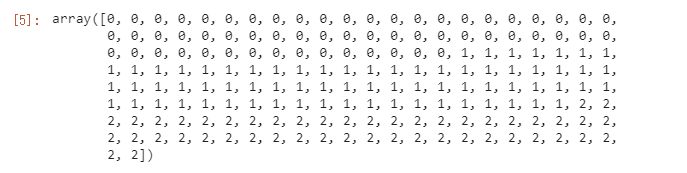

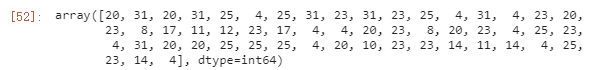

解释一下:这是说这个数据集有178行,13列 wine.target

解释一下:这是说这个数据集中的标签有三种,0,1和2,也就是这些红酒被分成了三类。 import pandas as pd pd.concat([pd.DataFrame(wine.data),pd.DataFrame(wine.target)],axis=1)#第一个参数是将两个DataFrame合并,axis默认为0,是纵向合并,为1是横向合并

解释一下:这里是将红酒属性数据集和标签列进行了横向链接(也叫合并,学过数据库的都知道) wine.feature_names

解释一下:这是红酒的属性名字 wine.target_names

解释一下:这是标签名字,也就是分类的名字 Xtrain,Xtest,Ytrain,Ytest=train_test_split(wine.data,wine.target,test_size=0.3)解释一下:这里是说将数据集分为训练集和测试集,其中70%为训练集,30%为测试集。 Xtrain.shape

解释一下:训练集有124个样本,13个属性 Xtest.shape

解释一下:训练集有54个样本,13个属性 Ytrain

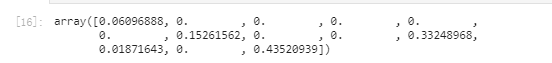

这是说训练集的目标属性,有三种,为0,1,2 第三步:建立模型(三行代码行天下) clf = tree.DecisionTreeClassifier(criterion="entropy") clf = clf.fit(Xtrain,Ytrain) score = clf.score(Xtest,Ytest)#返回预测的准确accuracy score

解释一下:模型得分0.9259,还算不错。 第四步:画出这棵树 feature_name = ['酒精','苹果酸','灰','灰的碱性','镁','总酚','类黄酮','非黄烷类酚类','花青素','颜 色强度','色调','od280/od315稀释葡萄酒','脯氨酸'] import graphviz dot_data = tree.export_graphviz(clf,out_file = None,feature_names= feature_name,class_names=["琴酒","雪莉","贝尔摩德"],filled=True,rounded=True) graph = graphviz.Source(dot_data) graph

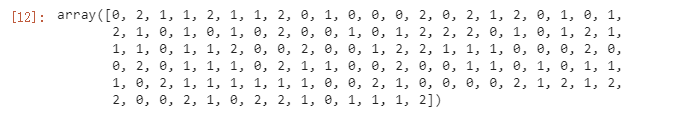

解释一下:上图就是决策树选出的一些属性,利用这些属性建立的分类树。 那么我们能不能将每个属性的重要性打印出来呢?回答是可以的 #特征重要性 clf.feature_importances_ [*zip(feature_name,clf.feature_importances_)]

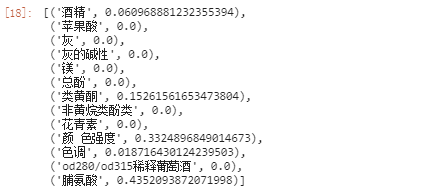

是不是不够直观,是因为我们还是无法知道哪个属性对应的重要性的数值。 [*zip(feature_name,clf.feature_importances_)]

是不是直观多了呢 到这里,你是不是一位我们的工作完成了呢? 当然没有,这只是开始呢,我们还有更重要的工作要做。 多次运行上述建模代码,你会发现score的值每次都不一样。 那么它为什么会不稳定呢?是不是对所有数据集都这样呢? 这是因为决策树模型的的计算步骤中, 不纯度是基于节点来计算的,也就是说,决策树在建树时,是靠优化节点来追求一棵优化的树 但最优 的节点能够保证最优的树吗? 这是个问题,但是集成算法解决了这个问题 sklearn 表示,既然一棵树不能保证最优,那就建更 多的不同的树,然后从中取最好的。 怎样从一组数据集中建不同的树? 在每次分枝时,不从使用全部特征,而是随 机选取一部分特征,从中选取不纯度相关指标最优的作为分枝用的节点。 这样,每次生成的树也就不同了。 2.1.2 random_state & splitter clf = tree.DecisionTreeClassifier(criterion="entropy",random_state=30) clf = clf.fit(Xtrain, Ytrain) score = clf.score(Xtest, Ytest) #返回预测的准确度 score

我们来实验一下: clf = tree.DecisionTreeClassifier(criterion="entropy",random_state=30 ,splitter="random") clf = clf.fit(Xtrain, Ytrain) score = clf.score(Xtest, Ytest) score

解释一下:我们得到的分数是0.944 我们将图画出来看看 import graphviz dot_data = tree.export_graphviz(clf,feature_names= feature_name,class_names=["琴酒","雪莉","贝尔摩德"],filled=True,rounded=True ) graph = graphviz.Source(dot_data) graph

解释一下:看看,是不是我们的模型对训练集效果太好了啊,这很容易造成过拟合。 那怎么来解决这个问题呢? 当我们养一盆植物的时候,当这个植物比较潦草的时候,我们怎么办呢?是不是要剪枝啊! 为了让决策树有更好的泛化性,我们要对决策树进行剪枝。 剪枝策略对决策树的影响巨大,正确的剪枝策略是优化 决策树算法的核心。 sklearn 为我们提供了不同的剪枝策略: max_depth : 限制树的最大深度,超过设定深度的树枝全部剪掉 这是用得最广泛的剪枝参数,在高维度低样本量时非常有效。 决策树多生长一层,对样本量的需求会增加一倍,所 以限制树深度能够有效地限制过拟合。 在集成算法中也非常实用。实际使用时,建议从=3 开始尝试,看看拟合的效 果再决定是否增加设定深度。 min_samples_leaf & min_samples_split : min_samples_leaf 限定,一个节点在分枝后的每个子节点都必须包含至少 min_samples_leaf 个训练样本,否则分 枝就不会发生 或者,分枝会朝着满足每个子节点都包含min_samples_leaf 个样本的方向去发生 一般搭配max_depth 使用 在回归树中有神奇的效果,可以让模型变得更加平滑。 这个参数的数量设置得太小会引 起过拟合,设置得太大就会阻止模型学习数据。 一般来说,建议从=5 开始使用。如果叶节点中含有的样本量变化很 大,建议输入浮点数作为样本量的百分比来使用。 同时,这个参数可以保证每个叶子的最小尺寸,可以在回归问题 中避免低方差,过拟合的叶子节点出现。对于类别不多的分类问题,取1 通常就是最佳选择。 min_samples_split 限定,一个节点必须要包含至少 min_samples_split 个训练样本,这个节点才允许被分枝,否则分枝就不会发生。 我们来看个例子吧: clf=tree.DecisionTreeClassifier(criterion="entropy",random_state=30,splitter="random",max_depth=3,min_samples_leaf=5,min_samples_split=5) clf = clf.fit(Xtrain, Ytrain) dot_data = tree.export_graphviz(clf,feature_names= feature_name,class_names=["琴酒","雪莉","贝尔摩德"],filled=True,rounded=True) graph = graphviz.Source(dot_data) graph 解释一下:max_depth=3,min_samples_leaf=5,min_samples_split=5,观察上面的图,你会发现,深度不超过3,分支后的每个结点的samples都不少于5,每个被分的结点的samples都不低于5。

那么我们来看看效果怎么样

score = clf.score(Xtest, Ytest)

score

解释一下:max_depth=3,min_samples_leaf=5,min_samples_split=5,观察上面的图,你会发现,深度不超过3,分支后的每个结点的samples都不少于5,每个被分的结点的samples都不低于5。

那么我们来看看效果怎么样

score = clf.score(Xtest, Ytest)

score

解释一下:树变得更简洁了,但是模型得分依旧不错。 max_features & min_impurity_decrease : 一般 max_depth 使用,用作树的 ” 精修 “ max_features限制分枝时考虑的特征个数,超过限制个数的特征都会被舍弃。 和 max_depth 异曲同工, max_features是用来限制高维度数据的过拟合的剪枝参数 但其方法比较暴力,是直接限制可以使用的特征数量 而强行使决策树停下的参数 在不知道决策树中的各个特征的重要性的情况下,强行设定这个参数可能会导致模型学习不足。 如果希望通过降维的方式防止过拟合,建议使用PCA , ICA 或者特征选择模块中的降维算法。 min_impurity_decrease限制信息增益的大小,信息增益小于设定数值的分枝不会发生。 这是在 0.19 版本中更新的功能,在0.19 版本之前时使用 min_impurity_split 。 确认最优的剪枝参数: 那具体怎么来确定每个参数填写什么值呢? 这时候,我们就要使用确定超参数的曲线来进行判断了,继续使用我们 已经训练好的决策树模型clf 。 超参数的学习曲线,是一条以超参数的取值为横坐标,模型的度量指标为纵坐标的曲线,它是用来衡量不同超参数取值下模型的表现的线。 在我们建好的决策树里,我们的模型度量指标就是score 。 import matplotlib.pyplot as plt test = [] for i in range(10): clf = tree.DecisionTreeClassifier(max_depth=i+1,criterion="entropy",random_state=30,splitter="random") clf = clf.fit(Xtrain, Ytrain) score = clf.score(Xtest, Ytest) test.append(score) plt.plot(range(1,11),test,color="red",label="max_depth") plt.legend() plt.show()

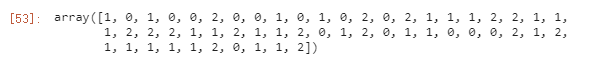

解释一下:横坐标为max_depth取值,纵坐标为score,从图中我们可以看到,当max_depth取3的时候,模型得分最高。 那么,剪枝参数一定能够提升模型在测试集上的表现吗? 调参没有绝对的答案,一切都是看数据本身,嘿嘿 这么多参数,我们要一个个画学习曲线吗?那不累死了? 这个问题我会在后续的文章中回答。 无论如何,剪枝参数的默认值会让树无尽地生长 这些树在某些数据集上可能非常巨大,对内存的消耗也非常巨 大。 所以如果你手中的数据集非常巨大,你已经预测到无论如何你都是要剪枝的 那提前设定这些参数来控制树的 复杂性和大小会比较好。 2.1.4 目标权重参数 class_weight & min_weight_fraction_leaf: 完成样本标签平衡的参数。样本不平衡是指在一组数据集中,标签的一类天生占有很大的比例。 比如说,在银行要 判断“ 一个办了信用卡的人是否会违约 ” ,就是是 vs 否( 1% : 99% )的比例。 这种分类状况下,即便模型什么也不 做,全把结果预测成“ 否 ” ,正确率也能有 99% 。 因此我们要使用 class_weight 参数对样本标签进行一定的均衡,给少量的标签更多的权重,让模型更偏向少数类,向捕获少数类的方向建模。 该参数默认None ,此模式表示自动给与数据集中的所有标签相同的权重。 有了权重之后,样本量就不再是单纯地记录数目,而是受输入的权重影响了 因此这时候剪枝,就需要搭配 min_ weight_fraction_leaf这个基于权重的剪枝参数来使用。 另请注意,基于权重的剪枝参数(例如 min_weight_ fraction_leaf)将比不知道样本权重的标准(比如 min_samples_leaf )更少偏向主导类。 如果样本是加权的,则使用基于权重的预修剪标准来更容易优化树结构,这确保叶节点至少包含样本权重的总和的一小部分。 2.2 重要属性和接口 属性是在模型训练之后,能够调用查看的模型的各种性质。 对决策树来说,最重要的是 feature_importances_ ,能 够查看各个特征对模型的重要性。 sklearn 中许多算法的接口都是相似的,比如说我们之前已经用到的 fifit 和 score ,几乎对每个算法都可以使用。 除了这两个接口之外,决策树最常用的接口还有apply 和 predict 。 apply 中输入测试集返回每个测试样本所在的叶子节 点的索引,predict 输入测试集返回每个测试样本的标签。 返回的内容一目了然并且非常容易,大家感兴趣可以自己 下去试试看。 在这里不得不提的是, 所有接口中要求输入X_train和X_test的部分,输入的特征矩阵必须至少是一个二维矩阵。 sklearn不接受任何一维矩阵作为特征矩阵被输入 。 如果你的数据的确只有一个特征,那必须用 reshape(-1,1) 来给 矩阵增维; 如果你的数据只有一个特征和一个样本,使用reshape(1,-1) 来给你的数据增维。#apply返回每个测试样本所在的叶子节点的索引 clf.apply(Xtest)

解释一下:我们拿到了每个样本所在的叶子节点的索引 #predict返回每个测试样本的分类/回归结果 clf.predict(Xtest)

解释一下:我们拿到了每个样本的分类结果。 至此,我们已经学完了分类树 DecisionTreeClassififier 和用决策树绘图( export_graphviz )的所有基础。 我们讲解了决策树的基本流程,分类树的八个参数,一个属性,四个接口,以及绘图所用的代码。 八个参数: Criterion ,两个随机性相关的参数( random_state , splitter ),五个剪枝参数( max_depth, min_samples_split, min_samples_leaf , max_feature , min_impurity_decrease ) 一个属性: feature_importances_ 四个接口: fifit , score , apply , predict 接下来,在不断的实验中,在各种数据集上进行实战,一定会变得更加熟练!

本文参考教程:菜菜的sk-learn课程 如有写的不合适,亦或是不精确的地方,望读者多包涵 如果大家对上述内容有任何不理解的地方,可以留言,和毛同学共同讨论,一起进步!

整理于2020年12月1日 |

【本文地址】

今日新闻 |

推荐新闻 |