用jps查看worker有成功启动但在ui上没有看到alive workers |

您所在的位置:网站首页 › spark配置没有worker节点 › 用jps查看worker有成功启动但在ui上没有看到alive workers |

用jps查看worker有成功启动但在ui上没有看到alive workers

|

前一天晚上按照书上搭建了HA集群,且验证了一下master宕机的情况下,另一个单独用sbin下的start-master.sh命令单独再次启动Master服务的节点自动由standby状态转为alive。 但是,今天登上集群的时候,用一键启动脚本启动了spark集群,查看jps,master和其他节点的worker都有在,但运行第一个spark程序SparkPi的时候,出错了,出错信息如下

然后在网上各种搜索和查看节点日志,以为要启动Hadoop,把Hadoop又启动了,网上又说要改spark-env.sh,把ip改为host,有说打开slave节点的7077端口,又说把master改为大写???什么鬼东东都试过,全没用

ui上面,当时打开的是http://hadoop01:8080,不知道是不是因为我在Hadoop02上启动了Master,sbin/start-master.sh 导致Hadoop01的status是standby,当然运行不了啦,然后又跑到Hadoop02那里运行,还是不行 此时ui页面是这样:

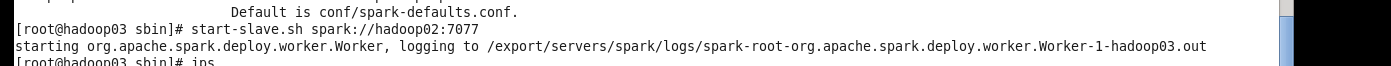

虽然Hadoop02的status是alive了,但workers貌似没运行,然后不知我是怎么把问题定位到workers没运行起来这个原因的, 也忘了是怎么想到去slave节点那里单独再次启动worker的,命令:sbin下start-slave.sh spark://hadoop02:7077,

咦,好像有点苗条,再刷新一下ui看看,诶哟,好家伙,果然行了

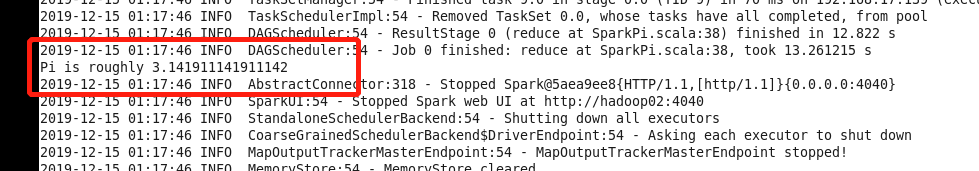

再在Hadoop02上运行sparkPi,成功了!

|

【本文地址】

今日新闻 |

推荐新闻 |