爬取网易云数据并且可视化展示 |

您所在的位置:网站首页 › qq音乐与网易云的数据 › 爬取网易云数据并且可视化展示 |

爬取网易云数据并且可视化展示

|

结构化爬取网易云数据并且可视化展示

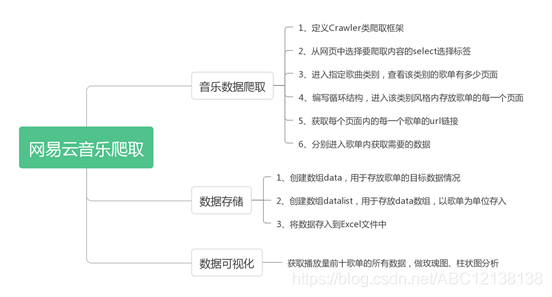

项目说明代码框架第三方库说明内容爬取说明页面详情

完整代码爬取结果内容可视化

项目说明

网易云音乐歌单数据获取,获取某一歌曲风格的所有歌单,进入每个歌单获取歌单名称、创建者、播放量、页面链接、收藏数、转发数、评论数、标签、介绍、收录歌曲数、部分收录歌名,并统计播放量前十的歌单,将播放量前十的歌单以及对应的所有信息进行另外存储,对其进行可视化展示。 在做这个爬虫的时候,对于如何翻页问题和身边的人进行了探讨,有人说用selenium模拟点击,但是通过观察网页,我发现即使是不用模拟点击翻页也能历遍爬完歌单的信息,接下来我就带着大家一起如何爬取数据。 代码框架

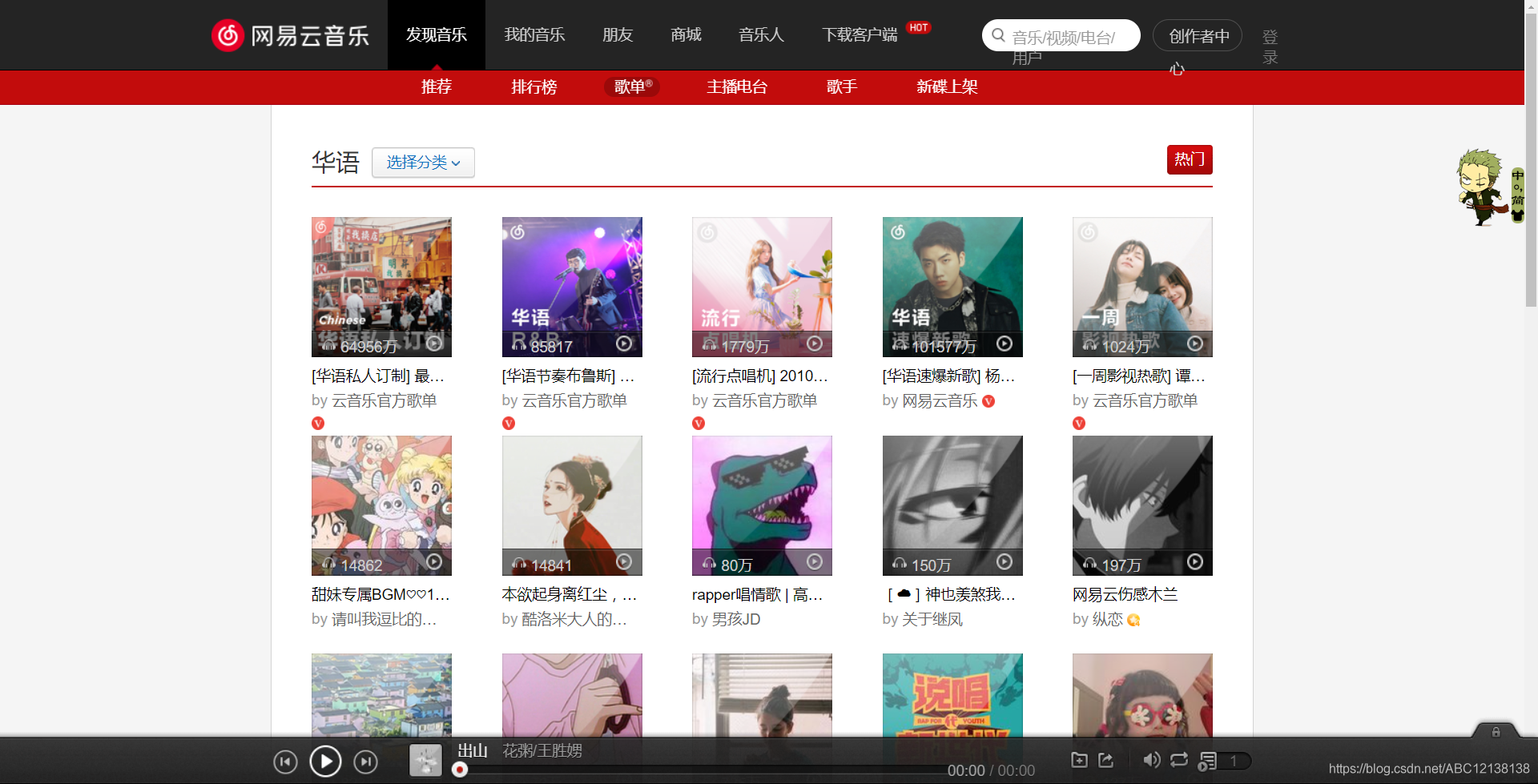

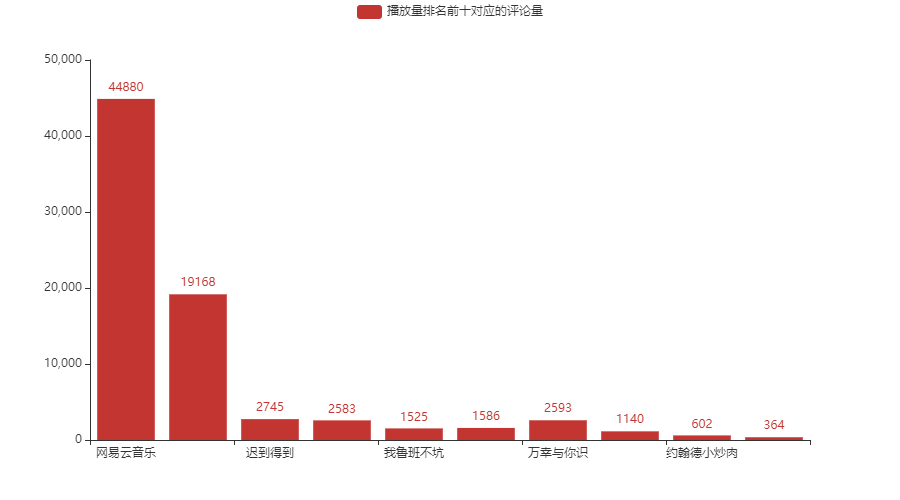

在项目中用到的一些第三方库的介绍: # bs4 ''' BS4全称是Beautiful Soup,它提供一些简单的、 python式的函数用来处理导航、搜索、修改分析树等功能。 它是一个工具箱,通过解析文档为Beautiful Soup自动将输入文档转换为 Unicode编码,输出文档转换为utf-8编码。 ''' # requests ''' 用requests库来访问网页,获取网页内容,支持HTTP特性 ''' # time ''' Time库是与时间处理有关的模块, 在这个项目中是用来强制网页访问间隔时间的。 ''' # random ''' Random库主要功能是提供随机数,在项目中和time库配合使用, 生产随机强制访问的间隔时间的 ''' # xlwt ''' Python访问Excel时的库,其功能是写入xls文件, 在本项目中是用于写入爬取的数据 ''' # pandas ''' Pandas库是基于NumPy的一种工具,用于读取文本文件的, 可以快速便捷的处理数据的库。 ''' # pyecharts.charts ''' pyecharts.charts是用于数据可视化的库,其中包含很多种画图工具, 在本项目中应用到的是画柱状图是Bar,圆饼图是Pie ''' # matplotlib.pyplot ''' matplotlib也是可视化的库,由各种可视化的类构成, matplotlib.pyplot是绘制各类可视化图形的命令子库 ''' 内容爬取说明爬取链接:https://music.163.com/discover/playlist/?cat= 页面详情观察网页内容是我们进行爬虫项目的首要步骤,这里我选择了华语类型的歌单来观察一下; 老规矩 F12 进入开发者选项:

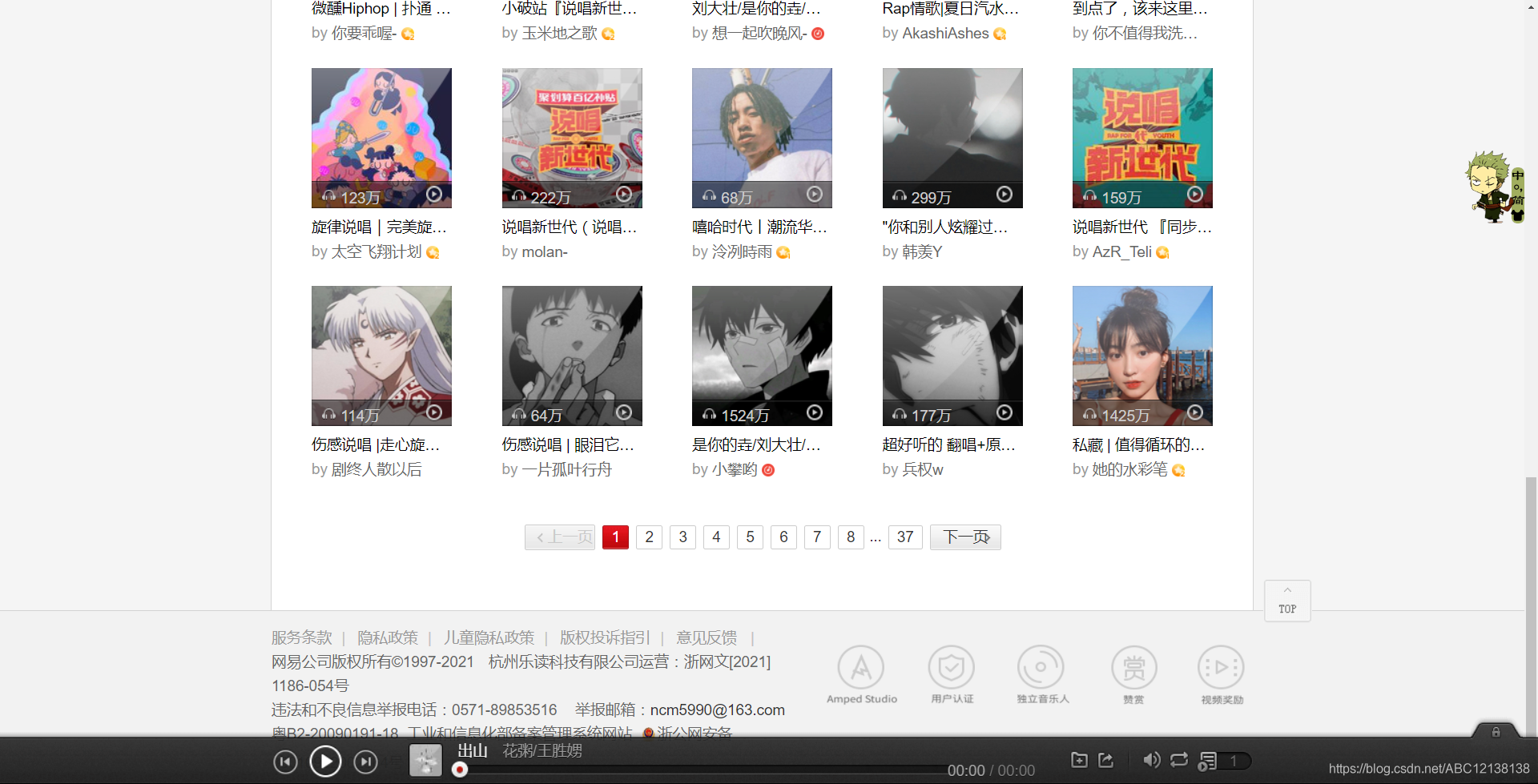

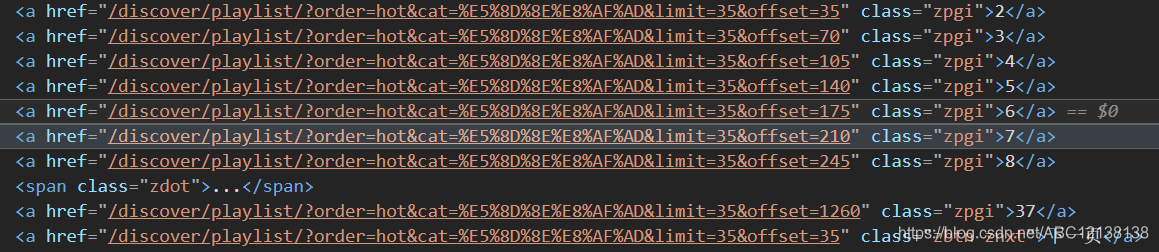

例如:“https://music.163.com/#/discover/playlist/?order=hot&cat=%E5%8D%8E%E8%AF%AD&limit=35&offset=35” 通过网页链接观察,我发现对于网页翻页的重点在于“&limit=35&offset=35”的数字35,每个页面是以链接后面的数字决定当前是在第几个页面,是以0为首页面,35为倍数的规律,第一个页面为 “&limit=0&offset=0”, 第二个页面为 “&limit=35&offset=35”,第三个页面为 “&limit=35&offset=70”,以此类推,只要知道当前类别的歌单有多少个页面,就可以通过for循环来循环翻页,遍历每一个页面。 既然我们已经知道了翻页的规律了,那现在的重点就是获取歌单的页数。我们可以在箭头指引的地方,用开发者选项自带的复制方式,直接右键选择copy,copy selector直接复制CSS选择器语句; 标签: #m-pl-pager > div > a:nth-child(11) #获取歌单网页的页数 result = bs.select('#m-pl-pager > div > a:nth-child(11)')那接下来就是对单个歌单进行内容爬取了,由于我们爬取的内容较多,所以这里就不一一列举了,大家可以自行对比参照,不懂可以私信。 获取歌单名称 通过selector选择器选择各个内容的,由于是在网易云的网页版,因此在歌单内的歌曲并没有显示所有歌曲,只显示了10条歌曲,因此在爬取的时候每个歌单只获取了10条歌曲。如果还想要爬取每天歌曲更多详细内容,可以进入歌曲的url链接,获取更多的内容。 完整代码这里我会定义一个内容类Content 和 网页信息类Website,进行结构化爬虫,如果不是很理解的话,可以看看我之前发过的内容, 爬取三联生活周刊新闻 Content类和 Website类 class Content: def __init__(self, url, name, creator, play, collect, transmit, comment, tag, introduce, sing_num, sing_name): self.url = url self.name = name self.creator = creator self.play = play self.collect = collect self.transmit = transmit self.comment = comment self.tag = tag self.introduce = introduce self.sing_num = sing_num self.sing_name = sing_name def print(self): print("URL: {}".format(self.url)) print("NAME:{}".format(self.name)) print("CRAETOR:{}".format(self.creator)) print("PLAY:{}".format(self.play)) print("COLLECT:{}".format(self.collect)) print("TRANSMIT:{}".format(self.transmit)) print("COMMENT:{}".format(self.comment)) print("TAG:{}".format(self.tag)) print("INTRODUCE:{}".format(self.introduce)) print("SING_NUM:{}".format(self.sing_num)) print("SING_NAME:{}".format(self.sing_name)) class Website: def __init__(self, searchUrl, resultUrl, pUrl, absoluterUrl, nameT, creatorT, playT, collectT, transmitT, commentT, tagT, introduceT, sing_numT, sing_nameT): self.resultUrl = resultUrl self.searchUrl = searchUrl self.absoluterUrl = absoluterUrl self.pUrl = pUrl self.nameT = nameT self.creatorT = creatorT self.playT = playT self.collectT = collectT self.transmitT = transmitT self.commentT = commentT self.tagT = tagT self.introduceT = introduceT self.sing_numT = sing_numT self.sing_nameT = sing_nameT爬取类 Crawler from bs4 import BeautifulSoup import re import requests import time import random import xlwt #进行excel操作 class Crawler: #爬取网页函数 def getWeb(self, url): try: #异常处理 #请求头 headers_ = {'User-Agent':'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_9_5) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.95 Safari/537.36', 'Accept':'text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,*/*;q=0.8'} req = requests.get(url, headers = headers_) req.encoding = "utf-8" #网页格式化,避免出现乱码 except requests.exceptions.RequestException: return None return BeautifulSoup(req.text, "html.parser") #爬取所需内容的函数 def getContent(self, pageObj, selector): childObj = pageObj.select(selector) # print("\n".join(line.text for line in childObj)) return "\n".join(line.text for line in childObj) #搜索函数,主函数 def search(self, topic, site): # 爬取某种风格的歌单有多少页 newurl = site.searchUrl + topic newurl = requests.utils.quote(newurl, safe=':/?=&') #对url链接上存在的中文字符进行处理 bs = self.getWeb(newurl) result = bs.select('#m-pl-pager > div > a:nth-child(11)') num = int("\n".join(link.text for link in result)) #某种风格歌单的页数 # 翻页,选取一种歌曲风格,有多个页面加载歌单,分别读取 for i in range(0, num+1): j = 35*i url = site.searchUrl + topic + '&limit=35&offset=' + str(j) #构造每个页面的url链接 url = requests.utils.quote(url, safe=':/?=&') bs = self.getWeb(url) searchResults = bs.select(site.resultUrl) for link in searchResults: url = link.attrs["href"] # 判断是否为绝对链接 if(site.absoluterUrl): bs = self.getWeb(url) else: bs = self.getWeb(site.pUrl + url) # print(site.pUrl + url) if(bs is None): print("something was wrong with that page or URL. Skipping") return else: #爬取歌曲名称 main = bs.find('ul',{'class':'f-hide'}) sing_name = "\n".join(music.text for music in main.find_all('a')) # 爬取相关内容 data = [] #申请一个数组,以歌单为单位,存储每个歌单里面所需要的内容 url = site.pUrl + url data.append(url) # print(data) # 加入一个参数,判断目前读取的数据是字符串还是整数 name = self.getContent(bs, site.nameT) data.append(name) creator = self.getContent(bs, site.creatorT) data.append(creator) play = self.getContent(bs, site.playT) data.append(play) collect = self.getContent(bs, site.collectT) data.append(collect) transmit = self.getContent(bs, site.transmitT) data.append(transmit) comment = self.getContent(bs, site.commentT) data.append(comment) tag = self.getContent(bs, site.tagT) data.append(tag) introduce = self.getContent(bs, site.introduceT) data.append(introduce) sing_num = self.getContent(bs, site.sing_numT) data.append(sing_num) # sing_name = self.getContent(bs, site.sing_nameT) data.append(sing_name) datalist.append(data) #以歌单为单位存入数组中 # print(datalist) content = Content(url, name, creator, play, collect, transmit, comment, tag, introduce, sing_num, sing_name) # content.print() # return datalist #数据写入文档 def saveData(self, datalist, savepath): print("保存到Excel文件中!") # xlwt.Workbook用来创建一个工作表,style_compression=0表示是否被压缩 music = xlwt.Workbook(encoding = 'utf-8', style_compression=0) # 添加sheet表格,并允许重复修改 sheet = music.add_sheet('网易云音乐数据爬取', cell_overwrite_ok=True) # 定义列名 col = ("url", "歌单名称", "创建者", "播放量", "收藏量", "转发量", "评论量", "标签", "介绍", "歌曲数量", "歌曲名称" ) for i in range(0,11): sheet.write(0, i, col[i]) #将列名写进表格 for i in range(0, len(datalist)-1): # print("第{}行正在写入".format(i+1)) data = datalist[i] for j in range(0, 11): sheet.write(i+1, j, data[j]) music.save('E:/新建文件夹/Python爬虫/网易云音乐.xls') print("数据保存成功!") crawler = Crawler() # searchUrl, resultUrl, pUrl, absoluterUrl, nameT, creatorT, playT, collectT, transmitT, # commentT, tagT, introduceT, sing_numT, sing_nameT #对应website类的参数,将website定义的参数进行实例化 siteData = [['https://music.163.com/discover/playlist/?cat=', 'a.msk', 'https://music.163.com', False, 'div.tit h2.f-ff2.f-brk', 'span.name a', 'strong#play-count', 'a.u-btni.u-btni-fav i', 'a.u-btni.u-btni-share i', '#cnt_comment_count', 'div.tags.f-cb a i', 'p#album-desc-more', 'div.u-title.u-title-1.f-cb span.sub.s-fc3', 'span.txt a b']] sites = [] datalist = [] for row in siteData: sites.append(Website(row[0], row[1], row[2], row[3], row[4], row[5], row[6], row[7], row[8], row[9], row[10], row[11], row[12], row[13])) topics = "华语" #选择自己想要的歌曲风格 time.sleep(random.random()*3) for targetSite in sites: crawler.search(topics, targetSite) savepath = '网易云音乐.xls' crawler.saveData(datalist, savepath) 爬取结果爬取的结果 可视化代码 import pandas as pd from pyecharts.charts import Pie #画饼图 from pyecharts.charts import Bar #画柱形图 from pyecharts import options as opts import matplotlib.pyplot as plt # 读入数据,需要更改 #可视化 data = pd.read_excel('网易云音乐.xls') #根据播放量排序,只取前十个 df = data.sort_values('播放量',ascending=False).head(10) v = df['歌单名称'].values.tolist() #tolist()将数据转换为列表形式 d = df['播放量'].values.tolist() #设置颜色 color_series = ['#2C6BA0','#2B55A1','#2D3D8E','#44388E','#6A368B' '#7D3990','#A63F98','#C31C88','#D52178','#D5225B'] # 实例化Pie类 pie1 = Pie(init_opts=opts.InitOpts(width='1350px', height='750px')) # 设置颜色 pie1.set_colors(color_series) # 添加数据,设置饼图的半径,是否展示成南丁格尔图 pie1.add("", [list(z) for z in zip(v, d)], radius=["30%", "135%"], center=["50%", "65%"], rosetype="area" ) # 设置全局配置项 # TitleOpts标题配置项 # LegendOpts图例配置项 is_show是否显示图例组件 # ToolboxOpts()工具箱配置项 默认项为显示工具栏组件 pie1.set_global_opts(title_opts=opts.TitleOpts(title='播放量top10歌单'), legend_opts=opts.LegendOpts(is_show=False), toolbox_opts=opts.ToolboxOpts()) # 设置系列配置项 # LabelOpts标签配置项 is_show是否显示标签; font_size字体大小; # position="inside"标签的位置,文字显示在图标里面; font_style文字风格 # font_family文字的字体系列 pie1.set_series_opts(label_opts=opts.LabelOpts(is_show=True, position="inside", font_size=12, formatter="{b}:{c}播放量", font_style="italic", font_weight="bold", font_family="Microsoft YaHei" ), ) # 生成html文档 pie1.render("E:/玫瑰图.html") print("玫瑰图保存成功!") print("-----"*15) # print(df['创建者'].values.tolist()) bar = ( Bar() .add_xaxis([i for i in df['创建者'].values.tolist()]) .add_yaxis('播放量排名前十对应的评论量', df['评论量'].values.tolist()) ) bar.render("E:/条形图.html") print("柱形图保存成功!")词云代码 import wordcloud import pandas as pd import numpy as np data = pd.read_excel('网易云音乐.xls') #根据播放量排序,只取前十个 data = data.sort_values('播放量',ascending=False).head(10) print(data["歌单名称"]) #font_path指明用什么样的字体风格,这里用的是电脑上都有的微软雅黑 w1 = wordcloud.WordCloud(width=1000,height=700, background_color='white', font_path='msyh.ttc') txt = "\n".join(i for i in data['歌单名称']) w1.generate(txt) w1.to_file('E:\\词云.png')`玫瑰图 柱形图 结束,有兴趣的朋友可以来交流一下,这期的内容就到这了,大家晚安,拜拜! |

【本文地址】

今日新闻 |

推荐新闻 |

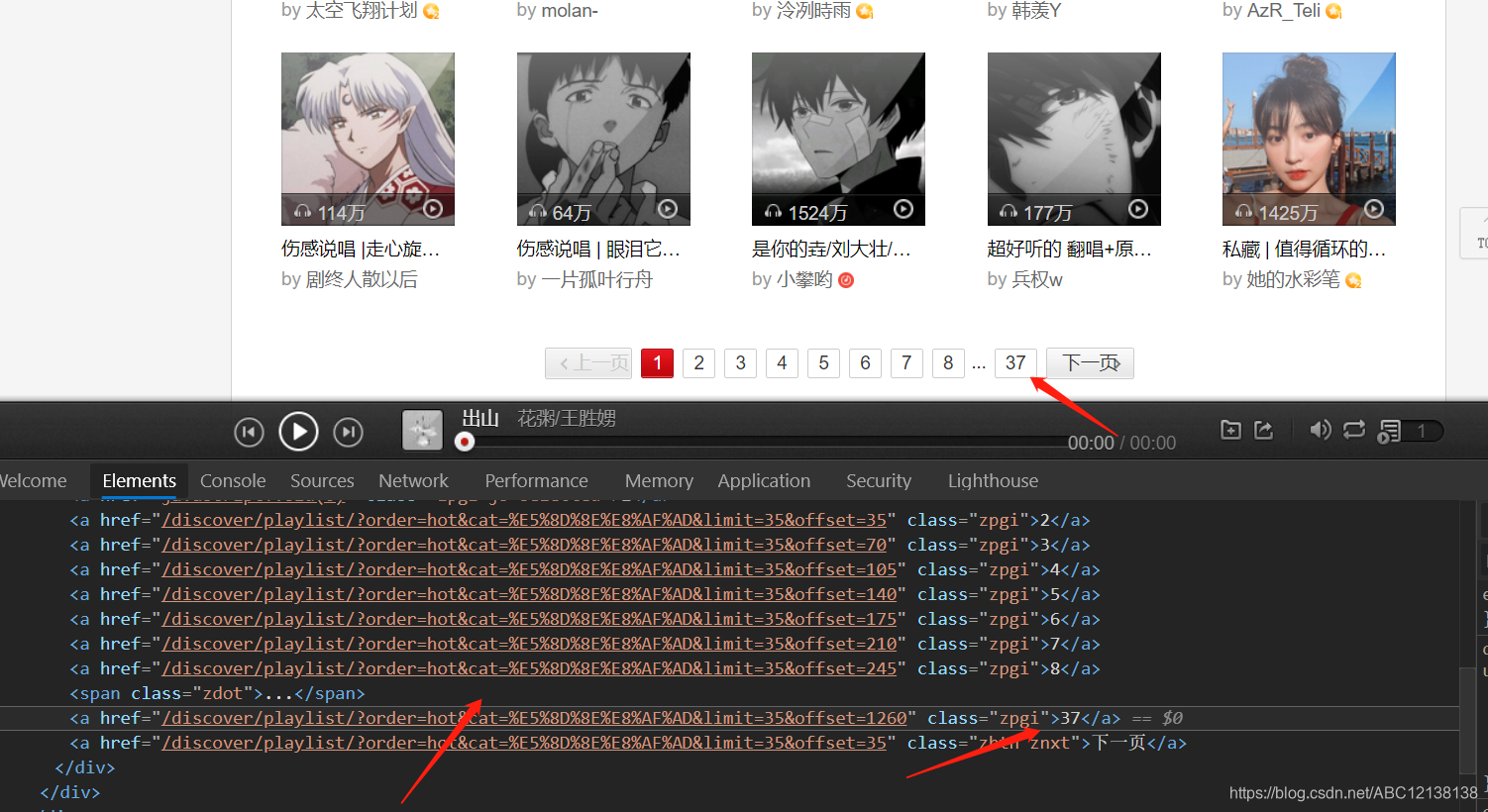

华语风格的歌单总共有37页,每页有35个歌单,那总共大约有1295个歌单。一个风格的歌单是代表不了全部的,我们在做爬虫的时候要避免以偏概全,多看一个页面,找出规律,这样才能写出结构化的爬虫,当网页的内容发生变化,但总体框架没有变化时,我们的代码就能继续运行,这也是考验代码健壮性的一方面(跑偏了)。 在选择其他歌单类别后,可以看到每个类别的歌单基本都是用37或38个页面来存放歌单,每个页面有35个歌单,那如何历遍每一个页面呢? 我当时面对这个问题的时候也是想了很久,又不想用selenium模拟点击,那我们就要多观察源代码,看看有没有蛛丝马迹。

华语风格的歌单总共有37页,每页有35个歌单,那总共大约有1295个歌单。一个风格的歌单是代表不了全部的,我们在做爬虫的时候要避免以偏概全,多看一个页面,找出规律,这样才能写出结构化的爬虫,当网页的内容发生变化,但总体框架没有变化时,我们的代码就能继续运行,这也是考验代码健壮性的一方面(跑偏了)。 在选择其他歌单类别后,可以看到每个类别的歌单基本都是用37或38个页面来存放歌单,每个页面有35个歌单,那如何历遍每一个页面呢? 我当时面对这个问题的时候也是想了很久,又不想用selenium模拟点击,那我们就要多观察源代码,看看有没有蛛丝马迹。

在源代码中,我们可以看到每个页面对应的链接是有规律的,

在源代码中,我们可以看到每个页面对应的链接是有规律的, 进入每一个页面,获取该页面的每一个歌单,进入单个歌单中,歌单名称,创建者,播放量等数据都存放在网页的同一个div内,

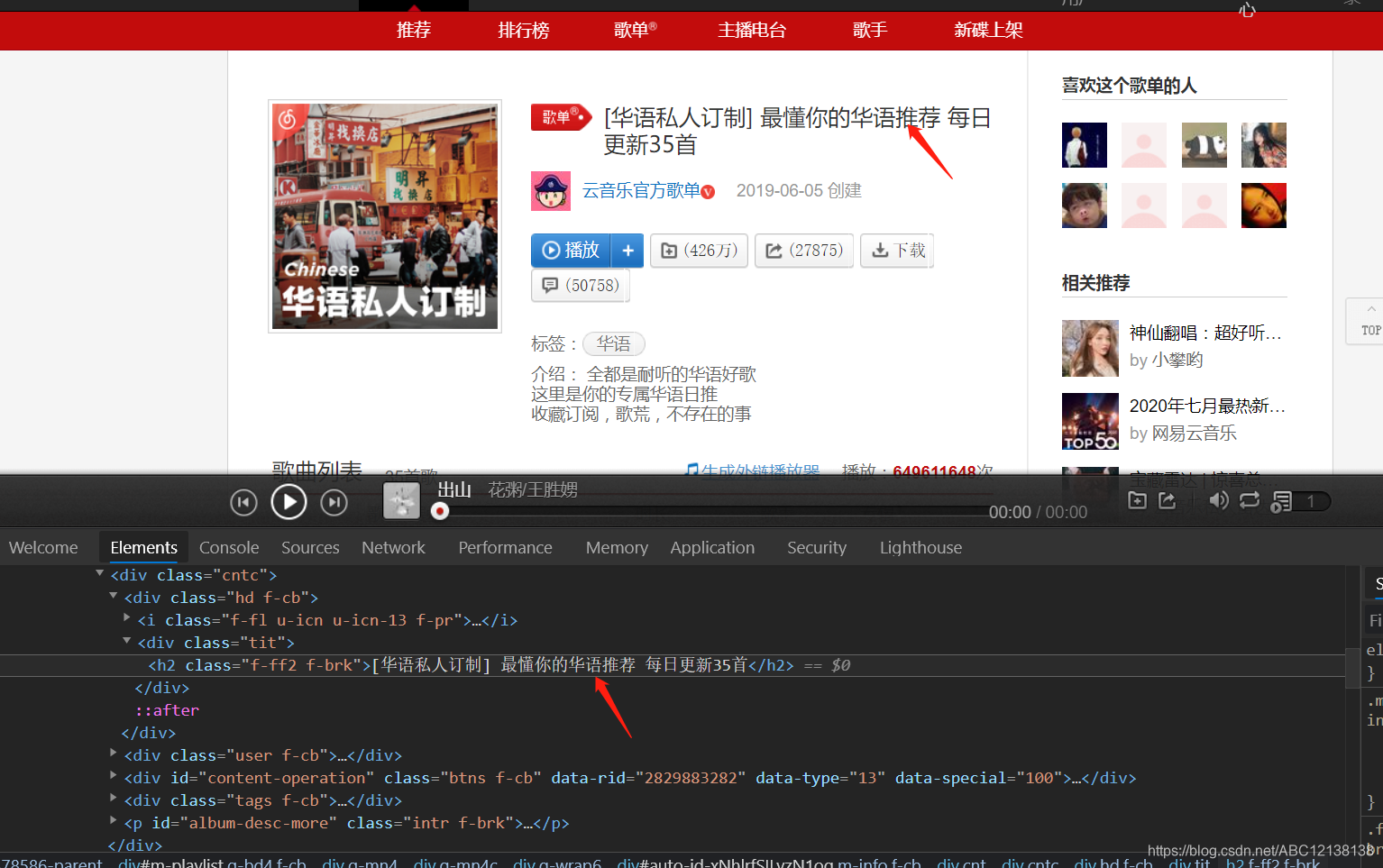

进入每一个页面,获取该页面的每一个歌单,进入单个歌单中,歌单名称,创建者,播放量等数据都存放在网页的同一个div内, 由于数据太多了,这里就只截取了一部分,有兴趣可以自己运行一下;

由于数据太多了,这里就只截取了一部分,有兴趣可以自己运行一下;

词云

词云