神经正切核,深度学习理论研究的最新热点? |

您所在的位置:网站首页 › pinn是什么意思 › 神经正切核,深度学习理论研究的最新热点? |

神经正切核,深度学习理论研究的最新热点?

|

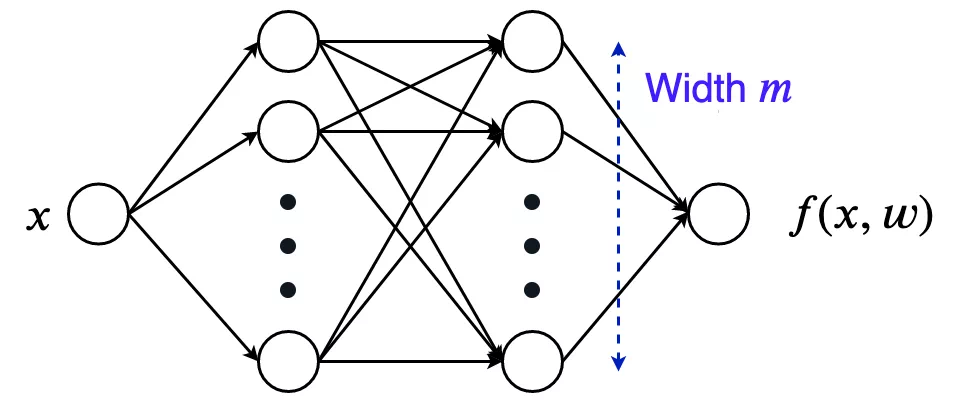

想理解神经网络的训练动态过程,不妨从「神经正切核」入手。那么什么是神经正切核,核机制如何运行?就读于印度理工学院马德拉斯分校电气工程系的 Rajat Vadiraj Dwaraknath 撰文介绍了这一概念。 选自Rajat's Blog,作者:Rajat Vadiraj Dwaraknath,机器之心编译,参与:魔王。 博客地址:https://rajatvd.github.io/NTK/文章动图地址:https://github.com/rajatvd/NTK神经正切核相关论文地址:https://arxiv.org/abs/1806.07572 这张动图展示了神经网络的训练动态过程。阅读本文,你将了解其背后原理。 这张动图展示了神经网络的训练动态过程。阅读本文,你将了解其背后原理。近期大量理论深度学习论文从无限宽度极限(infinite-width limit)入手分析神经网络。首先,无限宽度极限可能看起来不切实际,甚至没有研究意义。但是,无限宽度极限下的神经网络可以简化为具备神经正切核(neural tangent kernel,NTK)的线性模型。这样我们就可以很容易地研究梯度下降了。起初它看起来很有前景,但是实验结果证明,无限宽度极限下的神经网络效果不如实际的超参数网络。不过,这仍然为神经网络训练的某些方面提供了理论视角,值得我们继续探索。 此外,神经正切核可在更宽泛的标准下出现(这取决于模型的规模),且无需无限宽度极限条件。本文简单直观地介绍了该理论,它可作为梯度下降收敛性证明。为方便可视化,本文使用简单的一维示例,帮助读者更轻松地理解该理论。 设置 我们首先来看以下一个非常简单的例子,理解该示例之后再将其泛化。我们看到一个一维输入和一维输出网络。这个简单的 relu 网络有两个隐藏层,宽度为 m。  我们将使用这个简单的一维模型进行初始试验。 我们将使用这个简单的一维模型进行初始试验。我们将该网络函数寻求随机初始化的过程画出来: |

【本文地址】

今日新闻 |

推荐新闻 |