PCA(主成分分析)降维:找使得方差最大的投影方向 |

您所在的位置:网站首页 › pca降维维度怎么选择 › PCA(主成分分析)降维:找使得方差最大的投影方向 |

PCA(主成分分析)降维:找使得方差最大的投影方向

|

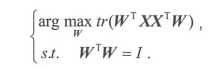

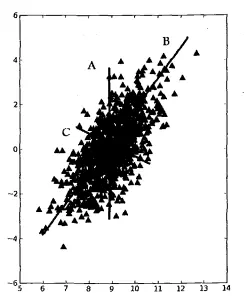

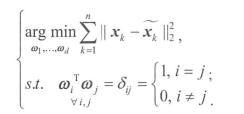

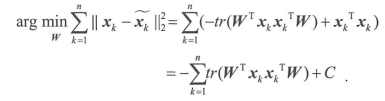

本质:去掉数据中没什么用处的信息,减少维度。 方法:找到一个方向,使得数据在这些投影方向上的方差最大。计算原始数据在这些正交基上投影的方差,方差越大,就说明在对应正交基上包含了更多的信息量。这个方向就是主成分。 可以用numpy实现对数据的降维,利用数据的特征值和特征向量。 例如:一个100*4(性别;颜值;身高;收入)维的矩阵,PCA降维就是保留差别最大的那几列。假设性别都为女,对特征没影响就去掉;假设收入这一列差别特别大,就要保留这一列。 例如: 一个1004(性别;颜值;身高;收入)维的矩阵,经过PCA降维成1002的矩阵的过程: 对每一列求一个特征值,按照降序排列,去掉最后两列,就变成100*2的了。可能只剩下身高和收入了。 PCA 还能从回归的角度求解问题。顺着这个思路 , 在高维空间中 , 我们实际上是要找到 一个 d 维超平 面,使得数据点到这个超平面的距离平方和最小 。 以 d= l 为例,超平面退化为直线 , 即把样本点投影到最佳直线,最小化的就是所有点到直线的距离平方之。目标函数为: |

【本文地址】

方法:(把n维的降维成k维) 1.去掉均值 2.计算协方差矩阵的特征值和特征向量;特征值代表重要程度。 3.保留最大的k个特征值对应的特征向量 4.把数据转化到上述特征向量构建的新空间

方法:(把n维的降维成k维) 1.去掉均值 2.计算协方差矩阵的特征值和特征向量;特征值代表重要程度。 3.保留最大的k个特征值对应的特征向量 4.把数据转化到上述特征向量构建的新空间

等价于:

等价于: