k8s之Pod详解(五)【Kubernetes(K8S) 入门进阶实战完整教程,黑马程序员K8S全套教程(基础+高级)】 |

您所在的位置:网站首页 › k8s入门进阶实战 › k8s之Pod详解(五)【Kubernetes(K8S) 入门进阶实战完整教程,黑马程序员K8S全套教程(基础+高级)】 |

k8s之Pod详解(五)【Kubernetes(K8S) 入门进阶实战完整教程,黑马程序员K8S全套教程(基础+高级)】

|

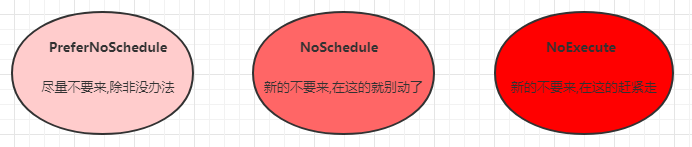

参考于Kubernetes(K8S) 入门进阶实战完整教程,黑马程序员K8S全套教程(基础+高级) PodPod的结构 `在这里,可通过一个命令来查看每种资源的可配置项 kubectl explain 资源类型 查看某种资源可以配置的一级属性 kubectl explain 资源类型.属性 查看属性的子属性 apiVersion: v1 #必选,版本号,例如v1 kind: Pod #必选,资源类型,例如 Pod metadata: #必选,元数据 name: string #必选,Pod名称 namespace: string #Pod所属的命名空间,默认为"default" labels: #自定义标签列表 - name: string spec: #必选,Pod中容器的详细定义 containers: #必选,Pod中容器列表 - name: string #必选,容器名称 image: string #必选,容器的镜像名称 imagePullPolicy: [ Always|Never|IfNotPresent ] #获取镜像的策略 command: [string] #容器的启动命令列表,如不指定,使用打包时使用的启动命令 args: [string] #容器的启动命令参数列表 workingDir: string #容器的工作目录 volumeMounts: #挂载到容器内部的存储卷配置 - name: string #引用pod定义的共享存储卷的名称,需用volumes[]部分定义的的卷名 mountPath: string #存储卷在容器内mount的绝对路径,应少于512字符 readOnly: boolean #是否为只读模式 ports: #需要暴露的端口库号列表 - name: string #端口的名称 containerPort: int #容器需要监听的端口号 hostPort: int #容器所在主机需要监听的端口号,默认与Container相同 protocol: string #端口协议,支持TCP和UDP,默认TCP env: #容器运行前需设置的环境变量列表 - name: string #环境变量名称 value: string #环境变量的值 resources: #资源限制和请求的设置 limits: #资源限制的设置 cpu: string #Cpu的限制,单位为core数,将用于docker run --cpu-shares参数 memory: string #内存限制,单位可以为Mib/Gib,将用于docker run --memory参数 requests: #资源请求的设置 cpu: string #Cpu请求,容器启动的初始可用数量 memory: string #内存请求,容器启动的初始可用数量 lifecycle: #生命周期钩子 postStart: #容器启动后立即执行此钩子,如果执行失败,会根据重启策略进行重启 preStop: #容器终止前执行此钩子,无论结果如何,容器都会终止 livenessProbe: #对Pod内各容器健康检查的设置,当探测无响应几次后将自动重启该容器 exec: #对Pod容器内检查方式设置为exec方式 command: [string] #exec方式需要制定的命令或脚本 httpGet: #对Pod内个容器健康检查方法设置为HttpGet,需要制定Path、port path: string port: number host: string scheme: string HttpHeaders: - name: string value: string tcpSocket: #对Pod内个容器健康检查方式设置为tcpSocket方式 port: number initialDelaySeconds: 0 #容器启动完成后首次探测的时间,单位为秒 timeoutSeconds: 0 #对容器健康检查探测等待响应的超时时间,单位秒,默认1秒 periodSeconds: 0 #对容器监控检查的定期探测时间设置,单位秒,默认10秒一次 successThreshold: 0 failureThreshold: 0 securityContext: privileged: false restartPolicy: [Always | Never | OnFailure] #Pod的重启策略 nodeName: #设置NodeName表示将该Pod调度到指定到名称的node节点上 nodeSelector: obeject #设置NodeSelector表示将该Pod调度到包含这个label的node上 imagePullSecrets: #Pull镜像时使用的secret名称,以key:secretkey格式指定 - name: string hostNetwork: false #是否使用主机网络模式,默认为false,如果设置为true,表示使用宿主机网络 volumes: #在该pod上定义共享存储卷列表 - name: string #共享存储卷名称 (volumes类型有很多种) emptyDir: {} #类型为emtyDir的存储卷,与Pod同生命周期的一个临时目录。为空值 hostPath: string #类型为hostPath的存储卷,表示挂载Pod所在宿主机的目录 path: string #Pod所在宿主机的目录,将被用于同期中mount的目录 secret: #类型为secret的存储卷,挂载集群与定义的secret对象到容器内部 scretname: string items: - key: string path: string configMap: #类型为configMap的存储卷,挂载预定义的configMap对象到容器内部 name: string items: - key: string path: string在K8S资源中一级属性都是一样的,主要包括5部分: apiVersion kubernetes内部定义,版本号必须可以用 kubectl api-resources 查询到kind 类型 kubernetes内部定义,版本号必须可以用 kubectl api-resources 查询到metadata 元数据 主要是资源标识和说明,常用的有name、namespace、labels等spec 描述 最重要的一部分,里面是对各种资源配置的详细描述status 状态信息Pod.spec 常见的子属性 containers 定义容器的详细信息nodeName 指定调度到哪一个节点上运行nodeName 根据NodeSelector中定义的信息选择将该Pod调度到包含这些label的节点 上hostNetwork 是否使用主机网络,默认为falsevolumes 定义Pod上挂载的存储信息restartPolicy 表示Pod遇到故障时的重启策略 Pod.spec.containers配置 [root@k8s-master01 ~]# kubectl explain pod.spec.containers KIND: Pod VERSION: v1 RESOURCE: containers # 数组,代表可以有多个容器 FIELDS: name # 容器名称 image # 容器需要的镜像地址 imagePullPolicy # 镜像拉取策略 command # 容器的启动命令列表,如不指定,使用打包时使用的启动命令 args # 容器的启动命令需要的参数列表 env # 容器环境变量的配置 ports # 容器需要暴露的端口号列表 resources # 资源限制和资源请求的设置下面定义了一个比较简单Pod的配置,里面有两个容器: nginx: nginx是一个轻量级web容器busybox: busybox是一个小巧的linux命令集合 [root@master ~]# cat pod-nginxbusybx.yaml apiVersion: v1 kind: Pod metadata: name: nginx-busybox namespace: dev spec: containers: - name: nginx image: nginx - name: busybox image: busybox 查看Pod的状态 READY 1/2 : 表示当前Pod中有2个容器,其中1个准备就绪,1个未就绪 RESTARTS : 重启次数,因为有1个容器故障了,Pod一直在重启试图恢复它 [root@master ~]# kubectl get pods -n dev NAME READY STATUS RESTARTS AGE deploy-nginx-58d84955cb-9c4lg 0/1 Terminating 0 58m nginx-busybox 1/2 Running 3 2m12s 查看内部的详情 Back-off restarting failed container可以知道,容器在不断重启。这是因为busybox是一个命令集合的容器,后台运行没有东西运行,容器就会马上停掉! 解决:修改yaml文件,添加 command: [“/bin/sh”,“-c”,“touch /tmp/hello.txt;while true;do /bin/echo $(date +%T) >> /tmp/hello.txt; sleep 3; done;”],运行kubectl apply -f pod-nginxbusybx.yaml就好了 [root@master ~]# kubectl describe pod nginx-busybox -n dev Name: nginx-busybox Namespace: dev Priority: 0 Node: node02/192.168.0.19 Start Time: Mon, 09 May 2022 17:21:04 +0800 Labels: Annotations: Status: Running IP: 10.20.2.15 IPs: IP: 10.20.2.15 Containers: nginx: Container ID: docker://eafa1c39dafe1d2116224a7f659bef5c0de429537b9465c2d7bb7f26412d778b Image: nginx Image ID: docker-pullable://nginx@sha256:0d17b565c37bcbd895e9d92315a05c1c3c9a29f762b011a10c54a66cd53c9b31 Port: Host Port: State: Running Started: Mon, 09 May 2022 17:21:21 +0800 Ready: True Restart Count: 0 Environment: Mounts: /var/run/secrets/kubernetes.io/serviceaccount from default-token-6tdz4 (ro) busybox: Container ID: docker://865ffc85c4fc5f2fd45d2c275bd144d80aef37562db7857cca87ecdca9e7735a Image: busybox Image ID: docker-pullable://busybox@sha256:5acba83a746c7608ed544dc1533b87c737a0b0fb730301639a0179f9344b1678 Port: Host Port: State: Terminated Reason: Completed Exit Code: 0 Started: Mon, 09 May 2022 17:25:35 +0800 Finished: Mon, 09 May 2022 17:25:35 +0800 Last State: Terminated Reason: Completed Exit Code: 0 Started: Mon, 09 May 2022 17:24:05 +0800 Finished: Mon, 09 May 2022 17:24:05 +0800 Ready: False Restart Count: 5 Environment: Mounts: /var/run/secrets/kubernetes.io/serviceaccount from default-token-6tdz4 (ro) Conditions: Type Status Initialized True Ready False ContainersReady False PodScheduled True Volumes: default-token-6tdz4: Type: Secret (a volume populated by a Secret) SecretName: default-token-6tdz4 Optional: false QoS Class: BestEffort Node-Selectors: Tolerations: node.kubernetes.io/not-ready:NoExecute for 300s node.kubernetes.io/unreachable:NoExecute for 300s Events: Type Reason Age From Message ---- ------ ---- ---- ------- Normal Scheduled 4m35s default-scheduler Successfully assigned dev/nginx-busybox to node02 Normal Pulling 4m34s kubelet, node02 Pulling image "nginx" Normal Pulled 4m19s kubelet, node02 Successfully pulled image "nginx" Normal Created 4m18s kubelet, node02 Created container nginx Normal Started 4m18s kubelet, node02 Started container nginx Normal Pulling 2m49s (x4 over 4m18s) kubelet, node02 Pulling image "busybox" Normal Pulled 2m33s (x4 over 4m1s) kubelet, node02 Successfully pulled image "busybox" Normal Created 2m33s (x4 over 4m1s) kubelet, node02 Created container busybox Normal Started 2m33s (x4 over 4m1s) kubelet, node02 Started container busybox Warning BackOff 2m32s (x5 over 3m44s) kubelet, node02 Back-off restarting failed container镜像拉取策略(imagepullpolicy) kubernetes支持配置三种拉取策略: Always:总是从远程仓库拉取镜像(一直远程下载)IfNotPresent:本地有则使用本地镜像,本地没有则从远程仓库拉取镜像(本地有就本地 本地没远程下载)默认使用这个Never:只使用本地镜像,从不去远程仓库拉取,本地没有就报错 (一直使用本地) [root@master ~]# cat pod-nginxbusybx.yaml apiVersion: v1 kind: Pod metadata: name: nginx-busybox namespace: dev spec: containers: - name: nginx image: nginx:1.17.3 imagePullPolicy: Never # 用于设置镜像拉取策略 - name: busybox image: busybox # 创建Pod [root@master ~]# kubectl create -f pod-nginxbusybx.yaml pod/nginx-busybox created # 查看Pod详情 # 此时明显可以看到nginx镜像有一步Pulling image "nginx:1.17.3" 的过程 [root@master ~]# kubectl describe pods nginx-busybox -n dev Events: Type Reason Age From Message ---- ------ ---- ---- ------- Normal Scheduled 31s default-scheduler Successfully assigned dev/nginx-busybox to node01 Normal Pulling 13s (x2 over 30s) kubelet, node01 Pulling image "busybox" Normal Pulled 12s (x2 over 14s) kubelet, node01 Successfully pulled image "busybox" Normal Created 12s (x2 over 14s) kubelet, node01 Created container busybox Normal Started 12s (x2 over 14s) kubelet, node01 Started container busybox Warning InspectFailed 10s (x4 over 30s) kubelet, node01 Failed to apply default image tag "nginx\"1.17.3": couldn't parse image reference "nginx\"1.17.3": invalid reference format Warning Failed 10s (x4 over 30s) kubelet, node01 Error: InvalidImageName Warning BackOff 10s (x2 over 11s) kubelet, node01 Back-off restarting failed container启动命令和进入Pod内的容器 kubectl exec pod名称 -n 命名空间 -it -c 容器名称 /bin/shcommand,用于在pod中的容器初始化完毕之后运行一个命令。 command 命令的意思: “/bin/sh”,“-c”, 使用sh执行命令 touch /tmp/hello.txt; 创建一个/tmp/hello.txt 文件 while true;do /bin/echo $(date +%T) >> /tmp/hello.txt; sleep 3; done; 每隔3秒向文件中写入当前时间 [root@master ~]# cat pod-nginxbusybx.yaml apiVersion: v1 kind: Pod metadata: name: nginx-busybox namespace: dev spec: containers: - name: nginx image: nginx - name: busybox image: busybox command: ["/bin/sh","-c","touch /tmp/hello.txt;while true;do /bin/echo $(date +%T) >> /tmp/hello.txt; sleep 3; done;"] # 创建Pod [root@master ~]# kubectl create -f pod-nginxbusybx.yaml pod/nginx-busybox created # 进入Pod,查看文件的内容 [root@master ~]# kubectl exec nginx-busybox -n dev -it -c busybox /bin/sh / # cat /tmp/hello.txt 10:23:02 10:23:05 10:23:08注意: 通过上面发现command已经可以完成启动命令和传递参数的功能,为什么这里还要提供一个args选项,用于传递参数呢?这其实跟docker有点关系,kubernetes中的command、args两项其实是实现覆盖Dockerfile中ENTRYPOINT的功能。 1 如果command和args均没有写,那么用Dockerfile的配置。2 如果command写了,但args没有写,那么Dockerfile默认的配置会被忽略,执行输入的command3 如果command没写,但args写了,那么Dockerfile中配置的ENTRYPOINT的命令会被执行,使用当前args的参数4 如果command和args都写了,那么Dockerfile的配置被忽略,执行command并追加上args参数环境变量 [root@master ~]# cat pod-nginxbusybx.yaml apiVersion: v1 kind: Pod metadata: name: nginx-busybox namespace: dev spec: containers: - name: nginx image: nginx - name: busybox image: busybox command: ["/bin/sh","-c","touch /tmp/hello.txt;while true;do /bin/echo $(date +%T) >> /tmp/hello.txt; sleep 3; done;"] env: - name: "username" value: "root" - name: "pssword" value: "123456" # apply可以改变的正在运行的容器 [root@master ~]# kubectl apply -f pod-nginxbusybx.yaml pod/nginx-busybox created # 进入Pod的容器,查看变量是否生效 [root@master ~]# kubectl exec nginx-busybox -n dev -it -c busybox /bin/sh / # echo $username root / # echo $pssword 123456 / #端口的设置 先看下ports支持的子选项: [root@k8s-master01 ~]# kubectl explain pod.spec.containers.ports KIND: Pod VERSION: v1 RESOURCE: ports FIELDS: name # 端口名称,如果指定,必须保证name在pod中是唯一的 containerPort # 容器要监听的端口(0 ["pro","yyy"] [root@k8s-master01 ~]# vim pod-nodeaffinity-required.yaml # 再次启动 [root@k8s-master01 ~]# kubectl create -f pod-nodeaffinity-required.yaml pod/pod-nodeaffinity-required created # 此时查看,发现调度成功,已经将pod调度到了node1上 [root@k8s-master01 ~]# kubectl get pods pod-nodeaffinity-required -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE ...... pod-nodeaffinity-required 1/1 Running 0 11s 10.244.1.89 node1 ......preferredDuringSchedulingIgnoredDuringExecution 实验: apiVersion: v1 kind: Pod metadata: name: pod-nodeaffinity-preferred namespace: dev spec: containers: - name: nginx image: nginx:1.17.1 affinity: #亲和性设置 nodeAffinity: #设置node亲和性 preferredDuringSchedulingIgnoredDuringExecution: # 软限制 - weight: 1 preference: matchExpressions: # 匹配env的值在["xxx","yyy"]中的标签(当前环境没有) - key: nodeenv operator: In values: ["pro","yyy"] # 创建pod [root@k8s-master01 ~]# kubectl create -f pod-nodeaffinity-preferred.yaml pod/pod-nodeaffinity-preferred created # 查看pod状态 (运行成功) [root@k8s-master01 ~]# kubectl get pod pod-nodeaffinity-preferred -n dev NAME READY STATUS RESTARTS AGE pod-nodeaffinity-preferred 1/1 Running 0 40sNodeAffinity规则设置的注意事项: 1 如果同时定义了nodeSelector和nodeAffinity,那么必须两个条件都得到满足,Pod才能运行在指定的Node上 2 如果nodeAffinity指定了多个nodeSelectorTerms,那么只需要其中一个能够匹配成功即可 3 如果一个nodeSelectorTerms中有多个matchExpressions ,则一个节点必须满足所有的才能匹配成功 4 如果一个pod所在的Node在Pod运行期间其标签发生了改变,不再符合该Pod的节点亲和性需求,则系统将忽略此变化 PodAffinity PodAffinity主要实现以运行的Pod为参照,实现让新创建的Pod跟参照pod在一个区域的功能。 首先来看一下PodAffinity的可配置项: pod.spec.affinity.podAffinity requiredDuringSchedulingIgnoredDuringExecution 硬限制 namespaces 指定参照pod的namespace topologyKey 指定调度作用域 labelSelector 标签选择器 matchExpressions 按节点标签列出的节点选择器要求列表(推荐) key 键 values 值 operator 关系符 支持In, NotIn, Exists, DoesNotExist. matchLabels 指多个matchExpressions映射的内容 preferredDuringSchedulingIgnoredDuringExecution 软限制 podAffinityTerm 选项 namespaces topologyKey labelSelector matchExpressions key 键 values 值 operator matchLabels weight 倾向权重,在范围1-100 topologyKey用于指定调度时作用域,例如: 如果指定为kubernetes.io/hostname,那就是以Node节点为区分范围 如果指定为beta.kubernetes.io/os,则以Node节点的操作系统类型来区分实验下requiredDuringSchedulingIgnoredDuringExecution, 首先创建一个参照Pod,pod-podaffinity-target.yaml: apiVersion: v1 kind: Pod metadata: name: pod-podaffinity-target namespace: dev labels: podenv: pro #设置标签 spec: containers: - name: nginx image: nginx:1.17.1 nodeName: node1 # 将目标pod名确指定到node1上 # 启动目标pod [root@k8s-master01 ~]# kubectl create -f pod-podaffinity-target.yaml pod/pod-podaffinity-target created # 查看pod状况 [root@k8s-master01 ~]# kubectl get pods pod-podaffinity-target -n dev NAME READY STATUS RESTARTS AGE pod-podaffinity-target 1/1 Running 0 4s创建pod-podaffinity-required.yaml apiVersion: v1 kind: Pod metadata: name: pod-podaffinity-required namespace: dev spec: containers: - name: nginx image: nginx:1.17.1 affinity: #亲和性设置 podAffinity: #设置pod亲和性 requiredDuringSchedulingIgnoredDuringExecution: # 硬限制 - labelSelector: matchExpressions: # 匹配env的值在["xxx","yyy"]中的标签 - key: podenv operator: In values: ["xxx","yyy"] topologyKey: kubernetes.io/hostname上面配置表达的意思是:新Pod必须要与拥有标签nodeenv=xxx或者nodeenv=yyy的pod在同一Node上,显然现在没有这样pod,接下来,运行测试一下。 # 启动pod [root@k8s-master01 ~]# kubectl create -f pod-podaffinity-required.yaml pod/pod-podaffinity-required created # 查看pod状态,发现未运行 [root@k8s-master01 ~]# kubectl get pods pod-podaffinity-required -n dev NAME READY STATUS RESTARTS AGE pod-podaffinity-required 0/1 Pending 0 9s # 查看详细信息 [root@k8s-master01 ~]# kubectl describe pods pod-podaffinity-required -n dev ...... Events: Type Reason Age From Message ---- ------ ---- ---- ------- Warning FailedScheduling default-scheduler 0/3 nodes are available: 2 node(s) didn't match pod affinity rules, 1 node(s) had taints that the pod didn't tolerate. # 接下来修改 values: ["xxx","yyy"]----->values:["pro","yyy"] # 意思是:新Pod必须要与拥有标签nodeenv=xxx或者nodeenv=yyy的pod在同一Node上 [root@k8s-master01 ~]# vim pod-podaffinity-required.yaml # 然后重新创建pod,查看效果 [root@k8s-master01 ~]# kubectl delete -f pod-podaffinity-required.yaml pod "pod-podaffinity-required" de leted [root@k8s-master01 ~]# kubectl create -f pod-podaffinity-required.yaml pod/pod-podaffinity-required created # 发现此时Pod运行正常 [root@k8s-master01 ~]# kubectl get pods pod-podaffinity-required -n dev NAME READY STATUS RESTARTS AGE LABELS pod-podaffinity-required 1/1 Running 0 6sPodAntiAffinity PodAntiAffinity主要实现以运行的Pod为参照,让新创建的Pod跟参照pod不在一个区域中的功能。 它的配置方式和选项跟PodAffinty是一样的,这里不再做详细解释,直接做一个测试案例。 1)继续使用上个案例中目标pod [root@k8s-master01 ~]# kubectl get pods -n dev -o wide --show-labels NAME READY STATUS RESTARTS AGE IP NODE LABELS pod-podaffinity-required 1/1 Running 0 3m29s 10.244.1.38 node1 pod-podaffinity-target 1/1 Running 0 9m25s 10.244.1.37 node1 podenv=pro2)创建pod-podantiaffinity-required.yaml,内容如下: apiVersion: v1 kind: Pod metadata: name: pod-podantiaffinity-required namespace: dev spec: containers: - name: nginx image: nginx:1.17.1 affinity: #亲和性设置 podAntiAffinity: #设置pod亲和性 requiredDuringSchedulingIgnoredDuringExecution: # 硬限制 - labelSelector: matchExpressions: # 匹配podenv的值在["pro"]中的标签 - key: podenv operator: In values: ["pro"] topologyKey: kubernetes.io/hostname上面配置表达的意思是:新Pod必须要与拥有标签nodeenv=pro的pod不在同一Node上,运行测试一下。 # 创建pod [root@k8s-master01 ~]# kubectl create -f pod-podantiaffinity-required.yaml pod/pod-podantiaffinity-required created # 查看pod # 发现调度到了node2上 [root@k8s-master01 ~]# kubectl get pods pod-podantiaffinity-required -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE .. pod-podantiaffinity-required 1/1 Running 0 30s 10.244.1.96 node2 .. 5.4.3 污点和容忍污点(Taints) 前面的调度方式都是站在Pod的角度上,通过在Pod上添加属性,来确定Pod是否要调度到指定的Node上,其实我们也可以站在Node的角度上,通过在Node上添加污点属性,来决定是否允许Pod调度过来。 Node被设置上污点之后就和Pod之间存在了一种相斥的关系,进而拒绝Pod调度进来,甚至可以将已经存在的Pod驱逐出去。 污点的格式为:key=value:effect, key和value是污点的标签,effect描述污点的作用,支持如下三个选项: PreferNoSchedule:kubernetes将尽量避免把Pod调度到具有该污点的Node上,除非没有其他节点可调度NoSchedule:kubernetes将不会把Pod调度到具有该污点的Node上,但不会影响当前Node上已存在的PodNoExecute:kubernetes将不会把Pod调度到具有该污点的Node上,同时也会将Node上已存在的Pod驱离

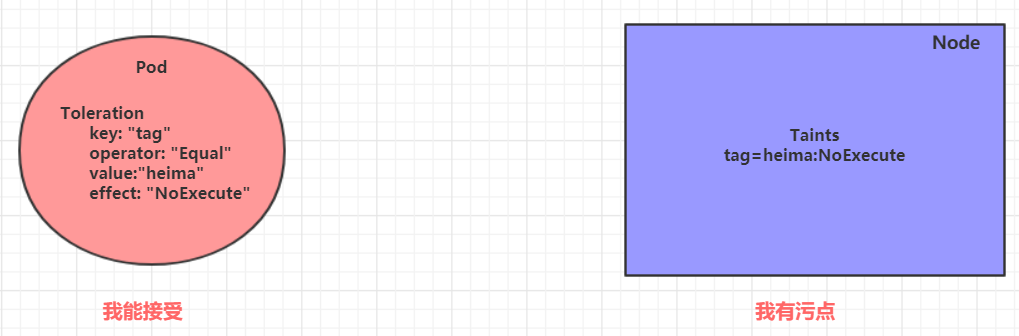

使用kubectl设置和去除污点的命令示例如下: # 设置污点 kubectl taint nodes node1 key=value:effect # 去除污点 kubectl taint nodes node1 key:effect- # 去除所有污点 kubectl taint nodes node1 key-接下来,演示下污点的效果: 准备节点node1(为了演示效果更加明显,暂时停止node2节点)为node1节点设置一个污点: tag=heima:PreferNoSchedule;然后创建pod1( pod1 可以 )修改为node1节点设置一个污点: tag=heima:NoSchedule;然后创建pod2( pod1 正常 pod2 失败 )修改为node1节点设置一个污点: tag=heima:NoExecute;然后创建pod3 ( 3个pod都失败 ) # 为node1设置污点(PreferNoSchedule) [root@k8s-master01 ~]# kubectl taint nodes node1 tag=heima:PreferNoSchedule # 创建pod1 [root@k8s-master01 ~]# kubectl run taint1 --image=nginx:1.17.1 -n dev [root@k8s-master01 ~]# kubectl get pods -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE taint1-7665f7fd85-574h4 1/1 Running 0 2m24s 10.244.1.59 node1 # 为node1设置污点(取消PreferNoSchedule,设置NoSchedule) [root@k8s-master01 ~]# kubectl taint nodes node1 tag:PreferNoSchedule- [root@k8s-master01 ~]# kubectl taint nodes node1 tag=heima:NoSchedule # 创建pod2 [root@k8s-master01 ~]# kubectl run taint2 --image=nginx:1.17.1 -n dev [root@k8s-master01 ~]# kubectl get pods taint2 -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE taint1-7665f7fd85-574h4 1/1 Running 0 2m24s 10.244.1.59 node1 taint2-544694789-6zmlf 0/1 Pending 0 21s # 为node1设置污点(取消NoSchedule,设置NoExecute) [root@k8s-master01 ~]# kubectl taint nodes node1 tag:NoSchedule- [root@k8s-master01 ~]# kubectl taint nodes node1 tag=heima:NoExecute # 创建pod3 [root@k8s-master01 ~]# kubectl run taint3 --image=nginx:1.17.1 -n dev [root@k8s-master01 ~]# kubectl get pods -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED taint1-7665f7fd85-htkmp 0/1 Pending 0 35s taint2-544694789-bn7wb 0/1 Pending 0 35s taint3-6d78dbd749-tktkq 0/1 Pending 0 6s 小提示: 使用kubeadm搭建的集群,默认就会给master节点添加一个污点标记,所以pod就不会调度到master节点上.容忍(Toleration) 上面介绍了污点的作用,我们可以在node上添加污点用于拒绝pod调度上来,但是如果就是想将一个pod调度到一个有污点的node上去,这时候应该怎么做呢?这就要使用到容忍。

污点就是拒绝,容忍就是忽略,Node通过污点拒绝pod调度上去,Pod通过容忍忽略拒绝 下面先通过一个案例看下效果: 上一小节,已经在node1节点上打上了NoExecute的污点,此时pod是调度不上去的本小节,可以通过给pod添加容忍,然后将其调度上去创建pod-toleration.yaml,内容如下 apiVersion: v1 kind: Pod metadata: name: pod-toleration namespace: dev spec: containers: - name: nginx image: nginx:1.17.1 tolerations: # 添加容忍 - key: "tag" # 要容忍的污点的key operator: "Equal" # 操作符 value: "heima" # 容忍的污点的value effect: "NoExecute" # 添加容忍的规则,这里必须和标记的污点规则相同 # 添加容忍之前的pod [root@k8s-master01 ~]# kubectl get pods -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED pod-toleration 0/1 Pending 0 3s # 添加容忍之后的pod [root@k8s-master01 ~]# kubectl get pods -n dev -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED pod-toleration 1/1 Running 0 3s 10.244.1.62 node1下面看一下容忍的详细配置: [root@k8s-master01 ~]# kubectl explain pod.spec.tolerations ...... FIELDS: key # 对应着要容忍的污点的键,空意味着匹配所有的键 value # 对应着要容忍的污点的值 operator # key-value的运算符,支持Equal和Exists(默认) effect # 对应污点的effect,空意味着匹配所有影响 tolerationSeconds # 容忍时间, 当effect为NoExecute时生效,表示pod在Node上的停留时间 |

【本文地址】

今日新闻 |

推荐新闻 |

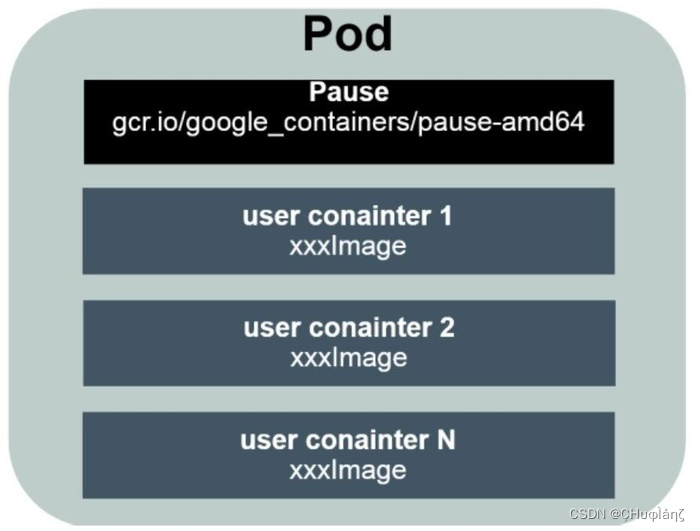

每个Pod中都可以包含一个或者多个容器 这些容器可以分为两类:

每个Pod中都可以包含一个或者多个容器 这些容器可以分为两类: