【Linux】高并发之epoll模型详解 |

您所在的位置:网站首页 › epoll模型原理 › 【Linux】高并发之epoll模型详解 |

【Linux】高并发之epoll模型详解

|

在linux 没有实现epoll事件驱动机制之前,我们一般选择用select或者poll等IO多路复用的方法来实现并发服务程序。在大数据、高并发、集群等一些名词唱得火热之年代,select和poll的用武之地越来越有限,风头已经被epoll占尽。 本文便来介绍epoll的实现机制,并附带讲解一下select和poll。通过对比其不同的实现机制,真正理解为何epoll能实现高并发。

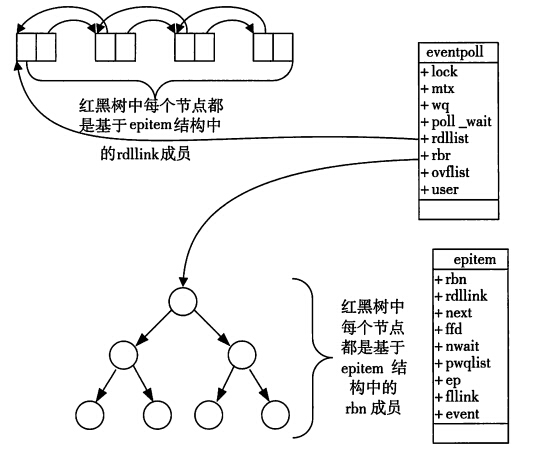

select的缺点: 单个进程能够监视的文件描述符的数量存在最大限制,通常是1024,当然可以更改数量,但由于select采用轮询的方式扫描文件描述符,文件描述符数量越多,性能越差;(在linux内核头文件中,有这样的定义:#define __FD_SETSIZE 1024)内核 / 用户空间内存拷贝问题,select需要复制大量的句柄数据结构,产生巨大的开销;select返回的是含有整个句柄的数组,应用程序需要遍历整个数组才能发现哪些句柄发生了事件;select的触发方式是水平触发,应用程序如果没有完成对一个已经就绪的文件描述符进行IO操作,那么之后每次select调用还是会将这些文件描述符通知进程。相比select模型,poll使用链表保存文件描述符,因此没有了监视文件数量的限制,但其他三个缺点依然存在。 拿select模型为例,假设我们的服务器需要支持100万的并发连接,则在__FD_SETSIZE 为1024的情况下,则我们至少需要开辟1k个进程才能实现100万的并发连接。除了进程间上下文切换的时间消耗外,从内核/用户空间大量的无脑内存拷贝、数组轮询等,是系统难以承受的。因此,基于select模型的服务器程序,要达到10万级别的并发访问,是一个很难完成的任务。 因此,该epoll上场了。 epoll IO多路复用模型实现机制由于epoll的实现机制与select/poll机制完全不同,上面所说的 select的缺点在epoll上不复存在。 设想一下如下场景:有100万个客户端同时与一个服务器进程保持着TCP连接。而每一时刻,通常只有几百上千个TCP连接是活跃的(事实上大部分场景都是这种情况)。如何实现这样的高并发? 在select/poll时代,服务器进程每次都把这100万个连接告诉操作系统(从用户态复制句柄数据结构到内核态),让操作系统内核去查询这些套接字上是否有事件发生,轮询完后,再将句柄数据复制到用户态,让服务器应用程序轮询处理已发生的网络事件,这一过程资源消耗较大,因此,select/poll一般只能处理几千的并发连接。 epoll的设计和实现与select完全不同。epoll通过在Linux内核中申请一个简易的文件系统(文件系统一般用什么数据结构实现?B+树)。把原先的select/poll调用分成了3个部分: 1)调用epoll_create()建立一个epoll对象(在epoll文件系统中为这个句柄对象分配资源) 2)调用epoll_ctl向epoll对象中添加这100万个连接的套接字 3)调用epoll_wait收集发生的事件的连接 如此一来,要实现上面说是的场景,只需要在进程启动时建立一个epoll对象,然后在需要的时候向这个epoll对象中添加或者删除连接。同时,epoll_wait的效率也非常高,因为调用epoll_wait时,并没有一股脑的向操作系统复制这100万个连接的句柄数据,内核也不需要去遍历全部的连接。 下面来看看Linux内核具体的epoll机制实现思路。 当某一进程调用epoll_create方法时,Linux内核会创建一个eventpoll结构体,这个结构体中有两个成员与epoll的使用方式密切相关。eventpoll结构体如下所示: 每一个epoll对象都有一个独立的eventpoll结构体,用于存放通过epoll_ctl方法向epoll对象中添加进来的事件。这些事件都会挂载在红黑树中,如此,重复添加的事件就可以通过红黑树而高效的识别出来(红黑树的插入时间效率是lgn,其中n为树的高度)。 而所有添加到epoll中的事件都会与设备(网卡)驱动程序建立回调关系,也就是说,当相应的事件发生时会调用这个回调方法。这个回调方法在内核中叫ep_poll_callback,它会将发生的事件添加到rdlist双链表中。 在epoll中,对于每一个事件,都会建立一个epitem结构体,如下所示: struct list_head rdllink;struct epoll_event event;当调用epoll_wait检查是否有事件发生时,只需要检查eventpoll对象中的rdlist双链表中是否有epitem元素即可。如果rdlist不为空,则把发生的事件复制到用户态,同时将事件数量返回给用户。

epoll数据结构示意图 从上面的讲解可知:通过红黑树和双链表数据结构,并结合回调机制,造就了epoll的高效。 OK,讲解完了Epoll的机理,我们便能很容易掌握epoll的用法了。一句话描述就是:三步曲。 第一步:epoll_create()系统调用。此调用返回一个句柄,之后所有的使用都依靠这个句柄来标识。 第二步:epoll_ctl()系统调用。通过此调用向epoll对象中添加、删除、修改感兴趣的事件,返回0标识成功,返回-1表示失败。 第三部:epoll_wait()系统调用。通过此调用收集收集在epoll监控中已经发生的事件。 总结epoll机制epoll是一种高效的事件驱动I/O模型,它是Linux内核提供的一种I/O多路复用机制,可以同时监控多个文件描述符的I/O事件,当有文件描述符就绪时,可以立即通知用户态程序进行处理,从而提高了I/O操作的效率和并发处理能力。 epoll的核心思想就是利用内核的事件通知机制,将连接套接字加入到一个事件表中,当连接套接字上有I/O事件发生时,内核会通过事件通知机制通知应用程序进行处理。与传统的I/O多路复用机制(如select和poll)相比,epoll有以下优点: 处理大量连接:epoll支持大量的连接,可以同时处理成千上万个连接,而select和poll的连接数有限。 高效的事件通知:epoll采用了基于事件的通知机制,只有当连接套接字上有I/O事件发生时,才会进行通知,避免了无用的轮询,从而提高了I/O操作的效率。 内存复制次数少:epoll使用内存映射技术,可以将事件表直接映射到用户空间,避免了内存复制的开销,从而提高了应用程序的效率。 支持Edge Trigger模式:在Edge Trigger模式下,只有当连接套接字上的I/O事件状态发生变化时,才会进行通知,避免了重复通知和重复处理的问题,提高了应用程序的效率。 总之,epoll机制是一种高效的I/O多路复用机制,它可以支持大量的连接和高效的事件通知机制,其核心思想是利用内核事件通知机制,将连接套接字加入到一个事件表中,当连接套接字上有I/O事件发生时,内核会通过事件通知机制通知应用程序进行处理。 观此博客有感借鉴https://blog.csdn.net/shenya1314/article/details/73691088梳理刚学知识,不胜感激! |

【本文地址】

今日新闻 |

推荐新闻 |