Hadoop学习(一) |

您所在的位置:网站首页 › centos7hadoop安装与配置 › Hadoop学习(一) |

Hadoop学习(一)

|

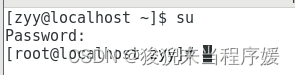

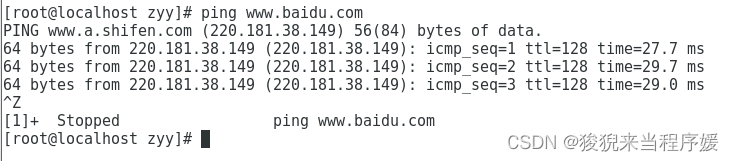

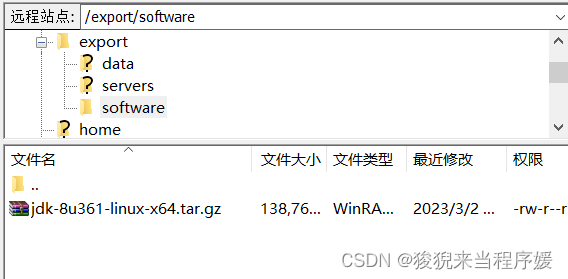

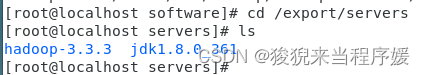

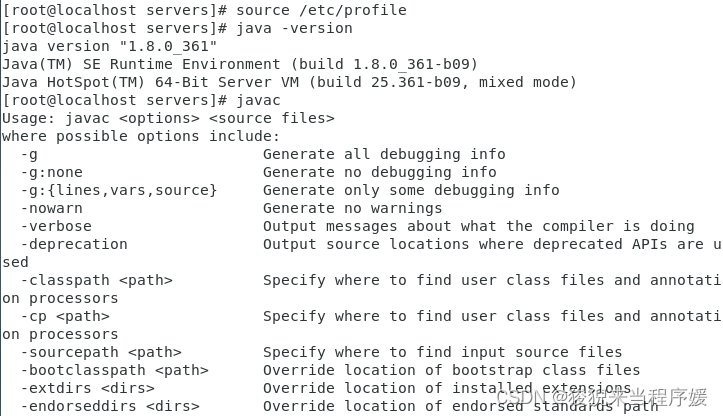

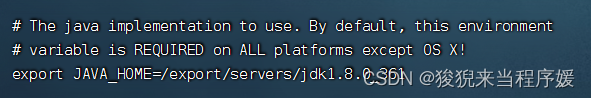

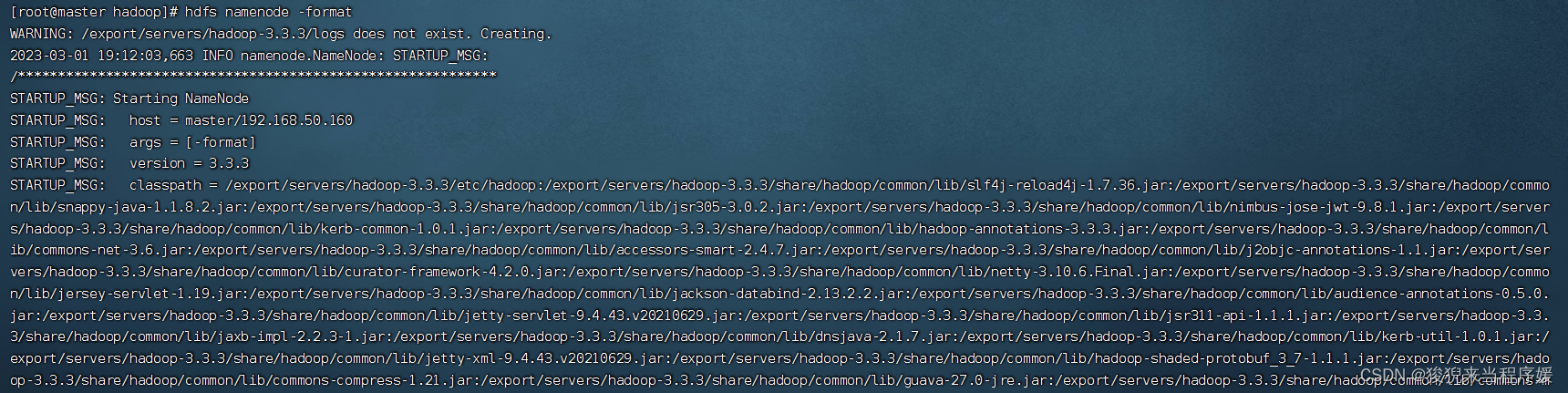

软件:VM Ware iso镜像:CentOS7 Hadoop版本:Hadoop-3.3.3 目录 一、创建虚拟机并安装CentOS系统 二、静态网络配置 三、安装Hadoop 1.下载Hadoop安装包 2.下载JDK安装包 3. 安装过程 4.克隆虚拟机 5.配置hoats文件和免密登录 6.Hadoop集群节点配置 7.格式化并启动节点 【好了之后一定要快照!!!避免重新安装!!】 【一起从0开始学Hadoop!!!】 一、创建虚拟机并安装CentOS系统 # 切换成root用户 su

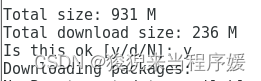

需要输入y,确保继续运行

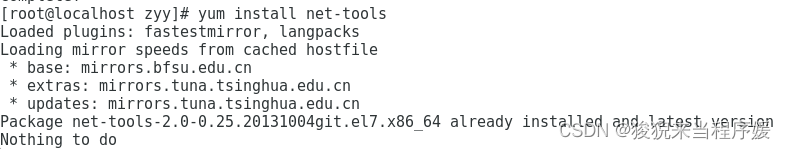

【这种情况是已经存在了,所以什么都不用做,如果没有,等待安装完成就行】

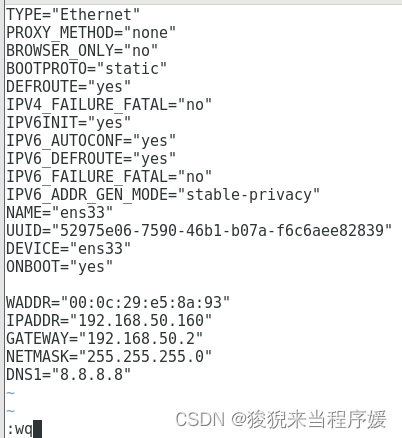

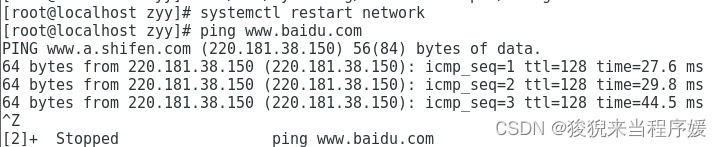

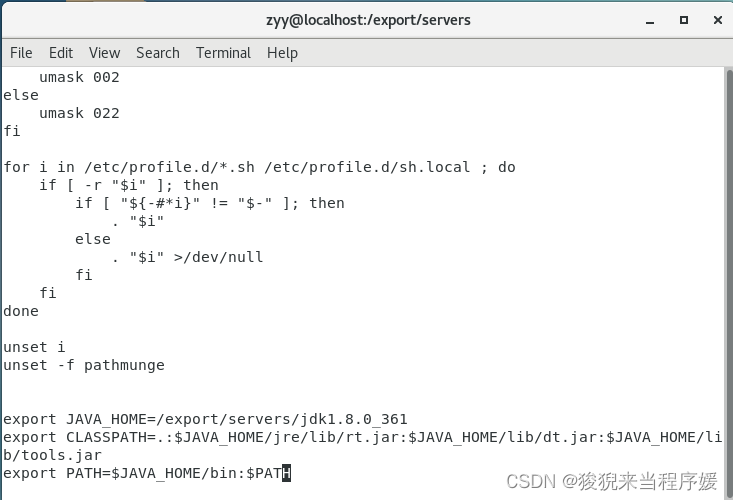

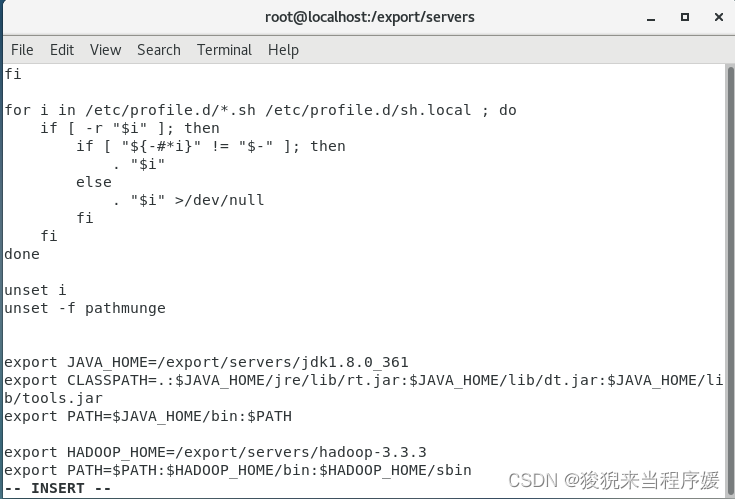

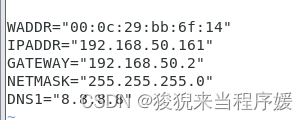

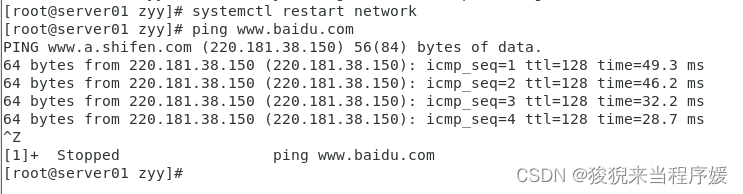

【使用 i 进入编辑模式,依次按下 esc : 输入wq 后按回车键,进行保存并退出】 BOOTPROTO的值设置为static ONBOOT的值设置为yes 子网掩码默认设置为255.255.255.0 网关的值为将ip地址中最后一段的值改为2 DNS使用谷歌提供的免费dns1:8.8.8.8

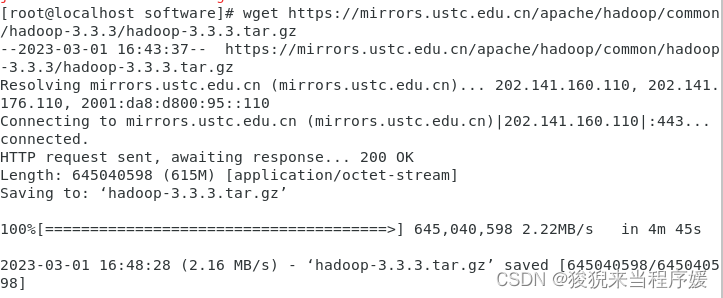

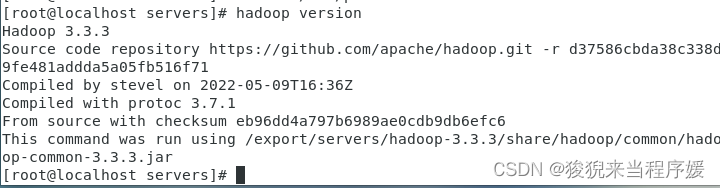

Index of /dist/hadoop/common/hadoop-3.1.3 方法二:通过wget下载 wget https://mirrors.ustc.edu.cn/apache/hadoop/common/hadoop-3.3.3/hadoop-3.3.3.tar.gz

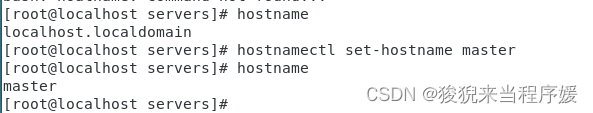

先去下面配置完集群再克隆,就不用最后一个问题解决了。 如果按先克隆,最后在格式化之前,将server01,server02的配置文件修改完再格式化也不会出问题。 # 修改虚拟机主机名 # 查看现在的名字 hostname # 修改第一台为master hostnamectl1 set-hoatname master # hostname再次查看一下,是否修改成功 hostname

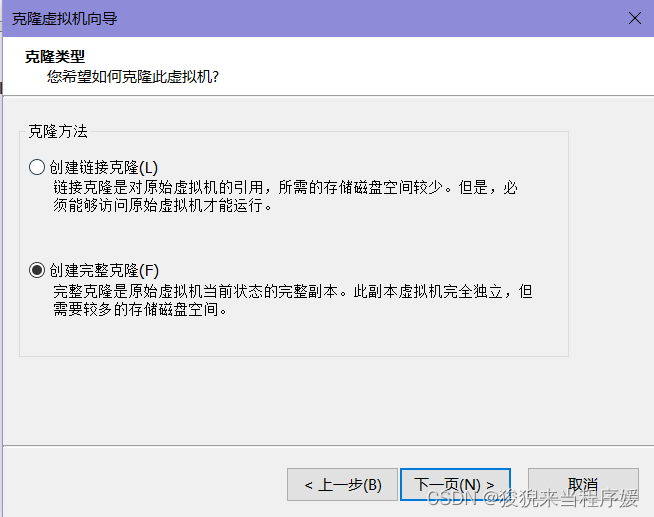

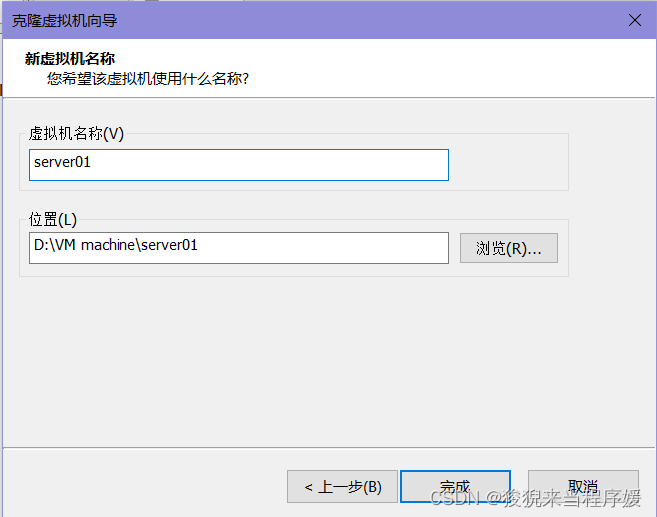

选择创建完整克隆

一个起名字server01,另一个起名字server02

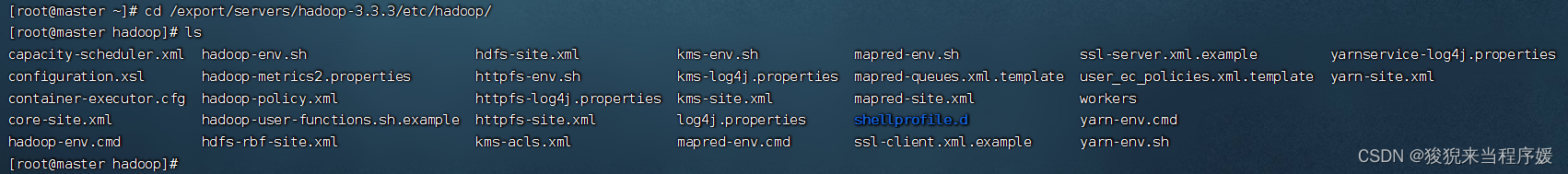

部分文件内容修改如下

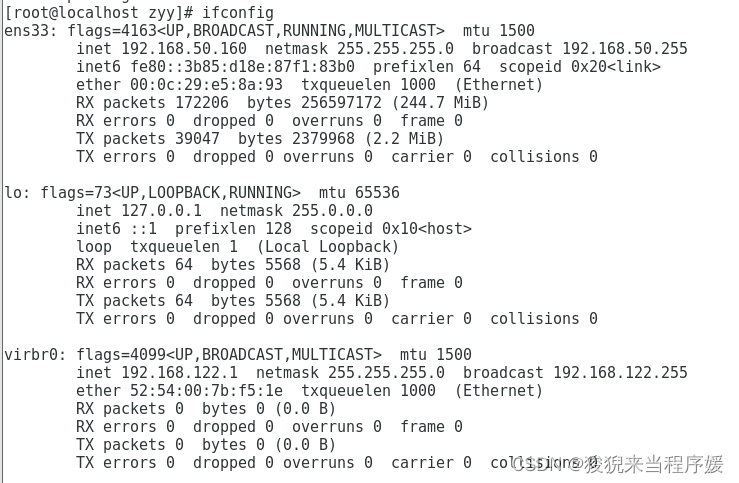

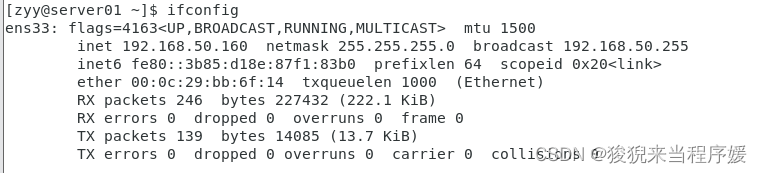

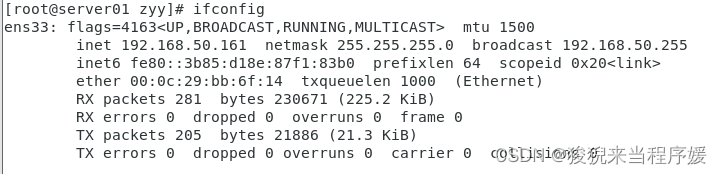

此时用ifconfig检查ip,发现已经修改成功

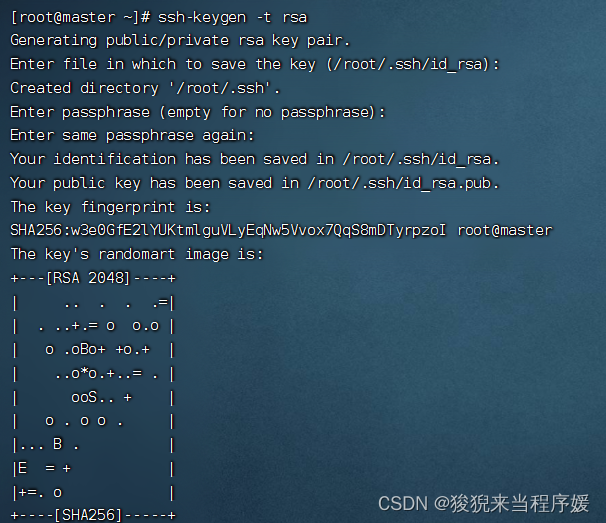

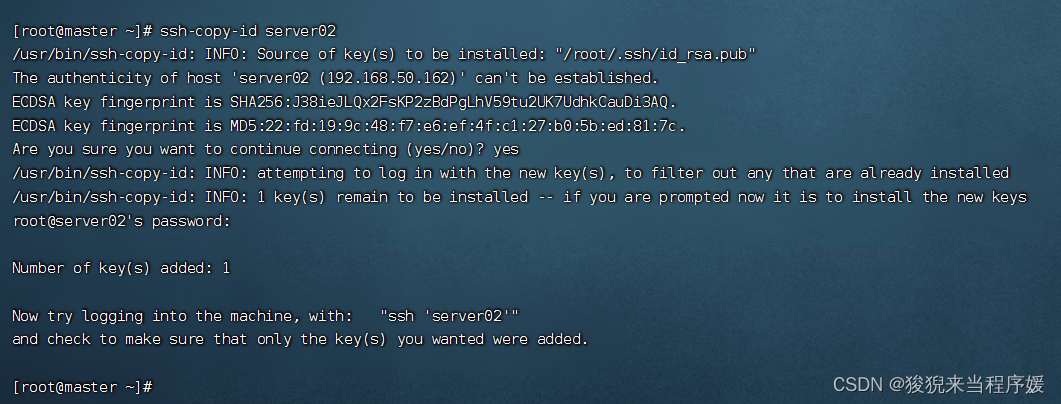

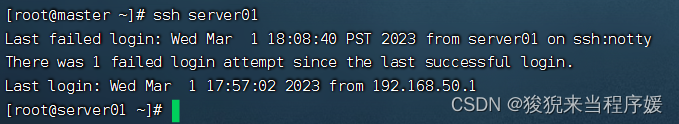

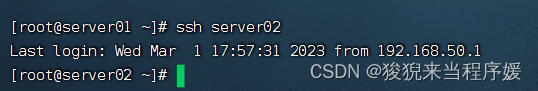

修改hosts文件 vi /etc/hosts # 添加以下内容 192.168.50.160 master 192.168.50.161 server01 192.168.50.162 server02 # 保存并退出 # 检查节点是否配置成功 ping master # ping slave1 # ping slave2配置免密登录 # master主机上生成密钥文件(四次回车) ssh-keygen -t rsa

添加以下内容: fs.defaultFS hdfs://hadoop01:9000 hadoop.tmp.dir /export/servers/hadoop-2.7.4/tmp

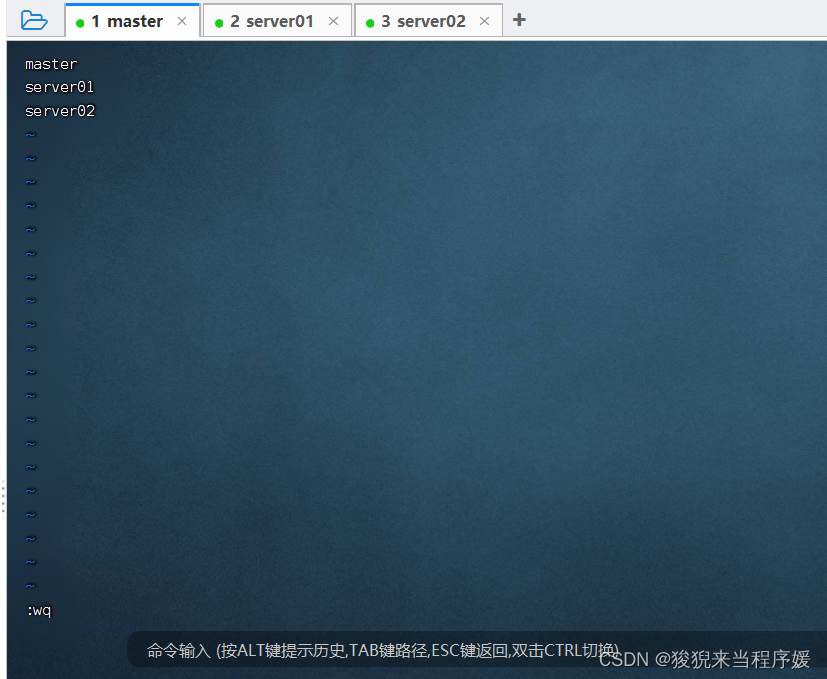

添加以下内容: dfs.replication 3 dfs.namenode.secondary.http-address server01:50090 # 进行文件备份 cp mapred-site.xml.template mapred-site.xml** # 修改mapred-site.xml文件 vi mapred-site.xml添加以下内容: mapreduce.framework.name yarn yarn.app.mapreduce.am.env HADOOP_MAPRED_HOME=/export/servers/hadoop-3.3.3 mapreduce.map.env HADOOP_MAPRED_HOME=/export/servers/hadoop-3.3.3 mapreduce.reduce.env HADOOP_MAPRED_HOME=/export/servers/hadoop-3.3.3 # 编辑文件 vi yarn-site.xml添加以下内容 yarn.resourcemanager.hostname master yarn.nodemanager.aux-services mapreduce_shuffle # 修改slaves文件 # 将文件中的localhost删除,添加主节点和子节点的主机名称 # 主节点master,子节点server01,server02 vi workers # hadoop3.x不使用slaves了

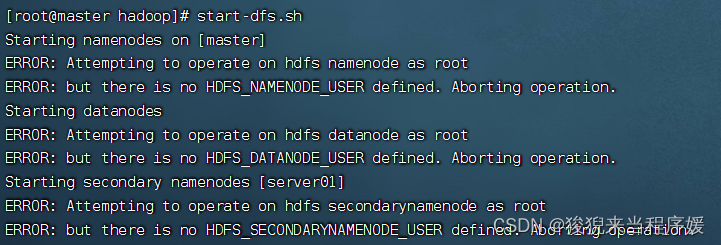

报错,发现没有设置用户

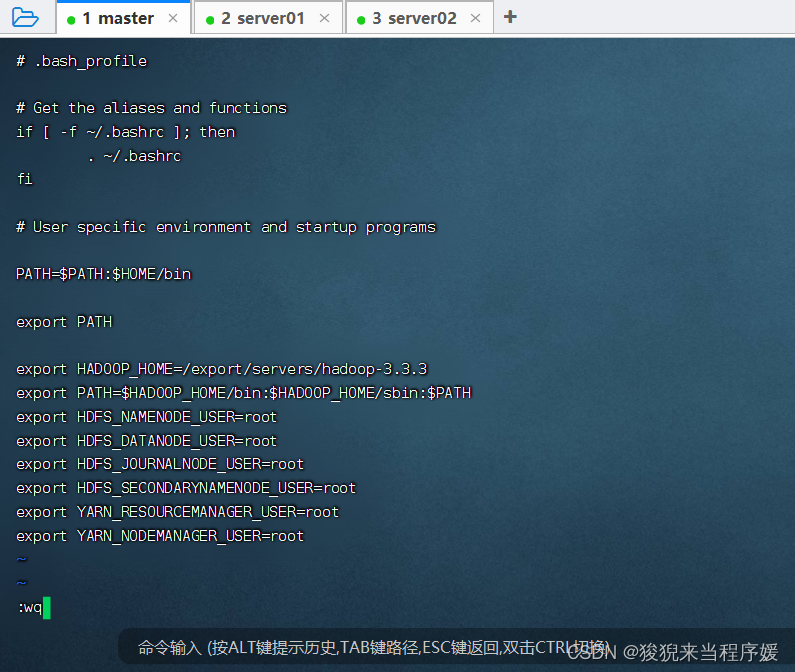

编辑资源文件 # 编辑资源文件 vi ~/.bash_profile

添加以下内容 export HADOOP_HOME=/export/servers/hadoop-3.3.3 export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH export HDFS_NAMENODE_USER=root export HDFS_DATANODE_USER=root export HDFS_JOURNALNODE_USER=root export HDFS_SECONDARYNAMENODE_USER=root export YARN_RESOURCEMANAGER_USER=root export YARN_NODEMANAGER_USER=root

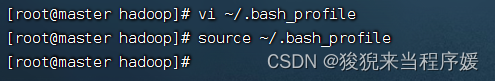

保存后更新资源文件

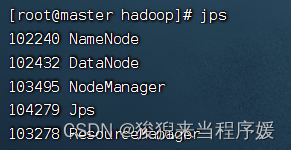

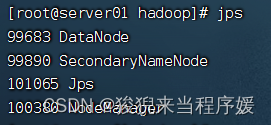

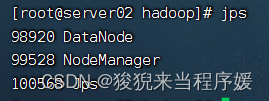

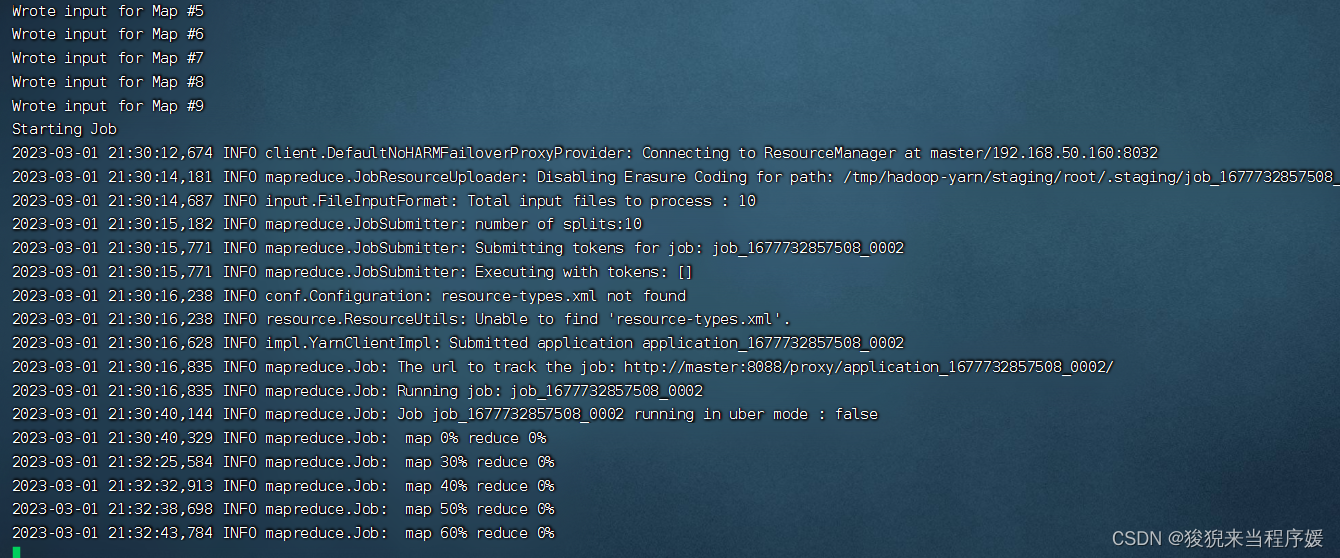

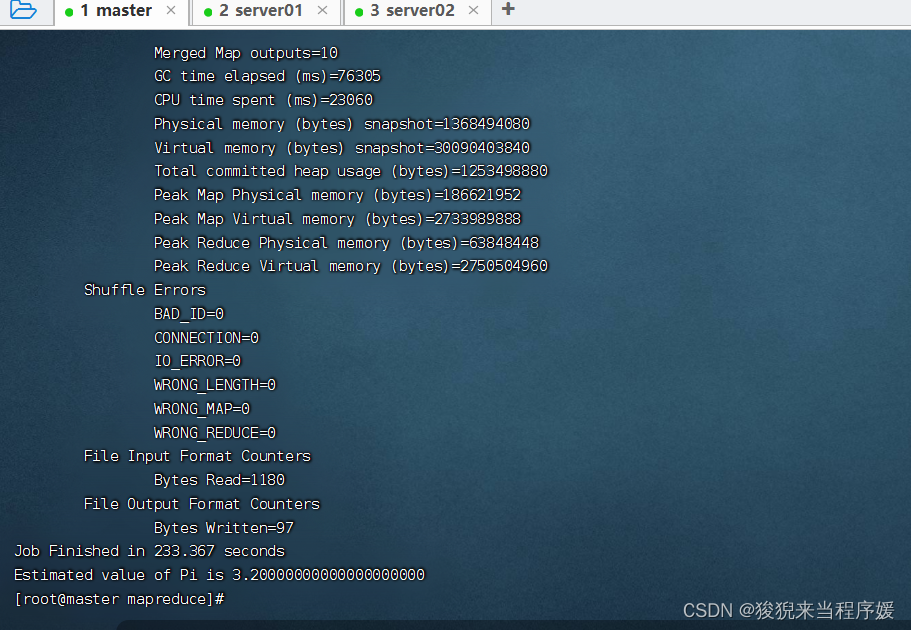

问题解决: 【发现子节点没有datanode】 # 停止所有集群 stop-all.sh【重新格式化集群】 # 删除$HADOOP_HOME下的tmp目录下的所有文件 # 删除logs下的所有文件 【三台机器,只有master有tmp目录】再次格式化就行 8.Linux里查看在web中检查 【虚拟机中使用火狐浏览器】 在浏览器地址栏中输入http://master:9870/,检查NameNode和DataNode是否正常;【3.0.0之前使用50070端口】 在浏览器地址栏中输入http://master:8088/,检查YARN是否正常 10.windows里查看去C:\Windows\System32\drivers\etc 管理员方式打开hosts文件 添加 192.168.50.160 master 192.168.50.161 server01 192.168.50.162 server02 然后在浏览器中输入上面的网址 11.运行实例检查 cd hadoop-3.3.3/share/hadoop/mapreduce/ hadoop jar hadoop-mapreduce-examples-3.3.3.jar pi 10 10

|

【本文地址】

今日新闻 |

推荐新闻 |